過去2年間、人工知能(AI)の「可能性と脅威」について多くの議論がなされてきた。AIシステムが化学兵器や生物兵器の製造を支援する可能性があるとの指摘もある。

これらの懸念はどの程度現実的なのか。生物テロリズムと健康インテリジェンスの分野の研究者として、我々はオンライン上の誇大宣伝から実際のリスクを区別しようと試みてきた。

「化学・生物」兵器への正確な影響はまだ不確実である。しかし、規制が技術の発展に追いついていないことは明らかである。

リスクの評価

AIモデルがもたらすリスクを評価することは容易ではない。さらに、一貫した広く採用された評価方法も存在しない。

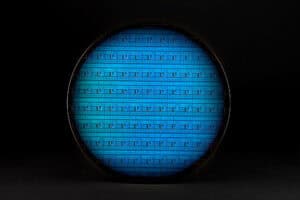

大規模言語モデル(LLM)の例を見てみよう。これらはChatGPT、Claude、Geminiなどのチャットボットの背後にあるAIエンジンである。

9月、OpenAIはo1(通称「Strawberry」)というLLMをリリースした。リリース時、開発者らは新システムが生物兵器の製造を支援するリスクは「中程度」であると主張した。

この評価は一見すると憂慮すべきものに思える。しかし、o1のシステムカードをより詳しく読むと、より些細なセキュリティリスクが明らかになる。

例えば、このモデルは未訓練の個人がウイルスに関する遺伝情報の公開データベースをより迅速に閲覧することを支援する可能性がある。このような支援がバイオセキュリティに与える実質的な影響は小さいと考えられる。

にもかかわらず、メディアはすぐに、この新モデルが「兵器化のリスクに意味のある貢献をした」と報じた。

チャットボットを超えて

2022年末に第一世代のLLMチャットボットが登場した際、これらのシステムが未訓練の個人によるパンデミックの引き起こしを支援する可能性があるという懸念が広く報じられた。

しかし、これらのチャットボットは既存のデータに基づいており、全く新しいものを生み出す可能性は低い。生物テロ組織の初期のアイデア出しや方向性の確立を支援する程度である。

チャットボットよりも、生命科学分野での応用を目的としたAIシステムの方が、より深刻な懸念事項である。AlphaFoldシリーズなどの多くは、疾病との戦いや新しい治療薬の探索を支援するものである。

しかし、一部のシステムには悪用される可能性がある。科学的に本当に有用なAIは、両刃の剣である可能性が高い:人類に大きな利益をもたらす可能性がある一方で、リスクも伴う技術である。

このようなAIシステムは「デュアルユース研究の懸念」と呼ばれるものの代表例である。

プリオンとパンデミック

デュアルユース研究の懸念自体は新しいものではない。バイオセキュリティや核不拡散の分野の専門家は長年これを懸念してきた。化学や合成生物学における多くのツールや技術は、悪意のある目的に使用される可能性がある。

例えば、タンパク質科学の分野では、新しい計算プラットフォームが、潜在的に致命的な異常折りたたみタンパク質であるプリオンの合成や、新規の毒素兵器の製造を支援する可能性があることが10年以上前から懸念されている。AlphaFoldなどの新しいAIツールは、このシナリオをより現実に近づける可能性がある。

しかし、プリオンや毒素は比較的小規模な集団に対して致命的である可能性があるものの、真の混乱をもたらすようなパンデミックを引き起こすことはできない。生物テロリズムの研究において、我々の主な懸念はパンデミックを引き起こす可能性のある病原体である。

歴史的に、生物テロリズムの計画はペストの原因菌であるYersinia pestisと、天然痘を引き起こすtariolaウイルスに焦点を当ててきた。

主な疑問は、新しいAIシステムが、これらのような病原体の入手や、ゼロからの作成を目指す未訓練の個人やグループにとって、具体的な違いをもたらすかどうかである。

現時点では、我々にはそれを知る術がない。

AIシステムを評価・規制するルール

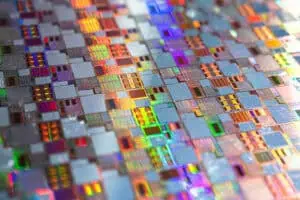

AIを活用した生物兵器のリスクという新しい状況をどのように評価するかについて、誰も確定的な答えを持っていない。最も進んだ計画は、2023年10月に発令されたAI開発に関する大統領令を通じて、退任予定のBiden政権によって示された。

この大統領令の重要な規定は、新しいAIシステムが化学、生物、放射性、または核兵器の拡散に与える可能性のある影響を評価するための基準を確立することを複数の米国機関に課している。専門家はこれらを「CBRN」という見出しでまとめることが多いが、我々が「CBRN+AI」と呼ぶ新しい力学はまだ不確実である。

この大統領令はまた、遺伝子合成に必要なハードウェアとソフトウェアを規制する新しいプロセスを確立した。これは、AIシステムによって生み出されたデジタルのアイデアを生物学的生命という物理的な現実に変換するための機械である。

米国エネルギー省は近く、新しいAIシステムによって生成される可能性のある生物学的リスクを管理するためのガイダンスを発表する予定である。これは、今後数年間でAIがバイオセキュリティにどのような影響を与える可能性があるかを理解するための道筋を提供するものである。

政治的圧力

これらの萌芽的な規制は既に政治的圧力にさらされている。米国での次期Trump政権は、「急進的左派のアイデア」に基づいているとの懸念から、BidenのAIに関する大統領令を撤回することを約束している。この立場は、バイオセキュリティとは無関係な米国のアイデンティティ政治における争いに影響されている。

不完全ではあるが、この大統領令は今後数年間でAIが化学・生物学的脅威の拡散にどのような影響を与えるかを理解するための最良の青写真である。これを撤回することは、米国の国益と、広く人類の安全保障全体に対する大きな不利益となるだろう。

コメント