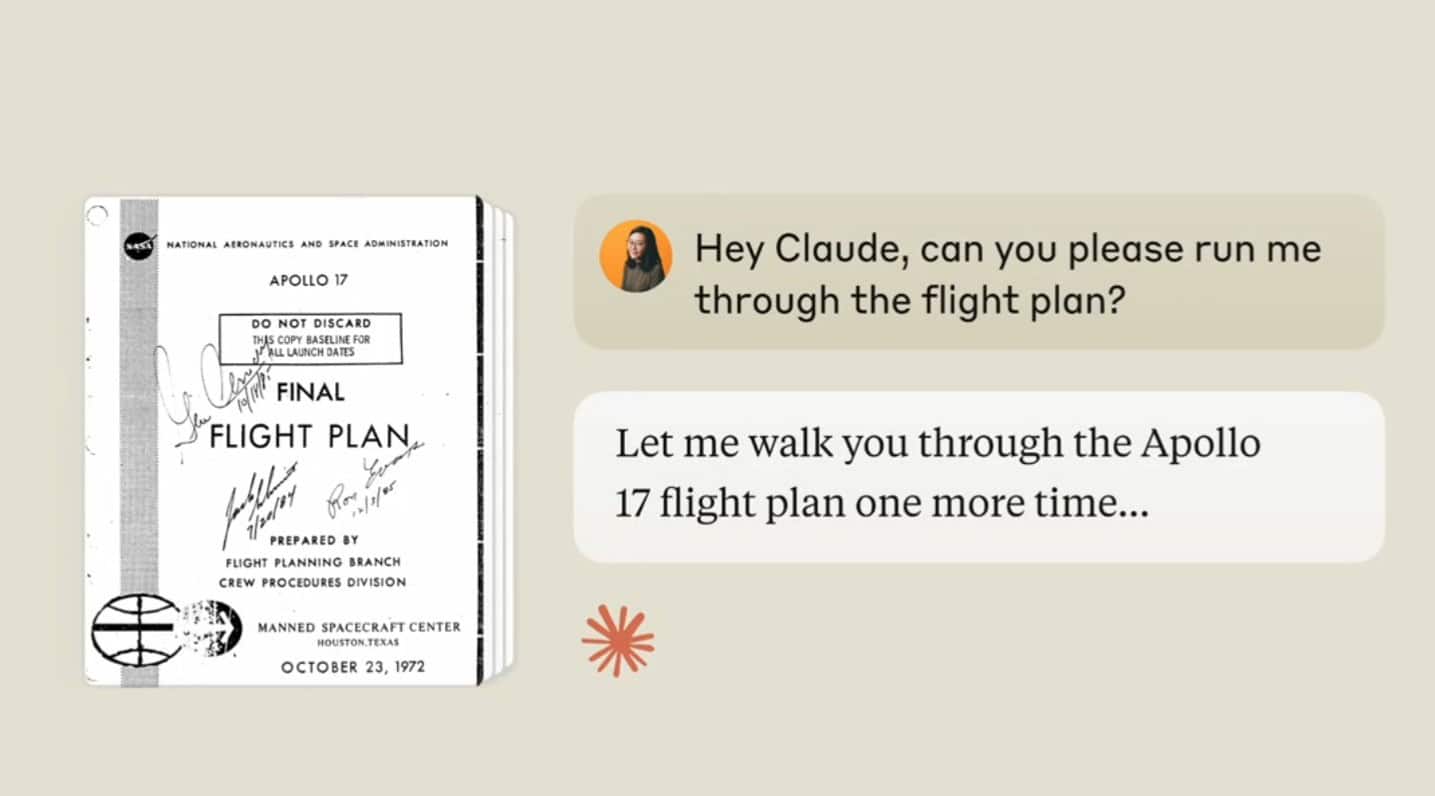

Anthropicは同社のAIモデル「Claude 3.5 Sonnet」に、PDF文書内の画像、グラフ、表などの視覚要素を解析できる新機能を追加したことを発表した。この機能は現在パブリックベータとして提供されている。

新機能の概要と処理の仕組み

PDFの処理は3段階で行われる。まず文書からテキストを抽出し、次に各ページを画像に変換、最後にテキストと視覚要素の両方を統合的に分析する。これにより、財務報告書や法的文書、研究論文など、画像や図表を含む複雑な文書の総合的な理解が可能となった。

AnthropicのAlex Albert氏は、「これまでPDFを添付した場合、テキスト抽出サービスを使用してテキストのみを取得していたが、今回からClaudeがPDFを視覚的に認識できるようになった」と説明している。

利用に際しての詳細

本機能には以下の制限が設けられている:

- ファイルサイズ:32MB未満

- ページ数:100ページ以下

- 暗号化・パスワード保護されたPDFは非対応

- 1ページあたり1,500〜3,000トークンを消費

機能の利用には「Feature Previews」から「Visual PDFs」を有効化する必要がある。API経由での利用も可能で、ヘッダーに「anthropic-beta: pdfs-2024-09-25」を指定することで利用できる。

また、Anthropicは以下のガイドラインを推奨している:

- 明確で読みやすいテキストの使用

- ページの適切なアライメント

- PDFビューワーに表示されるページ番号の使用

- APIリクエスト時はPDFをテキストの前に配置

- サイズ制限を超える場合は文書を分割

この機能強化により、Claudeの文書理解能力は大きく向上した。特に研究論文や技術文書など、視覚的な要素が重要な役割を果たす文書での活用が期待できる。また、最近発表されたComputer Use機能やGitHub Copilotとの統合など、Anthropicは急速に機能拡張を進めており、AIモデルの実用性を高める取り組みを加速させている。

コード実行能力やデータ可視化機能と組み合わせることで、ビジネスや研究開発における文書分析・処理の効率化に大きく貢献する可能性がある。今後のAmazon BedrockやGoogle Vertex AIへの対応拡大により、さらなる普及が期待される。

Source

- Anthropic: PDF support (beta)

コメント