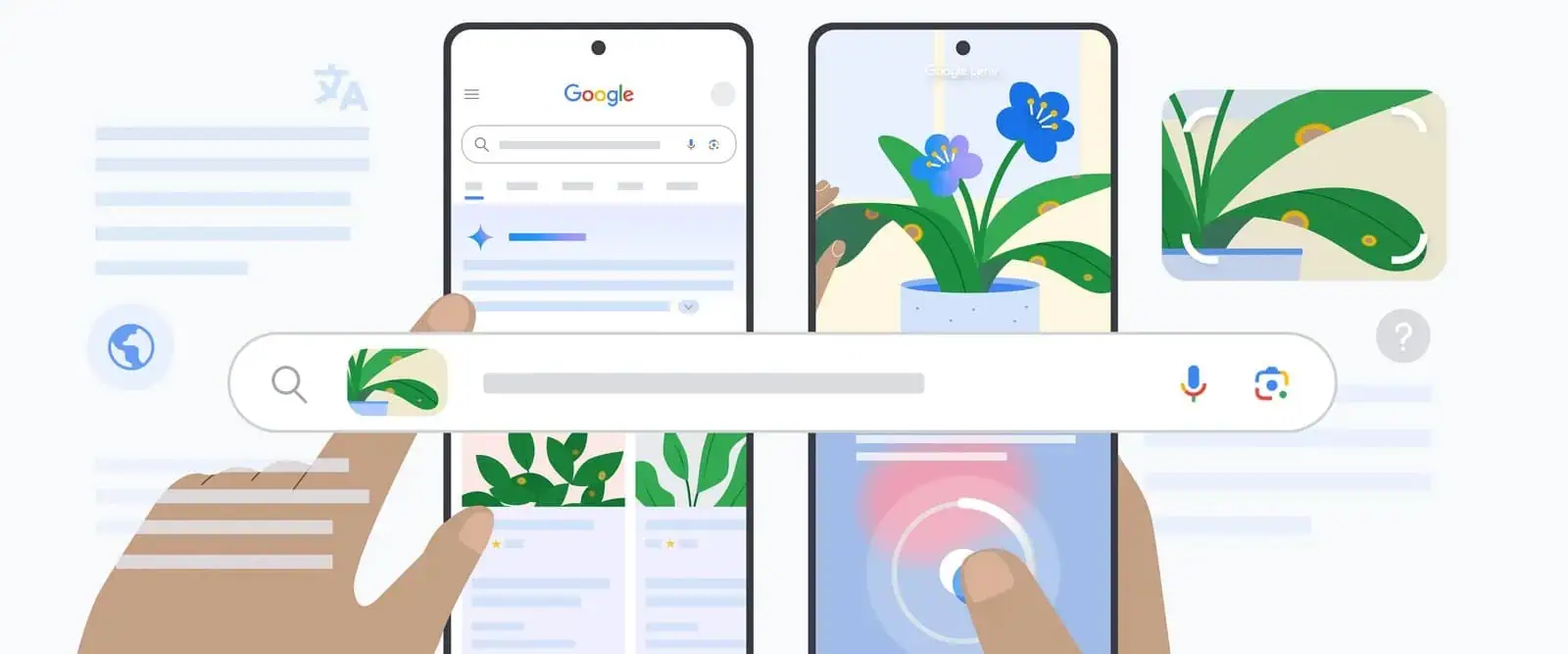

Google Lensが大幅なアップデートを受け、動画解析機能を新たに搭載した。この機能強化により、ユーザーは撮影中の動画内の対象物について、リアルタイムで質問することができるようになった。さらに、音声入力機能も追加され、写真や動画の検索がより直感的になった。

AIが動画を理解し、ユーザーの質問に答える

Google Lensの新機能は、Googleの最新AI技術であるGeminiモデルを活用している。この動画解析機能は現在、英語を使用するAndroidおよびiOSユーザー向けに提供されており、GoogleのSearch Labsプログラムに登録しているユーザーが利用できる。ユーザーはAndroidやiOSデバイスのGoogleアプリ内でLensを起動し、カメラのシャッターボタンを長押しすることで動画を撮影しながら、音声で質問を投げかけることができる。

例えば、水族館で興味深い魚の群れを見つけた場合、「なぜ魚たちは円を描いて泳いでいるの?」といった質問をすることが可能だ。システムは動画の内容と質問を理解し、AIを用いて生成された概要(AI Overview)と共に、Web上の関連リソースを提示する。例えば、水族館で魚の群れを撮影しながら「なぜ魚が輪を描いて泳いでいるの?」と尋ねると、Lensは該当する場面を解析し、AIが生成した概要と共に、追加情報へのリンクを提供する。

Googleの製品管理ディレクターであるLou Wang氏は、この機能について次のように説明している。「AIを使用して、動画の中で最も興味深く、質問に関連するフレームを特定し、それをもとにAI Overviewsからの回答を生成します」。

音声入力とショッピング機能の拡張

Lensの新機能は動画検索だけにとどまらない。静止画の撮影時にも音声で質問できるようになり、より自然な方法で周囲の物事について探索することが可能になった。

さらに、ショッピング関連の機能も強化された。Lensが製品を認識すると、価格、ブランド、レビュー、在庫状況などの情報を表示する。この機能は現在、電子機器、おもちゃ、美容製品などの特定のカテゴリーで利用可能だ。

検索結果ページのAI活用と広告統合

Googleは検索結果ページの構成にもAIを活用し始めている。AIによって整理された検索結果ページでは、ユーザーの質問に関連するコンテンツや様々な見解がWeb全体から集められ、情報を簡単に見つけられるようになっている。

また、生成されたAIによる概要にも新しいデザインが導入され、関連するWebページへのインラインリンクが追加された。これにより、ユーザーは興味のあるサイトにより簡単にアクセスできるようになった。

さらに、AIによる概要に広告を統合する試みも始まっている。関連するビジネスや製品の広告を表示することで、ユーザーの検索体験をさらに向上させることを目指している。

現在、この機能は電子機器、おもちゃ、美容製品などの一部のカテゴリーで利用可能だ。Googleによると、毎月約40億件のLens検索がショッピングに関連しているという。

Xenospectrum’s Take

Google Lensの新機能は、視覚的検索と音声入力を組み合わせることで、ユーザーエクスペリエンスを大きく向上させている。この統合により、GoogleはAI駆動の検索市場でのリーダーシップを強化し、競合他社に対して優位性を確立したと言える。

特に注目すべきは、この機能がGeminiモデルを基盤としている点だ。GeminiはGoogleの最新AIモデルであり、マルチモーダル処理能力に優れている。これにより、画像や動画の文脈を理解し、関連する情報を抽出する能力が大幅に向上している。

さらに、この機能はモバイルファーストの時代に即したものだ。スマートフォンのカメラを通じて世界を探索し、即座に情報を得られるこの機能は、特に若い世代のユーザーに訴求するだろう。若い世代はスマートフォンを日常的に活用し、視覚的で直感的なインターフェースに慣れているため、このようなインタラクティブな機能に強い関心を持つと考えられる。

Sources

コメント