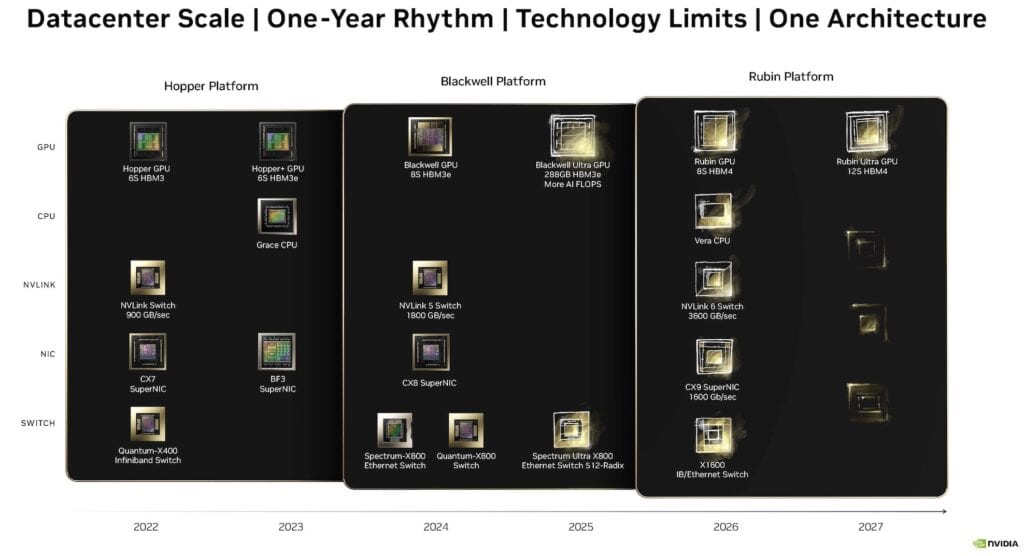

NVIDIAのCEO Jensen Huang氏は、同社の四半期決算発表の場で、次世代AI GPU「Blackwell Ultra」と「Vera Rubin」の開発が予定通り進行していることを確認した。Blackwell Ultraは2025年後半の発売が予定され、Vera Rubinは2026年に登場する見通しだ。2025年3月のGTCではさらに将来の製品についても言及される予定とのことだ。

Blackwell Ultraの詳細と計画

Blackwell Ultra(B300シリーズ)は、2025年後半にリリース予定のNVIDIAの次世代AI向けGPUである。現行のBlackwell(B200シリーズ)に対して大幅な性能向上が見込まれており、非公式情報によれば約50%のパフォーマンス向上が期待されている。Huang氏は「Blackwell Ultraは新しいネットワーキング、新しいメモリ、そして新しいプロセッサーを搭載する」と述べている。

技術仕様としては、8スタックの12-Hi HBM3E(High Bandwidth Memory、高帯域幅メモリの第3世代拡張版)を採用し、最大288GBのオンボードメモリを提供することになる。これは現行のBlackwellの192GBから大幅に増加した容量である。また、TDP(Thermal Design Power、熱設計電力)は1000Wから1400Wへと増加し、計算能力の向上を実現するための電力要件も高まっている。FP4(4ビット浮動小数点演算)性能においては約1.4倍の向上が見込まれている。

Blackwell Ultraは、Mellanox Spectrum Ultra X800イーサネットスイッチと組み合わせて提供される予定で、このスイッチは512ポートをサポートし、AIクラスター内の通信効率を大幅に向上させる。

Huang氏は、過去にBlackwell(B200)の開発で生じた問題について「完全に回復した」と述べ、「多くのサプライチェーンパートナーと多くの人々の助けにより、光速で回復した」と強調した。また、この問題が年間製品サイクルに影響を与えないことも確認している。

Blackwell Ultraは、現行のBlackwellと次世代のVera Rubinアーキテクチャの架け橋的な位置づけであり、NVIDIAが主流クライアント向けに選択肢を最大化する意図があるとされる。

Vera Rubinアーキテクチャの展望

「次のクリックはVera Rubinと呼ばれる」とHuang氏が表現するように、Rubinアーキテクチャは2026年に登場予定のNVIDIAの次世代GPU技術である。Huang氏はこのアーキテクチャについて「大きな、大きな、巨大な飛躍を提供する」と述べており、AIコンピューティング能力において大幅な向上が期待されている。

Vera Rubinの最大の特徴は、HBM4(High Bandwidth Memory第4世代)の採用である。この次世代メモリ技術は、コンピューティング市場の将来的な進化において重要な役割を果たすとされている。これまで明らかになっている情報では、Rubinプラットフォームは8スタックのHBM4メモリを搭載し、最大288GBのメモリ容量を提供する予定である。

さらに、Rubinプラットフォームには、Vera CPUやNVLink 6スイッチ(3600GB/秒の帯域幅)、CX9ネットワークカード(1600Gb/秒対応)、X1600スイッチなど、包括的なエコシステムが統合される予定だ。これにより、高度なAIワークロード向けの総合的なインフラストラクチャが実現される。

Vera Rubinアーキテクチャは2025年3月のGTCで発表される予定だが、実際の製品リリースは2026年になると見られている。Huang氏によれば、「すべてのパートナーがそのトランジションに向けて準備を進めている」状況だという。

ポストRubin計画とNVIDIAの長期戦略

興味深いことに、Huang氏は2025年3月のGPU Technology Conference(GTC)において、Rubinの次の製品についても言及する予定であることを明らかにした。「GTCに来て、Blackwell Ultraについて話そう。Rubinについても話し、その次のクリックについても見せよう。本当に、本当にエキサイティングな新製品だ」とHuang氏は述べている。

このポストRubinについては、Rubin Ultraであることが明かされており、2027年頃に登場すると予測されている。この製品は12スタックのHBM4Eメモリを搭載し、5.5レチクルサイズのCoWoS(Chip-on-Wafer-on-Substrate、積層チップ実装技術)インターポーザーと100mm×100mmのTSMC基板を使用する画期的な製品になると見られている。

NVIDIAは、人工知能技術の発展に合わせて年間製品サイクルを維持しながら、継続的に革新的な製品を市場に投入する戦略を示している。Huang氏は「次の電車は年間リズムでやってくる」と表現し、製品開発の継続性を強調している。

Sources

コメント