Google DeepMindは、ロボットが折り紙やジッパー付き袋の操作などの繊細な作業を行うことを可能にする新たなAIモデル「Gemini Robotics」と「Gemini Robotics-ER」を発表した。両モデルはGemini 2.0を基盤とし、ロボットが物理世界でより効果的に機能するための視覚理解、言語処理、物理操作、空間認識の能力を大幅に向上させている。

Gemini Roboticsの概要と主要機能

Gemini RoboticsはGoogle DeepMindが開発した視覚-言語-行動(Vision-Language-Action、VLA)モデルで、大規模言語モデル「Gemini 2.0」を基盤としている。このモデルの特徴は、視覚情報の処理、言語コマンドの理解、物理的動作の生成を一体化している点にある。従来のロボット制御AIと比較して、一般性、インタラクティブ性、器用さという3つの主要な側面で大きな進歩を遂げている。

一般性(Generality)においては、トレーニング時に見たことのない新しい状況やタスクに適応する能力を持つ。Google DeepMindによれば、Gemini Roboticsは包括的な一般化ベンチマークにおいて、他の最先端VLAモデルと比較して平均2倍以上の性能を示したという。これは、新しい物体、多様な指示、新しい環境に対応できることを意味する。

インタラクティブ性(Interactivity)の面では、Gemini 2.0の言語理解能力を活用し、日常的な会話言語で表現された命令を理解・応答できる。ロボットは周囲を継続的に監視し、環境の変化や指示の変更を検出して、それに応じて行動を調整する。この種の制御、あるいは「操縦性」は、家庭から職場までのさまざまな環境でロボットアシスタントとの協力をより容易にする可能性がある。

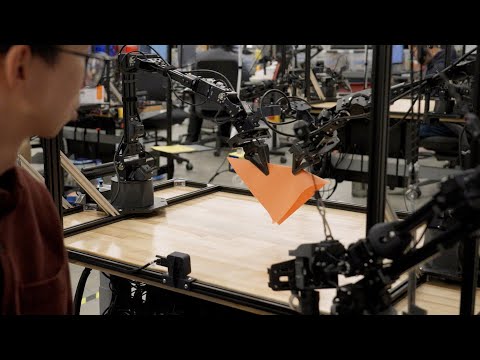

器用さ(Dexterity)に関しては、Gemini Roboticsは人間が苦もなく行う日常的なタスクでも、驚くほど繊細な運動技能を必要とするものに対応できる。例えば、折り紙の折り方やジップロック袋へのスナック収納など、正確な操作を必要とする複雑な多段階タスクに取り組むことができる。

さらに、Gemini Roboticsは異なるタイプのロボットに容易に適応できるよう設計されている。主にALOHA 2と呼ばれる双腕ロボットプラットフォームのデータで訓練されたが、多くの学術研究室で使用されているFrankaアームをベースにした双腕プラットフォームも制御可能であることが実証されている。さらに、Apptronik社が開発したヒューマノイドロボット「Apollo」のようなより複雑な実施形態にも特化させることができる。

Gemini Robotics-ERの空間理解能力と特徴

Gemini Robotics-ERは、「具現化推論」(Embodied Reasoning)の略称を持つ高度な視覚-言語モデルだ。このモデルはロボット工学に必要な方法で世界理解を強化し、特に空間推論に焦点を当てている。ロボット工学者はこのモデルを既存の低レベルコントローラーと接続することができる。

Gemini Robotics-ERは、ポインティングや3D検出などのGemini 2.0の既存能力を大幅に向上させている。空間推論とGeminiのコーディング能力を組み合わせることで、新しい機能をその場で生成することができる。例えば、コーヒーマグを見せると、モデルはハンドルを持って持ち上げるための適切な二本指グリップと、それに近づくための安全な軌道を直感的に理解できる。

このモデルは、知覚、状態推定、空間理解、計画、コード生成など、ロボットを制御するために必要なすべてのステップをすぐに実行できる。このようなエンドツーエンドの設定では、Gemini 2.0と比較して2~3倍の成功率を達成している。さらに、コード生成が十分でない場合、Gemini Robotics-ERは文脈内学習(in-context learning)の力を活用し、少数の人間によるデモのパターンに従って解決策を提供することもできる。

Gemini Robotics-ERの主な革新点は、人間が経験を通じて時間をかけて発達させる直感的な物理世界理解を模倣しようとしている点にある。人間は以前に見たことのない物体を見て、それとどのように相互作用するのが最善かについて教育的な推測を行うことができるが、これはDeepMindがGemini Robotics-ERで再現しようとしている能力である。

実演された能力と実用例

Google DeepMindが公開したデモビデオでは、両AIモデルの能力を示す様々な実例が紹介されている。特に注目すべき事例として、以下のものがある:

バスケットボールのスラムダンク:デモでは、ロボットアームに「バスケットボールを拾ってスラムダンクして」と指示すると、ロボットが慎重にミニチュアバスケットボールを拾い上げ、ミニチュアのネットに入れるシーンが見られる。Google DeepMindの主任ソフトウェアエンジニアであるKanishka Rao氏によれば、このロボットは「バスケットボールに関連することを一度も見たことがない」が、基礎となるモデルがゲームの一般的な理解を持ち、バスケットボールネットがどのように見えるか知っており、「スラムダンク」という用語の意味を理解していたため、「これらの概念を実際に物理世界でタスクを達成するために接続することができた」という。

折り紙の折り方:ロボットアームが紙を折り畳んで折り紙の狐を作る能力を実演した。これは、紙を慎重に扱い、複雑な折りパターンを理解して実行する高度な器用さを示している。

ジッパー付き袋の操作:プラスチック製のブドウをタッパーウェアのような透明容器に入れるよう指示された後、研究者がテーブル上で3つの容器を動かしても、ロボットアームは指示を完了するまで透明な容器を追跡し続けるデモも行われた。これは、変化する指示や状況に適応する能力を示している。

これらのデモは、Gemini Roboticsが従来のロボットAIモデルを超える能力を持っていることを示している。特に2023年に発表されたGoogle RT-2と比較すると、RT-2は既に練習した物理的動きを再利用することに限られていたのに対し、Gemini Roboticsは折り紙や袋への収納などの繊細なタスクを可能にする大幅に強化された器用さを実証している。これは、ロボットが単にコマンドを理解するだけでなく、繊細で正確な物理的タスクを実行できるロボットへの移行を示唆している。

安全性への取り組みとASIMOVデータセット

Google DeepMindは、AIとロボット工学の責任ある発展のために、安全性に関する「階層的、全体的アプローチ」を採用している。低レベルのモーター制御から高レベルの意味理解まで、研究における安全性に対処するためのこのアプローチは、ロボットと周囲の人々の物理的安全性を基本的に考慮している。

ロボット工学における古典的な安全対策には、衝突回避、接触力の制限、移動ロボットの動的安定性の確保などがある。Gemini Robotics-ERは、これらの「低レベル」の安全重視コントローラーと連携可能で、各特定の実施形態に固有のものである。Geminiのコア安全機能に基づき、Gemini Robotics-ERモデルは潜在的な行動が特定の文脈で安全に実行できるかどうかを理解し、適切な応答を生成できるようになっている。

学術界と産業界全体でロボット安全研究を促進するため、Google DeepMindは具現化AIとロボット工学における意味的安全性を評価・改善するための新しいデータセットも公開している。以前の研究では、アシモフのロボット三原則に触発された「ロボット憲法」がLLM(大規模言語モデル)がロボットにとってより安全なタスクを選択するのにどのように役立つかを示した。以来、ロボットの行動を導くためのデータ駆動型憲法(自然言語で直接表現されたルール)を自動的に生成するフレームワークを開発してきた。このフレームワークにより、人々はより安全で人間の価値観に沿ったロボットを開発するための憲法を作成、修正、適用できるようになるという。

新しく発表された「ASIMOV」データセットは、実世界のシナリオにおけるロボット行動の安全性の意味を厳密に測定するのに役立つとされる。このデータセットは、ロボットの安全性を物理的危害防止を超えて評価するための標準化された方法を作成するGoogle DeepMindの試みを表している。データセットは、AIモデルが様々なシナリオでロボットが取る可能性のある行動の潜在的結果をどれだけうまく理解できるかをテストするのに役立つよう設計されている。

Google DeepMindの発表によれば、Geminiモデルはこのベンチマークで「強力なパフォーマンス」を示し、技術レポートでは、モデルが質問の80%以上を正しく回答したことが示されている。

パートナーシップと将来の応用

Google DeepMindは今回の発表で、テキサス州オースティンに拠点を置くApptronik社との提携を発表し、「Gemini 2.0によって次世代のヒューマノイドロボットを構築する」と述べた。Gemini RoboticsはALOHA 2と呼ばれる双腕ロボットプラットフォームのデータを主に使用して訓練されたが、Apptronik社が開発したヒューマノイドロボット「Apollo」のようなより複雑な実施形態にも特化できることが示されている。

この提携はヒューマノイドロボットに対するGoogleの新たなアプローチを示しており、以前の取り組み(2013-2014年頃に複数のロボット企業を買収し、後に売却)とは異なる。Apptronik社との新しい提携は、大規模言語モデルに基づくこのサイクルの生成AIのためのヒューマノイドロボットアプローチの新たな展開のようだ。

Google DeepMindはまた、「信頼できるテスター」プログラムを通じてGemini Robotics-ERへの限定的なアクセスを提供している。このプログラムには、Boston Dynamics、Agility Robotics、Enchanted Toolsなどの企業が参加している。これは、ロボットを真に有用にするための有用なAI「ドライバー」の出現を目指す業界全体の取り組みの一部である。

ヒューマノイドロボットハードウェアについては、Figure AI(2024年3月にヒューマノイドロボットの大規模資金調達を確保)や前Alphabet子会社のBoston Dynamics(2023年4月に柔軟な新しいAtlasロボットを導入)などの企業が取り組んでいるが、ロボットを真に有用にするための有用なAI「ドライバー」はまだ登場していない。

Google DeepMindの発表では、新しいAIモデルの可用性タイムラインや具体的な商業応用については明らかにされておらず、これらは引き続き研究段階にある。Googleが共有したデモビデオはAI駆動の能力の進展を示しているが、制御された研究環境と予測不能な実世界の環境でこれらのシステムがどのように機能するかについては、まだ多くの疑問が残されている。

Sources