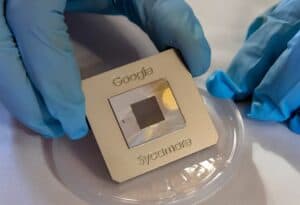

Googleは、オープンAIモデル「Gemma」を提供しているが、本日、飛躍的な性能と効率性を目指して設計された新しいアーキテクチャに基づく次世代モデル「Gemma 2」をリリースした。合わせて、2024年7月よりVertex AIを通じた提供も開始するとのことだ。

2倍の規模のモデルに匹敵する優れた性能を発揮

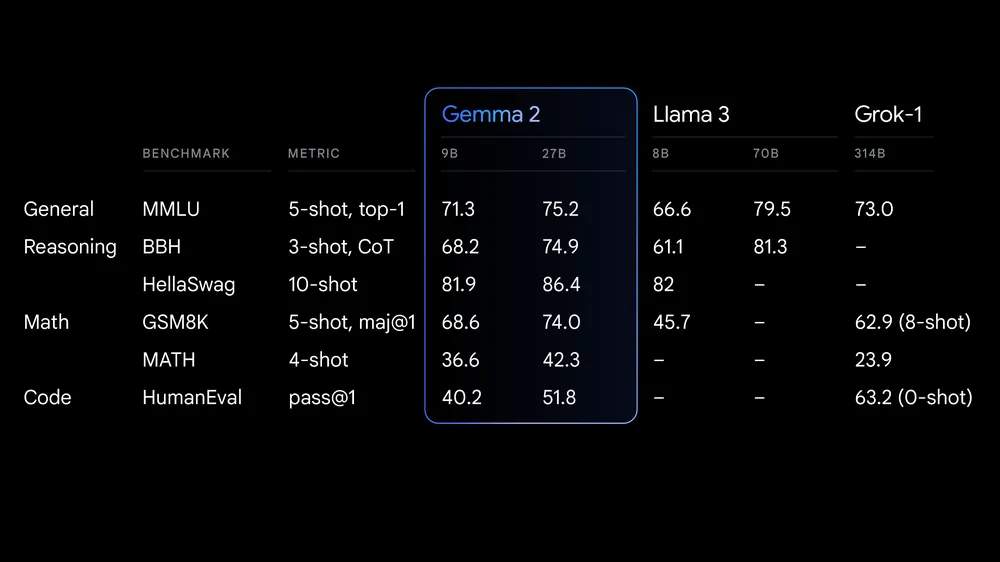

Gemma 2は、90億(9B)パラメータと270億(27B)パラメータの2つのサイズで提供される。この新世代モデルは全体的な推論能力が大幅に向上しており、初代Gemmaモデルよりも優れた性能を発揮する。Googleによると、27Bモデルは2倍以上の規模のモデルに匹敵する性能を発揮し、9BモデルはLlama 3 8Bや他の同規模のオープンソースモデルを凌駕するとのことだ。今後数か月のうちに、GoogleはスマートフォンのAIシナリオにより適した26億パラメータのGemma 2モデルをリリースする計画だ。

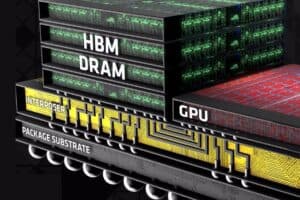

新しいGemma 2モデルは、単一のNVIDIA A100 80GB Tensor Core GPU、NVIDIA H100 Tensor Core GPU、または単一のTPUホストでホスティングでき、AIインフラストラクチャのコストを削減できる。Hugging Face Transformersを介して、NVIDIA RTXまたはGeForce RTXデスクトップGPUでGemma 2を実行することも可能である。来月から、Google Cloudの顧客はVertex AI上でGemma 2を展開および管理できるようになる。開発者は現在、Google AI Studioで新しいGemma 2モデルを試すことができる。

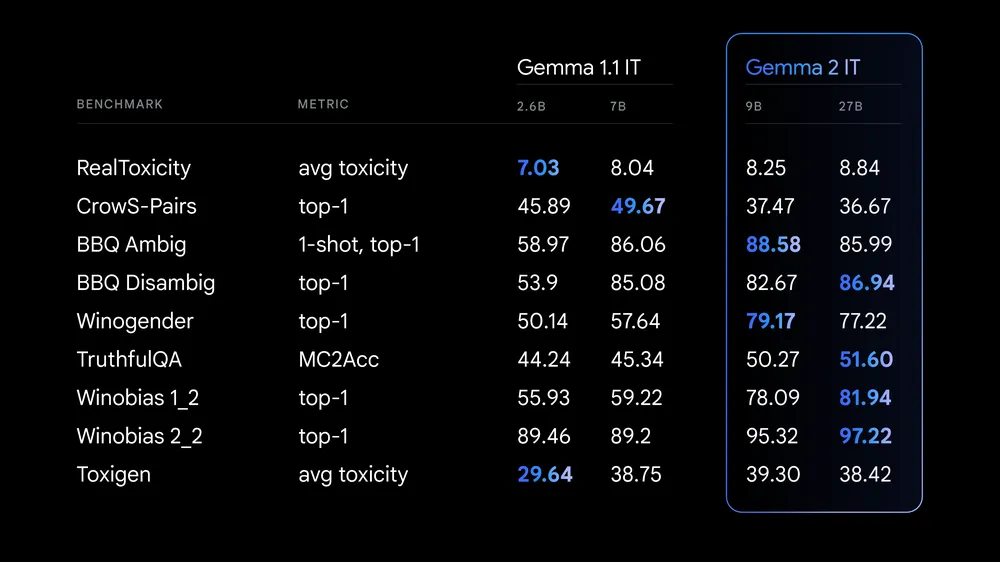

Gemma 2の訓練中、Googleは事前訓練データをフィルタリングし、包括的な安全性メトリクスに対してテストと評価を行い、潜在的なバイアスやリスクを特定し軽減した。

Googleは、KaggleまたはColabフリー層を通じてGemma 2を無料で提供している。学術研究者は、Gemma 2学術研究プログラムに応募してGoogle Cloudクレジットを受け取ることができる。

また、Gemma 2 のモデル ウェイトはKaggleとHugging Face Modelsからダウンロードすることが可能だ。

高性能、効率性、アクセシビリティの組み合わせにより、Gemma 2はオープンソースAI領域におけるゲームチェンジャーとなっている。Googleによると、新モデルは、スマートフォン、IoTデバイス、PCなどのエッジデバイスやアプリにAIを統合したい開発者を対象としている。

Source

コメント