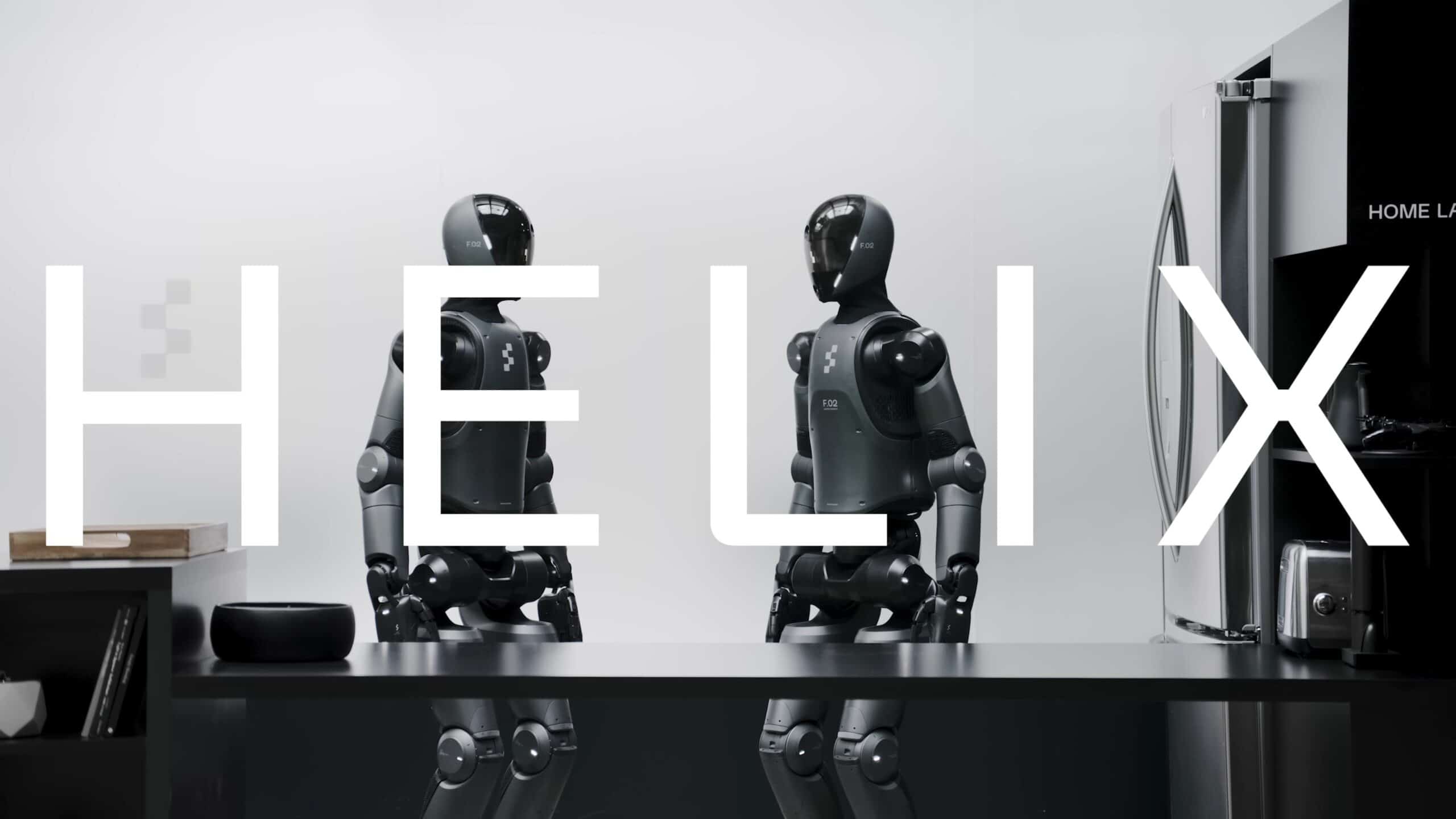

Figureは、家庭での利用を想定した人型ロボット向けに搭載される、画期的なVision-Language-Actionモデル「Helix」を発表した。OpenAIとの協業を解消後、独自開発されたHelixは、自然言語による指示で多様なタスクを実行できる、汎用性と実用性を兼ね備えたAIシステムとなる

Helix発表:家庭用ロボット実現へ新たな一歩

Figureが開発したHelixは、視覚、言語理解、動作制御を統合した汎用Vision-Language-Action(VLA)モデルだ。自然言語による指示を理解し、未知の物体でも柔軟に扱える能力を持つ。

FigureのCEO、Brett Adcock氏は、「Helixは人間の様に考えます…そしてロボットを家庭に導入するには、能力の段階的な変化が必要です。Helixは、事実上すべての家庭用品に一般化できます」と述べている。

今回の発表は、Figure AIがOpenAIとの協業から離れ、独自路線へと転換した直後に行われた点も特筆される。Adcock氏は、大規模言語モデル(LLM)がコモディティ化する状況下において、ロボット制御においては独自のAIモデル開発が不可欠であるとの認識を示した。

Helixの技術的特徴:System 1, System 2構成とデータ効率

Helixは、「System 1」と「System 2」という2つのAIシステムを組み合わせた、独自のアーキテクチャを採用している。

- System 1 (S1): 8000万パラメータのAIであり、200Hzの高速で動作し、視覚情報に基づきロボットの精密な動作制御を行う。

- System 2 (S2): 70億パラメータのマルチモーダル言語モデルであり、7-9Hzで動作し、言語と視覚情報を処理して、高レベルなシーン理解と指示解釈を実行する。

この構成により、Helixは高速な動作制御と高度な状況判断の両立を可能としている。また、Helixはわずか500時間の学習データで訓練されており、従来のVLAモデルと比較してデータ効率が高い点も特徴だ。

Helixは、35自由度の上半身を同時に制御し、指の動きから全身の姿勢に至るまで、滑らかで複雑な動作を可能にする。さらに、2台のロボットが協調して作業を行うことも可能だ。動画によるデモンストレーションでは、Helix搭載のロボットが、事前に学習していない物体であっても、自然言語の指示に従って冷蔵庫への食品の出し入れを行う様子が示された。

家庭環境での実用化と今後の展望

Figure AIは、Helixを家庭用ロボットの実用化に向けた重要なステップと位置づけている。倉庫や工場などの構造化された環境とは異なり、家庭は多様な物体や複雑なレイアウトが存在する、ロボットにとって非常に困難な環境である。

Helixは、家庭内の多様な物体を認識し、適切な動作を生成する能力を持つため、家事支援ロボットとしての応用が期待される。Adcock氏は、Helixが「事実上すべての家庭用品に対応できる」と述べ、その汎用性の高さを強調している。

もっとも、Helixはまだ開発初期段階にあり、実際の家庭環境における性能は未知数な部分も多く残されている。Figure AIは、今後Helixの性能向上と実用化に向け、さらなる研究開発を進めていく方針である。

Source

コメント