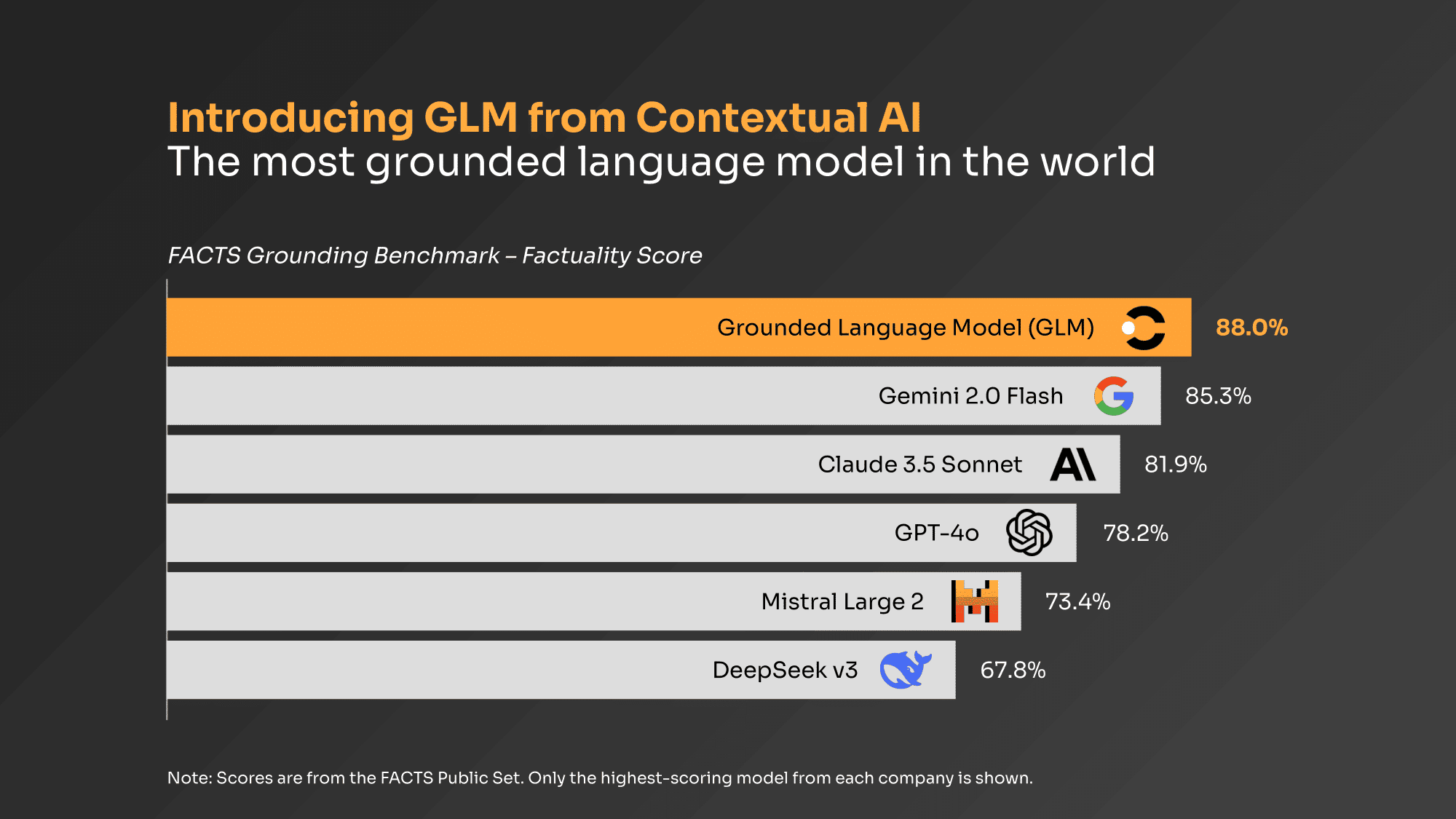

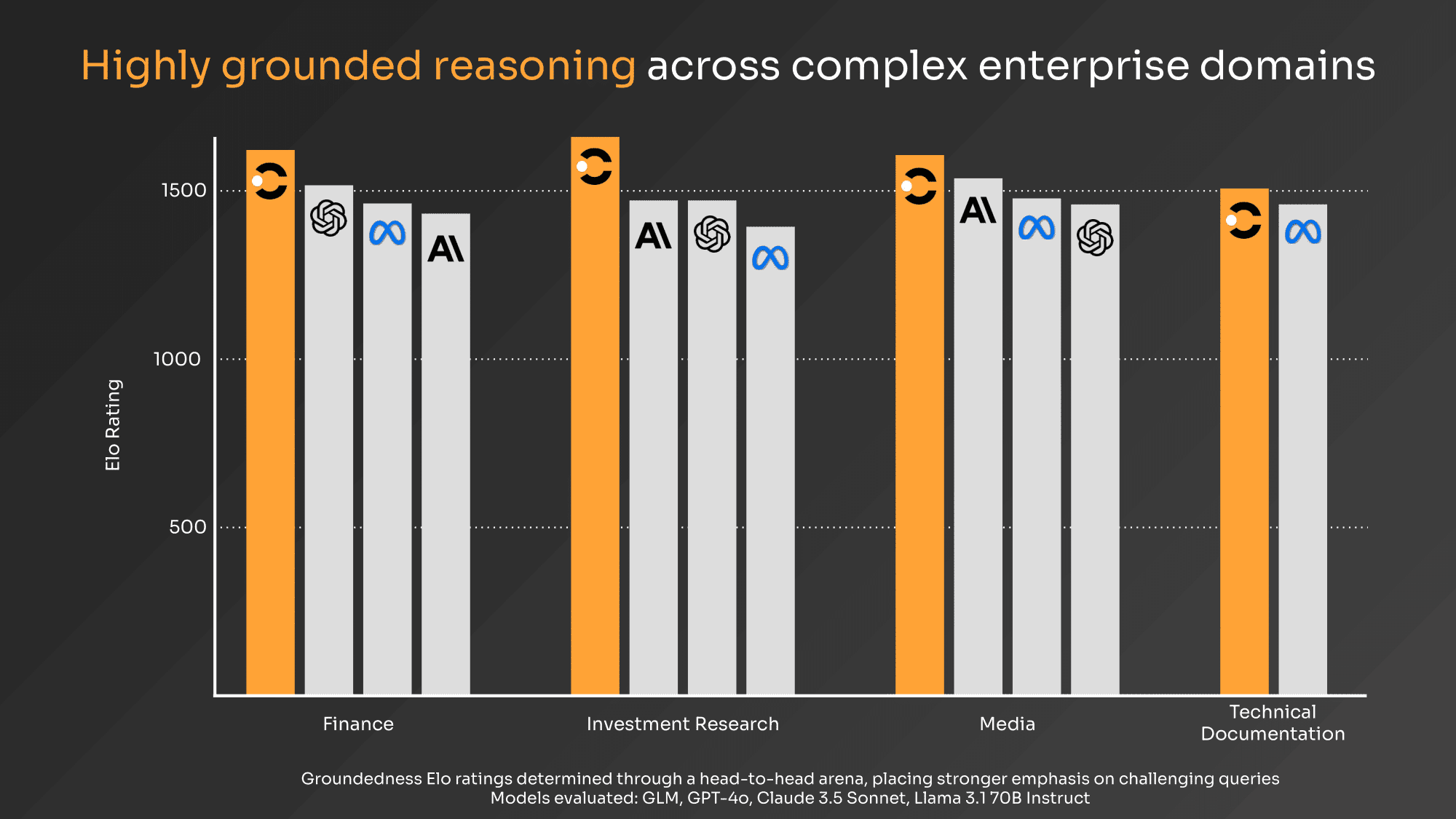

Contextual AI社が新たな言語モデル「GLM(Grounded Language Model)」を発表した。Googleが発表したFACTSベンチマークで88%の正確性を達成し、Google、Anthropic、OpenAIの主要モデルを上回る結果を示している。RAG(検索拡張生成)技術の創始者によって開発されたこのモデルは、特に企業での正確性が求められる用途において、既存モデルの課題であるハルシネーション(幻覚)問題の解決を目指している。

主要AIモデルを正確性で上回る性能

Contextual AIが発表したGLMは、AIモデルの事実適合性を測定する業界標準ベンチマーク「FACTS」において88%のスコアを記録。これはGoogleのGemini 2.0 Flash(84.6%)、AnthropicのClaude 3.5 Sonnet(79.4%)、OpenAIのGPT-4o(78.8%)を上回る結果となった。

大規模言語モデル(LLM)は、エンタープライズソフトウェアに革新をもたらしたが、事実誤認、いわゆる「ハルシネーション(幻覚)」は、企業での採用における重大な課題となっている。ContextualのCEO兼共同創業者のDouwe Kiela氏はVentureBeatのインタビューで「規制の厳しい業界の企業環境では、ハルシネーションに対する許容度はまったくない」と述べている。GLMの優位性は特に企業利用において重要な意味を持つといえる。

一般的なLLMは、創造的な文章作成から技術文書まで、あらゆるタスクに対応できるよう設計されている。一方、Contextual AIのGLMは、事実の正確性が最優先される、リスクの高い企業環境をターゲットにしている。「マーケティング部門にとって有用な汎用言語モデルは、ミスがより深刻な影響を及ぼす企業環境で求められるものとは異なる」とKiela氏は説明する。

GLMの中核となる「groundedness(根拠に基づいた性質)」とは、AIの生成出力が提供された情報に厳密に基づいていることを指す。GLMは与えられた文書に含まれる情報のみを使用して回答し、文書が関連しない場合は回答を拒否する設計となっている。これは一般的な基盤モデルが訓練データから学習したパターンに基づいて回答を生成(時にハルシネーションを引き起こす)するのとは対照的だ。

RAG技術を進化させた技術基盤

Contextual AIの創業チームはRAG(Retrieval-Augmented Generation:検索拡張生成)技術の原著論文の共著者である。RAGとは、言語モデルが回答を生成する際に外部の情報源から関連情報を検索・参照する手法だ。

同社の技術的アプローチは「RAG 2.0」と呼ばれる。従来のRAGシステムが既製のコンポーネント(埋め込みモデル、ベクトルデータベース、言語モデル)を単に組み合わせるのに対し、Contextual AIのアプローチはシステム全体を統合的に最適化している。

「私たちは混合検索器コンポーネントを持っており、これはインテリジェントな検索を行う方法です。質問を見て、最新世代のモデルのように考え、最初に検索戦略を計画します」とKiela氏は説明する。

GLMの特筆すべき機能として、インラインアトリビューションがある。これは生成中の回答に情報源の引用を直接組み込む機能で、各情報が正確にどこから来たのかを追跡できる。また「avoid_commentary」フラグを設定することで、モデルが追加的なコメントを提供するかどうかをコントロールできる。コメントは会話的な性質を持つため厳密には提供された知識ソースに根拠づけられていないが、回答の有用性を高める文脈を提供できる。

企業AIにおけるハルシネーション問題の解決

企業のAIアプリケーションにおいて、言語モデルからのハルシネーションは顧客体験の低下、企業評判の損害、誤ったビジネス判断につながるクリティカルなリスクとなっている。

具体的な例としては、航空会社のチャットボットが誤った割引ポリシーを約束するケース、金融分析AIが信頼できる市場分析文書から表やグラフの値を誤って伝えるケース、デバッグアシスタントが提供された社内文書ではなく一般的なチップ回路図から情報を引き出して技術者を誤った方向に導くケースなどが挙げられる。

Contextual AIは、HSBC、Qualcomm、The Economistなどの顧客を獲得しており、企業がAI投資から具体的な利益をようやく実現できるよう支援する立場にある。「これは、AIからROIを提供し始めるよう圧力を受けているかもしれない企業にとって、実際の問題を解決する、より特殊なソリューションを検討し始める機会です」とKiela氏は述べている。「その一部は、標準的な言語モデルよりも少し退屈かもしれないが、コンテキストに根ざしていることを確認し、その仕事を本当に信頼できる、客観的な言語モデルを持つことです」。

拡張機能と今後の展開

GLMはテキスト生成に焦点を当てているが、Contextual AIのプラットフォームは最近、チャート、図表などのマルチモーダルコンテンツと、BigQuery、Snowflake、Redshift、Postgresなどの一般的なプラットフォームからの構造化データのサポートを追加した。

「企業における最も困難な問題は、構造化データと非構造化データの交差点にあります。大企業で本当に興味深い問題のほとんどは、構造化と非構造化の交差点にあります。データベースレコード、トランザクション、ポリシードキュメント、その他多くのものがあるかもしれません」とKiela氏は述べている。

同社によれば、半導体産業の回路図を含む様々な複雑な視覚化が既にサポートされているという。

Contextual AIは、GLM発表後間もなく特化型リランカーコンポーネントをリリースし、その後ドキュメント理解機能を拡張する計画だ。また、よりエージェント的な能力のための実験的機能も開発中とされている。

同社は現在、無料アカウント作成により、最初の1M入力トークンと1M出力トークンまで無料でGLMを試すことができるとしている。追加のクレジットは必要に応じて購入可能だ。

Sources

- Contextual AI:

- VentureBeat: Contextual AI’s new AI model crushes GPT-4o in accuracy — here’s why it matters