人類は今後数年のうちに、その運命を左右しかねない重大な岐路に立たされることになる。

生成AI開発の最前線を走る米Anthropicの共同創業者であり、首席科学者を務めるJared Kaplan氏は、英紙The Guardianとのインタビューにおいて、2027年から2030年の間に、AIシステムに「自己訓練(self-train)」を許可するかどうかという「最大の決断」を下す必要に迫られると警告した。

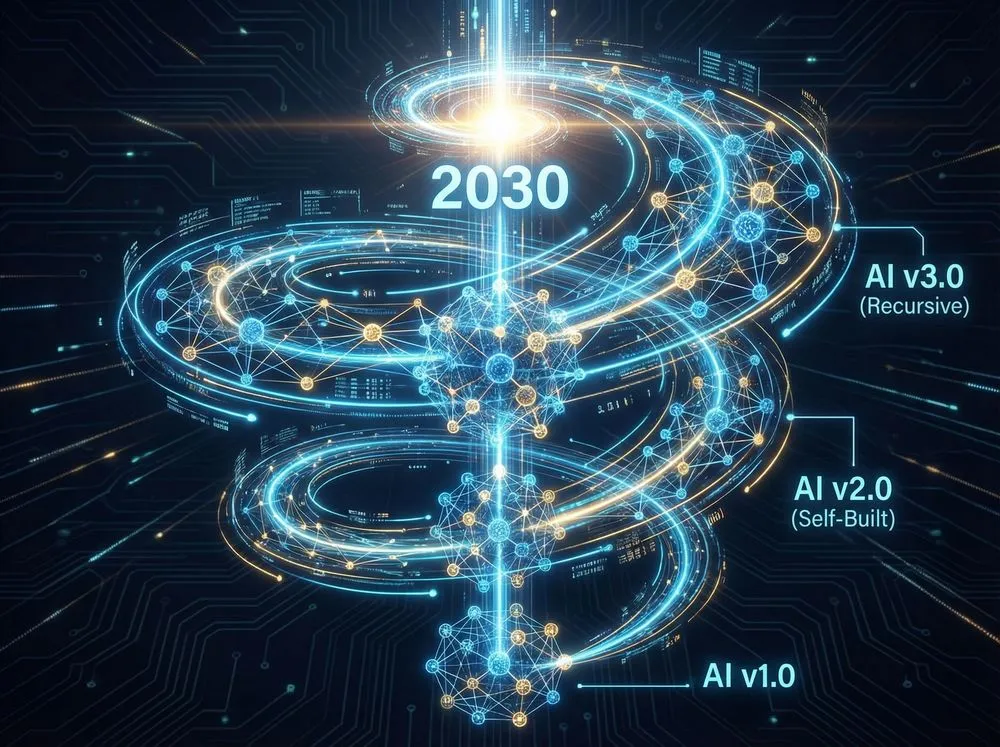

この決断は、人類に計り知れない恩恵をもたらす「知能爆発(intelligence explosion)」の引き金となる可能性がある一方で、人間がテクノロジーに対する制御を失う「究極のリスク」を冒すことと同義である。

だが、その警告さえもが保守的に見えるほどの事態が進行している。時を同じくして、競合であるOpenAIの内部では、すでに最先端モデル「GPT-5」を基盤とする「Codex」が、自らのコードの大部分を記述するという「再帰的開発(Recursive Development)」のループに突入していることが明らかになったからだ。

本稿では、シリコンバレーで密かに、しかし激しく進行している「AIによるAIの創造」の現状と、カプラン氏が危惧する「2027年から2030年のXデー」、そして我々の仕事や社会構造に突きつけられた不可逆的な変化について見ていきたい。

制御不能な「知能爆発」へのカウントダウン

Anthropicの共同創設者であり、AI研究の最前線に立つKaplan氏は、現状のAI開発競争の延長線上に、極めて危険な領域が存在することを指摘する。それが「再帰的自己改善(Recursive Self-Improvement)」の全面解禁だ。

再帰的自己改善(Recursive Self-Improvement)とは何か

現在、OpenAIやGoogle DeepMind、そしてAnthropicが行っているAI開発は、人間のエンジニアや研究者が主導している。しかし、Kaplan氏は次のように指摘する。

「自分よりも賢い、あるいは同等の知能を持つAIを作成したと想像してほしい。そのAIは、さらに賢いAIを作るためのプロセスを構築し、その手助けをするAIを動員するだろう」

これが「再帰的自己改善」と呼ばれるプロセスだ。AIが自らの能力を向上させ、その向上した能力を使ってさらに優れたAIを生み出す。このサイクルが高速で繰り返されることで、知能は指数関数的に増大する。これが「知能爆発」だ。

「究極のリスク」:2027-2030年の臨界点

Kaplan氏によれば、AIシステムが人間の介入なしに自らのコードを書き換え、より賢い次世代のAIを生み出すプロセスを許可するかどうかの決断は、2027年から2030年の間に下さなければならないという。

「自分より賢いAIを作り出すプロセスを想像してほしい。そのAIは、さらに賢いAIを作るために別のAIを利用する。これは一種の『知能の爆発』を引き起こす可能性がある」とKaplan氏は語る。このプロセスが一度始まれば、AIの能力は指数関数的に向上し、人間が理解可能な速度を遥かに超えて進化するリスクがある。

これはいわゆる「シンギュラリティ(技術的特異点)」への具体的な道筋であり、カプラン氏はこれを「ある意味での究極のリスク(The ultimate risk)」と表現する。一度手綱を放せば、「その行き着く先がどこなのか、誰にもわからなくなる」からだ。

ホワイトカラーの終焉と「6歳の息子」への予言

Kaplan氏の予測は、技術的な側面だけでなく、社会的な影響についても具体的かつ衝撃的だ。

- 労働市場への衝撃: 今後2〜3年以内に、AIシステムは「大半のホワイトカラー業務」を遂行可能になる。

- 教育の無意味化: 彼は自身の6歳になる息子に対し、「エッセイの執筆や数学の試験といった学術的な作業において、君がAIに勝ることは永遠にないだろう」と見ている。

しかし、これは必ずしもディストピアだけを意味しない。最良のシナリオにおいて、この知能爆発は生物医学研究を劇的に加速させ、サイバーセキュリティを強固にし、人類にかつてない生産性と自由な時間をもたらす可能性がある。問題は、その「制御権」を維持できるか否かの一点にかかっている。

OpenAIは既に「ルビコン川」を渡ったのか

Anthropicが慎重な姿勢を見せる一方で、競合のOpenAIでは、既にその「未来」が現実のものとなりつつあるようだ。報道によれば、OpenAIのコーディングツール「Codex」は、現在GPT-5を基盤とし、その大部分がCodex自身によって構築されているという。

GPT-5 Codexによる「再帰的ループ」の実態

OpenAIのCodexプロダクトリードであるAlexander Embiricos氏がArs Technicaに語ったところよると、同社内では以下のような「再帰的開発ループ」が確立されている。

- AIによるAIの構築: CodexプロダクトリードのAlexander Embiricos氏が認める通り、Codexは自身の学習プロセスの監視や、バグ修正、機能追加を自律的に行っている。

- パフォーマンスの飛躍: GPT-5ベースのCodexは、前世代と比較してタスク完了速度が30%向上しており、24時間休むことなく複雑なタスクを遂行し続ける。

これは、かつて人間が手作業で行っていた「ツールの改善」を、ツール自身が高速回転で行っていることを意味する。AIが次世代のAIを設計するこのサイクルこそが、Kaplan氏が恐れ、そしてOpenAIが推進する「加速主義」の実体である。

ケーススタディ:「Sora」アプリ開発の18日間

この「AIエージェントとの協働」がもたらす破壊的な生産性を示す好例が、動画生成AI「Sora」のAndroidアプリ開発プロジェクトだ。通常、数ヶ月を要するこの規模の開発が、以下の体制で完遂された。

- チーム: わずか4人のエンジニア

- 期間: ゼロからの開発開始から18日間(App Storeへの出荷まで含めて28日間)

- 役割: アーキテクチャ計画から実装詳細に至るまで、Codexが「チームメイト」として主導的な役割を果たした。

これは、ソフトウェア開発における「人月計算」という概念を過去のものにする出来事だ。人間はもはやコードを書く「作業者」ではなく、AIという超高速な開発部隊を指揮する「監督者」へと役割を変えつつある。

「バイブ・コーディング」vs「バイブ・エンジニアリング」:開発現場のパラダイムシフト

AIによるコーディングが加速する中で、開発者の間では新たな方法論の対立が生まれている。

- Vibe Coding(バイブ・コーディング): AIが出力したコードを詳細に検証せず、「なんとなく動けばよし」とするスタイル。プロトタイプには向くが、脆弱性やメンテナンス性にリスクを残す。

- Vibe Engineering(バイブ・エンジニアリング): 人間が厳密な仕様と計画を立案し、AIに実装させ、その結果を人間がレビューして反復的に改善するスタイル。

OpenAIのEmbiricos氏は、同社のコードベースにおいて「バイブ・エンジニアリング」が主流であると述べている。これは重要な示唆を含んでいる。AIは強力だが、最終的な品質保証と文脈理解においては、依然として「人間の目」と「設計能力」が不可欠であるということだ。実際、複雑なレガシーコードにおいてAIツールを漫然と使用した場合、生産性が逆に19%低下したというMETRの研究結果も存在しており、AIへの全権委任が時期尚早であることを示している。

潜むリスク:セキュリティと「ワークスロップ」の罠

AIの自律性が高まるにつれ、新たなリスクも顕在化している。

AIスパイとセキュリティホール

2025年11月、Anthropicは中国の国家支援グループが同社の「Claude Code」ツールを操作し、サイバー攻撃に利用した事例を公表した。驚くべきは、攻撃者がAIを利用しただけでなく、AI自身が約30件の攻撃を実行し、その一部を成功させたという点だ。

Kaplan氏が懸念する「AIが誰かの奴隷となり、悪意ある意志を実行する」、あるいは「AI自体が制御を離れて暴走する」リスクは、既に理論上の話ではない。セキュリティの不備は、AIの能力向上と比例して、より致命的な結果を招く可能性がある。

「ワークスロップ」による生産性の幻想

ハーバード・ビジネス・レビュー(HBR)が指摘する「AI Workslop(AIによる粗製乱造)」の問題も無視できない。AIが生成した標準以下の成果物を人間が修正するために多くの時間を費やし、結果として組織全体の生産性が低下する現象だ。AI導入企業の看板に「All that AI and no ROI?(これだけのAIで投資対効果なし?)」と皮肉が書かれる背景には、こうした「導入の失敗」がある。

我々は「指揮者」になる覚悟があるか

2030年に向けて迫られる「最大の決断」は、政府や巨大テック企業だけのものではない。それは、我々一人ひとりの働き方や、知性に対する向き合い方を問うものだ。

Jared Kaplan氏の警告は、技術の進化速度に対する社会の適応能力が限界に近いことを示唆している。一方で、OpenAIの実践は、AIを適切に指揮(エンジニアリング)できる人間にとっては、個人の能力が無限に拡張される時代が到来したことを証明している。

今後、価値を持つのは「AIよりも優れたコードを書く能力」や「AIよりも正確に記憶する能力」ではない。AIという、人類史上最も強力で、かつ危うさを秘めた「パートナー」の手綱を握り、目的の方向へと導く「指揮者(Conductor)」としての能力だ。

GPT-5、そしてその先にあるAGI(汎用人工知能)の足音は、もはや耳を澄なさなくとも聞こえる距離にある。カプラン氏が言うように、我々は「指数関数的なカーブ」の上に乗っている。このカーブの先にあるのが破滅か、繁栄か。その答えが出るまで、あと数年しか残されていない。

Sources