生成型人工知能(AI)は過去数年で急速に発展し、多くの業界に変革をもたらしている。ニュースルームもその例外ではない。

本日発表された新しい報告書によると、ニュース視聴者とジャーナリストの双方が、報道機関によるチャットボット、画像・音声・動画ジェネレーターなどの生成AIの現在の使用方法と、将来的な使用可能性について懸念を抱いていることが判明した。

この報告書は、オーストラリアおよび他の6カ国(アメリカ、イギリス、ノルウェー、スイス、ドイツ、フランス)における生成AIとジャーナリズムに関する3年間のインタビューとフォーカスグループ調査に基づいている。

調査に参加したニュース視聴者のうち、ジャーナリズムにおける生成AIに遭遇したと確信しているのはわずか25%であった。約50%は不確かであるか、遭遇した可能性があると考えていた。

これは、報道機関が生成AIを使用する際の透明性が欠如している可能性を示唆している。また、報道機関と視聴者との間の信頼関係の欠如を反映している可能性もある。

誰が、または何が、どのようにしてニュースを作成するかということは、多くの理由で重要である。

例えば、一部のメディアは他より多くの、あるいは少ない情報源を使用する傾向がある。また、政治家や専門家などの特定の種類の情報源をより多く使用する場合もある。

一部のメディアはコミュニティの一部を過小に表現したり、誤って表現したりすることがある。これは時として、報道機関のスタッフ自体が視聴者層を代表していないことが原因である。

AIをジャーナリズムの制作や編集に安易に使用することで、これらの不平等が再生産される可能性がある。

我々の報告書では、ジャーナリストと報道機関が生成AIを使用できる数十の方法を特定し、それぞれについてニュース視聴者がどの程度快く感じているかをまとめている。

我々が話を聞いたニュース視聴者は全般的に、編集や制作よりも舞台裏の作業にAIを使用することをより快く感じていた。これにはインタビューの文字起こしや、トピックの取り上げ方についてのアイデア提供などが含まれる。

しかし、快適さは文脈に大きく依存する。知覚されるリスクが低い場合、視聴者は一部の編集や制作タスクについてかなり快く感じていた。

問題点と機会

生成AIはジャーナリズムのほぼすべての部分で使用することができる。

例えば、カメラマンがイベントを撮影した後、生成AIツールが「最適」と判断する画像を選び、最適化のために画像を編集し、それぞれにキーワードを追加することができる。

これらは比較的無害な応用のように見えるかもしれない。しかし、AIが何かや誰かを誤って識別し、これらのキーワードが写真のキャプションで誤認識につながったらどうだろうか?人間が「良い」画像だと考える基準がコンピュータが考えるものと異なっていたらどうだろうか?これらの基準は時間とともに、または異なる文脈で変化する可能性もある。

画像を明るくしたり暗くしたりするという単純なことでさえ、政治が絡むと騒動を引き起こす可能性がある。

AIは完全な作り話もできる。写真のようにリアルに見える画像が、実際には起こっていないことを示すこともある。動画は完全にAIで生成することも、文脈を変更するためにAIで編集することもできる。

生成AIは見出しの作成や記事の要約にも頻繁に使用されている。これは時間のない個人にとって有用な応用のように聞こえるが、一部の報道機関はAIを使用して他者のコンテンツを盗用している。

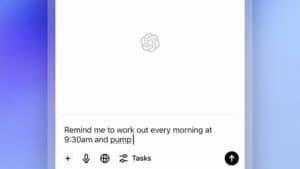

AI生成のニュースアラートが事実を誤って伝えることもある。例として、Appleは最近、自動生成されたニュース通知機能を一時停止した。これは、アメリカの殺人容疑者Luigi Mangioneが自殺したという誤った情報をBBCを情報源として配信したためである。

ジャーナリストによるAI使用について人々はどう考えているか

我々の研究によると、ニュース視聴者は、自身が同様の目的でAIを使用した経験がある場合、ジャーナリストの特定のタスクへのAI使用をより快く感じる傾向にあることが分かった。

例えば、インタビューを受けた人々は、ジャーナリストが画像の一部をぼかすためにAIを使用することを概ね快く感じていた。調査参加者は、ビデオ会議アプリやスマートフォンの「ポートレート」モードで同様のツールを使用していると述べた。

同様に、一般的なワードプロセッサやプレゼンテーションソフトウェアに画像を挿入すると、視覚障害者のために画像の文章による説明が自動的に作成されることがある。このようなAIによる画像説明に以前遭遇したことがある人々は、ジャーナリストがメディアにキーワードを追加するためにAIを使用することをより快く感じていた。

調査参加者が最も頻繁にジャーナリズムにおける生成AIに遭遇したのは、ジャーナリストがバイラルとなったAIコンテンツについて報道する場合であった。

例えば、King Charlesの戴冠式でPrince WilliamとPrince Harryが抱擁を交わす様子を示すAI生成画像が出回った際、報道機関はこの偽画像について報じた。

我々のニュース視聴者の参加者は、AIが記事の執筆、編集、翻訳に使用されたという通知も目にしていた。また、それらに付随するAI生成画像も見ていた。これはThe Daily Telegraphで人気のあるアプローチで、同紙は多くの意見コラムでAI生成画像を使用している。

全体として、調査参加者は、ジャーナリストがブレインストーミングや既存メディアの拡充にAIを使用することを最も快く感じていた。これに続いて、編集や制作へのAI使用が挙げられた。しかし、快適さは具体的な使用方法に大きく依存する。

調査参加者の大多数は、インフォグラフィックのアイコン作成にAIを使用することには快く感じていた。しかし例えば、AIアバターがニュースを伝えるという考えには非常に不快感を示した。

編集に関しては、参加者の過半数が歴史的な画像をアニメーション化するためのAI使用に快く感じていた。AIは視聴者の興味と関与を引き出すことを期待して、そうでなければ静的な画像に「命を吹き込む」ために使用することができる。

視聴者としてのあなたの役割

ジャーナリストがAIを使用しているかどうか、またはどのように使用しているかが不確かな場合は、その報道機関のポリシーや説明を探してみよう。見つからない場合は、ポリシーの策定と公開を要請することを検討しよう。

人間の労働を代替するのではなく、補完し支援するためにAIを使用するメディア機関を支援することを検討しよう。

決定を下す前に、当該のジャーナリストや報道機関の過去の信頼性と、証拠が示すことを考慮しよう。

コメント