OpenAIは2026年4月23日、次世代モデル「GPT-5.5」を発表した。提供はまずChatGPTとCodexから始まり、ChatGPTではPlus、Pro、Business、Enterpriseユーザー向けにGPT-5.5を展開する。GPT-5.5 ProはChatGPTのPro、Business、Enterpriseユーザーに提供される。CodexではPlus、Pro、Business、Enterprise、Edu、Goプランが対象となる。一方、APIでの一般提供は発表時点では始まっておらず、OpenAIは「very soon」として近く提供すると説明している。

GPT-5.5の焦点は、単純なベンチマーク上の上積みより、長時間のエージェント作業をどこまで実用域に近づけるかに置かれている。OpenAIは、コーディング、コンピューター操作、知識労働、初期段階の科学研究での能力向上を強調した。GPT-5.4がChatGPT、Codex、APIへ同時に投入されたのに対し、GPT-5.5はChatGPTとCodexを先行させ、APIは後続とした。この提供順の違いは、モデルの能力差だけでなく、価格、長文コンテキスト、安全性評価、実運用時のコストを切り分けて見る必要があることを示している。

価格面では、予定されている標準API単価がGPT-5.4から倍増する。gpt-5.5は100万トークンあたり入力5ドル、キャッシュ入力0.50ドル、出力30ドルとされ、GPT-5.4の入力2.50ドル、キャッシュ入力0.25ドル、出力15ドルから引き上げられる。OpenAIは同時に、GPT-5.5が実運用でGPT-5.4と同等のトークン単位レイテンシを維持し、Codexタスクではより少ないトークンで処理できると説明している。ただし、これだけで全ユーザーの総コストが下がるとは断定できない。発表から読み取れるのは、単価上昇とトークン効率改善を組み合わせた、新しい費用対効果の評価軸だ。

GPT-5.5はAPI先行ではなく、ChatGPTとCodex先行のモデルとして出た

GPT-5.5の提供条件は、前世代との違いを最初に見るべき点だ。GPT-5.4は発表時にChatGPT、Codex、APIで利用可能とされたが、GPT-5.5とGPT-5.5 Proは発表時点でAPIの一般提供が始まっていない。OpenAIはAPI提供を「very soon」としており、予定されるAPI仕様としてgpt-5.5の100万コンテキスト、BatchとFlexの半額、Priorityの2.5倍料金、gpt-5.5-proの入力30ドル・出力180ドルを示している。

ChatGPT側では、GPT-5.5がPlus以上の主要有料プランへ展開される。CodexではPlus、Pro、Business、Enterprise、Edu、Goプランで利用でき、コンテキストウィンドウは40万トークンだ。ここは混同しやすい。CodexでのGPT-5.5は40万コンテキスト、APIで予定されているgpt-5.5は100万コンテキストであり、同じ「GPT-5.5」でも利用面の上限が異なる。

この分割は、GPT-5.5を「すぐAPIで大規模組み込みするモデル」としてではなく、まずOpenAI管理下のChatGPTとCodexで展開し、利用状況と安全性を見ながらAPIへ広げるモデルとして位置づけていることを示す。OpenAIはAPI展開には異なる安全・セキュリティ要件が必要だと説明しており、発表時点では製品面の統制とモデル能力の拡大が同時に進められている。特にCodexは、OpenAIがGPT-5.5の実用性を示す中核の場になっている。OpenAIは社内で85%以上がCodexを週次利用しているとし、Finance部門が2万4771件のK-1フォーム、計7万1637ページの処理にCodexを使った例や、Go-to-Market領域で週5〜10時間の削減につながった例を挙げている。GPT-5.5は、こうした長く複雑な作業単位で効果を示すモデルとして発表された。

ベンチマークは全般的に向上、だが最大の差は長文コンテキスト

OpenAIが示したGPT-5.5とGPT-5.4の比較では、コーディング、知識労働、コンピューター操作、通信業務タスクで幅広い改善がある。他社モデルとの比較値も一部公開されており、Terminal-Bench2.0ではGPT-5.5が82.7%、Claude Opus 4.7が69.4%、Gemini 3.1 Proが68.5%だった。SWE-Bench ProではGPT-5.5が58.6%、Claude Opus 4.7が64.3%、Gemini 3.1 Proが54.2%であり、すべての評価でGPT-5.5が他社モデルを上回るという単純な構図ではない。

| 評価項目 | GPT-5.5 | GPT-5.4 | Claude Opus 4.7 | Gemini 3.1 Pro |

|---|---|---|---|---|

| Terminal-Bench2.0 | 82.7% | 75.1% | 69.4% | 68.5% |

| SWE-Bench Pro | 58.6% | 57.7% | 64.3% | 54.2% |

| Expert-SWE | 73.1% | 68.5% | - | - |

| GDPval | 84.9% | 83.0% | 80.3% | 67.3% |

| OSWorld-Verified | 78.7% | 75.0% | 78.0% | - |

| BrowseComp | 84.4% | 82.7% | 79.3% | 85.9% |

| Tau2-bench Telecom | 98.0% | 92.8% | - | - |

この表だけを見ると、改善幅と競争上の位置はタスクによって大きく異なる。SWE-Bench Proの差はGPT-5.4比で0.9ポイントにとどまり、Claude Opus 4.7の64.3%を下回る。一方、Terminal-Bench2.0はGPT-5.4比で7.6ポイント上がり、Claude Opus 4.7やGemini 3.1 Proとの差も大きい。BrowseCompではGPT-5.5 Proが90.1%、GPT-5.4 Proが89.3%と高い値を示すが、標準モデル同士ではGemini 3.1 Proの85.9%がGPT-5.5の84.4%をわずかに上回る。GPT-5.5を「全ベンチマークで劇的に伸びたモデル」と見るより、ターミナル操作、専門的なソフトウェア作業、業務フロー寄りのエージェント作業で改善が厚いモデルとして見る方が、発表内容に近い。

さらに大きな差は長文コンテキスト評価に出ている。OpenAI MRCRの512K〜1Mでは、GPT-5.5が74.0%、GPT-5.4が36.6%で、差は37.4ポイントに達する。Graphwalks BFS 1Mでは45.4%対9.4%、Graphwalks parents 1Mでは58.5%対44.4%だった。GPT-5.4もAPIで100万コンテキストを持ち、Codexでは実験的に100万コンテキスト対応が示されていたが、GPT-5.5では長い入力の中から関係をたどる能力がより強く打ち出された。

長文コンテキストの改善は、単に長いファイルを読めるという話にとどまらない。大規模コードベース、複数文書にまたがる企業資料、長い実験ログ、会計・法務・調査資料では、モデルが入力を保持するだけでなく、離れた箇所の関係を正しくたどる必要がある。GraphwalksやMRCRの差は、そうした「長い文脈の中で参照関係を維持する」能力の改善を示す材料である。ただし、ベンチマークは特定条件下の結果であり、実際の企業ワークロードで同じ改善幅が出るとは限らない。

価格は倍増、OpenAIはトークン効率とインフラで相殺を狙う

GPT-5.5のAPI価格は、発表時点では「coming soon」として料金ページに掲載されている。標準のgpt-5.5は100万トークンあたり入力5ドル、キャッシュ入力0.50ドル、出力30ドルで、GPT-5.4のちょうど2倍である。gpt-5.5-proは入力30ドル、出力180ドルとされる。GPT-5.4の発表時に示されたgpt-5.4-proのAPI価格も入力30ドル、出力180ドルだったため、Pro帯では標準モデルほどの単価上昇は示されていない。

| モデル | 入力 | キャッシュ入力 | 出力 |

|---|---|---|---|

| GPT-5.4 | 2.50ドル | 0.25ドル | 15ドル |

| GPT-5.5 | 5ドル | 0.50ドル | 30ドル |

| GPT-5.4 Pro | 30ドル | 未記載 | 180ドル |

| GPT-5.5 Pro | 30ドル | 未記載 | 180ドル |

単価だけを見れば、GPT-5.5は明確に高い。OpenAIが示す説明は、レイテンシとトークン効率にある。同社は、GPT-5.5が実世界のサービングでGPT-5.4と同等のトークン単位レイテンシを維持し、Codexタスクではより少ないトークンを使うと説明している。つまり、同じ仕事をより短い出力や少ない中間処理で終えられるなら、トークン単価の上昇分が一部相殺される可能性がある。

ただし、ここには公開情報上の限界がある。OpenAIはCodexタスクでのトークン削減を主張しているが、ワークロード別に総トークン数、再試行回数、ツール呼び出し数、成功率を組み合わせた十分なデータは公開していない。そのため、「GPT-5.5は高いが結果的に安い」と一般化するのは早い。成立し得るのは、長い作業を少ない反復で完了でき、出力や思考過程の冗長さが減るタスクだ。逆に、短い定型生成や単純な分類では、単価上昇の影響がそのまま出やすい。

BatchとFlexが標準の半額、Priorityが2.5倍という予定料金も、利用形態の分化を示している。即時性が低いバッチ処理や柔軟なレイテンシを許容できる処理では単価を抑え、低遅延や優先処理を求める用途では高い倍率を払う構造である。GPT-5.5の価格体系は、単一のAPI単価ではなく、処理の緊急度、文脈長、成功率、再試行回数を含めて設計する必要がある。

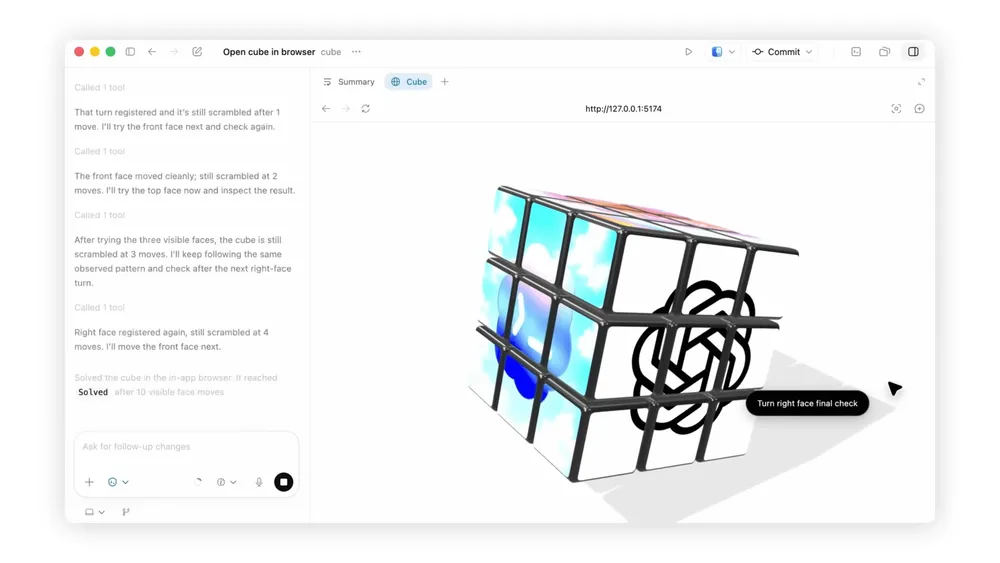

Codexで見える推論基盤とFast modeの交換条件

GPT-5.5の発表では、Codexが単なる利用先ではなく、モデルの能力とインフラ改善を示す中心的な文脈になっている。CodexでのGPT-5.5は40万コンテキストに対応し、Fast modeではトークン生成が1.5倍速くなる一方、コストは2.5倍になる。長いコーディング作業では、速度とコストの交換条件が明示された形だ。

OpenAIは、GPT-5.5をGPT-5.4と同等のレイテンシで提供するために、NVIDIA GB200/GB300 NVL72システムを使ったと説明している。さらに、Codexで書かれたロードバランシングとパーティショニングのヒューリスティックにより、トークン生成速度が20%以上向上したという。ここで示されているのは、モデル改善だけでなく、モデルを支える推論基盤の改善が製品性能に直結しているという構図である。

この点は、GPT-5.5を利用する開発者や企業にとって実務的な意味を持つ。長時間エージェント作業では、モデルの知能だけでなく、途中で止まらないこと、文脈を保てること、ツール実行やファイル編集を含むワークフローを安定して進められることが価値になる。Codexの40万コンテキストはAPI予定の100万より短いが、リポジトリ単位の作業や複数ファイルの修正には十分に大きい。APIの100万コンテキストが来れば、さらに長い文書束やコードベースを扱う設計が可能になるが、発表時点ではまだ一般提供されていない。

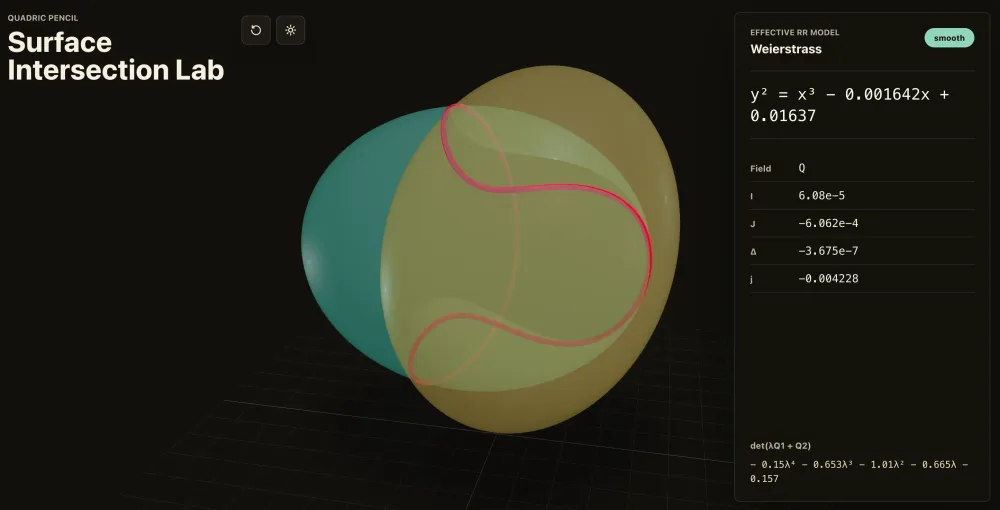

OpenAIが示した社内事例も、GPT-5.5の売り方を示している。FinanceのK-1フォーム処理、Go-to-Marketの自動化、社内での高いCodex週次利用率は、チャットで質問に答えるモデルではなく、複数ステップの業務を処理するエージェント基盤としての訴求だ。科学研究でも、遺伝子発現データの分析、代数幾何アプリの構築、Ramsey数に関する証明探索といった例が挙げられた。これらは性質の異なる事例だが、共通するのは、入力を読み、道具を使い、途中の結果を検証しながら成果物へ進むワークフローである。読者が見るべき点は、GPT-5.5が「回答品質のモデル」から「作業完了率のモデル」へさらに寄っていることだ。

安全性評価はHigh扱い、ただしCriticalには届いていない

GPT-5.5のSystem Cardでは、Biological/ChemicalとCybersecurityがHigh capabilityとして扱われている。一方、Criticalには達していない。AI self-improvementについてもHighのしきい値には到達していない。OpenAIは、標準的なテスト構成ではGPT-5.5が機能するフルチェーンのCritical級アウトカムを独立に生み出さなかったとしている。

サイバーセキュリティでは、GPT-5.5の能力上昇が明確に示されている。System Cardの比較では、サイバー関連のcombined pass rateがGPT-5.5で93.33%、GPT-5.4-thinkingで73.33%だった。外部評価でも、IrregularはGPT-5.5がGPT-5.4より強い攻撃的サイバー性能を示し、成功あたりコストも低いと評価した。英国AISIは、狭いサイバータスクでGPT-5.5を全体として最も強いモデルと見たが、差は誤差範囲内ともしている。

安全性の読み取りでは、能力評価が下限であるというSystem Cardの注記が重要である。異なるプロンプト、足場となるツールやスキャフォールディング、より長い実行、ファインチューニング、対話条件によって、より高い能力が引き出される可能性があるためだ。エージェントモデルは、単発回答よりも外部ツールや長い計画と結びついたときにリスクが変わりやすい。API提供を後続にした展開は、安全性評価と製品展開の関係を見るうえでの材料になる。

一方で、OpenAIはTrusted Access for Cyberを拡大し、検証済みの防御側研究者や企業顧客に対して、身元確認を伴うアクセス経路を用意している。これは、サイバー能力の上昇を一律に閉じるのではなく、用途と利用者を分けて扱う方針である。なお、UK AISIはテストした構成でユニバーサルjailbreakを見つけたが、OpenAIはその後のローンチ構成で検証済みの高深刻度jailbreakをブロックしたとしている。ただし、UK AISIは構成上の問題により最終構成を検証できなかった。この点は、ローンチ後の独立検証が残る部分である。

判断軸は「賢さ」より、長い仕事の成功率と総費用へ移る

GPT-5.5は、GPT-5.4の単純な上位版としてだけ扱うと実態を取り逃がす。発表で強調された差分は、長文コンテキスト、Codexでの少ないトークン使用、コンピューター操作や業務タスク、サイバー安全性評価、そしてAPI提供を遅らせた展開順にある。性能表の上では多くの項目で改善しているが、実務上の争点は、より高い単価を払っても長い作業の完了率、再試行の少なさ、待ち時間、運用上の安全性で回収できるかである。

APIがまだ一般提供されていないため、開発者が自社アプリケーションにgpt-5.5を組み込んだときの挙動は未確定である。予定される100万コンテキスト、標準・Batch・Flex・Priorityの料金差、Proの高単価設定は示されたが、実際のスループット、レート制限、失敗時の再実行コスト、ツール利用を含む総費用は公開後に検証する必要がある。GPT-5.5の評価は、ベンチマーク表の順位ではなく、各組織の長い作業がどれだけ短い反復で終わるかに移る。

次の焦点は、API提供開始時の実利用条件である。Codexでは40万コンテキスト、APIでは100万コンテキスト予定という差があり、価格はGPT-5.4から倍増する。安全性面ではHigh能力として扱われる領域が広がった。GPT-5.5は、モデルの知能向上を売る発表であると同時に、エージェントを製品と業務へ広げる際のコスト、レイテンシ、安全性の均衡点をOpenAIがどこに置くかを示す発表でもある。

Sources

OpenAI:

OpenAI Deployment Safety Hub: