Stability AIは先日Computexにて、Stable Diffusion 3 Mediumのリリースを予告していたが、本日予告通りにこれをリリースした。

画像生成のための新たなオープンウェイトモデル「SD3 Medium」

画像生成のためのオープンウェイトAIモデル「Stable Diffusion」は、MidjourneyやDALL-Eとは異なり、ダウンロードしてユーザー自身のマシンのGPU等を使用してローカルで実行することができる。高速な画像生成と高解像度の出力には、それ相応の大容量のメモリと高性能なGPUが必要だが、高度な機械学習ライブラリによる最適化と加速により、プロセスを大幅にスピードアップすることも可能だ。

そんなStable Diffusionの最新モデル「Stable Diffusion 3 Medium(SD3 Medium)」は、この画像生成AIモデルをノートPC、より具体的に言えば、今後登場する「Copilot+ PC」でも動作可能なサイズに最適化されたものだ。

Stability AIのStable Diffusion 3 Mediumは、20億のパラメータを持ち(8億および80億のバージョンも計画されている)ユーザーはモデルをダウンロードして非商用目的で使用することができる。アクセスできないユーザーはStability AIのオンラインツールを使用することができる。

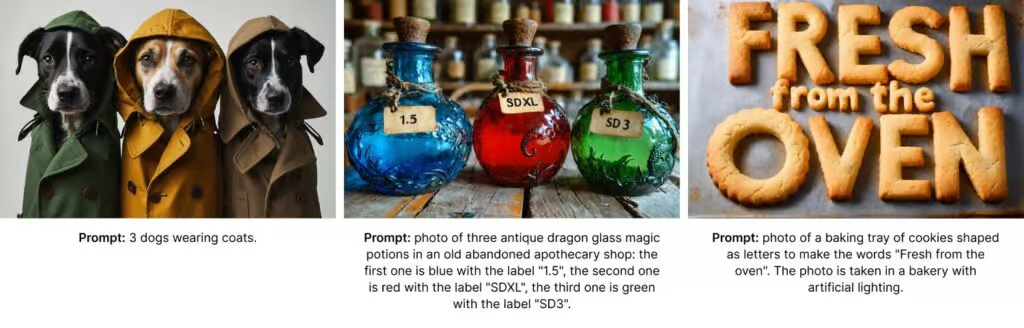

SD3 Mediumモデルは、SD3で見られたいくつかの改善を継承している。具体的には以下の特徴が挙げられる:

- フォトリアリズム:手や顔によく見られるアーチファクトを克服し、複雑なワークフローを必要とせずに高品質の画像を提供する。

- プロンプトの遵守:空間的関係、構成要素、アクション、スタイルを含む複雑なプロンプトを理解する。

- タイポグラフィ:Diffusion Transformerアーキテクチャの支援により、アーティファクトやスペルミスのないテキスト生成において、これまでにない結果を達成。

- リソース効率:低いVRAMフットプリントにより、標準的なコンシューマーGPUでパフォーマンスを低下させることなく実行するのに理想的となっている。

- 微調整:小さなデータセットから微妙なディテールを吸収できるため、カスタマイズに最適。

特にタイポグラフィの改善は顕著であり、以前は、画像がAIによって生成されたものか手動で作成されたものかを判断する簡単な方法であったが、これからはそれが容易ではなくなる。今では、様々なスタイルでテキストを生成することができ、大半の場合、タイプミスをしなくなっている。

また、Stability AIは、NVIDIAおよびAMDと協力して、両GPUベンダーのためのハードウェア特化の最適化を実現している。NVIDIAに関しては、TensorRTを使用することで、パフォーマンスが50%向上する。この最適化は、すべてのGeForce RTX GPUで動作する。ただし、特別に最適化されたTensorRTが必要となるため、必要な場合はこちらからダウンロードしよう。

AMDについては、Stability AIはAMD APU、GPU、さらにはデータセンターのInstinct MI300X GPUに対する最適化された推論を約束している。AMDのハードウェアには、特別なモデルのダウンロードは必要ない。

SD3 Mediumモデルをダウンロードして使用したい場合は、Hugging Faceから可能だ。

Sources

コメント