最近よく聞く「AI」と言う単語は、Appleにとっては少なくとも「Artificial Intelligence」の略ではないようだ。少なくとも同社は本日開催したWWDCのキーノートの中で、一度たりとも、「Artificial Intelligence」もしくは、「AI」という単語を使っていない。代わりに同社は生成モデル(Appleは生成AIとは言わない)による新しいパーソナルインテリジェンスである「Apple Intelligence」を発表した。これは、画像生成や文書の要約、そしてSiriの大幅な改良などを伴うAppleによるOSへの深いAI機能の統合を目指すものだ。

Apple Intelligence: 個人のコンテキストと生成AIの融合

AppleがWWDCでAI機能を大々的に発表するのは既に公然の秘密であったため、それ自体は驚きではなかった。そして、その機能自体も既にOpenAIやMicrosoft、Googleが提供しているものから大きく進化したものはなく、新鮮味のないものばかりだ。ただし、やはりプレゼンテーションの妙だろう。これがAppleデバイスでOSに統合されることの有用性や未来を垣間見せられるとワクワクさせられるのは確かだ。

「私たちは、Appleのイノベーションに新たな章が加わることを大変嬉しく思っています。Apple Intelligenceによって、ユーザーがApple製品でできること、そしてApple製品がユーザーのためにできることが生まれ変わります。Apple独自のアプローチは、生成AIとユーザーの個人的な背景を組み合わせ、真に有用なインテリジェンスを提供します。また、Apple Intelligenceは完全にプライバシーとセキュリティが保護された方法で情報にアクセスでき、ユーザーが自分にとって最も大切なことを行うのを支援します。これはAppleだけが提供できるAIであり、実際にどんなことができるのかをユーザーに体験してもらう日が待ち切れません」と、AppleのCEO(最高経営責任者)、Tim Cook氏は述べている。

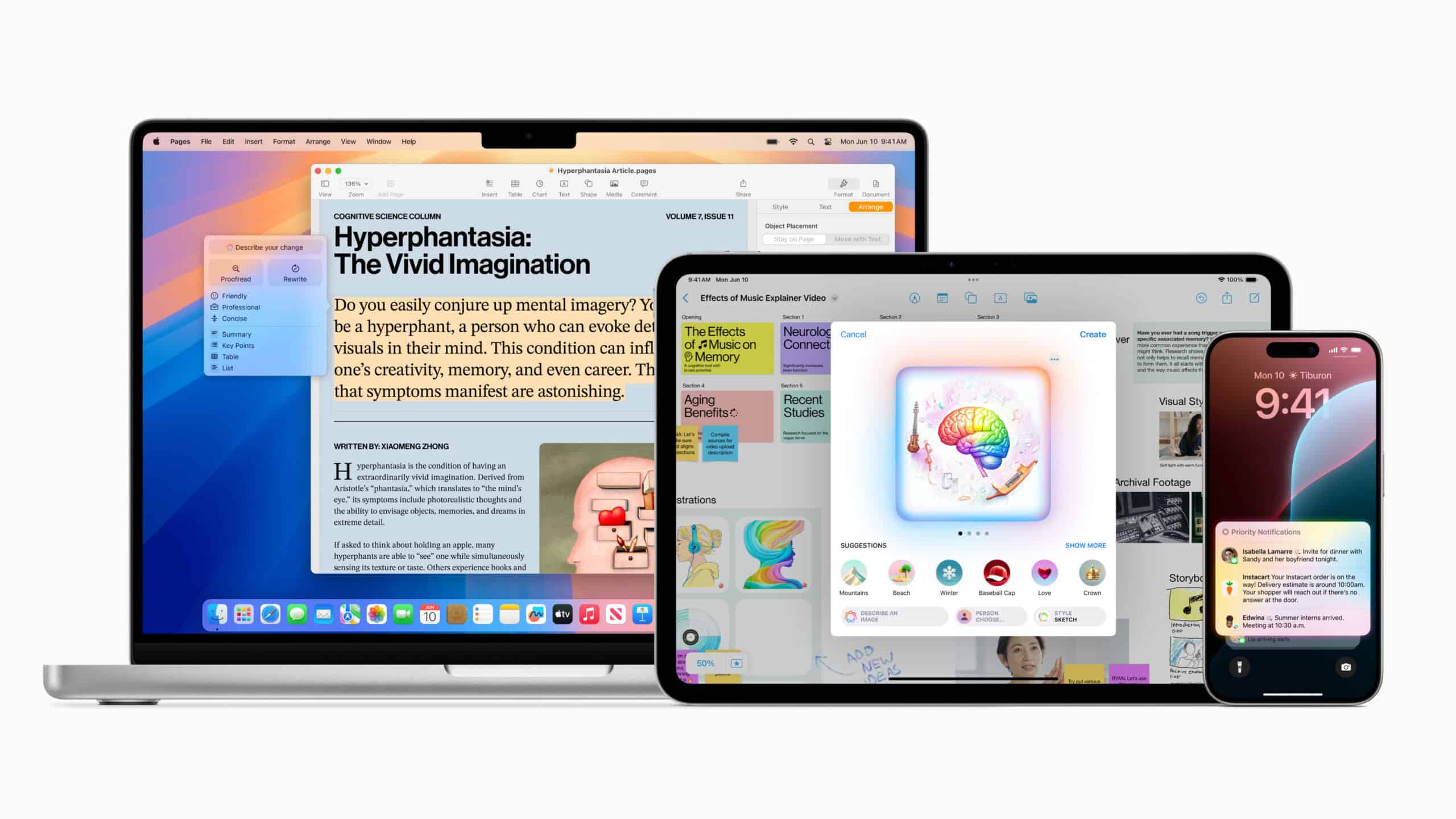

Appleが発表したパーソナルインテリジェンス「Apple Intelligence」は、iOS、iPadOS、およびmacOSプラットフォーム全体で機能する包括的な機能セットである。提供はベータ版が今夏から開始されるが、米国の英語ユーザー向けにのみ提供され、日本を含む各国言語への対応は2025年まで持ち越される。

Appleが重点を置くものはこれまでも、そしてこれからもプライバシーと言う事で、生成AI処理の大部分をオンデバイスで行う事にこだわっている。そのため、Apple Intelligence機能を使うことが出来るにはそれ相応の処理能力が必要となり、iPhoneならば現時点ではiPhone 15 Pro、iPhone 15 Pro Maxのみ。Mac、iPadはM1以上の処理能力を備えたデバイスに対応する。

オンデバイスで処理しきれないタスクに関しては、その処理の一部をプライバシー保護に重点を置いたAppleシリコン上で稼働するPrivate Cloud Computeプラットフォームで処理され、デバイスに戻される。この特別なサーバーは、外部にデータが共有されず、Apple自身も中身を見ることが出来ないとのことだ。

Apple Intelligenceによって可能になる新機能は以下の通りだ。

Siriの大規模アップデート

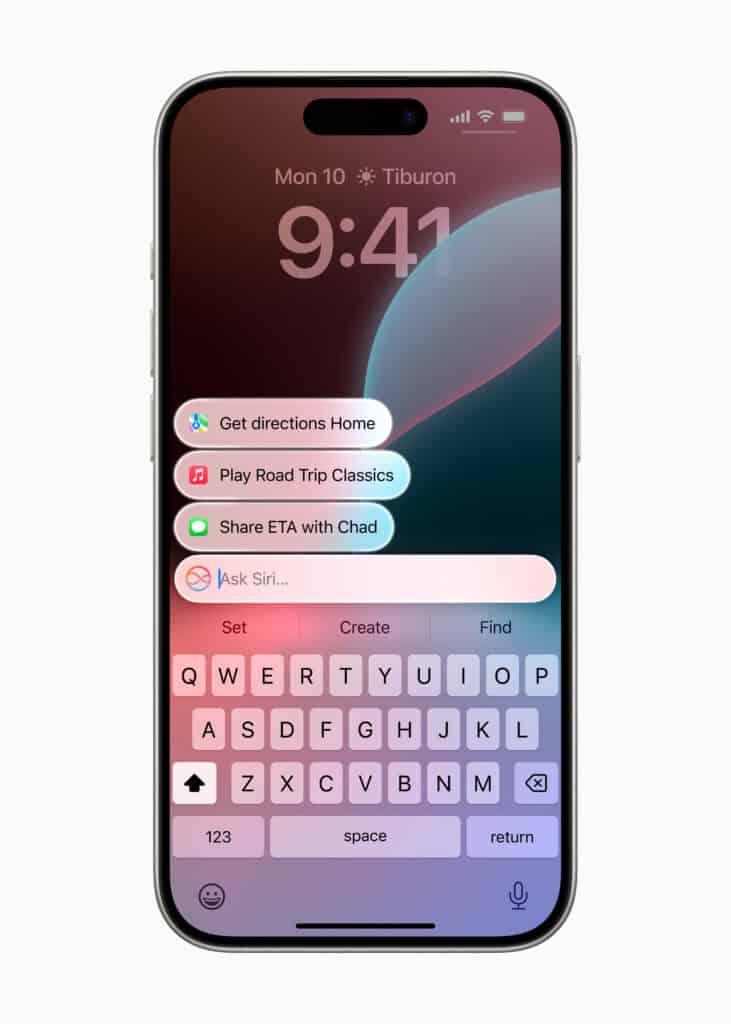

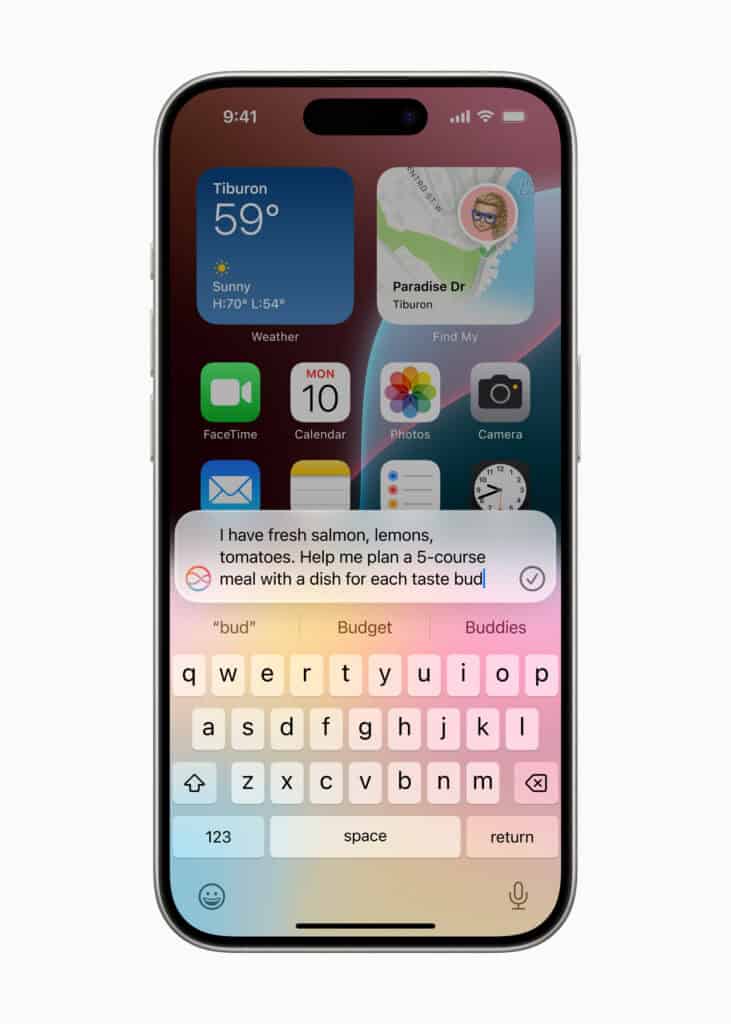

Siriは13年前にAppleがリリースしたパーソナルアシスタントだ。当時はその新規性に人々は驚かされたものだが、その後は余り進化が見られない状態が続き、競合他社と比べて劣る物として“使えない存在”と言うレッテルを貼られることもままあった。だが、新しいApple Intelligenceを搭載することでSiriが大きく生まれ変わることになった。Siriは音声またはテキストプロンプトによる入力を受け付けることができるようになり、以前のクエリを記憶してそれに基づいて賢く対応することができるようになった。

加えて、Siriの音声認識能力自体も飛躍的に高まった。言い間違えや、言葉に詰まったり、クエリの途中で考えをまとめ直す必要がある場合でも、Siriは情報を問題なく処理できる。また、Siriは「画面認識」機能も備えており、テキストからの入力を受け取ることができる。たとえば、友人がテキストで住所を共有した場合、「○○さんからのテキストから住所を彼の連絡先に追加して」と言うだけであなたの連絡先に追加されるのだ。

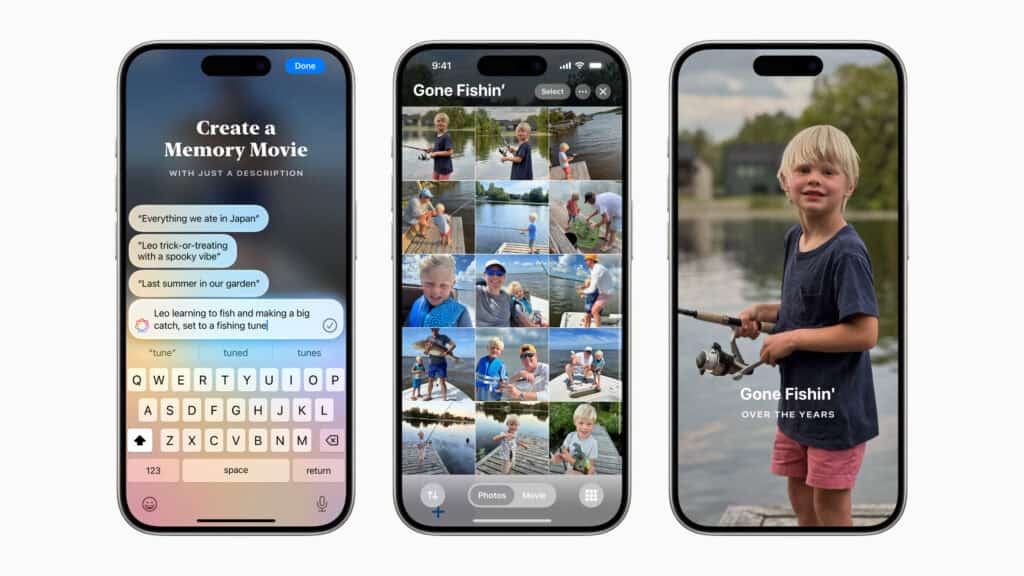

Siriによる操作は写真アプリ内の画像にも拡張される。Appleのプレゼンテーションの中でSiriに「New Yorkでピンクのコートを着ているStaceyの写真を見せて」と指示すると、その結果が表示される様子が写し出され、次に、選択した写真をSiriに「この写真をStaceyのプロフィールのメモに追加して」と指示すると、Siriは文脈を理解し、その指示に基づいて処理を行っていた。

これらの機能はAppleのすべてのファーストパーティアプリケーション、およびApp Intents APIを使用するサードパーティアプリケーションにも拡張される。Siriは、テキスト、メール、または以前のメモからの情報を覚えていなくても、特定の情報を見つける手助けをする。たとえば、フォームに運転免許証番号を入力する必要がある場合、Siriはデバイス内で運転免許証の画像を検索し、対応する番号を必要なテキストフィールドに入力してくれるのだ。

もう一つのデモでは、ユーザーが「母のフライトはいつ着陸するの?」と尋ねると、Siriはフライトの詳細を調べ、リアルタイムのフライト追跡情報と照らし合わせて正確な到着時刻を把握することができる。次に、母親とのランチの予定を尋ねると、その予定が表示され、最後に、空港からレストランまでの所要時間を尋ねると、SiriはAppleマップでコースをプロットしてくれている。

Apple Intelligenceのアプリへの統合

生成AIと言えばテキスト生成以外に画像生成が有名だろう。Appleはこれをユーザー独自の絵文字作成機能「Genmoji(GenerateとEmojiの造語)」に落とし込んだ。

ユーザーはテキストプロンプトによって指示を出す、例えば、「目にきゅうりを乗せてリラックスしている笑顔」という入力によって、おなじみの黄色い顔の絵文字に独自のデコレーションを施したGenmojiを出力し、メッセージ内で利用する事が出来るようになる。生成されるのは一つではなく複数のGenmojiのようで、バリエーションをスワイプして、自分の好みに最も合ったものを見つけることができる。

また、AppleはMessagesアプリを通じてアクセスできるImage Playgroundも導入する。テキストまたは音声プロンプトを使用して、“スケッチ”、“イラスト”、“アニメ”調の画像を生成できる。自分の写真だけではなく、連絡先に登録されている人のプロフィール画像などから画像を生成することも可能だ。

また、Image Playgroundはスタンドアロンアプリとしても利用可能で、サードパーティアプリもAPIを利用できる。

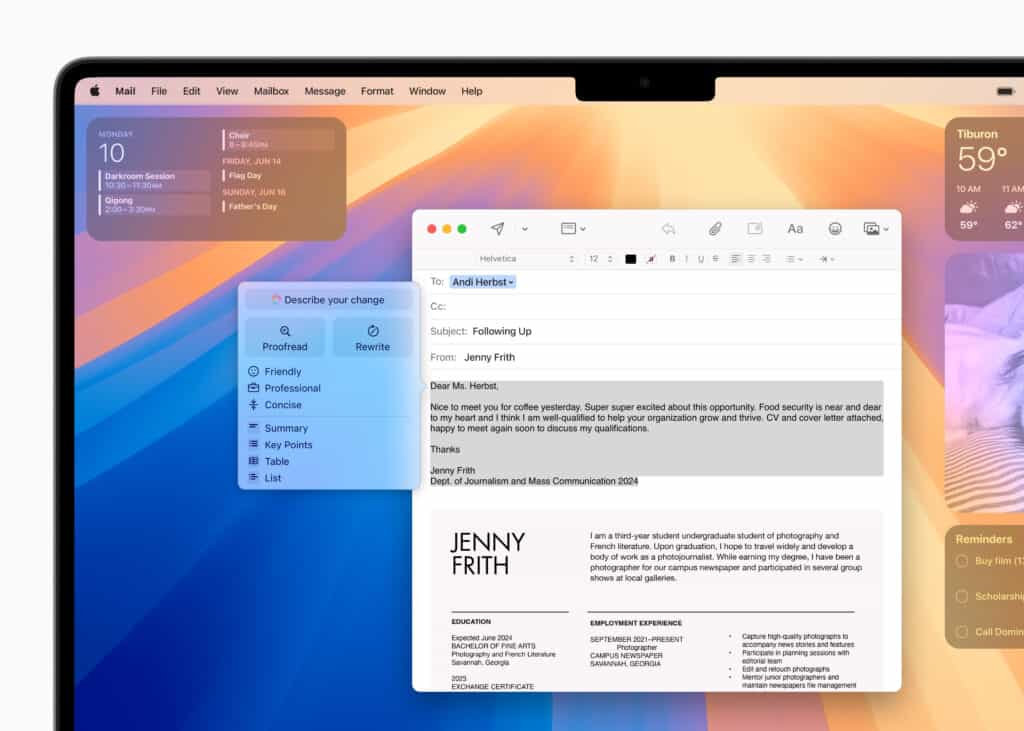

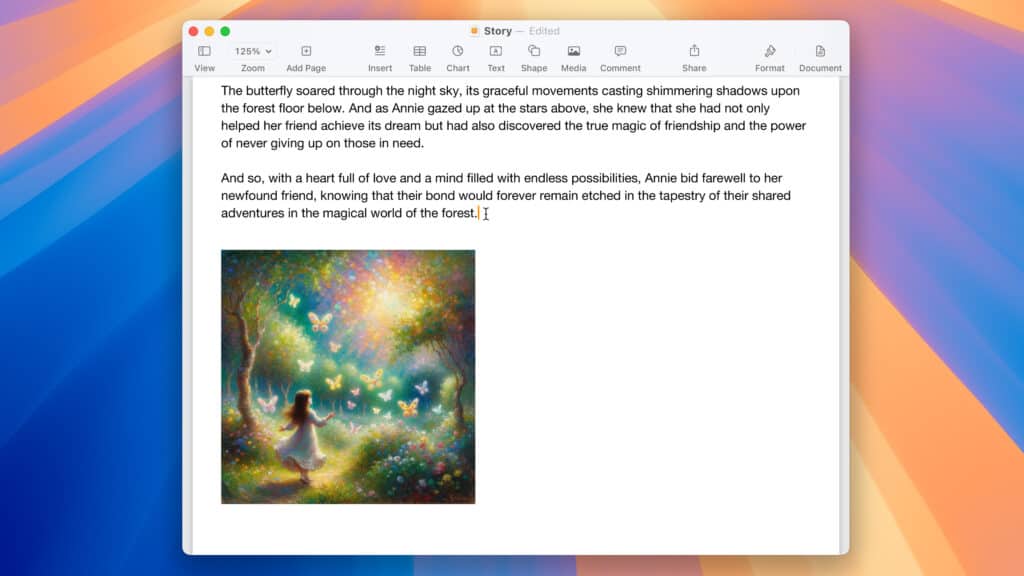

また、長いメールの要約や、文書の書き直し、またはそのトーンを変更する機能なども宇津井化される。これらの機能はAppleのすべてのオペレーティングシステム全体でシステム全体で利用可能になる。

ちなみに、これらのAI機能は全てAppleの独自開発AIモデルによって実現される。

加えて、Appleは後述するように、更に高度な回答などを得たい場合に備え、OpenAIやGoogleと言った外部のAIモデルを利用する事が出来る様な選択肢も提示するようだ。

OpenAIとの提携

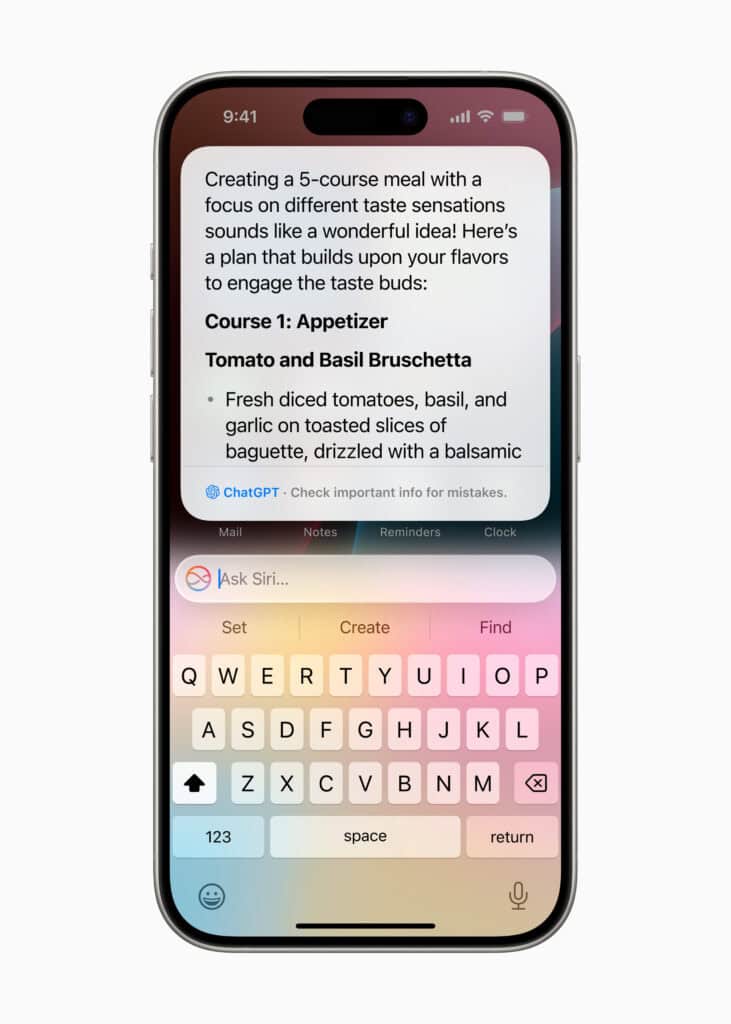

Appleの生成AIの最初の外部パートナーはOpenAIとなる。

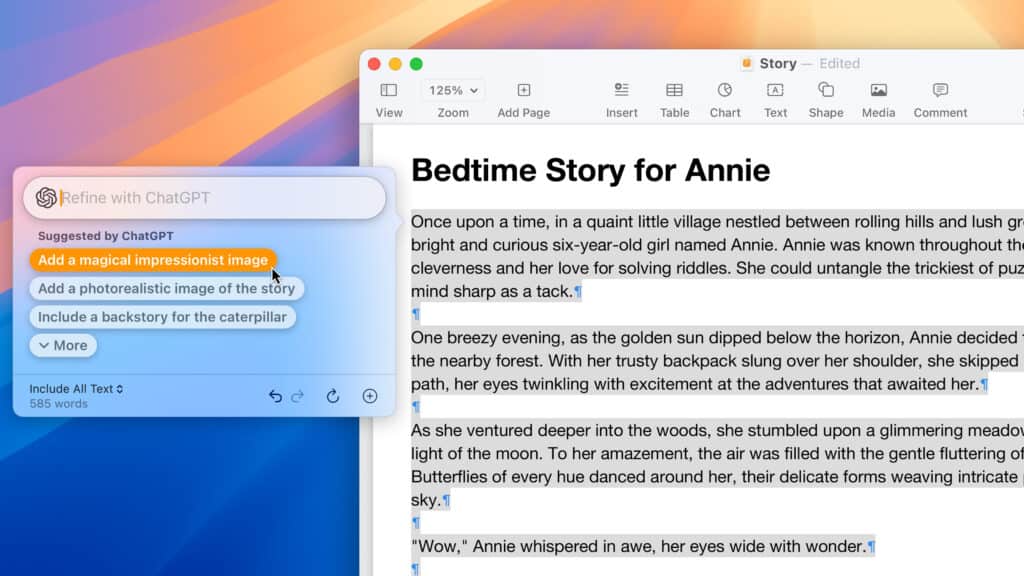

GPT-4oを搭載したChatGPTの基本バージョンが、今秋からiOS 18で無料で利用可能になり、一部のアプリに直接統合される。Appleによると、ユーザーの入力は保存されないとのことだ。

また、ChatGPT Plusなどの有料サブスクリプション加入者はChatGPTのプレミアム機能にもアクセスできる。DALL-Eなどの画像生成機能も利用できるとのことだ。

OpenAIによると、Siriは必要に応じてChatGPTの知能を利用することもできるという。

Appleは他のAI企業とのさらなる提携も視野に入れている。Google Geminiやその他のモデルがChatGPTの代替として続く可能性がある。Googleとの協議が進行中とされている。

Sources

コメント