Microsoftは、ウィスコンシン州に建設中のAI専用データセンター「Fairwater」の詳細を公開した。これは、人工知能が社会インフラとなる新時代に向けた、同社の壮大なビジョンを物理的に具現化したものであり、AI時代の「産業革命」を牽引する巨大な工場(ファクトリー)と位置づけられている。総額73億ドルもの投資が注ぎ込まれるこの施設は、技術的な偉業であると同時に、地球環境への影響という重大な問いを我々に投げかけるものだ。

桁外れのスケールが物語る戦略的重要性

この建設プロジェクトのスケールは、使用された資材の量からも明らかである。

- 深層基礎杭: 46.6マイル(約75km)

- 構造用鋼材: 2,650万ポンド(約12,000トン)

- 中電圧地下ケーブル: 120マイル(約193km)

- 機械配管: 72.6マイル(約117km)

この数字の羅列は、MicrosoftがAIインフラ構築にいかに莫大なリソースを投じているかを物語っている。この施設は、同社のクラウドプラットフォームAzure、パートナーであるOpenAIの先進的なAIモデル、そして我々が日常的に利用するCopilotのようなAIサービスの根幹を支える基盤となる。つまりFairwaterは、現代のデジタル経済における石油ともいえる「計算能力(コンピュート)」を生成するための、巨大な精製プラントなのだ。

AI時代の「頭脳」:アーキテクチャの技術的革新

Fairwaterの真価は、その規模だけでなく、内部のアーキテクチャにある。従来のデータセンターが、Webサイトのホスティングや電子メールサービスなど、多数の比較的小さな独立したタスクを同時に処理するために最適化されていたのに対し、Fairwaterは全く異なる思想で設計されている。それは、施設全体が「単一の巨大なAIスーパーコンピューター」として機能することだ。

心臓部を担うNVIDIA最新GPUのアーキテクチャ

その心臓部には、数十万基に及ぶNVIDIAの最新GPU、GB200が搭載される。 Microsoftは、この構成によって「現在の最速スーパーコンピューターの10倍の性能」を実現すると主張している。 この驚異的な性能は、単にGPUを多数並べただけでは達成できない。

鍵となるのは、NVIDIAのBlackwellアーキテクチャとNVLink技術である。Fairwaterでは、1つのラックに72基のNVIDIA Blackwell GPUが搭載される。これらは第5世代のNVLinkによって相互接続され、GPU間で毎秒1.8テラバイトという超高帯域の通信を実現する。 これにより、ラック内の72基のGPUは、それぞれが独立して動作するのではなく、合計14テラバイトの巨大なメモリプールを共有する「単一の巨大なアクセラレータ」として振る舞う。 このアーキテクチャが、AIモデルの学習においてボトルネックとなりがちなデータの移動を最小化し、1ラックあたり毎秒865,000トークンという驚異的な処理能力を叩き出すのである。

全身に張り巡らされた超高速な「神経系」

この強力な心臓部(GPUラック)の能力を最大限に引き出すため、施設全体には超高速な「神経系」ともいえるネットワークが張り巡らされている。

ラック間の通信には、InfiniBandとEthernetの両方を用いた800Gbpsのファブリックが採用されている。 特に重要なのは、これが「フルファットツリー・ノンブロッキングアーキテクチャ」で構築されている点だ。 これは専門的な用語だが、要するに「データセンター内のどのGPUも、他のどのGPUとも、通信の渋滞(輻輳)を起こすことなく最大速度で通信できる」設計を意味する。これにより、数十万基のGPUが文字通り一体となって、単一の超巨大AIモデルの学習を並列で実行できるのだ。

さらにMicrosoftは、物理的なレイアウトにも工夫を凝らしている。Fairwaterのラックは2階建ての構成で配置されており、隣接するラックだけでなく、上下のラックとも直接ネットワーク接続されている。 これにより、信号が移動する物理的な距離を最小限に抑え、通信の遅延(レイテンシ)を徹底的に削減している。ナノ秒単位の遅延がシステム全体の性能を左右するスーパーコンピューティングの世界において、これは極めて重要な設計思想である。

記憶を司るエクサバイト規模のストレージ

AIモデルの学習には、膨大なデータセットを保存し、瞬時にGPUに供給する能力が不可欠だ。Fairwaterのストレージシステムは、その規模と性能において既存の概念を覆す。「フットボール競技場5つ分」と表現されるその物理的な広さもさることながら 、性能面では、単一のAzure Blob Storageアカウントで毎秒200万以上の読み書きトランザクションを処理できる能力を持つ。 これにより、エクサバイト(100京バイト)級のデータを扱う巨大なAIワークロードにも弾力的に対応可能だ。

環境負荷という避けられぬ課題への回答

これほどの巨大な計算能力は、必然的に莫大な電力消費と熱を発生させる。AIの進化が加速する一方で、その環境負荷は社会全体にとって看過できない課題となっている。MicrosoftはFairwaterにおいて、この問題に対して先進的な解決策を提示している。

「水を使わない」液体冷却システム

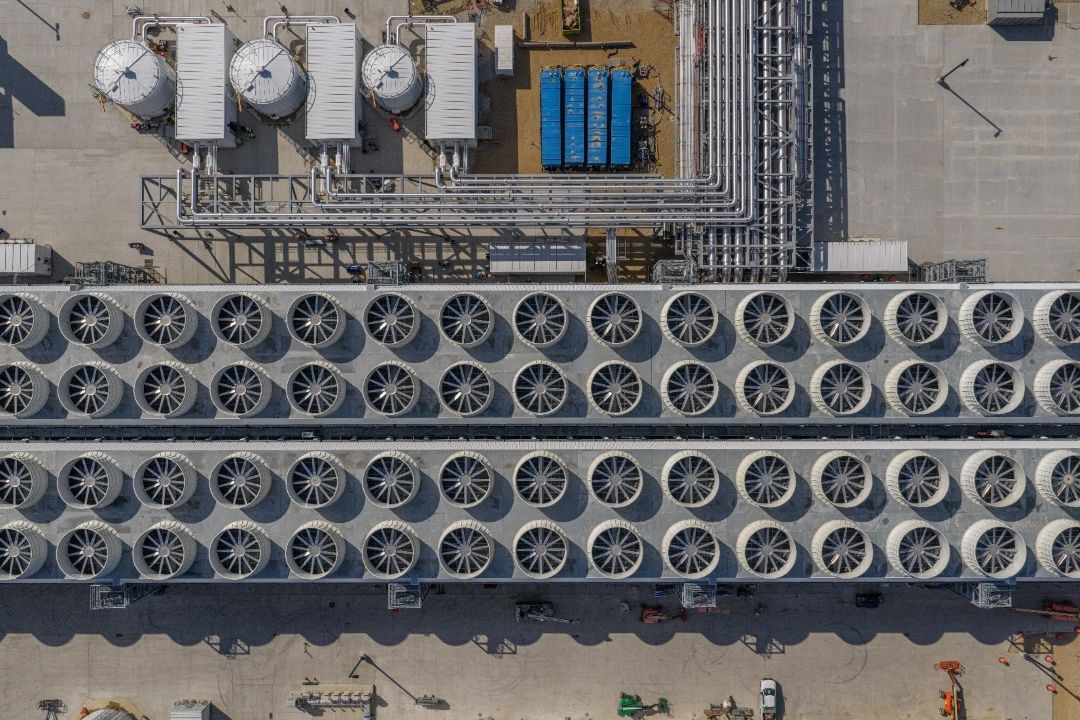

最も注目すべきは、冷却システムだ。高密度に実装された最新GPUが発生する熱は、従来の空冷システムでは効率的に処理できない。そこでFairwaterでは、施設の約90%で「クローズドループ液体冷却システム」を採用している。

これは、サーバーに直接接続された密閉されたパイプ内を冷却液が循環し、熱を効率的に奪う仕組みだ。奪われた熱は、建物の外に設置された巨大な冷却フィンと172台の大型ファンによって外部に放出され、冷やされた液体が再びサーバーへと戻る。 「クローズドループ」の名の通り、一度システムに充填された液体は蒸発することなく再利用され続けるため、運用段階での新たな水の消費はゼロとなる。 これにより、施設の水使用量は、一般的なレストランの年間使用量や、18ホールのゴルフコースが夏のピーク時に1週間で消費する量と同程度にまで抑えられるという。

残り10%の従来型サーバーは、通常は外気を利用して冷却し、年間で最も気温が高くなる数日間のみ水冷システムを補助的に使用する設計となっており、ここでも水使用量の削減が徹底されている。

再生可能エネルギーへの大規模投資

冷却が「熱」の問題であるとすれば、より根源的な課題は「電力」である。FairwaterのようなAIデータセンターは、数十万世帯分にも相当する電力を消費する。この課題に対し、Microsoftは再生可能エネルギーの導入を強力に推進している。

具体的には、ウィスコンシン州ポートエイジ郡で建設中の新しい250メガワットの太陽光発電プロジェクトから電力を購入する契約(PPA)を締結した。 これは、データセンターが消費する電力を再生可能エネルギーで相殺しようとする取り組みの一環である。Brad Smith社長は、施設の総電力需要が900メガワットを超える可能性に言及しており 、今後もさらなる再生可能エネルギーの確保が求められるだろう。

これらの取り組みは高く評価されるべきである一方で、AIコンピューティング需要の爆発的な増加ペースに再生可能エネルギーの供給が追いつくのか、という根本的な問いは依然として残る。一部で指摘されているように、安定的かつクリーンなベースロード電源としての原子力の再評価など、より多角的なエネルギー戦略の議論が今後ますます重要になるのではないだろうか。

未来への構想:地球規模で連携する「AIファクトリー」

Microsoftのビジョンは、ウィスコンシン州の一施設に留まらない。Fairwaterは、世界中に張り巡らされる「分散型AIスーパーコンピューター」ネットワークの、重要な最初のピースなのである。

同社は、Fairwaterと同様の設計思想を持つAIデータセンターを米国内の他の場所や、ノルウェー、英国でも建設中である。 これらの施設は、Microsoftが独自に構築した広域ネットワーク(AI WAN)によって相互に接続され、あたかも地球規模の一つの巨大なAIマシンとして機能する構想だ。

この分散型アプローチは、いくつかの戦略的な利点をもたらす。

- レジリエンス(回復力): 特定の地域で自然災害や電力供給の問題が発生しても、他の地域の施設が処理を引き継ぐことで、システム全体の可用性を維持できる。

- スケーラビリティ(拡張性): 将来、現在のモデルを遥かに超える規模のAIを学習させる必要が生じた場合、複数のデータセンターのリソースをプールして対応できる。

- 効率性: 世界中の計算資源とデータを最適に配置し、地理的な遅延を最小化しながら、グローバルなAIサービスを提供できる。

Microsoftは、この構想を「産業革命における工場」になぞらえ、これらの施設が物理的な商品を生産する代わりに「知能(インテリジェンス)」を大規模に生産する「AIファクトリー」であると表現している。 これは、AIの能力が一部の企業に独占されるのではなく、クラウドを通じて世界中の開発者や企業に民主化される未来を示唆している。

結論として、MicrosoftのFairwaterは、AI技術の未来を形作る上で極めて重要なマイルストーンである。その圧倒的な計算能力は、科学、医療、ビジネスといったあらゆる分野で、これまで不可能だったブレークスルーを生み出す可能性を秘めている。しかし同時に、その巨大さがもたらす環境への負荷は、我々が技術の進歩と持続可能性をいかに両立させていくべきかという、根源的な問いを突きつけている。Fairwaterという「知能の工場」が本格稼働する2026年、我々はその恩恵と共に、その代償にも真摯に向き合うことを求められるだろう。

Sources