AI産業が直面している最大のボトルネックは、もはやアルゴリズムの複雑さではなく、物理法則そのものである。データセンターは膨大な電力を消費し、シリコンチップ内の電子移動に伴う発熱が計算能力の向上を阻んでいる。

2026年1月22日、この「物理の壁」を突破しようとするスタートアップ、Neurophosが、シリーズAラウンドで1億1000万ドル(約160億円)の資金調達を完了したと発表した。彼らが提示する解決策は、電子ではなく「光子(フォトン)」を用いた演算処理だ。

本稿では、シリコンバレーの有力VCやMicrosoftらがこぞって出資したこの技術の正体、競合NVIDIAに対する圧倒的な効率優位性、そして2028年の商用化に向けた戦略的ロードマップを掘り下げて見ていこう。

「不可視化マント」の技術がAIチップへ

今回のラウンドはGates Frontierが主導し、Microsoftのベンチャー部門であるM12、Aramco Ventures、Bosch Venturesなどが参加した。これによりNeurophosの総調達額は1億1800万ドルに達する。

Neurophosの技術的ルーツは、デューク大学の物理学者David R. Smith教授の研究にある。彼はかつて「メタマテリアル」を用いて物体をマイクロ波から隠す「不可視化マント(invisibility cloak)」の実証実験で世界を驚かせた人物だ。Neurophosは、このメタマテリアル技術をAIチップの微細構造に応用することで、これまで理論上の存在に過ぎなかった「高密度な光学コンピューティング」を現実のものとした。

CEOであり共同創業者のPatrick Bowen氏は、「AI産業はムーアの法則による計算能力の向上を待っていられない」と断言する。同社のアプローチは、シリコンの微細化競争とは異なる次元で、物理レベルのパラダイムシフトを起こそうとしている。

なぜ「光」なのか:電子の限界とNeurophosの破壊的革新

従来のGPU(Graphics Processing Unit)は、トランジスタを通じて電子を移動させることで計算を行う。この過程では電気抵抗により必ず熱が発生し、信号の遅延が生じる。AIモデルが巨大化するにつれ、この発熱と電力消費がデータセンターの運用を圧迫している。

対して、光を用いる光学コンピューティングには、抵抗による発熱がなく、光速でデータを伝送できるという物理的な利点がある。しかし、これまでの光学チップには致命的な欠点があった。光を制御する素子(モジュレーター)がシリコンのトランジスタに比べて巨大であり、チップ上に十分な数を集積できなかったのだ。

1万倍の小型化を実現した「メタサーフェス・モジュレーター」

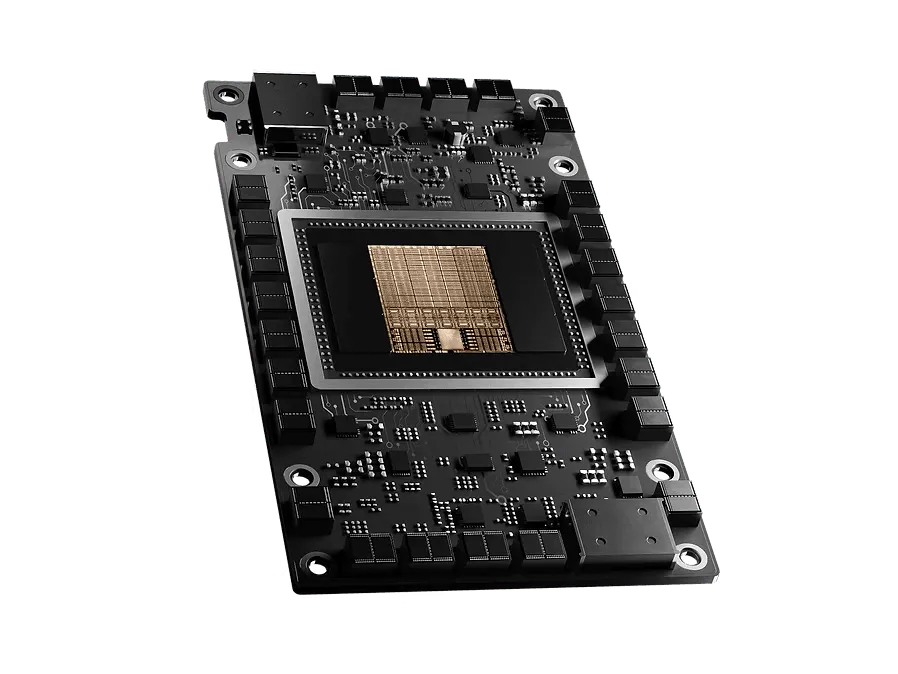

Neurophosのコアイノベーションは、独自の「メタサーフェス・モジュレーター」にある。これは従来の光学素子と比較して10,000倍の小型化に成功したものだ。

これにより、単一のチップ上に100万個以上の光学処理素子を集積することが可能になった。Neurophosが開発する「OPU(Optical Processing Unit)」は、メモリ内で計算を行う(compute-in-memory)アーキテクチャを採用し、AI推論における中心的な計算である行列積和演算を、光の干渉を利用して瞬時に処理する。

圧倒的な効率:NVIDIA B200との比較

Neurophosが主張する性能数値は、既存のシリコンチップの常識を覆すものだ。同社のOPUプロトタイプは、100ギガヘルツ(GHz)以上のクロックスピードを達成可能だという。

TechCrunchが報じたデータによると、Neurophosのチップは56GHzで動作させた場合、675ワットの消費電力で235ペタオペレーション/秒(POPS)の処理能力を発揮するとされる。比較対象として挙げられたNVIDIA のB200 GPUが1000ワットで9 POPS(※特定の精度条件による比較と推測される)であることに対し、エネルギー効率と絶対性能の両面で桁違いの差をつけている。

Neurophosの主張によれば、既存のAIプロセッサと比較して最大100倍の性能向上を実現するとしている。Bowen CEOの言葉を借りれば、「エネルギー効率の問題を解決して初めて、高速化の特権が得られる」のである。

Microsoftの戦略的意図とデータセンターの危機感

今回の投資家リストの中で最も注目すべきはMicrosoft(M12)の存在だ。OpenAIへの投資を通じてAIブームを牽引するMicrosoftは、同時にAI推論にかかる莫大な電力コストという現実に直面している。

MicrosoftのコアAIインフラストラクチャ担当副社長、Marc Tremblay氏は次のように述べている。「現代のAI推論は記念碑的な量の電力と計算能力を要求する。AIモデル自体の飛躍的進化に見合う、計算ハードウェア側のブレークスルーが必要だ」

NVIDIA製GPUの供給不足と価格高騰、そしてデータセンターの電力容量不足は、ハイパースケーラーにとって存亡に関わる課題だ。MicrosoftがNeurophosに投資するのは、単なる技術的関心ではなく、将来的なインフラコストを劇的に引き下げるためのヘッジ戦略だ。

2028年の商用化へ向けたロードマップ

画期的な技術であっても、量産できなければ意味がない。Neurophosはこの点においても現実的な解を持っている。同社のチップは、特殊な製造ラインを必要とせず、標準的なCMOSファウンドリの材料とプロセスで製造可能であるという。

具体的なマイルストーン

- 2027年: ノルウェーのデータセンター事業者Terakraftと提携し、実環境でのパイロット運用を開始。

- 2028年初頭: 最初の完全なシステムを製造。

- 2028年後半: 本格的な量産と市場投入。

調達した1億1000万ドルは、テキサス州オースティンの本社拡張、サンフランシスコへのエンジニアリング拠点新設、そしてデータセンター向けOPUモジュールおよびソフトウェアスタックの開発加速に充てられる。

AIチップ市場の勢力図はどう変わるか

現在のAIチップ市場はNVIDIAの独壇場だが、Neurophosのような「推論特化型」かつ「非シリコン」のアプローチは、市場構造を根本から変える可能性を秘めている。

AIモデルの学習(Training)には依然として汎用性の高いGPUが必要とされるだろうが、一度学習したモデルを動かす推論(Inference)フェーズでは、圧倒的な省電力性能を持つOPUが選好される未来は想像に難くない。特に、電力供給が逼迫している都市型データセンターや、エッジコンピューティング領域において、Neurophosの技術はゲームチェンジャーとなり得る。

シリコンの進化が物理的な限界に近づく中、AIの進化を持続させる鍵は、電子から光子への転換にあるのかもしれない。Neurophosの挑戦は、単なるハードウェアの代替ではなく、計算そのものの物理的基盤を再定義する試みである。

Sources