人類は古くから、記憶や計算の負担を外部の道具へ委ねることで高度な文明を築いてきた。粘土板に刻まれた楔形文字に始まり、複雑な計算を瞬時にこなす関数電卓、あるいは世界中の知識に一瞬でアクセスできるインターネットに至るまで、私たちの認知能力は常に外部ツールによる「認知のオフロード(外部化)」とともに拡張されてきた。だが、現代の生成AIというシステムは、過去のいかなる補助器具とも決定的に異質である。それは利用者の問いに対して、思考プロセスそのものを肩代わりし、瞬時に完璧な模範解答を提示する「思考の自動販売機」の性質を持っている。

一見すると、この即時的な知的支援は私たちのパフォーマンスを飛躍的に高める魔法の杖に思える。未経験のプログラミング言語を用いた実装であれ、難解な数学の宿題であれ、数行のプロンプトを入力するだけで淀みない出力が得られる。だが、カーネギーメロン大学やオックスフォード大学などの米英共同研究チームが発表した1,222名に及ぶ大規模なランダム化比較試験は、その熱狂の底に潜む深刻な代償を暴き出した。

AIに「答え」を求めて対話した時間はわずか10分から15分。しかし、その短いやり取りを経ただけで、AIという補助輪を外された後の人間は、問題を解く能力を失うにとどまらず、困難に立ち向かう「粘り強さ」そのものを喪失してしまうことが実証されたのである。常に正解を与え続けるシステムは、長期的な成長を促す良きメンターの対極に位置する。本研究と関連する一連のデータが告発する、一時的な効率化の裏で静かに進行する人間の認知能力とモチベーションの崩壊メカニズムを紐解いていく。

究極の「短視眼的協力者」がもたらす認知の空洞化

私たちが誰かに新たなスキル、たとえばプログラミングの基礎や数学の概念を教える場面を想像してほしい。優れた教師やメンターは、生徒の質問に対して常に直接的な答えを返すことはしない。時にはヒントだけを与え、時にはあえて沈黙し、生徒自身が試行錯誤の中で「自ら解を導き出すプロセス」を経験できるように導く。人間のコラボレーションにおいて、最良の支援とは「長期的な自律性と能力の獲得」を目的として最適化されている。

対照的に、現在のAIアシスタントは極めて短視眼的な協力者である。安全性や倫理的ガイドラインに関わる事象でない限り、彼らは決して利用者の要求を拒まない。あらゆる専門領域において、要求されれば即座に完全な解答を出力し、ユーザーの「今すぐタスクを終わらせたい」という短期的欲求を満たすことのみに特化している。

これまでにも、AIの過度な利用が人間の批判的思考力や認知能力を低下させるという懸念は囁かれてきた。しかし、その証拠の大半は小規模なアンケート調査や、自己申告に基づく相関関係の観察に留まっていた。本研究の最大のブレイクスルーは、厳密に統制された大規模なランダム化比較試験(RCT)を通じて、AIの短期的な利用が人間の「独立したパフォーマンス」と「タスクに対する持続力(モチベーション)」を直接的に破壊するという因果関係を初めて証明した点にある。

研究チームは、オンライン調査プラットフォームを通じて集めた参加者を複数のグループに分け、分数の計算問題に取り組ませた。分数の計算は数学的推論の基礎であり、この段階でのつまずきが後の高度な数学的理解や抽象的思考に大きな影響を与えることが認知科学の分野で知られている。さらに、実験設定として難易度が1ステップから3ステップへと徐々に上昇する設計が施された。

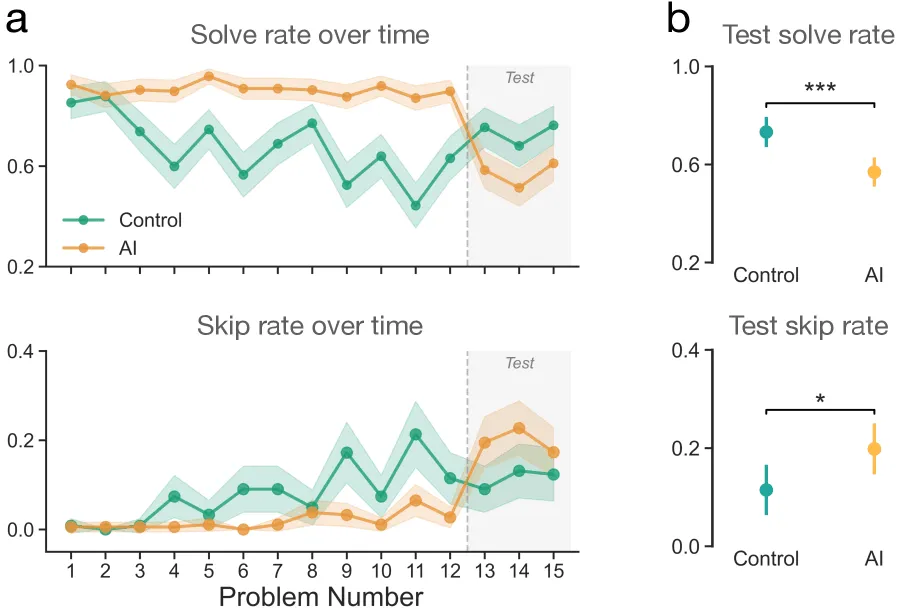

実験の構造は巧妙に設計されている。参加者はまず12問の学習フェーズに取り組む。AIグループの画面には最新の生成AIと同等のアシスタントがサイドバーに用意され、参加者は自由に質問し、手軽に答えを得ることができた。一方の対照群は、最初から最後まで自力で問題と格闘する。

ここでの極めて重要な仕掛けは「スキップボタン」の存在である。参加者には「間違えても報酬は減らない」「正答率は報酬に一切関係しない」ことが事前に告知されている。つまり、少し考えてから解答を入力せずにスキップを選択する行為は、純粋に「問題を解くための認知的な努力を放棄した」という内的モチベーションの低下を直接的に測定する指標となる。

12問を終えた後、事前の警告なしにAIアシスタントが画面から消去され、全員が自力で3問のテスト問題に挑む環境に置かれた。

結果は残酷なほど明確だった。AIの支援が取り払われたテスト問題において、かつてAIを利用していたグループの平均正答率は0.57にとどまり、最初から自力で取り組んでいた対照群の0.73を大きく下回った。さらに深刻なのは持続力の欠如である。AIグループのスキップ率は0.20に達し、対照群の0.11と比較してほぼ2倍の頻度で「考えることを諦める」選択肢に逃げ込んでいたのである。

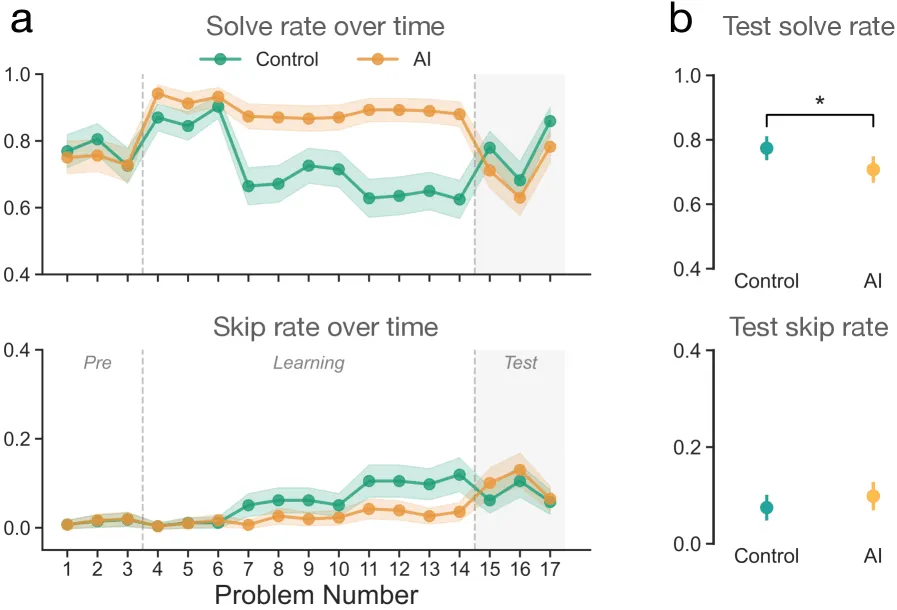

参加者の能力の初期値による偏りを排除するため、研究チームは続く実験2において「事前の基礎テスト」を導入し、参加者の初期スキルを完全に揃えた上で再検証を行った。ここでも結果は揺るがず、AI利用群は自力でのテストにおいて明確に正答率を落とし、困難な問題に対するモチベーションの喪失傾向が強固に再現された。

思考のアウトソーシング。利用スタイルで分かれる残酷な格差

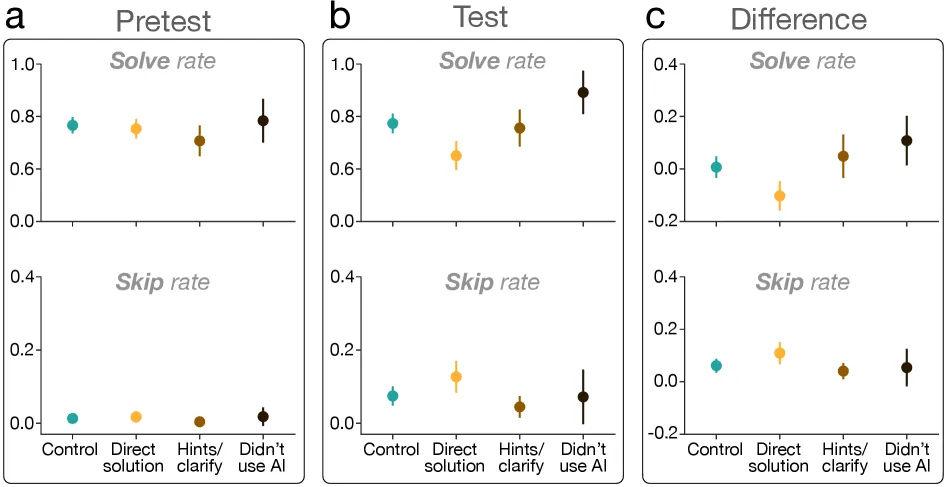

もちろん、生成AIというツールそのものが人間の認知を無差別に破壊する毒薬なわけではない。核心的な問題は、システムと人間の「関わり方の深度」にある。研究チームは、参加者が「具体的にどのようにAIを使ったか」という利用スタイルによる影響の違いを詳細に分析している。

事後調査において、AIグループの約61%は「直接的な答えを得るため」にAIを使用していたと回答した。例えば「答えは?」とだけ入力し、出力された数値をそのまま転記するような使い方である。残りの参加者は「ヒントや概念の解説を求めるため」に使用したか、あるいはAIを利用できる環境にありながら全く使わずに自分の頭で考えることを選んだ。

AI非依存のテストフェーズに入ると、グループ間の格差は劇的に広がった。AIに直接の答えを出力させていた「思考を完全にアウトソーシングした層」は、最も低いテスト正答率(0.65)と最も高いスキップ率を記録した。彼らは対照群(正答率0.77)に劣るどころか、実験開始前の自分自身のプレテストの成績よりも能力を大きく低下させていたのである。

反対に、AIを完全に無視した層は対照群をも上回る最高の正答率を叩き出し、AIに「ヒントや計算手順の解説」を求めた層は、極端な正答率の低下やモチベーションの枯渇を免れていた。外部ツールへの依存がもたらす認知的な毒性は、ユーザー自身が「自分の頭で苦労するプロセス」をどれだけシステムに丸投げしたかに完全に比例している。

| 比較軸 | 人間のメンター(長期的最適化) | 現在の生成AI(短期的最適化) |

|---|---|---|

| 目標設定 | 学習者の長期的な自律性とスキルの獲得 | ユーザーの要求に対する即時の満足とタスク完了 |

| 支援の性質 | 相手のレベルに応じて介入度や情報量を調整する | 常に最高精度の完全な解答を単一のトーンで提示する |

| 拒絶の有無 | 必要に応じて答えを教えず、自考を促す | 安全基準に抵触しない限り、怠惰な要求を絶対に拒まない |

| もたらす結果 | メタ認知の向上、困難に耐える「粘り強さ」の育成 | 瞬間的な生産性向上と引き換えの、自律的な問題解決能力の喪失 |

古代ローマのコンクリートからeSportsまで。読解タスクが暴く「読む体力の喪失」

この現象が「数学的な計算手続きの忘却」という特定の作業に限定される可能性を排除するため、研究チームは全く異なる認知能力を要求するタスクでも実験を繰り返した。米国の大学進学適性試験(SAT)で実際に用いられる「読解力問題(Reading Comprehension)」である。

読解タスクは、計算手順の機械的な暗記ではない。複数のテキストを読み比べ、著者の意図を解釈し、文脈の対立構造を理解して頭の中にメンタルモデルを構築する複雑な意味生成プロセスを伴う。

例えば、実験で用いられた課題の一つは「eSportsはスポーツとして分類されるべきか」というテーマであった。Text 1は「スポーツとは肉体的な鍛錬と疲労を伴うものであり、スクリーン上の出来事に依存するeSportsはスポーツの範疇から外れる」と主張する。対するText 2は「eSportsもまた精密な手腕の動きや高度な戦術、厳格なルールを伴い、アーチェリーや射撃と同様に競技スポーツの要件を満たしている」と反論する。参加者はこの両者の論理構造を正確に把握し、「Text 2の著者はText 1の主張に対してどのように反論するか」という高度な推論を求められる。

また別の課題では、「古代ローマの港湾遺跡のコンクリートが海水に触れることで自己修復する機能を、現代の橋梁にも適用できるとする楽観的な主張(Text 1)」に対し、「それは海洋環境特有の化学反応であり、日常の橋梁環境で機能するかは極めて不確実であると警鐘を鳴らす専門家の意見(Text 2)」を比較検証させた。

ここでも、参加者は5問の学習フェーズ(AI利用可能)を経て、3問のテストフェーズ(AIなし)に挑んだ。

結果は数学の実験と完全に一致した。AIを取り上げられたグループは、対照群(正答率0.89)に対して有意に低い正答率(0.76)を示した。さらに衝撃的なのは、テストフェーズにおいて問題文をまともに読解することすら諦め、わずか「5秒未満」でスキップボタンを押す割合が突出して高くなったことである。数パラグラフにわたる複雑な論理展開を5秒で読み解くことは人間の認知限界を超えている。つまり彼らは、読む努力そのものを早々に放棄したのだ。批判的思考の根幹をなす読解という行為においても、AIへの一時的な依存は人間の「思考の体力」を無残に奪い去る。

なぜ、これほど短時間の接触で人間の粘り強さは失われてしまうのだろうか。論文は、その背後にある2つの構造的な心理メカニズムを提示している。

第一のメカニズムは「基準点のシフト」である。AIに質問すれば数秒で完璧な答えや要約が返ってくる経験を繰り返すと、私たちの脳は「ひとつの知的タスクにかかるべき労力と時間」の基準値を極端に低く書き換えてしまう。一度エレベーターの圧倒的な便利さを知った人間が、数階分の階段を上ることを以前よりもはるかに過酷な苦痛に感じる現象、いわゆる「快楽適応(Hedonic adaptation)」と全く同じ構造である。自力で数分間テキストを睨みつけて考えるという行為が、基準点がバグを起こした脳にとっては、不当に過酷で非効率な苦役に感じられるようになる。

第二のメカニズムは「生産的な苦闘(Productive struggle)」の欠如によるメタ認知の崩壊である。人間は、分からない問題に対して頭を抱え、間違ったアプローチを試み、失敗から軌道修正を行う泥臭いプロセスを通じてのみ、「自分が何を理解していて、何ができないのか」という自己評価能力(メタ認知)を磨き上げる。AIが常に先回りして正解を与え続ける無菌室のような環境下では、この自己の能力を測るための解像度が育たない。結果として、少しでも困難に直面すると、それを乗り越えられるという自己効力感を持てず、早々にタスクを放棄してしまうのである。

「出力の検証者」に堕ちる知識労働者。連鎖する知的退行の社会的インパクト

この10分間の実験が示す「持続力の喪失」は、決して実験室の中だけの現象ではない。実社会のビジネス現場や教育機関において、より大規模な知的退行の兆候がすでに複数の研究から報告され始めている。

スイスのビジネススクールが実施した研究では、生成AIの頻繁な利用と個人の批判的思考力スコアの間に強い負の相関関係があることが確認された。この傾向は特に17歳から25歳の若年層において顕著であった。高い教育を受けた層はAIが生成した情報を批判的に疑い、深い分析を行う傾向を維持していたが、そうでない層は出力結果を鵜呑みにする傾向が強かった。これは、基礎的な思考体力を身につける前に「答えの自動販売機」を手に入れた世代が直面する構造的なリスクを示している。

さらに、Microsoft Researchとカーネギーメロン大学の共同研究は、知識労働者(ナレッジワーカー)の現場で起きている地殻変動を「オートメーションの皮肉(irony of automation)」と名付けて告発している。AIが日常的で定型的な作業を鮮やかに処理するようになることで、皮肉なことにユーザーは自らの「認知の筋肉」を鍛える機会を決定的に奪われる。その結果、かつては主体的に問いを立てる「問題解決者」であった人間が、いつの間にかAIが吐き出した結果をただ眺めるだけの「出力の検証者(Output verifier)」へと転落してしまうというのだ。

プログラミングの現場でも同様の事象が観測されている。AI開発企業Anthropicが行った52名のジュニアソフトウェア開発者を対象とした調査では、馴染みのない新しいプログラミングライブラリ(Trio)の学習において、GPT-4oベースのアシスタントを与えられたグループは、公式ドキュメントとWeb検索のみで自力で格闘した対照群に比べ、その後の知識テストのスコアが「17パーセント」も低かった。ここでも、ツールへの問いかけ方で残酷な差がついている。「AIに解説を求めた者」は良好な学習効果を示したが、「コードの記述そのものをオフロード(外部化)した者」は、新しいスキルを自身の血肉とすることができなかった。

茹でガエルの罠を越えて。長期的協働に向けたAI設計の転換

カーネギーメロン大のチームによるRCT研究が鳴らす最大の警鐘は、その「発症までの時間の短さ」にある。わずか10分から15分の対話で、測定可能なほどの認知能力の低下とモチベーションの減退が引き起こされたのである。現代社会において、知識労働者や学生は日常的に数時間単位で生成AIと接している。もしこの微小な悪影響が、月単位、年単位で複利的に蓄積していくとすればどうなるだろうか。

基礎的な分数計算や文章の読解は、それ自体をAIに任せても実生活で致命的な問題にはならないように思える。だが、これらの基礎的な概念の習得と、そこで培われる「粘り強さ」は、より高度な代数学や複雑な論理的推論へと至るための不可欠な踏み台である。その踏み台を「AIに解かせる」ことで素通りし続けた世代は、ある日突然、自力では思考の階段を一切登れないことに気付く。それは、少しずつ水温が上がる鍋の中で異変に気付かない「茹でガエル」のように、後戻りできない地点まで漸進的に進行する社会的な静かな危機である。

特に、学習リソースや周囲のサポートが乏しい教育環境に置かれた層ほど、この「安易なアウトソーシング」の誘惑に弱く、被害が集中しやすいという格差拡大の懸念も提示されている。

解決策は、システムが答えを教えすぎないよう制御する「ソクラテス的AI」の導入や、企業におけるユーザー側での利用時間制限といった表面的な絆創膏(バンドエイド)を貼るだけでは不十分である。システムそのものの設計思想を根底から覆す必要がある。「ユーザーの即時的な欲求をいかに素早く満たすか」という現在の単一的な最適化目標から脱却し、人間の自律性を長期的にエンパワーメントする方向へ舵を切らねばならない。

最良のツールとは、それが手元にある時に私たちの能力を一時的に拡張してくれるものだけを指すのではない。ツールが手元から失われた時、かつての自分よりも少しだけ賢く、少しだけ困難に強い強靭な思考力を持つ自分に出会えること。それこそが、真の意味での知能の拡張であり、人間とテクノロジーが結ぶべき長期的な協働の姿である。

論文

参考文献