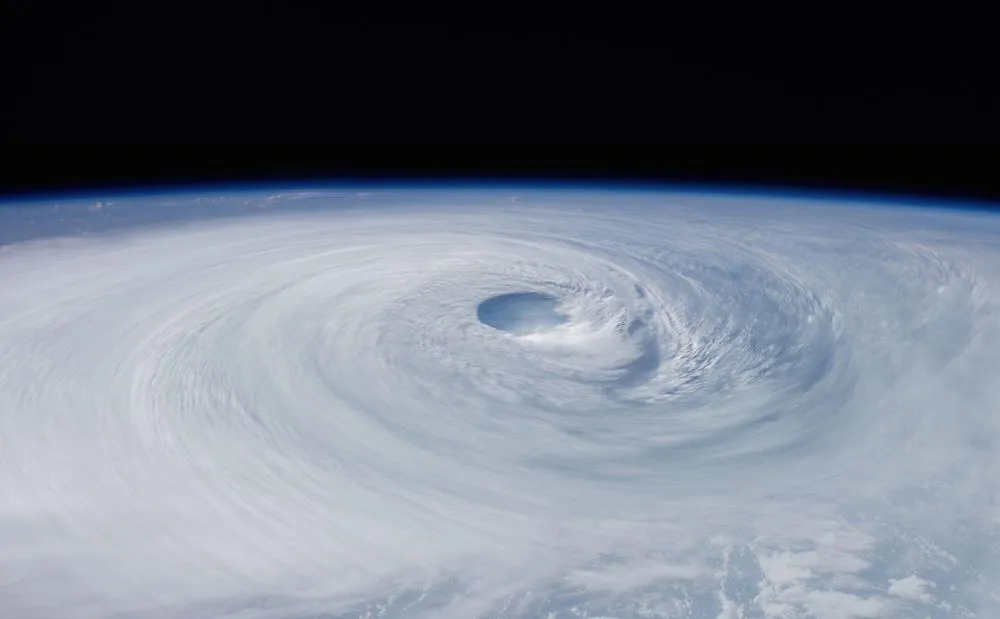

2025年の大西洋は、海の上だけでなく、気象予報の世界においても、巨大な嵐が吹き荒れていた。シーズンが静かに幕を閉じようとする今、専門家たちが分析データを前にして息を呑んでいる。主役は、Google傘下のAI企業DeepMindが開発した新しい気象予測モデルだ。わずか数ヶ月前に産声を上げたばかりのこのAIは、気象予測の巨人たちを次々となぎ倒し、専門家による公式予報さえも上回るという、前代未聞の精度を叩き出したのだ。これは単なる技術的勝利ではない。我々が自然災害にどう向き合うか、その未来を根底から覆しかねない、歴史的なパラダイムシフトの幕開けである。

衝撃のデータが物語る「新時代の到来」

事の発端は、マイアミ大学の上級研究員Brian McNoldy氏が公開した、2025年大西洋ハリケーンシーズンにおける各予測モデルの性能を比較した予備的なデータ分析だった。 この分析が示した結果は、衝撃的という言葉すら生ぬるいものだった。

And here is the same, but for all 13 storms in the entire season so far. "OFCL" is the NHC's forecast, and "GDMI" is the Google #DeepMind ensemble mean and is the leading model for both track and intensity this season. [2/3]

— Brian McNoldy (@bmcnoldy.bsky.social) 2025年11月1日 1:04

[image or embed]

グラフに示された複数の線の中で、最も低い位置、つまり最も予測誤差が少なかったのは、Google DeepMindのAIモデル(GDMI)だったのだ。対照的に、最も高い位置で、つまり最も精度が悪かったのは、米国の国家事業として運用される「全球予報システム(Global Forecast System、以下GFS)」だった。

その差は、一目瞭然というレベルを超えている。例えば、5日先(120時間後)のハリケーンの進路予測における平均誤差を見てみよう。

- Google DeepMind (GDMI): 165海里(約305km)

- 米国全球予報システム (GFS): 360海里(約667km)

GFSの誤差は、DeepMindの実に2倍以上。 これは、5日後のハリケーンの位置が、東京から大阪を軽く通り越してしまうほどの距離もズレる可能性を示唆する。一方でDeepMindの誤差は東京から名古屋あたりに収まる。どちらの情報を基に避難計画を立て、インフラを防護すべきか、答えは明白だろう。

だが、驚きはこれだけでは終わらない。DeepMindのAIは、単に米国の主力モデルに圧勝しただけではなかった。人間の専門家たちが、あらゆるモデルやデータを吟味して発表する「国立ハリケーンセンター(NHC)公式予報(OFCL)」よりも優れた成績を収めたのだ。 さらに、複数の優れたモデルの予測を統計的に統合し、通常は最も信頼性が高いとされる「コンセンサスモデル(TVCNやHCCAなど)」さえも上回った。

これは、大西洋盆地において、AIシステムが単体の自動予測モデルだけでなく、熟練した人間による判断や複数のモデルの集合知をも打ち負かした、歴史上初めてのケースとなった。 まさに、気象予測界の「Alpha Go」ショックとでも言うべき事件である。

なぜAIはこれほど正確なのか?DeepMindモデルの心臓部に迫る

この驚異的な精度の背景には、従来の手法とは全く異なるアプローチが存在する。

伝統的モデルの限界:物理法則との終わりなき格闘

まず、GFSや、世界最高峰と評される欧州中期予報センター(ECMWF)のモデルが、どのように天気を予測しているかを理解する必要がある。これらは「物理ベースモデル」と呼ばれ、大気や海洋の動きを記述する流体力学や熱力学の方程式に基づいている。

地球全体を無数の格子(グリッド)に分割し、それぞれの格子点における気温、気圧、風速などの初期値を観測データから設定する。そして、スーパーコンピュータの膨大な計算能力を使い、これらの物理法則に従って、5分後、10分後、1時間後…と未来の状態をシミュレーションしていくのだ。これは、いわば、地球の気象現象をコンピュータ内にミニチュアで再現する試みであり、その複雑さと計算量は天文学的なものとなる。

このアプローチは科学的に極めて堅牢だが、弱点もある。計算コストを抑えるために、どうしても現実の複雑な現象を単純化(近似)せざるを得ない点だ。特に、ハリケーンの中心部で起こるような、小さくも激しい乱流プロセスを正確に再現することは極めて難しい。そのため、ハリケーンの「進路」予測は得意でも、「勢力(強度)」の予測は苦手、といったトレードオフが生じがちだった。

DeepMindの革新:データから「天気のパターン」を学ぶ

一方、Google DeepMindのAIモデルは、物理法則の複雑な方程式を直接解くことはしない。その代わり、深層学習(ディープラーニング)と呼ばれる技術を用い、過去数十年にわたる膨大な気象データから「天気のパターン」そのものを学習する。

具体的には、2種類のデータを学習に用いているのが特徴だ。

- 再解析データセット: 過去の気象観測データを統合し、地球全体の過去の天気を再構築した膨大なデータ。

- サイクロン特別データベース: 過去45年間に観測された約5,000個のサイクロンについて、その進路、強度、大きさなどの詳細情報をまとめた専門データ。

この2つを組み合わせることで、AIは地球規模の大きな大気の流れ(これがハリケーンの進路を決める)と、サイクロン周辺の局所的な特徴(これが勢力を決める)の両方を同時に学習することができる。これにより、従来のモデルが抱えていた「進路と強度のトレードオフ」を克服し、たった一つのモデルで両方を高精度に予測するというブレークスルーを達成したのだ。

さらに、その効率は圧倒的だ。物理ベースモデルが世界のトップクラスのスーパーコンピュータを数時間稼働させてようやく一つの予測を出すのに対し、DeepMindのAIは、一般的なGPUクラスター(画像処理などに使われる計算ユニット)でわずか数分で予測を完了させる。この速度と低コストは、予報の更新頻度を上げたり、より多くのシナリオを試したりすることを可能にし、気象予報のあり方を根底から変えるポテンシャルを秘めている。

凋落する巨人・米国GFSモデルに一体何が?

輝かしい成果を上げたDeepMindとは対照的に、米国の威信をかけたGFSがなぜこれほどまでに性能を落としてしまったのか。専門家たちは、いくつかの要因を指摘している。

一つは、2019年から始まったモデルの心臓部である「ダイナミックコア」の大規模なアップグレードが、結果的に裏目に出たのではないかという見方だ。「FV3」と呼ばれる新しいコアへの移行は、本来ならば性能向上をもたらすはずだったが、ハリケーンのような特殊な現象の予測においては、むしろ精度を悪化させる副作用があった可能性が考えられる。

もう一つ、より深刻な問題として指摘されているのが、観測データの欠落だ。一部の専門家は、近年の政府予算削減、特に「DOGE」と関連付けられる動きの中で、重要なデータ収集が滞った可能性を推測している。天気予報の精度は、初期値として入力される観測データの質と量に大きく依存する。その入力データが不十分であれば、どれだけ優れたモデルでも正確な予測は導き出せない。この仮説が正しければ、問題は単なる技術的な失敗に留まらない。

現場の予報官たちの間では、今シーズンのGFSの予測は信頼を失い、しばしば「無視される」存在になっていたという。これは、米国の気象予測システムの根幹が揺らいでいることを示す、憂慮すべき事態である。

AIは予報官の仕事を奪うのか?現場と専門家のリアルな声

これほどの性能差を見せつけられると、「もはや人間の予報官は不要になるのではないか」という疑問が湧くのも無理はない。しかし、現場の専門家たちは、より冷静で現実的な見方をしている。

気象予報士のJeff Berardelli氏は、DeepMindの性能を称賛しつつも、これが「万能薬ではない」と強調する。実際、今シーズン、ハリケーン・エリンの進路予測ではDeepMindが他のモデルを圧倒する場面があった一方で、カナダのCMCモデルやドイツのICONモデルなども非常に優れた予測を示したケースは少なくなかった。

専門家たちが口を揃えて強調するのは、「コンセンサス」の重要性だ。どんなに優れたモデルでも、時には大きく外すことがある。だからこそ、一つのモデルを妄信するのではなく、DeepMind、GFS、ECMWF、CMC、ICONなど、特性の異なる複数のモデルの予測を比較検討し、その「平均的な傾向」を見極めることが、最も堅実な予報に繋がる。

未来の気象予報室の姿は、AIが人間に取って代わるのではなく、両者が協調する姿になるだろう。AIが、人間には到底不可能なスピードで膨大なデータを処理し、考えうる無数の未来のシナリオを確率と共に提示する。人間の予報官は、そのAIの出力を解釈し、他のモデルや自身の経験、そして地域の特性といった文脈的知識と照らし合わせ、最終的な判断を下す。そして最も重要な役割である、その予測が持つ不確実性を市民に正しく伝え、適切な行動を促す「リスク・コミュニケーション」を担うのだ。DeepMindは予報官の仕事を奪うのではなく、彼らを強力な能力で補強する「最高のパートナー」になる可能性が高い。

気象予報の未来図:パラダイムシフトはすでに始まっている

2025年のハリケーンシーズンに起きた出来事は、単なる一シーズンの番狂わせではない。これは、気象学における数十年に一度の、地殻変動の始まりと見るべきだ。

最大の理由は、AIモデルが持つ「学習能力」にある。物理ベースモデルの精度向上は、物理学のさらなる理解や計算能力の向上によって、比較的ゆっくりと漸進的に進む。これに対し、AIモデルは新しいデータを学習することで、また自らの失敗から学ぶことで、潜在的には指数関数的に性能を向上させることができる。GoogleがWeather Labを通じて予測データを公開し、世界中の研究者からのフィードバックを得ようとしているのも、この学習サイクルを加速させるためだ。

Googleだけでなく、NVIDIAやHuaweiといった他の巨大テック企業も、独自のAI気象モデル開発にしのぎを削っている。この熾烈な競争は、今後数年間で、我々が手にする天気予報の精度、速度、そして情報量を劇的に向上させるだろう。

より早く、より正確なハリケーンの進路・強度予報は、避難勧告のリードタイムを延ばし、より効果的な防災計画を可能にする。それは、一人でも多くの命を救い、経済的な損失を最小限に食い止めることに直結する。

2025年、我々はAIが自然の最も破壊的な力の一つであるハリケーンの未来を、人間以上に正確に見通す瞬間を目撃した。これは少しの畏怖を伴う事実であると同時に、科学技術が人類にもたらす、計り知れない希望の光でもある。気象予報の新時代は、もう始まっているのだ。

Sources