AIは本当に儲かるのか?この問いに対し、金融大手Morgan Stanleyが投じた最新レポートは極めて重要な視点を提供している。これまで性能の優劣で語られがちだったAIチップ戦争に、「利益率」という極めてビジネスライクな物差しを持ち込んだからだ。その分析が明らかにしたのは、NVIDIAの圧倒的な支配力と、市場の期待を背負うAMDが直面する、あまりにも厳しい現実であった。

新たな評価軸:「100MW AI工場モデル」が示す商業的リアリズム

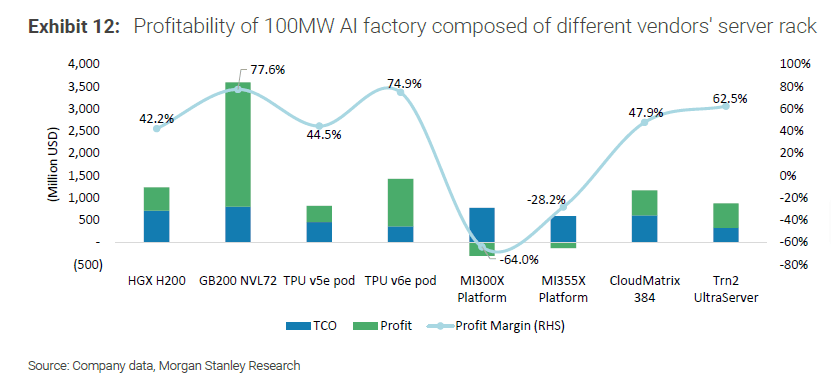

Morgan Stanley Researchが公開したデータは、AI推論ワークロードにおける運用コストと利益率を比較分析したものだ。レポートでは、独自に100MW規模のAI工場を想定し、NVIDIA、Google、AMD、AWS、Huaweiといった各ベンダーのサーバーラックを比較評価している。これは、AIの社会実装で中核を担う「推論(Inference)」タスクに特化し、その投資対効果を定量的に評価しようとする、初の本格的な試みだ。

このモデルの革新性は、これまで曖昧だったAIインフラの経済性を、具体的な「工場」という概念に落とし込んだ点にある。

- 標準化された単位: モデルは、中規模データセンターの典型的な電力消費量である100メガワット(MW)を基準単位とする。これにより、異なるベンダーのソリューションを同一の土俵で比較することが可能になる。

- 精緻なコスト計算: レポートは、AI工場の運営にかかる総所有コスト(Total Cost of Ownership, TCO)を徹底的に洗い出している。これには、データセンター建設などの「基建コスト」、AIチップを含むサーバーシステムなどの「ハードウェアコスト」、そして電力料金などの「運営コスト」が含まれる。このモデルによれば、100MW規模のAI工場の年間TCOは、構成によって3.3億ドルから8億ドル強に達するという。

- 市場価格に基づく収益予測: 収益は、各ハードウェアが生み出すTokenの量(TPS:Tokens Per Second)に、市場の公允な価格(100万Tokenあたり0.2ドルと設定)を掛け合わせることで算出される。現実的な稼働率(70%)も考慮されており、極めて実態に近い収益モデルとなっている。

このフレームワークが導き出した結論は明快だ。標準的なAI推論工場は、採用するチップに関わらず、平均して50%を超える高い利益率を生み出すポテンシャルを持つ。AI推論が、単なる技術革新ではなく、計算可能でリターンの大きいビジネスであることを雄弁に物語っている。

しかし、その内訳は、プレイヤーごとに天国と地獄の様相を呈していた。

勝者NVIDIA GB200が叩き出した「77.6%」という異次元の収益性

レポートが明らかにしたランキングにおいて、勝者の頂点に君臨したのは、やはりNVIDIAだった。同社の最新アーキテクチャ「Blackwell」を搭載したフラッグシッププラットフォーム「GB200 NVL72」で構成されたAI工場は、実に77.6%という驚異的な利益率を達成すると試算された。

この圧倒的な収益性の源泉はどこにあるのか。それは、単なるハードウェアの演算性能だけによるものではない。NVIDIAが長年かけて築き上げてきた、重層的な競争優位性がそこにはある。

- 技術的優位性(FP4サポート): BlackwellアーキテクチャがサポートするFP4(4ビット浮動小数点)精度は、AI推論ワークロードにおいて、性能を大きく損なうことなくデータ量を削減し、処理速度を劇的に向上させる。これが直接的にToken産出効率(TPS)の向上、すなわち収益の最大化に繋がっている。

- ソフトウェア・エコシステムの支配力: CUDAプラットフォームは、もはや単なる開発環境ではない。AI開発者にとっての「OS」とも言うべき存在であり、NVIDIAのハードウェア性能を最大限に引き出すための最適化が絶えず行われている。レポートが指摘する「Fine Wine」(ワインのように時と共に熟成する)効果は、Hopper世代だけでなくBlackwell世代でも健在であり、ソフトウェアのアップデートを通じて継続的に性能が向上していく。このエコシステムの存在が、他社が容易に追いつけない深淵な堀となっているのだ。

- 統合プラットフォームとしての完成度: GB200 NVL72は、GPUだけでなく、CPU、そして超高速インターコネクトであるNVLinkを緊密に統合したシステムだ。個々の部品の性能だけでなく、システム全体としてボトルネックを排除し、最大効率で稼働するように設計されている。これが高い稼働率と性能維持に貢献している。

興味深いのは、2位にGoogleの自社開発チップ「TPU v6e pod」が74.9%という高い利益率で続いている点だ。これは、クラウドサービスという巨大な出口を持つ企業が、自社のワークロードに特化してハードウェアとソフトウェアを垂直統合で開発・最適化することの威力を示している。NVIDIAとは異なるアプローチで、極めて高い経済合理性を実現できることを証明した形だ。

さらに、AWSの「Trn2 UltraServer」(62.5%)、そしてHuaweiの「昇騰CloudMatrix 384」(47.9%)も堅実に利益を確保しており、AI推論市場が多様なソリューションを受け入れるだけの深さと広がりを持っていることも示唆している。

AMDの深刻な誤算:「推論」の戦場でなぜ大赤字に陥ったのか

レポートが投じた最大の衝撃は、AMDの財務パフォーマンスに関する分析だろう。市場からNVIDIAの唯一の対抗馬として大きな期待を集めるAMDのAIプラットフォームは、この推論シナリオにおいて、信じがたいほどの損失を記録した。

- AMD MI300Xプラットフォーム: -64.0%

- AMD MI355Xプラットフォーム: -28.2%

なぜ、これほどの乖離が生まれてしまったのか。レポートは、その原因が「高コスト構造」と「収益効率の低さ」という致命的なミスマッチにあることを示唆している。

第一に、コストの問題だ。驚くべきことに、MI300Xプラットフォームで構成されたAI工場の年間TCOは7.74億ドルと試算されており、これはNVIDIAの最高峰であるGB200プラットフォームの8.06億ドルとほぼ同水準である。多くの市場関係者が持つ「AMDはコスト・パフォーマンスに優れる」というイメージを根底から覆すデータだ。AIインフラのコストはチップ単価だけでは決まらない。サーバー全体の設計、冷却、電力効率、そして10年単位で見ればデータセンターの建設費用まで含まれる。このTCOという観点において、現状のAMDソリューションは、決して安価な選択肢ではないのだ。

第二に、収益性の問題だ。NVIDIAと同等の巨額な投資を必要としながら、その投資を回収できるだけのToken産出効率を「推論」タスクで発揮できていない。これが赤字の直接的な原因である。AMDのMI300シリーズは、AIの「学習(Training)」タスクにおいては高い性能を発揮することが知られているが、今後AI市場の85%を占めるとされる「推論」タスクにおいては、ソフトウェアの最適化が追いついていない可能性が浮き彫りになった。

CUDAという成熟しきったエコシステムに対し、AMDが推進するROCmはまだ発展途上にある。特定の推論モデルやワークロードに対するきめ細かなチューニング、ドライバの安定性、開発者コミュニティの厚みといった点で、NVIDIAとの間には依然として大きな隔たりが存在する。ハードウェアのカタログスペックがいかに優れていても、それを実ビジネスの収益に繋げるソフトウェアの力が伴わなければ、宝の持ち腐れとなってしまう。この現実を、Morgan Stanleyのモデルは冷徹に突きつけた。

エコシステムとロードマップがすべてを決する

このレポートは、AIチップ戦争の主戦場が、個別の製品性能の競争から、より大きな「エコシステム」と「製品ロードマップ」の競争へと移行していることを明確に示している。

非NVIDIA陣営は、NVIDIAの牙城であるNVLinkに対抗すべく、新たな接続規格の標準化を急いでいる。AMDが主導する「UALink」は低遅延を重視し、Broadcomなどが推進する「Ethernet」はオープン性と柔軟性を武器にする。この標準化競争の行方は、NVIDIAに対抗しうるオープンなエコシステムが生まれるかどうかを占う上で極めて重要だ。しかし、規格争いに時間を費やしている間にも、NVIDIAは着々と歩を進めている。

NVIDIAが示すロードマップは、競合にとって絶望的ですらある。2025年には「Blackwell Ultra」を投入し、現行比で50%の性能向上を予告。そして2026年には次世代アーキテクチャ「Rubin」の大規模量産を開始する計画だ。この1年ごとのメジャーアップデートという驚異的な開発ケイデンスは、競合他社に息つく暇も与えず、常に追うべき背中を遠ざけ続ける。

AMDにとって、次世代の「MI400」はまさに正念場となるだろう。ハードウェア性能の向上はもちろんのこと、今回露呈した「推論」における収益性の課題をソフトウェアの力で克服できるのか。それが、NVIDIA一強時代に風穴を開けられるかどうかの分水嶺となる。

Morgan Stanleyのレポートは、AIという熱狂に沸く市場に、強烈な「商業的リアリズム」の視点を持ち込んだ。それは、AIがもはや技術デモの段階を終え、投資、コスト、利益という厳格な経済原則に支配される巨大ビジネスへと変貌を遂げたことの宣言に他ならない。企業の意思決定者や投資家は、もはやチップの理論性能だけでなく、TCOとROIというレンズを通して、自らのAI戦略を再評価する必要に迫られている。

Sources