OpenAIは、同社の主力AIチャットボット「ChatGPT」において、新たなAIモデル「GPT-4.1」および「GPT-4.1 mini」の提供を開始したと発表した。 これらのモデルは、特にコーディング能力と指示追従性の向上を特徴としており、開発者コミュニティからの強い要望に応える形で、API提供開始から約1ヶ月を経てChatGPTにも導入されることになる。 しかし、ただでさえ複雑化していたChatGPTのモデルラインナップがさらに増えることに対し、ユーザーからは戸惑いの声も上がっている。

コーディング性能と指示追従性が向上した「GPT-4.1」とは?

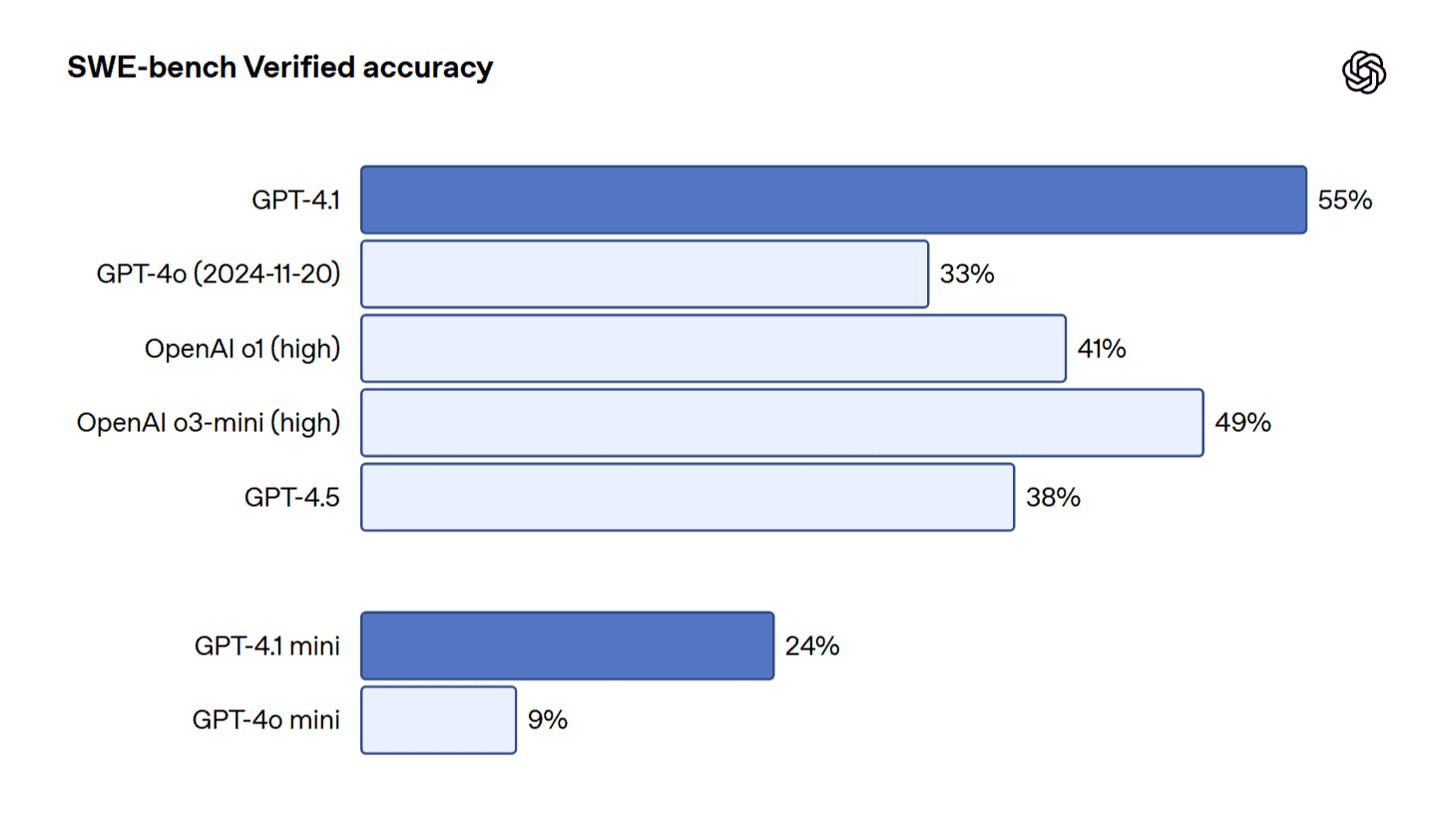

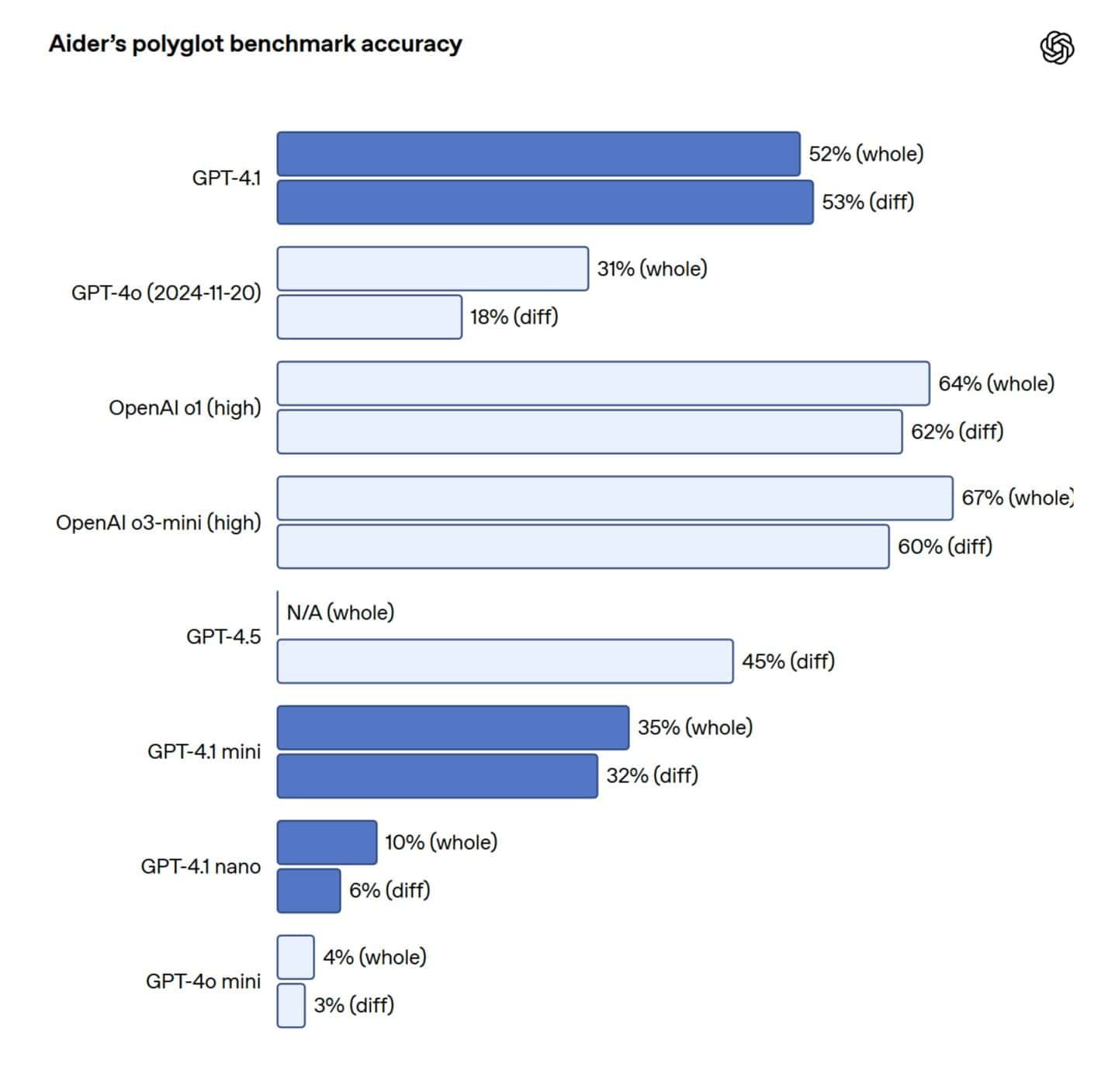

今回ChatGPTに導入された「GPT-4.1」は、OpenAIが2025年4月にAPIを通じて開発者向けに先行リリースしていたモデル群の一翼を担うものだ。 OpenAIによると、GPT-4.1は既存のGPT-4oと比較して、特にソフトウェア開発に関連するタスクや、ユーザーの指示を正確に理解し実行する能力において顕著な改善が見られるという。 具体的には、ソフトウェアエンジニアリングのベンチマークであるSWE-bench Verifiedにおいて、GPT-4.1はGPT-4oを21.4ポイント上回るスコアを記録している。 また、指示追従性を測るScaleのMultiChallengeベンチマークでも、GPT-4oに対して10.5ポイントの向上を示している。

この性能向上は、より複雑なプログラミングの補助や、特定のフォーマットに従った出力、あるいは多段階の指示に対する的確な応答といった実用的な場面でユーザーにメリットをもたらすと考えられる。OpenAIは、GPT-4.1を「よりシンプルな、日常的なコーディングニーズ」に応える選択肢として位置づけており、同社の持つ「o3」や「o4-mini」といった推論モデルとは異なる強みを持つとしている。

特筆すべきは、API版のGPT-4.1ファミリー(GPT-4.1、GPT-4.1 mini、GPT-4.1 nano)が最大100万トークンという広大なコンテキストウィンドウをサポートしている点だ。 これにより、理論上は数千ページに及ぶ文書や大規模なコードベースを一度に処理できることになる。 ただし、現時点でChatGPTのインターフェースから利用できるGPT-4.1およびGPT-4.1 miniのコンテキストウィンドウサイズは、従来のChatGPTの制限(無料ユーザー8,000トークン、Plusユーザー32,000トークン、Proユーザー128,000トークン)に準拠しており、API版の100万トークンが直接利用可能になったわけではない点に注意が必要だ。この点については、将来的な拡張も示唆されている。

ChatGPTの有料プラン(Plus、Pro、Team)のユーザーは、モデル選択メニューの「他のモデル」からGPT-4.1を選択できるようになる。 EnterpriseおよびEduユーザーへの展開は数週間以内を予定しているとのことだ。

無料ユーザーにも恩恵「GPT-4.1 mini」が標準モデルに

今回のアップデートでは、より軽量なモデルである「GPT-4.1 mini」も提供が開始された。 こちらは、従来の「GPT-4o mini」を置き換える形で、無料ユーザーを含む全てのChatGPTユーザーが利用可能となる。 OpenAIによれば、GPT-4.1 miniは旧GPT-4o miniと比較して、指示追従性、コーディング能力、そして「全体的な知性」において大幅な改善を実現しているとのことだ。

無料ユーザーは、これまで通りGPT-4oの利用上限に達すると、自動的にフォールバックモデルに切り替わるが、その際のモデルがGPT-4o miniからGPT-4.1 miniに変更されることになる。 これにより、無料ユーザーも間接的にGPT-4.1ファミリーの恩恵を受けられる形となる。

API限定からChatGPTへ、その背景とユーザーの混乱

GPT-4.1ファミリーは当初、APIを介した開発者向けの提供が主眼とされていた。 しかし、OpenAIのポストトレーニングリサーチリードであるMichelle Pokrass氏がXで言及したように、「ユーザーからの強い要望」を受けてChatGPTへの搭載が決定された経緯がある。同氏は「当初はAPI限定の予定だったが、皆さんがChatGPTでの利用を望んだため」と述べており、ユーザーの声が製品戦略に影響を与えたことを示唆している。

一方で、この新たなモデル追加は、既に複雑化しているOpenAIのモデルラインナップをさらに分かりにくくするという側面も持ち合わせている。ChatGPT Proユーザーは、今回の追加で実質的に9種類(GPT-4o、様々な特殊GPT-4oバージョン、o1-pro、o3-mini、o3-mini-high、そしてGPT-4.1とGPT-4.1 mini、さらにDeep Research機能)もの選択肢に直面することになる。 この状況に対し、ウォートン校のEthan Mollick教授がSNSで皮肉を込めて言及するなど、専門家からもその複雑さを指摘する声が上がっている。

RedditやOpenAIの公式フォーラムでは、「どのモデルを使えば良いのか分からない」「なぜ最良のモデルだけを提供しないのか」といったユーザーの困惑の声が以前から聞かれていた。OpenAIのSam Altman CEO自身も、2025年2月にモデル名の複雑さを認めた上で、将来の「GPT-5」では命名規則を整理し、より統一されたブランド構造を目指すとしていた。しかし、今回のGPT-4.1の追加は、その簡素化の目標とは逆行するように見えるかもしれない。

エンタープライズ利用におけるGPT-4.1の価値

そもそもGPT-4.1はエンタープライズ用途における実用性を重視して設計されたモデルであるようだ。その証左に、まずはGPT-4.1が、開発者向けのAPI版という形でリリースされたことからも窺えるだろう。加えて、GPT-4oと比較してSWE-bench Verifiedで21.4ポイント、ScaleのMultiChallengeベンチマークで10.5ポイント高いスコアを記録し、冗長な出力を50%削減するなど、企業ユーザーが重視する効率性と信頼性の向上を実現している。

特に、AIエンジニア、AIオーケストレーションリード、データエンジニア、ITセキュリティ専門家といった役割において、GPT-4.1は以下のようなメリットをもたらすと分析されている。

- AIエンジニア: モデルのデプロイ速度向上と指示追従性の改善により、開発ライフサイクルの効率化が期待できる。

- AIオーケストレーションリード: 堅牢性と一貫性のある動作により、自動化パイプラインへの統合が容易になる。

- データエンジニア: ハルシネーション(もっともらしい嘘の情報を生成する現象)の低減と事実に基づいた応答精度の向上により、信頼性の高いデータワークフロー構築に貢献する。

- ITセキュリティ専門家: 一般的なジェイルブレイク(安全制限を突破する試み)への耐性と制御された出力により、社内ツールへの安全な統合を支援する。

GPT-4.1は、特にパフォーマンスと運用要件のバランスを求める中規模企業にとって、魅力的な選択肢となる可能性があることは確かだ。

安全性と透明性への新たな取り組み

GPT-4.1のAPI版が4月にリリースされた際、一部のAI研究コミュニティからは、十分なセーフティレポートなしにモデルが提供されたことに対する批判の声が上がっていた。 これに対しOpenAIは、GPT-4.1はフロンティアモデル(能力が飛躍的に向上した最先端モデル)ではなく、既存モデルの延長線上にあるため、フロンティアモデルと同等の詳細なレポートは必須ではないとの見解を示していた。

しかし、今回のChatGPTへの導入とほぼ時を同じくして、OpenAIはAIモデルの安全性評価結果をより頻繁に公開していく方針を発表し、そのための新たなWebサイト「Safety Evaluations Hub」を立ち上げた。 このハブでは、有害コンテンツの生成、ジェイルブレイク耐性、ハルシネーションの発生率、指示階層の遵守といった項目に関する各モデルの評価結果が公開され、定期的に更新される予定である。 GPT-4.1およびGPT-4.1 miniの安全性評価結果もこのハブで確認できる。 これは、OpenAIがモデルの安全性と透明性に対する社会的な要請に応えようとする姿勢の表れと言えるだろう。ただし、これらのテストはOpenAI自身が行い、公開する情報を選択しているため、全ての課題が公になるとは限らない。

結局、どのモデルを選べばいいのか?

これだけ多くのモデルが提供されると、ユーザーとしては「結局どれを使えば良いのか?」という疑問が湧くのは当然である。OpenAIは、現時点ではGPT-4oをChatGPTのデフォルトモデルとして維持している。これは、GPT-4oが汎用性、速度と能力のバランス、そして親しみやすい対話スタイル(強化学習と特別なシステムプロンプトによって調整されている)を持つためと考えられる。

一方で、o3やo4-mini-highのような「推論モデル」は、実行速度は遅いものの、分析的な問題をより体系的に考察したり、信頼性の高いウェブ検索を実行したりする能力に長けている。

そして今回追加されたGPT-4.1は、主に「コーディング支援」において、より高速な応答を求めるユーザー向けの選択肢として位置づけられているようだ。 実際の使用感としては、GPT-4.1はGPT-4oに比べて簡潔な応答をする傾向があると見られる。

最終的にどのモデルが最適かは、ユーザーの好み、達成したいタスク、そして各モデルに設定されている利用制限(より高性能なモデルは運用コストが高いため、利用回数に制限が設けられている場合がある)によって変わってくるだろう。

重要なのは、どのAIモデルもハルシネーションを起こす可能性があり、特に重要なタスクに利用する際は、出力された情報を鵜呑みにせず、必ず他の情報源と照らし合わせてファクトチェックを行う必要があるという点である。

AIモデル戦国時代、OpenAIの次の一手は?

OpenAIがGPT-4.1ファミリーをChatGPTに導入したことは、AI技術の進化と普及が加速していることを改めて示す動きと言える。特にコーディング支援能力の向上は、多くの開発者にとって朗報だろう。しかし、その一方で、モデルラインナップの複雑化は、一般ユーザーにとっては新たな混乱の種になりかねない。

OpenAIがかつて約束した「GPT-5」によるモデル体系の整理・統合に大いに期待したいところだ。

Source

- OpenAI (X)