SK hynixが世界に先駆けて12層HBM4メモリのサンプルを主要顧客に向けて出荷した。現在サンノゼで開催中のGTC 2025でも開発モデルを展示中だ。この次世代AI向け超高性能DRAMは最大36GB容量と2TB/秒超の帯域幅を達成し、同社は2025年下半期の量産開始を目指している。

予定を前倒しして12層HBM4サンプルを顧客へ提供

SK hynixは12層HBM4(High Bandwidth Memory 4)のサンプルを主要顧客に予定より早く提供したと発表した。同社は長年培ってきたHBM市場での技術的優位性と生産実績を活かし、すでに顧客向けの認証プロセスを始動させている。SK hynixによれば、2025年下半期内に12層HBM4製品の量産準備を完了させる計画で、これにより次世代AIメモリ市場での地位をさらに強固なものにする考えだ。

3月17日から21日までカリフォルニア州サンノゼで開催されているグローバルAIカンファレンス「GTC 2025」においても、SK hynixは「Memory, Powering AI and Tomorrow」と題したブースで開発中の12層HBM4モデルを来場者に披露している。同イベントには同社のKwak Noh-Jung CEO、AI InfraおよびCMOのJuseon Kim氏、Global S&MのLee Sangrak氏らトップ幹部が参加し、グローバルAI業界の主要プレイヤーとの連携強化に努めている。

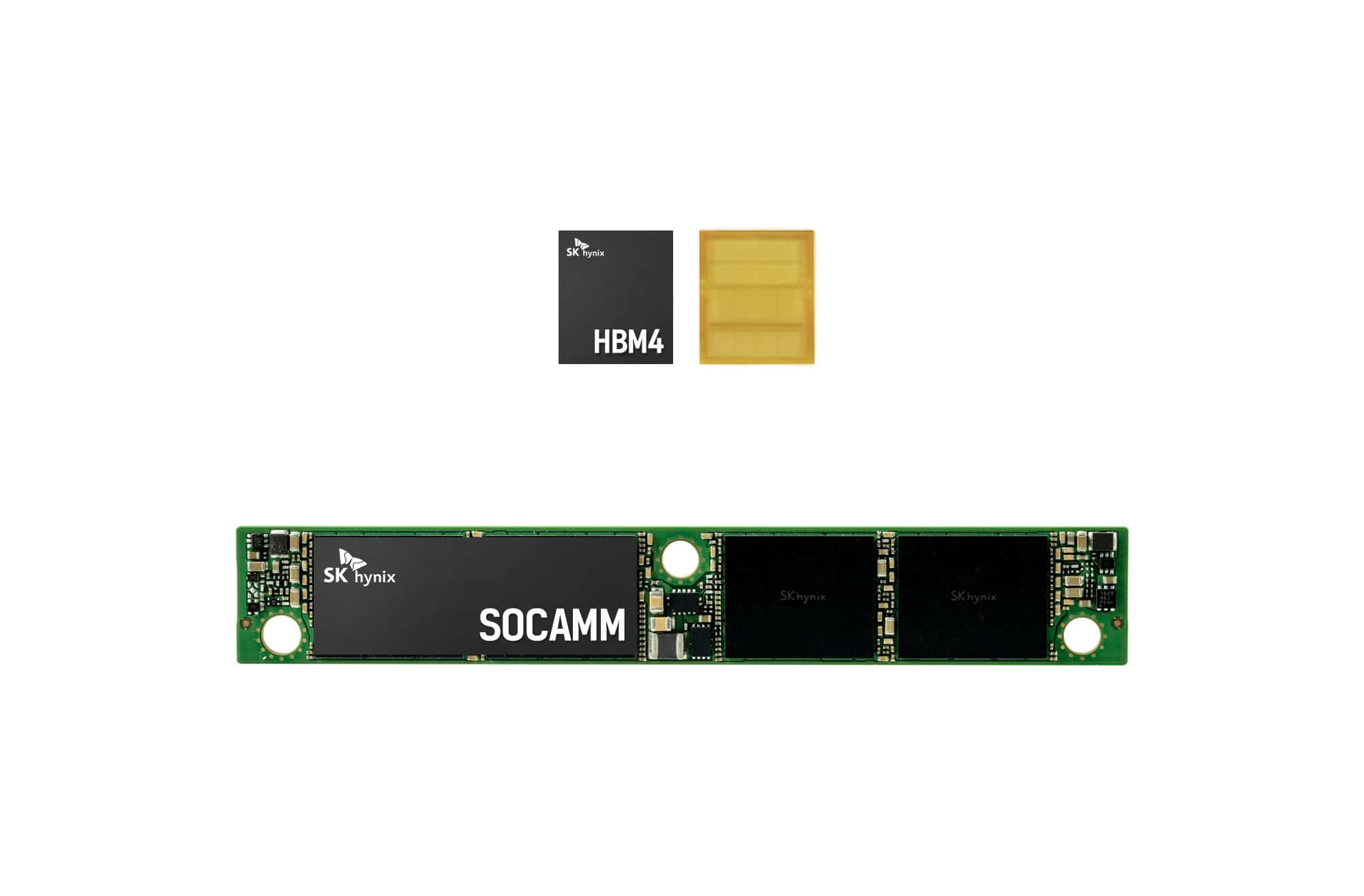

GTC 2025では12層HBM4に加え、すでに量産・供給を開始している12層HBM3Eや、AIサーバー向けの新メモリ規格となるSOCAMM(Small Outline Compression Attached Memory Module)も展示。SOCAMMはAIワークロードのメモリ容量を大幅に拡大しながらも電力効率を維持する低電力DRAMベースのメモリモジュールとして注目を集めている。

圧倒的な容量と速度を実現した次世代メモリ

今回サンプル提供された12層HBM4は、AIメモリ製品に不可欠となる業界最高水準の容量と速度を誇る。このメモリは毎秒2TB(テラバイト)を超えるデータ処理帯域幅を世界で初めて実装。これは1秒間に5GBのフルHD映画400本以上に相当するデータを処理できる性能であり、前世代のHBM3Eと比較して60%以上の高速化を達成している。

SK hynixは独自のAdvanced MR-MUF製法を採用することにより、12層HBM製品において最高となる36GBの容量を実現した。この製法は前世代製品での成功により競争力が実証されており、チップの反りを効果的に防止しながら放熱性を向上させることで、製品の信頼性と安定性を最大限に高めている。

技術面の詳細としては、SK hynixは2025年下半期に予定している12層HBM4の量産に向けて、TSMCの最先端3nmプロセスノードを採用する計画だ。これにより、さらなる高性能化と電力効率の向上が期待される。

AIメモリ市場での主導権を強化するSK hynix

SK hynixは2022年に業界に先駆けてHBM3の量産化を成功させ、2024年には8層および12層HBM3Eの量産も他社に先んじて開始している。特筆すべきは、12層HBM3EがNVIDIAの最新Blackwell GB300 GPU向けに独占供給されている点で、SK hynixは競合他社に対して揺るぎないリードを築き上げている。

「顧客ニーズに応えるための技術的課題を克服する長年の一貫した努力により、AIエコシステムのフロントランナーとしての地位を確立してきました。業界最大のHBMプロバイダーとして蓄積してきた経験を活かし、性能認証プロセスと量産準備をスムーズに進める体制が整いました」と、SK hynixのAI InfraプレジデントであるJustin Kim氏は語る。

同社はさらに、「差別化された競争力を持つAIメモリ分野において、Full Stack AI Memory Providerとしての未来を着実に歩んでいる」と自信を示している。

一方で、SK hynixの主要競合であるSamsungは12層HBM3Eの量産に関してまだ数か月の遅れがあるとされており、SK hynixの技術的アドバンテージは当面継続する見通しだ。

Source