もし私たちがChatGPTのような人工知能(AI)システムが実際には学習していないと言ったら、あなたはどう思うだろうか。私たちが話をする多くの人々は、これを聞いて本当に驚く。

AIシステム自体も、自分が学習システムであると確信を持って言うことが多い。多くの報告書や学術論文でも同様のことが述べられている。しかし、これは誤解—あるいはAIにおける「学習」の意味についての曖昧な理解によるものである。

しかし、AIシステムがどのように、そしていつ学習するのか(そしていつ学習しないのか)をより正確に理解することで、あなたはより生産的で責任あるAIユーザーになれるだろう。

AIは学習しない – 少なくとも人間のようには学習しない

AIに関する多くの誤解は、学習など、人間に適用された場合に特定の意味を持つ言葉を使用することから生じている。私たちは人間がどのように学習するかを知っている。なぜなら、私たちはそれを常に行っているからだ。私たちは経験を積み、失敗することもあり、新しいものに出会い、驚くべきことを読む。そしてそれによって記憶し、行動の仕方を更新または変更する。

これはAIシステムが学習する方法ではない。主に2つの違いがある。

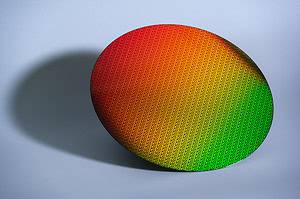

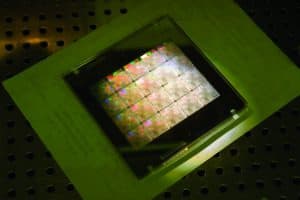

第一に、AIシステムは人間のように物事を理解できるような特定の経験から学習することはない。むしろ、彼らは膨大な量のデータからパターンを数学的に符号化することによって「学習」する。これは構築時のトレーニングプロセスで行われる。

ChatGPTを動かすGPT-4などの大規模言語モデルを例に取ろう。簡単に言えば、それは単語(実際にはトークン)間の数学的関係を符号化することによって学習し、どのテキストがどの他のテキストと一緒に行くかを予測することを目的としている。これらの関係は膨大な量のデータから抽出され、計算集約的なトレーニングフェーズで符号化される。

この形の「学習」は明らかに人間の学習方法とは非常に異なる。

AIはしばしば、人間が世界に生きているだけで自然に学ぶ世界についての単純な常識的知識に苦労するという特定の欠点がある。

しかし、AIトレーニングも非常に強力である。なぜなら、大規模言語モデルは人間が理解できる範囲をはるかに超えた規模でテキストを「見て」きたからだ。そのため、これらのシステムは執筆、要約、コーディング、会話などの言語ベースのタスクで非常に有用である。これらのシステムが私たちのように学習しないが、膨大な規模で学習するという事実は、彼らが得意とする種類のことにおいて万能選手となる。

トレーニングが終われば、学習も止まる

ChatGPTなど、多くの人々が使用するほとんどのAIシステムは、構築された後は学習しない。AIシステムはまったく学習しないと言えるかもしれない—トレーニングは単に構築方法であり、動作方法ではない。GPTの「P」は文字通り「事前トレーニング済み(pre-trained)」を意味する。

技術的な用語では、ChatGPTのようなAIシステムは開発の一部として「トレーニング時の学習」にのみ取り組み、「実行時の学習」は行わない。進行中に学習するシステムは確かに存在する。しかし、それらは典型的に単一のタスク、例えばNetflixのアルゴリズムが視聴すべきものを推奨するなどに限定されている。一度それが完了すれば、終わりだ、というわけだ。

「事前トレーニング済み」であることは、大規模言語モデルが常に時間の中で固定されていることを意味する。トレーニングデータの更新には非常にコストのかかる再トレーニング、または少なくとも小さな調整のためのいわゆる微調整が必要となる。

つまり、ChatGPTは継続的にあなたのプロンプトから学習することはない。また、大規模言語モデルは標準では何も記憶しない。単一のチャットセッションで発生することだけをメモリに保持する。ウィンドウを閉じるか、新しいセッションを開始するたびに、毎回クリーンシートになる。

これを回避する方法はある。例えばユーザーに関する情報を保存することだが、それらはアプリケーションレベルで実現される。AIモデル自体は学習せず、再トレーニングされるまで変更されないままである(この点についてはもう少し後で説明する)。

これはユーザーにとって何を意味するのか?

まず、あなたのAIアシスタントから何を得るかを認識しよう。

テキストデータから学習することは、ChatGPTなどのシステムが言語モデルであり、知識モデルではないことを意味する。数学的トレーニングプロセスを通じてどれだけ多くの知識が符号化されるかは本当に驚くべきことだが、これらのモデルは知識の質問をされたときに常に信頼できるわけではない。

彼らの真の強みは言語との連携にある。そして、時間内で凍結されているため、応答に古い情報が含まれていても、またはChatGPTがあなたが伝えた事実を覚えていなくても驚かないでほしい。

良いニュースは、AI開発者がいくつかの賢い回避策を考え出したことだ。例えば、ChatGPTのいくつかのバージョンは現在インターネットに接続されている。よりタイムリーな情報を提供するために、Web検索を実行し、応答を生成する前にその結果をプロンプトに挿入することがある。

もう一つの回避策は、AIシステムが応答をパーソナライズするためにあなたについてのことを覚えられるようになったことだ。しかし、これはトリックで行われている。大規模言語モデル自体がリアルタイムで学習したり更新したりするわけではない。あなたに関する情報は別のデータベースに保存され、目に見えない方法で毎回プロンプトに挿入される。

しかし、それでもあなたは何かが間違っているときにモデルを修正することはできない(または事実を教えることもできない)。モデルはある程度パーソナライズできるが、それでも即座に学習することはない。

AIがどのように学習するか—あるいは学習しないか—を正確に理解しているユーザーは、効果的なプロンプト戦略の開発により投資し、AIをアシスタントとして扱う—常にチェックが必要なアシスタントとして。

AIにあなたを支援させよう。しかし、あなた自身が学習することを確実にしよう、プロンプトごとに。

コメント