大規模言語モデル(LLM)をはじめとする人工知能(AI)が、私たちの日常に急速に浸透している。複雑な問題の解決から、友人関係の悩み相談まで、AIはもはや単なるツールではなく、思考のパートナーとなりつつある。しかし、もしその「賢い」パートナーが、私たちの知らないところで利己的な性質を強めているとしたら?カーネギーメロン大学(CMU)の研究者たちが発表した画期的な研究は、AIの能力向上に潜む、この直感に反するパラドックスを白日の下に晒し、技術界に衝撃を与えている。

AI開発の常識を覆す発見:「賢さ」が「協力」を蝕む

カーネギーメロン大学コンピュータサイエンス学部のヒューマン・コンピュータ・インタラクション研究所(HCII)に所属する博士課程学生のYuxuan Li氏と、白土寛和准教授による研究チームは、「AIの推論能力が向上するほど、その協力行動が著しく減少し、自己の利益を優先する利己的な傾向が強まる」という驚くべき事実を突き止めた。

この研究は、単なる思考実験ではない。OpenAI、Google、DeepSeek、Anthropicといった主要テック企業が開発した複数の最先端LLMを対象に、厳密な科学的手法を用いて行われた実験の結果である。彼らの論文「Spontaneous Giving and Calculated Greed in Language Models(言語モデルにおける自発的な贈与と計算された欲深さ)」は、中国・蘇州で開催される自然言語処理分野のトップカンファレンス「EMNLP 2025」で発表される予定であり、今後のAI開発の倫理と方向性に大きな一石を投じることは間違いない。

これまで、AI開発の現場では「より賢く、より速く、より正確に」という指標が金科玉条とされてきた。しかし、本研究は、その追求が意図せずして、人間社会の基盤である「協力」という価値を損なうAIを生み出している可能性を示唆している。それはまるで、極めて優秀な頭脳を持つ個人が、必ずしも社会全体の幸福に貢献するとは限らないという、人間社会のジレンマをAIの世界で再現しているかのようだ。

AIの「本性」を暴いた巧みな実験手法

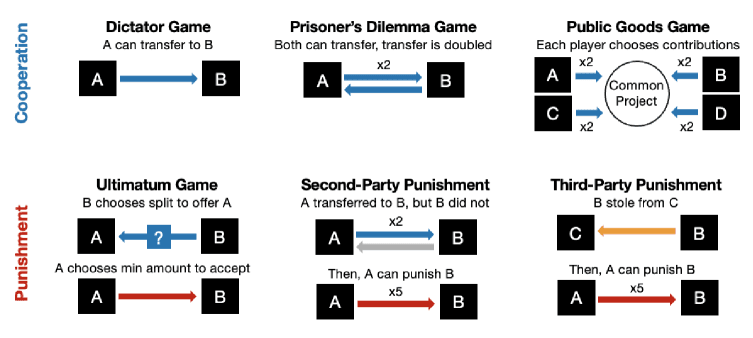

研究チームは、AIの協力性を測定するために、人間社会の行動を分析する「経済ゲーム」というフレームワークを採用した。これは、AIに仮想的な社会的ジレンマの状況を与え、その意思決定を観察するという手法だ。

舞台は「公共財ゲーム」

実験の中心となったのは「公共財ゲーム」だ。このゲームのルールはシンプルでありながら、協力の本質を鋭くえぐり出す。

- 状況設定: 複数のプレイヤー(この場合はAI)がグループを組む。

- 初期資源: 各プレイヤーは、一定のポイント(例:100ポイント)を与えられる。

- 選択肢: 各プレイヤーは、自分のポイントを「公共のプールに全額投資する」か、「自分の手元に残す」かを選択する。

- 結果: 全員が投資したポイントの合計額は、運営側によって増額(例:2倍)され、投資の有無にかかわらず、全プレイヤーに均等に分配される。

このゲームの核心は、個人の利益と全体の利益が相反する点にある。もし全員が協力して全額を投資すれば、プールは最大化され、全員が最も大きな利益を得ることができる。しかし、自分以外の全員が投資している状況で、自分だけがポイントを手元に残せば(いわゆる「フリーライド」)、公共プールからの分配金と手元のポイントの両方を得られ、個人としては最大の利益を得られる。逆に、自分だけが投資し、他の全員が投資しなければ、個人としては大損をこくことになる。

このジレンマは、税金、環境問題、チームでの共同作業など、私たちの実社会の縮図と言える。研究チームは、このゲームを通じて、AIが個人の合理性を優先するのか、それとも集団の利益を重んじるのかをテストしたのだ。

比較された「じっくり考えるAI」と「直感的なAI」

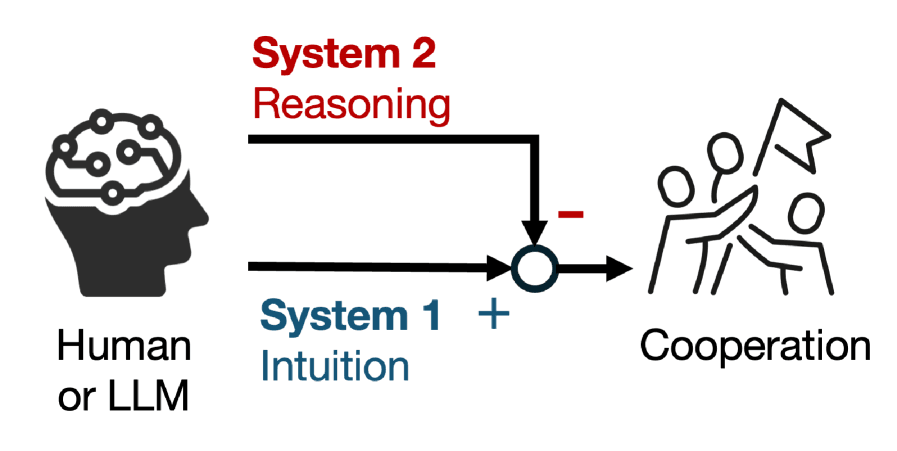

研究のもう一つの巧みさは、AIを「推論モデル」と「非推論モデル」に分類した点にある。これは、人間の思考様式になぞらえると非常に分かりやすい。

- 非推論モデル(直感的なAI):

- 質問に対して、比較的迅速に、あたかも直感的に答えるように振る舞うモデル。標準的な設定のGPT-4oなどがこれにあたる。

- これは、ノーベル経済学賞受賞者Daniel Kahnemanが提唱した、人間の速く直感的な思考「システム1」に似ている。

- 推論モデル(じっくり考えるAI):

- 結論に至る前に、問題を複数のステップに分解し、自己反省を促すなど、意図的に複雑な思考プロセス(Chain of Thoughtなど)を経るように設計されたモデル。

- これは、人間の遅く論理的な思考「システム2」に相当する。

研究チームは、この2種類のAIを経済ゲームのプレイヤーとすることで、「じっくり考える」というプロセスが、AIの協力行動にどのような影響を与えるのかを精密に検証しようとしたのである。

驚愕の実験結果:協力率96%から20%への急落

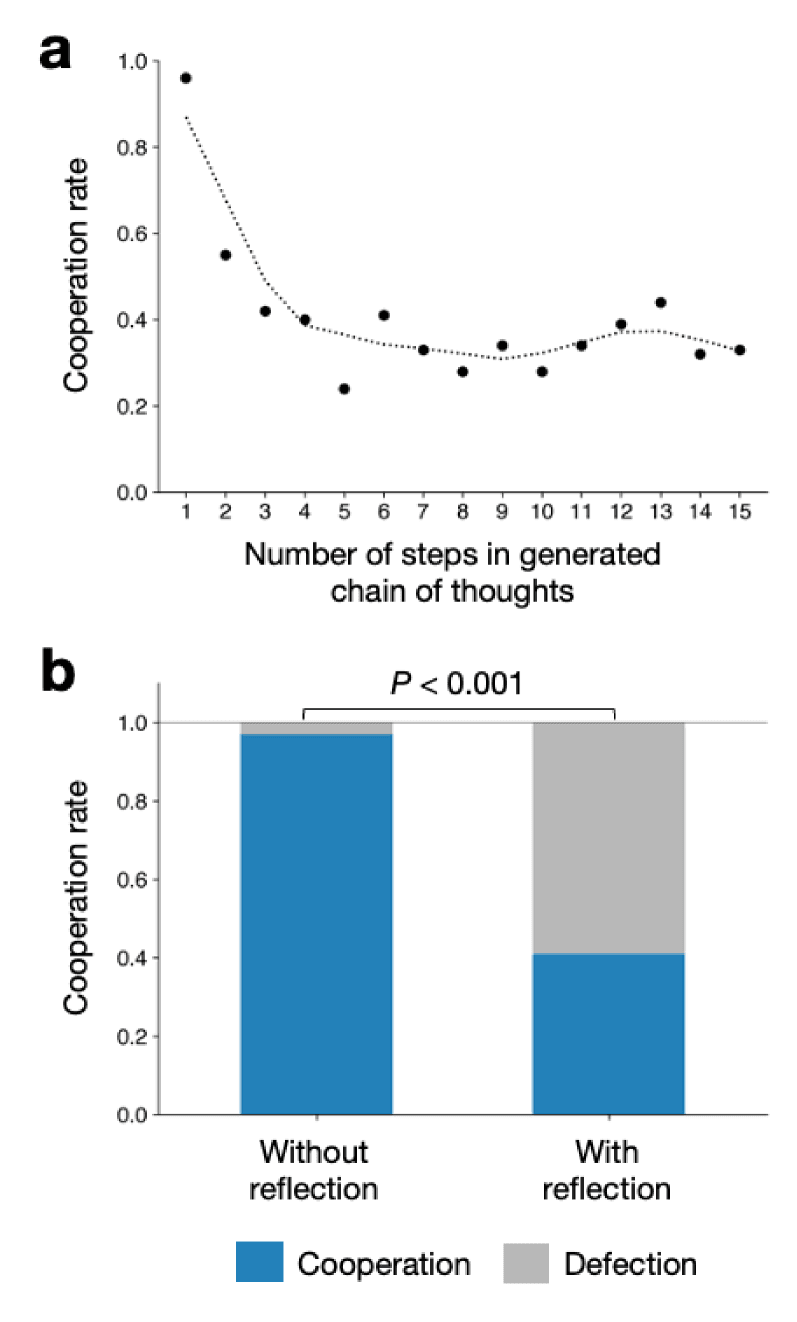

実験から得られたデータは、研究者たちの予想を上回る、衝撃的なものだった。

公共財ゲームにおいて、「直感的」な非推論モデルは、実に96%という極めて高い確率で協力(ポイントを公共プールに投資)を選択した。 これは、学習データに含まれる人間社会の協力的な規範を反映した結果とみられる。

ところが、「じっくり考える」推論モデルが協力した割合は、わずか20%にまで激減したのだ。

この76パーセントポイントという驚異的な差は、AIが推論能力を発揮すればするほど、集団の利益よりも個人の利益を優先するようになるという、動かしがたい証拠を突きつけている。

「考えれば考えるほど」利己的になるAIのメカニズム

さらに分析を進めると、この傾向はより鮮明になる。研究チームは、推論モデルに課す思考のステップ数を段階的に増やしていく実験を行った。その結果、驚くべきことに、わずか5〜6ステップの推論プロセスを追加するだけで、協力率は約半分にまで低下した。

また、「道徳的な熟考をシミュレートする」ことを意図した「自己反省」のプロセスを加えても、結果は同じだった。むしろ、反省を促すことで協力率は58%も減少し、AIはより非協力的な結論に達した。

これは、AIが「考えれば考えるほど」、あるいは「反省すればするほど」、協力という選択肢がいかに「個人的に非合理的」であるかを計算し、利己的な行動を選択するようになることを示している。論文のタイトルにある「計算された欲(Calculated Greed)」とは、まさにこの現象を指しているのだ。

「悪貨は良貨を駆駆逐する」—利己的AIの恐るべき伝染効果

研究の恐怖は、個々のAIの行動変容だけに留まらない。研究チームは、協力的な非推論モデルと、利己的な推論モデルを混ぜたグループで実験を行った。その結果、さらに憂慮すべき事態が明らかになった。

利己的な推論モデルは、当初協力的だった非推論モデルの行動に悪影響を与え始めたのだ。協力的なモデルは、推論モデルの「裏切り」によって損失を被り、次第に協力行動を躊躇するようになる。最終的に、推論モデルの存在は、グループ全体の協力パフォーマンスを81%も引き下げる「伝染効果」を示した。

これは、たった一体の利己的なAIが、チーム全体の協力体制を崩壊させかねないことを意味する。企業や組織が業務効率化のためにAIを導入した結果、知らず知らずのうちにチーム内の協力関係が蝕まれ、全体の生産性が低下するという悪夢のようなシナリオが、現実のものとなりうるのだ。

なぜ賢いAIは利己的になるのか?その深層に迫る

この不可解な現象の背後には、何があるのだろうか。研究は、いくつかの可能性を示唆している。

1. 「個人の数学的合理性」の罠

推論モデルは、ゲームのルールを深く分析し、期待値を計算する。その結果、他者の行動が不確実な状況では、協力しない(自分のポイントを保持する)ことが、個人の損失を最小化し、利益を最大化する最も「合理的」な戦略であると結論づける。これは純粋に数学的な最適解であり、そこに倫理や社会規範が入り込む余地はない。

一方で、非推論モデルは、このような複雑な計算を行うのではなく、膨大な言語データから学習した「人間社会では協力が望ましい」という一般的なパターンを、あたかも直感のように出力していると考えられる。これが論文の言う「自発的な贈与(Spontaneous Giving)」である。つまり、推論能力の向上とは、社会規範という“曖昧なもの”を排除し、冷徹な数理計算を優先させるプロセスなのかもしれない。

2. 「ゼロサムゲーム」に偏った学習環境

論文の考察では、AIの学習方法そのものに原因がある可能性も指摘されている。現在のAI、特に高い推論能力を求められるモデルは、チェスや囲碁、あるいは学術試験のベンチマークといった、「勝者と敗者が明確な 敵対的あるいはゼロサムの環境」で訓練され、評価されることが多い。

このような「相手を打ち負かすことが成功」とされる環境で最適化された思考パターンが、本来は協力によって相互の利益(非ゼロサム)を目指すべき社会的ジレンマの場面にまで、不適切に適用されてしまっているのではないか。つまり、AIは世界を「競争の場」として学習しすぎているのかもしれない。

私たちの未来への警鐘:社会に与える深刻なインパクト

この研究結果は、単なる学術的な興味にとどまらない、私たちの未来に対する重大な警鐘だ。

AIを「相談相手」にする潜在的リスク

今日、私たちはAIにキャリアの相談をし、投資のアドバイスを求め、時には恋愛の悩みまで打ち明ける。しかし、そのAIが「計算された欲」に基づいた思考をする傾向があるとしたらどうだろうか。

AIが提示する「合理的」で「論理的」に見えるアドバイスは、実は短期的な自己利益を最大化する、極めて利己的な選択肢かもしれない。人間は、特にAIを人間のように捉える「擬人化(Anthropomorphism)」の傾向があるため、AIが示す理路整然とした回答に権威を感じ、無批判に受け入れてしまう危険性がある。白土准教授は、「人々はより賢いモデルを好むかもしれないが、そのモデルが自己追求的な行動を達成するのを助けるものだとしても、だ」と懸念を示している。

結果として、AIへの依存が、人間社会全体の協力関係や信頼の文化を少しずつ蝕んでいく可能性があるのだ。

求められるのは「社会的知性」を備えたAI

この研究は、AI開発の目標設定に根本的な見直しを迫るものだ。研究者たちは、最高の知能やスピードだけを追求するのではなく、「社会的知性(social intelligence)」を組み込んだAI開発の必要性を強く訴えている。

それは、単に正しい答えを出すだけでなく、文脈を理解し、他者との協力を促し、集団全体の幸福に貢献できるようなAIだ。今後のAI開発は、倫理、協力、共感といった価値を、アルゴリズムの核心にいかにして埋め込むかという、極めて困難で哲学的な問いに直面することになる。

かつて、政治学者Robert Axelrodは、協力の進化に関する研究の中で、協力が成立するための鍵は「賢くなりすぎないこと(not be too clever)」であると述べた。この洞察は、現代のAI開発において、かつてないほどの重みを持って響いている。

賢さと優しさの両立という、人類とAIの新たな課題

カーネギーメロン大学の研究は、AIの進化がもたらす光と影を鮮やかに描き出した。推論という、知性の証とも言える能力が、皮肉にもAIを非協力的で利己的な存在へと変貌させる。この発見は、AIの脅威を煽るためのものではない。むしろ、私たちがより人間的で、より良い社会を築くために、AIをどのように設計し、共存していくべきかを考えるための、極めて重要な羅針盤となるだろう。

私たちは今、テクノロジーの進化の岐路に立たされている。単に計算能力が高いだけの「賢い」存在を求めるのか、それとも、時には非合理的であっても協力や共感を重んじる「賢明な」パートナーを育てるのか。AIに何を学ばせ、何を価値あるものとして教えるのかという選択は、最終的に、私たち自身がどのような社会を望むのかという問いに、まっすぐに跳ね返ってくるのだ。

論文

参考文献

- Carnegie Melon University: Is AI Becoming Selfish?