Alibaba Cloudは、AIモデルの推論処理に要するNVIDIA製GPUの数を82%削減したと主張する、新しいコンピューティングプーリングシステム「Aegaeon」を発表した。この技術は、AIの運用コスト構造を根底から揺るがし、米国の半導体輸出規制に直面する中国IT大手にとって朗報となるのだろうか。

AI業界を揺るがす「82%削減」の衝撃

今回の発表は、韓国ソウルで開催されたオペレーティングシステムの国際会議「SOSP 2025」で行われた。Alibaba Cloudと北京大学の研究者が共同で発表した論文によれば、Aegaeonシステムは3ヶ月以上にわたるベータテストでその驚異的な効率性を証明したという。

具体的には、Alibaba Cloudのモデルマーケットプレイスで、最大720億パラメータを持つ数十種類のLLM(大規模言語モデル)を稼働させるために、従来は1,192基必要だったNVIDIAのGPU「H20」を、わずか213基で運用可能にした。実に82%ものリソース削減である。

この成果は、単なる実験室レベルの成功ではない。すでにAegaeonはAlibaba Cloudのサービスで正式に展開されており、クラウド上でAIを利用する企業のコストを劇的に下げる可能性を示唆している。

なぜGPUはこれほどまでに非効率だったのか?

この「82%」という数字の重要性を理解するには、まず従来のAI推論インフラが抱える根本的な非効率性を知る必要がある。

AI推論における「サイロ化」問題

これまで、クラウド上でLLMのようなAIモデルを運用する際の標準的な手法は、特定のモデルに特定のGPU(群)を常時割り当てる「専用インスタンス」方式だった。これは、人気があり常にリクエストが殺到するモデルには有効だが、大半のモデルはそうではない。

Alibaba Cloudが自社の運用データで明らかにしたところによれば、プラットフォーム上に存在するモデルの90%以上は、利用頻度が極めて低い「ロングテール」に属する。これらのモデルのために確保されたGPU群は、ほとんどの時間、次のリクエストを待つだけの遊休状態に陥っていた。論文では、全GPUの17.7%が、総リクエスト数のわずか1.35%を処理するためだけに割り当てられていたという、驚くべきデータが示されている。 これは、膨大な計算能力を持つ高価なプロセッサが、ほとんど仕事もせずに電力を消費し続けていることを意味する。

既存の効率化技術の限界

もちろん、この問題に対して技術者たちが手をこまねいていたわけではない。これまでにもいくつかの効率化手法が試みられてきた。

一つは、複数のモデルを一つのGPUに同居させる「多重化(Multiplexing)」だ。しかし、この手法はGPUに搭載されているメモリ容量に大きく制約される。LLMは巨大なメモリを消費するため、一つのGPUに乗せられるモデルはせいぜい2つか3つが限界であり、根本的な解決には至らなかった。

もう一つが、必要に応じてモデルをGPUにロードし、不要になったらアンロードする「オートスケーリング」だ。これはリソース効率を上げる有望なアプローチだが、従来の手法は「リクエスト単位」でしか動作しなかった。つまり、一度リクエストの処理が始まると、それが完了するまでそのGPUは他のモデルのために使えない。

この方式は、「ヘッドオブライン・ブロッキング(Head-of-Line Blocking)」と呼ばれる深刻な問題を引き起こす。例えば、あるGPUが非常に時間のかかる長い文章の生成リクエストを処理している最中に、別のモデルへの短いリクエストが来たとしよう。後者のリクエストは、前の長い処理が終わるまで、ただひたすら待たされることになる。この待ち時間がサービス品質の低下を招くため、結局は余裕を持たせた数のGPUを確保せざるを得ず、効率化は頭打ちになっていた。

革命の中核技術「Aegaeon」の仕組みを徹底解剖

Aegaeonは、これらの従来技術が抱える課題を、全く異なるアプローチで解決する。その核心は「トークンレベル」のスケジューリングにある。

パラダイムシフトを呼ぶ「トークンレベル」のスケジューリング

LLMは、文章を一気に生成しているわけではない。「トークン」と呼ばれる単語や文字の断片を一つずつ、自己回帰的に生成している。Aegaeonは、従来のように一つの「リクエスト(文章全体)」が終わるのを待つのではなく、この「トークン」という極めて細かい単位でGPUの処理を管理し、モデルの切り替えを行う。

これは、コンピュータのCPUが行うマルチタスク処理に似ている。CPUは、驚異的な速さで複数のプログラムの処理を切り替えながら実行することで、あたかも同時に動いているかのように見せかけている。Aegaeonは、その概念をAI推論の世界に持ち込んだのだ。

あるモデルのトークンを一つ生成したら、即座にGPUを別のモデルに割り当て、そのモデルのトークンを一つ生成する。これを高速で繰り返すことで、一つのGPUが同時に最大7つもの異なるLLMを並行して動かすことができる。 これにより、前述の「ヘッドオブライン・ブロッキング」は解消され、GPUは常に何らかのモデルのトークンを生成し続ける、極めて高効率な状態が維持されるのだ。

理論を現実に変えた技術的ブレークスルー

この「トークンレベルでのモデル切り替え」というアイデアは、言うは易く行うは難しだ。モデルの切り替え自体に時間がかかっていては、かえって非効率になる。Aegaeonの真の革新性は、この切り替え(プリエンプティブ・オートスケーリング)をほぼゼロコストで実現する、フルスタックでの最適化にある。論文で詳細に述べられている主な技術要素は以下の通りだ。

- 1. 分離(Disaggregation)スケジューリング

LLMの推論処理は、実は性質の異なる二つのフェーズから成る。ユーザーからの入力(プロンプト)を読み込む「Prefill」と、応答トークンを一つずつ生成する「Decoding」だ。Aegaeonは、この二つの処理を異なるGPUインスタンス群に分離し、それぞれの特性に合わせた最適なスケジューリング戦略を適用する。これにより、システム全体の処理の流れを平準化し、ボトルネックの発生を防ぐ。 - 2. 超高速なモデル切り替え

トークンレベルで切り替えるには、モデルのロードやアンロード、つまりGPUメモリへの展開と退避が瞬時に行えなければならない。Aegaeonは、推論エンジンのコンポーネントを可能な限り再利用し、メモリ管理を徹底的に効率化することで、モデル切り替えに伴うオーバーヘッドを97%も削減した。 - 3. 細粒度のKVキャッシュ同期

モデルを切り替える際には、「KVキャッシュ」と呼ばれる、それまでの計算結果(文脈情報)を保持したデータも一緒に移動させる必要がある。Aegaeonは、このKVキャッシュの転送をGPUの計算処理と完全に非同期化・並列化する。これにより、GPUは転送の完了を待つことなく次の計算に取り掛かることができ、待ち時間を極限まで削減している。

これらの技術的ブレークスルーが組み合わさることで、Aegaeonは理論上のアイデアを、現実世界で機能する堅牢なシステムへと昇華させているのである。

Aegaeonがもたらす地殻変動

この技術がもたらす影響は、単なる一企業のコスト削減に留まらない。AI業界全体、ひいては世界のテクノロジー覇権争いにまで波及する可能性を秘めている。

NVIDIAの「牙城」は崩れるのか?

短期的には、NVIDIAにとってAegaeonは逆風となりうる。同社の収益の柱は、Alibabaのような巨大クラウド企業に販売するデータセンター向けAI GPUだ。その需要が「82%減少」する可能性が示されたことは、市場に動揺を与えかねない。NVIDIAの株価はAIブームの象徴として高騰を続けてきたが、その前提となる「GPUへの飽くなき需要」に疑問符が投げかけられた形だ。

しかし、筆者は長期的な視点も必要だと考える。Aegaeonのような技術がAIの推論コストを劇的に下げることは、これまでコストの壁で実現できなかった新たなAIアプリケーションやサービスの創出を促すだろう。AIの利用が社会全体に広がれば、最終的にはより多くのGPUが必要となる時代が来るかもしれない。AI市場のパイそのものを拡大させる触媒として機能するならば、長期的にはNVIDIAにとっても追い風となりうる、という見方もできる。

米国の輸出規制を無力化する「秘密兵器」

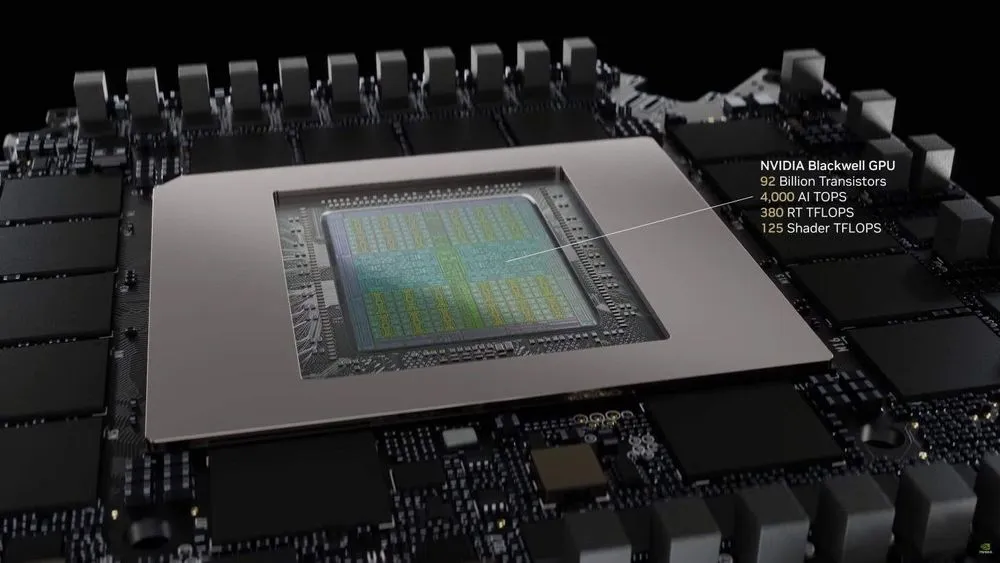

Aegaeonが持つもう一つの重要な側面は、地政学的な意味合いだ。米国は安全保障上の理由から、NVIDIAの最先端AIチップの中国向け輸出を厳しく規制している。Alibabaのテストで使用された「H20」も、この規制に対応するために性能を調整されたモデルである。

このような状況下で、Aegaeonは中国企業にとって「秘密兵器」とも言える価値を持つ。限られた、あるいは性能が劣るGPUしか手に入らないとしても、そのリソースを極限まで効率的に利用することで、実質的な計算能力を数倍に高めることができるからだ。これは、物理的なハードウェアの制約を、ソフトウェアの革新によって乗り越えようとする試みであり、米国の規制の効果を部分的に相殺する力を持つ。

AI民主化への道筋

AIの運用コスト、特に推論コストの高さは、巨大IT企業以外のプレイヤーにとって大きな参入障壁となってきた。Aegaeonのような技術が普及すれば、スタートアップや大学などの研究機関でも、より少ない資金で大規模なAIサービスを運用できるようになる。これは、AI技術の「民主化」を加速させ、イノベーションの裾野を広げる上で非常に重要な一歩となるだろう。

筆者の視点:技術的合理性の先に見えるもの

このAegaeonの登場は、分散コンピューティングにおけるリソーススケジューリング技術の進化のマイルストーンとして捉えることが出来る。これは単なるコスト削減ツールではない。膨大な計算機リソースをいかに無駄なく、かつ柔軟に分配するかという、クラウドコンピューティングの根源的なテーマに対する、現時点での一つの理想的な回答だ。

ただし、この技術がAlibabaの高度に統合されたインフラ環境下で最適化されている可能性は考慮すべきだろう。他のクラウドプロバイダーやオンプレミス環境で、同レベルの効率性を再現できるかは未知数だ。とはいえ、Aegaeonが示した方向性、すなわち「ハードウェアの限界をソフトウェアで超える」という思想は、今後のAIインフラ開発の潮流となることは間違いない。AIの能力が指数関数的に向上する中で、それを支えるインフラもまた、同様の進化を遂げなければならない。Aegaeonは、その長く険しい道のりにおける、確かな一歩を刻んだと言えるだろう。

Sources

- Computer King (X)