AIモデルの巨大化がデータセンターの物理的限界に達する中、Ciscoは業界に新たな地平を切り開く新チップ「Silicon One P200」と、それを搭載したルーター「Cisco 8223」を発表した。これは地理的に分散したデータセンター を単一の巨大な演算クラスターとして機能させる「スケールアクロス」という新概念を現実のものとするための一手だ。既にNVIDIA、Broadcomが先行するこの新市場で、Ciscoは独自の技術思想を武器に覇権を狙う。

AIの爆発的進化が迫る「壁」と新概念「スケールアクロス」

生成AIの進化は、その根幹を支える計算資源に未曾有の要求を突きつけている。OpenAIのGPTモデルの進化を例に取れば、その計算需要は指数関数的に増加しており、もはや単一のデータセンターで賄うことは物理的に不可能になりつつある。

問題は複合的だ。NVIDIAの最新GPUシステムでは1ラックあたりの消費電力が140キロワットに達し、将来的には1メガワットも視野に入る。これほどの電力を一箇所に集中させ、発生する熱を冷却することは極めて困難である。電力コストも地域によって大きく異なり、データセンターの立地は電力供給とコストに大きく依存する。

こうした制約から、サーバー単位の「スケールアップ」、サーバー数を増やす「スケールアウト」に続く第三の拡張戦略として「スケールアクロス (Scale Across)」という概念が必然的に生まれた。これは、物理的に離れた複数のデータセンターを、あたかも一つの巨大なコンピュータであるかのように、超広帯域かつ低遅延のネットワークで接続するアプローチだ。

CiscoでSilicon One開発を率いるシスコフェローのRakesh Chopra氏は、この新しいネットワークを従来のDCI(データセンター相互接続)とは明確に区別する。

「DCIは基本的にデータセンターとエンドユーザーを接続するもので、従来の広域網(WAN)を介します。私たちが今日話しているのは、データセンターをまたいでスケールアウトネットワークを接続する『スケールアクロス』の概念です。これは、高帯域幅のスケールアウトネットワークを取り込み、データセンターを橋渡しすることで、DCIよりもはるかに高い帯域幅を実現するものです。」

まさに、データセンターそのものがCPUソケット内のチップレットのように分割され、超高速インターコネクトで結ばれる。スケールアクロスネットワークは、その巨大な「Infinity Fabric」に相当すると言えるだろう。

Ciscoの回答:51.2T ASIC「P200」と8223ルーター

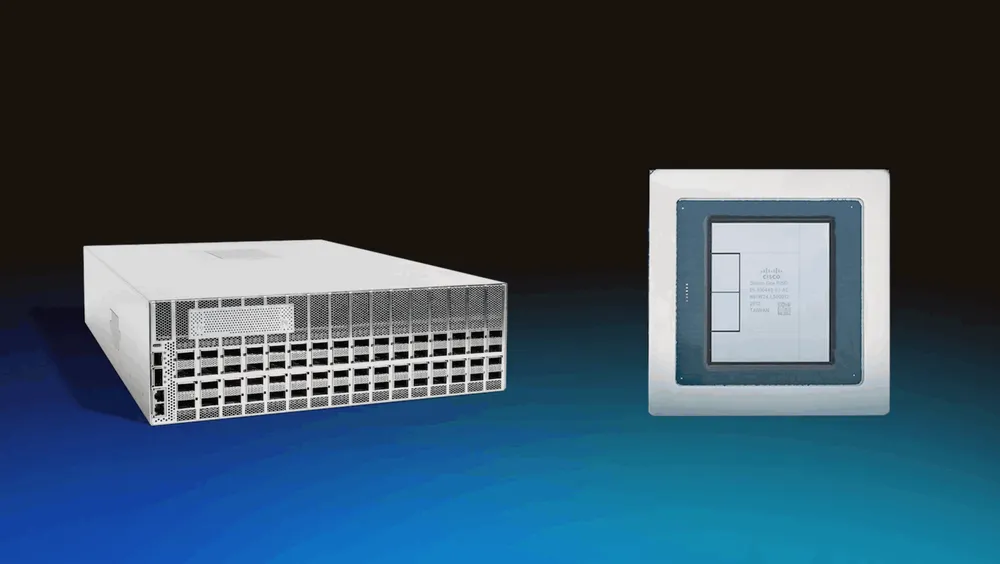

このスケールアクロス時代の要請に応えるべく、Ciscoが満を持して投入するのが、自社開発のルーティングASIC「Silicon One P200」と、それを搭載した「Cisco 8223」ルーターだ。そのスペックは、既存のネットワーク機器の常識を覆す。

驚異的な処理能力を1チップに凝縮

「Dark Pyramid」というコードネームで開発されたP200 ASICは、51.2Tbpsの総帯域幅を誇る。これは、2年前に発表された同帯域幅のモジュラーシャーシシステムが92個ものチップを必要としたのに対し、たった1つのチップで実現される。この集積度の飛躍的な向上が、消費電力と物理的スペースの大幅な削減をもたらした。

Silicon One P200の主な仕様:

- 総帯域幅: 51.2 Tbps (全二重)

- ポート構成: 64ポート x 800 Gbps

- パケット処理能力: 200億パケット/秒以上

- ルーティング検索: 4,300億回/秒以上

- ディープバッファ: 16GB (HBM3メモリ)

このチップを心臓部に持つ「Cisco 8223」ルーターは、3Uというコンパクトな筐体でこの性能を実現し、消費電力は従来世代の同等性能のシステムと比較して65%も削減されている。

数百万GPUを束ねる超巨大ファブリック

Cisco 8223は、800Gbpsのコヒーレント光学技術と組み合わせることで、最大1,000km離れたデータセンター間を接続する能力を持つ。 さらに、これらのルーターを複数組み合わせることで、理論上は驚異的な帯域幅を構築可能だ。

- 2層トポロジー: 最大13 Pbps (ペタビット/秒)

- 3層トポロジー: 最大3 Ebps (エクサビット/秒)

3エクサビット/秒という帯域幅は、数百万規模のGPUを含む巨大なAIトレーニングクラスターを単一のファブリックとして運用することを可能にする。これは、現在最大級とされるAIクラスターのネットワーク要件を遥かに凌駕するスケールである。

巨人が鎬を削る新市場:NVIDIA、Broadcomとの三つ巴

Ciscoの参入により、スケールアクロス市場は本格的な競争時代に突入した。先行するNVIDIAとBroadcomも、それぞれ強力な製品を市場に投入している。

- Broadcom「Jericho4」: 2025年8月に発表された51.2Tbpsのスイッチ/ルーターチップ。ディープパケットバッファを搭載し、最大100km離れたデータセンターを100Pbps以上の速度で接続可能と謳う。

- NVIDIA「Spectrum-XGS」: GPU最大手NVIDIAが投入するスイッチ製品群。詳細はまだ少ないが、大手GPUクラウドプロバイダーのCoreWeaveが採用を表明しており、AIインフラ全体を掌握しようとする同社の野心が見える。

この競争の中で、Ciscoは独自の技術的アプローチで差別化を図る。それが「ディープバッファ」の積極的な採用である。

Ciscoの賭け:「ディープバッファ」はAIの福音か、それとも…

Cisco P200のアーキテクチャで最も注目すべき点は、16GBもの大容量HBMメモリによる「ディープバッファ」の実装だ。これは、競合、特にNVIDIAが浅いバッファ(シャローバッファ)による低遅延を重視するアプローチとは一線を画す。

従来、AIの分散学習ネットワークにおいて、ディープバッファは「悪」と見なされる傾向にあった。バッファが深く、一度データで満たされると、それを排出するまでに時間がかかり、通信に遅延の揺らぎ(ジッター)を生む。これがGPU間の同期を阻害し、トレーニング性能を低下させると考えられてきたからだ(バッファブロート問題)。

しかし、Ciscoはこの通説に真っ向から反論する。Chopra氏の主張は明快だ。「問題はディープバッファの存在そのものではなく、バッファを溢れさせるほどの輻輳(ふくそう)が発生することにある」と彼は言う。AIのワークロードは通信パターンが確定的で予測可能であるため、高度な輻輳管理とロードバランシングによって、そもそもバッファが深く満たされる状況を回避できるというのだ。

さらに彼は、AIワークロードの同期的性質を指摘する。

「AIワークロードは、ネットワークを通過する最も遅いパスの完了を待ちます。つまり、性能に影響するのは最大伝送時間ではなく、平均伝送時間なのです」

むしろ、長距離のスケールアクロスネットワークにおいて致命的となるのは、パケットロスである。たった一つのパケットを失っただけで、AIの学習プロセスは数時間、場合によっては数日前のチェックポイントまで巻き戻る(ロールバック)必要があり、膨大な計算資源と時間を無駄にする。ディープバッファは、突発的なトラフィックのバースト(マイクロバースト)を吸収し、この致命的なパケットロスを防ぐための「保険」として機能する。この信頼性こそが、数ヶ月に及ぶ長大なAI学習を支える上で不可欠だというのがCiscoの主張だ。

実用化への視点と残された課題

この野心的な技術は、すでにクラウドの巨人たちの関心を集めている。MicrosoftのAzure Networking担当CVPであるDave Maltz氏は、「クラウドとAIの規模拡大には、バーストを吸収するためのより高速で多くのバッファリングを備えたネットワークが必要です。P200がこの分野で革新と選択肢を提供することを嬉しく思います」と述べ、Ciscoのアーキテクチャへの期待を示している。 Alibaba Cloudのネットワークインフラ責任者であるDennis Cai氏も、この技術がDCIネットワークの安定性、信頼性、拡張性を大幅に向上させるだろうと評価している。

ソフトウェアの柔軟性と未来を見据えたセキュリティ

Ciscoはハードウェアだけでなく、ソフトウェアの柔軟性にも配慮している。8223ルーターが最初にサポートするのは、業界標準のオープンソースネットワークOSであるSONiCとFBOSSだ。これは、自社のソフトウェアスタックを好むハイパースケーラーの要求に応えるための戦略的な選択である。Cisco独自のIOS XRは後日サポートされる予定で、これにより従来からの顧客層もカバーする。

セキュリティ面では、来るべき量子コンピュータ時代を見据え、耐量子暗号(PQC)アルゴリズムによる鍵管理や、シリコンレベルでの信頼の起点(Root of Trust)を実装。データの完全性を製造から運用まで保証する。

克服すべき「光速の壁」

一方で、物理法則という根本的な課題も残る。1,000km離れたデータセンター間では、光の速度が有限であるため、信号が片道に到達するだけで約5ミリ秒の遅延が発生する。これは送受信機や中継器での遅延を考慮しない理論上の最短時間だ。

この課題に対し、GoogleのDeepMindチームの研究がひとつの可能性を示している。モデルデータを圧縮して転送量を減らしたり、データセンター間の通信タイミングを戦略的にスケジューリングしたりすることで、遅延の影響をソフトウェア側で緩和できる可能性があるという。ハードウェアの進化とソフトウェアの工夫、その両輪がスケールアクロスを成功に導く鍵となるだろう。

データセンターの「チップレット化」が拓くAIの未来

CiscoのP200と8223ルーターの登場は、単なる新製品発表に留まらない。それは、AIの進化がインフラのあり方を根本から変え、「データセンター」という単位そのものが、より大きな計算機を構成する「部品(チップレット)」へと変貌していく時代の到来を告げるものだ。

NVIDIAが低遅延を追求し、Ciscoが信頼性を重視するなど、技術的なアプローチには違いが見られる。しかし、いずれも「単一データセンターの壁を越える」という共通の目標に向かっている。この健全な競争は、AIインフラの選択肢を広げ、イノベーションを加速させるだろう。

AIが作り出す未来は、それを支えるネットワークの力によって規定される。Ciscoが投じたこの一石は、データセンターの境界線を溶かし、AIの可能性をさらに広大な領域へと解き放つことになるのかもしれない。

Sources