Google I/O 2025で、アプリ開発プラットフォームFirebaseに新機能「Firebase AI Logic」の導入が発表された。これは、開発者がAI機能をアプリに組み込む際の障壁を低減し、AI時代における新たな開発体験を「バイブコーディング(Vibe Coding)」として提示するもので、アプリ開発の未来を大きく変える可能性を秘めたアップデートと言える。

Firebase AI Logic登場の背景:開発現場のAI統合ニーズに応える一手

GoogleがFirebase AI Logicを発表した背景には、アプリケーション開発におけるAI統合のニーズが急速に高まっている現状がある。GoogleのデベロッパーX担当バイスプレジデント兼ゼネラルマネージャーであるJeanine Banks氏は、SiliconANGLEのインタビューに対し、「約1年前には、プロの開発者でさえ、このような(AIを活用した)コーディング体験を望むとは想像していませんでした。しかし、それは爆発的に拡大しました」と語っている。この言葉は、開発現場の空気感が急速に変化していることを示唆しているのではないだろうか。

この「バイブコーディング(Vibe Coding)」とも呼ばれる、直感的でAIアシストによるソフトウェア作成手法は、従来の行単位のコーディングとは一線を画す。Banks氏によれば、Firebase StudioへのAI支援機能の追加は、コードのパフォーマンス、保守性、セキュリティを確保し、ベストプラクティスを遵守するための重要な要素も含まれているという。単に「楽になる」だけでなく、品質も担保しようというGoogleの意志が感じられる。

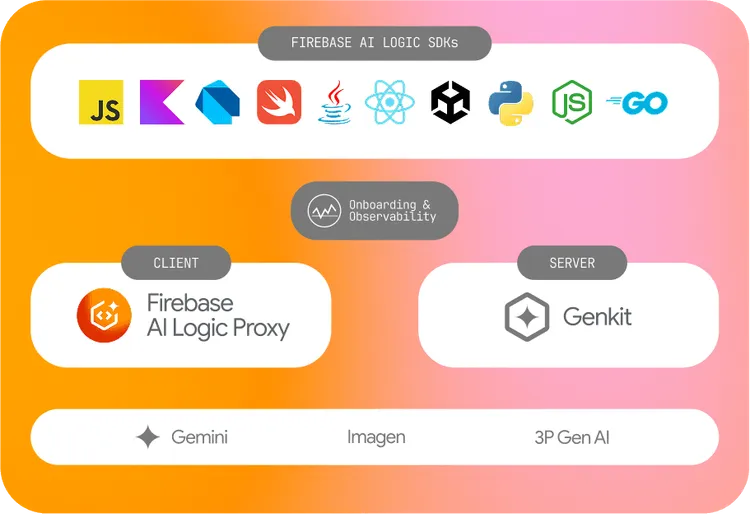

Firebase AI Logicは、昨年発表された「Vertex AI in Firebase」の進化形と位置づけられる。Googleは今年、サーバーサイドでGeminiや他のモデルを使用するための「Genkitフレームワーク」も発表しており、Firebase AI Logicはこれらのツールを統合し、開発者がクライアントサイド、サーバーサイドを問わず、より容易にAIをアプリに組み込めるようにする「ワンストップショップ」を目指している、とBanks氏は強調する。この「ワンストップショップ」という表現は、開発者にとって必要なものが一箇所に集約される利便性を端的に表している。

Firebase AI Logicの核心:開発者にもたらされる5つの革新的メリット

Firebase AI Logicは、開発者にとって多くのメリットをもたらす。その中でも特に注目すべき5つのポイントを見ていこう。これらは、日々の開発業務を大きく変える可能性を秘めている。

1. Gemini APIへのダイレクトアクセス:最新AIモデルをあなたのアプリに

Firebase AI Logicの最大の特長は、Googleの強力な生成AIモデルであるGemini APIへ、クライアントSDKを通じて直接アクセスできる点だ。これにより、開発者はバックエンドサーバーの構築や管理に煩わされることなく、テキスト生成、画像解析、動画・音声処理といった高度なAI機能をアプリに実装できる。

対応プラットフォームも幅広く、Android (Kotlin/Java)、iOS (Swift)、Web (JavaScript)、Flutter (Dart)、Unity (C#)、そしてReact Nativeと、主要な開発環境を網羅している(Firebase公式製品ページより)。これは、多様なスキルセットを持つ開発者が、慣れ親しんだ言語やフレームワークでAI開発に取り組めることを意味する。学習コストを抑えつつ、最先端の技術を活用できるのは大きな魅力と言えるだろう。

2. シンプルなセットアップと驚くほどの使いやすさ

Firebaseの伝統とも言える「開発者のための使いやすさ」は、Firebase AI Logicでも健在だ。Firebaseコンソール上で数クリックするだけでGemini APIへのアクセスを有効化でき、わずか数行のコードでAIコンテンツをアプリに組み込むことが可能になる(Firebase公式ドキュメント参照)。これは、特にリソースの限られたスタートアップや個人開発者にとって、大きな福音となるだろう。アイデアをすぐに形にできるスピード感は、競争の激しい現代において不可欠だ。

3. Firebase App Check連携による鉄壁のリソース保護

クライアントサイドから直接APIを呼び出す際の懸念の一つがセキュリティだ。Firebase AI Logicは、Firebase App Checkと統合することで、APIコールの保護レイヤーを追加できる(Firebase公式製品ページより)。これにより、不正なアクセスや悪意のあるリクエストから貴重なAPIリソースを守り、開発者は安心してクライアントSDKを利用できる。イノベーションを追求する上で、セキュリティは決して無視できない要素である。

4. Cloud Storage for Firebaseとのシームレスな連携

画像や動画、音声ファイルなどを扱うマルチモーダルなAIアプリケーションでは、ファイルのアップロードと管理が重要になる。Firebase AI Logicは、Cloud Storage for Firebaseと連携し、これらのプロセスを効率化する。さらに、Firebaseセキュリティルールを利用すれば、ファイルへのアクセス権限をきめ細かく制御し、認証されたユーザーのみがアップロードされたコンテンツを扱えるように設定できる(Firebase公式製品ページより)。これにより、開発者はコンテンツ管理の負担を軽減し、コア機能の開発に集中できる。

5. Firebase Remote Configによる動的なモデル・プロンプト更新

AIモデルやプロンプトは、常に改善と最適化が求められる。Firebase AI Logicは、Firebase Remote Configと連携することで、アプリのフルアップデートをユーザーに強いることなく、プロンプトや利用するモデルのバージョンを動的に微調整し、配信できる(Firebase公式製品ページより)。これにより、迅速なイテレーションとユーザー体験の継続的な向上が可能になる。市場の変化に素早く対応できるアジリティは、現代のアプリ開発において極めて重要だ。

Firebase StudioもAIで進化:Figmaからのインポート、自動バックエンド構築

Google I/O 2025では、Firebase AI Logicと並び、開発環境であるFirebase StudioのAIによる機能強化も発表された。これは、開発者の生産性を飛躍的に向上させる可能性を秘めている。

- Figmaインポートサポート: ビジュアル開発プラットフォームBuilder.ioとの提携により、Figmaのデザインを直接Firebase Studioにインポート可能になった。インポート後は、Gemini AIチャットを使ってUIやコードを編集・拡張できる。デザインと開発の垣根が、また一つ低くなったと言えるだろう。

- バックエンド統合の強化: App Blueprint機能の一環として、Firebase StudioがUIスタイルなどから必要なデータベースや認証機能を検出し、Firebase AuthやCloud Firestoreのフックを提案。デプロイ時には、これらのバックエンドサービスを自動的にプロビジョニングする。これにより、バックエンド構築の手間が大幅に削減される。

- プロトタイプ機能の向上: アプリプロトタイプ内のプレースホルダー画像を、画像ライブラリから検索して高忠実度のビジュアルに簡単に置き換えられるようになった。また、App Prototypingエージェントがモバイルデバイスに最適化され、外出先でもプロトタイプの作成やイテレーションが容易になった。アイデアが閃いたその瞬間に、場所を選ばずに形にできるのは画期的だ。

Banks氏が言及した「バイブコーディング」のコンセプトは、これらのFirebase Studioの進化によって、より現実的なものとなるだろう。直感的な操作とAIによる支援で、コーディング経験の浅い開発者でもアイデアを迅速に形にできるようになる。これは、まさに開発体験の革新と言えるのではないだろうか。

変化する開発者の役割と、Firebaseが狙う「スイートスポット」

AIの進化は、開発者の役割にも変化を促している。Banks氏は、「3~5年前、開発者にどんなタイプかと尋ねると、『フロントエンド開発者』『モバイル開発者』『iOS開発者』『バックエンド開発者』といった答えが返ってきました。しかし今では、多くの開発者が自分を『AI開発者』『フルスタック開発者』、あるいは『フルスタックAI開発者』と答えるようになっています」と指摘する。

この開発者のアイデンティティの変化こそ、GoogleがFirebaseで「スイートスポット」を狙っている核心部分だろう。Firebaseは、フロントエンドからバックエンド、そしてAIまでをシームレスに繋ぎ、新しい時代の「フルスタックAI開発者」にとって最適なプラットフォームとなることを目指しているのではないだろうか。もはや、特定の領域の専門家であることだけが開発者の道ではないのかもしれない。

Firebase AI Logic SDK導入への第一歩:シンプルさが鍵

Firebase AI Logic SDKの導入は、驚くほどシンプルだ。公式ドキュメントによれば、基本的なステップは以下の通り。

- Firebaseプロジェクトのセットアップとアプリ接続: Firebaseコンソールでプロジェクトを作成または選択し、アプリを接続。Firebase AI Logicページでガイド付きワークフローに従い、APIプロバイダー(Gemini Developer APIまたはVertex AI Gemini API)を選択する。

- Gemini Developer API: 請求はオプションで、無料のSpark料金プランで利用開始可能。

- Vertex AI Gemini API: 請求が必須で、従量課金のBlaze料金プランが必要。

開発者はニーズと予算に応じて選択できる。

- SDKの追加: 各プラットフォーム(Android, iOS, Web, Flutter, Unityなど)に応じた手順で、Firebase AI Logicライブラリをプロジェクトに追加する。例えば、Web (JavaScript) の場合はnpmでfirebaseパッケージをインストールし、初期化コードに数行追加するだけだ。

// Firebase公式ドキュメントより引用・改変

import { initializeApp } from "firebase/app";

import { getAI, getGenerativeModel, GoogleAIBackend } from "firebase/ai";

// Firebaseプロジェクトの設定情報に置き換えてください

const firebaseConfig = { /* ... */ };

const firebaseApp = initializeApp(firebaseConfig);

// Gemini Developer APIバックエンドサービスを初期化

const ai = getAI(firebaseApp, { backend: new GoogleAIBackend() });

// ユースケースに合ったモデルでGenerativeModelインスタンスを作成

const model = getGenerativeModel(ai, { model: "gemini-2.0-flash" });- サービス初期化とモデルインスタンス作成: 上記コードのように、使用するAPIプロバイダーに応じてサービスを初期化し、ユースケースに合ったモデル(例: gemini-2.0-flash)を指定してGenerativeModelインスタンスを作成する。

- プロンプト送信と応答処理: 作成したモデルインスタンスのgenerateContent()メソッドなどを使ってプロンプトを送信し、モデルからの応答を処理する。

// Firebase公式ドキュメントより引用・改変

async function run() {

const prompt = "魔法のバックパックについての物語を書いてください。";

const result = await model.generateContent(prompt);

const response = result.response;

const text = response.text();

console.log(text);

}

run();このように、Firebase AI Logicは、複雑な設定やサーバーサイドの実装なしに、開発者が迅速にAI機能を試せる環境を提供する。この手軽さが、イノベーションの種を育む土壌となるだろう。

Firebase AI Logicで拓かれるアプリの可能性:多様なユースケース

Firebase AI LogicとGemini APIの組み合わせは、アプリ開発に無限の可能性をもたらす。公式ドキュメントで示されているユースケースの一部を紹介しよう。

- 高度なテキスト生成: ブログ記事、詩、コード、メールのドラフト作成など、様々なテキストコンテンツを生成。ストリーミング応答にも対応し、リアルタイム性の高いチャットボットなども構築可能。あなたのアプリが、ユーザーの創造性を刺激するかもしれない。

- マルチモーダル分析: 画像の内容説明、PDFからの情報抽出、動画のシーン解説、音声の文字起こしなど、テキスト以外のデータと組み合わせた高度なAI処理が実現する。これにより、よりリッチで直感的なユーザー体験を提供できる。

- インタラクティブなチャット体験: ユーザーとの自然な対話を通じて情報提供やタスク実行を行う、洗練されたチャットボットをアプリに組み込める。顧客サポートの自動化や、パーソナライズされた情報提供など、応用範囲は広い。

- 構造化データ生成: JSONなどの特定の形式でAIに出力させることで、他システムとの連携やデータ処理を効率化できる。これにより、AIを既存のワークフローにスムーズに組み込むことが可能になる。

- 画像生成 (Imagenモデル): テキストプロンプトから画像を生成するImagenモデルも利用可能(ImagenModelインスタンスを使用)。アプリ内でオリジナルの画像を動的に生成するといった、これまでにない体験を提供できるだろう。

- ライブAPIによるリアルタイム双方向通信: 音声を含む入出力をストリーミングで行い、よりダイナミックなAIインタラクションを実現。例えば、リアルタイム翻訳や音声アシスタント機能などが考えられる。

- 関数呼び出しによる外部連携: 生成AIモデルを外部のAPIや情報源と接続し、より実用的で広範なタスクに対応させる。AIがアプリの枠を超えて、現実世界の情報を活用できるようになる。

これらはほんの一例に過ぎない。プロンプトデザインの工夫、温度設定や最大出力トークンといったモデルパラメータの調整、そして有害な応答を避けるためのセーフティ設定などを駆使することで、開発者は自らのアイデアをかつてないほど自由に形にできるだろう。まさに、創造性が試される時代だ。

Firebase AI Logicが切り拓くアプリ開発の未来とGoogleの戦略

Firebase AI Logicの登場は、単なる技術的進歩以上の意味を持つと筆者は考えている。これは、アプリ開発の民主化をさらに加速させ、より多くの人々がAIの力を活用してイノベーションを生み出すための起爆剤となり得る。

「バイブコーディング」という言葉に象徴されるように、開発の敷居は下がり、アイデアを持つ人が専門的なコーディングスキルなしにプロトタイプを作成し、検証するサイクルが高速化するだろう。これは、ローコード/ノーコード開発の潮流とも合致し、ソフトウェア開発のあり方を根本から変える可能性がある。もはや、プログラミング言語の習得が、アイデア実現の唯一の道ではなくなるのかもしれない。

GoogleのAI戦略全体から見ても、Firebase AI Logicは重要なピースだ。Geminiという強力な基盤モデルを、Firebaseという広大な開発者エコシステムを通じて、アプリケーションレイヤーにまで浸透させる。これにより、GoogleはAI技術の普及と、AIを活用した新しいサービスやビジネスの創出を強力に後押ししようとしている。これは、GoogleがAI時代におけるプラットフォーマーとしての地位を確固たるものにしようとする戦略の一環とも言えるだろう。

開発者コミュニティにとっても、これは大きな変化の時だ。AIを「使う」側から、AIを「組み込んで価値を創造する」側へと、その役割がシフトしていく。Firebase AI Logicは、その移行をスムーズにし、開発者が新たなスキルを習得し、市場価値を高めるための強力なツールとなるだろう。変化を恐れず、新しい技術を積極的に取り入れる姿勢が、これからの開発者には求められる。

もちろん、課題がないわけではない。AI倫理、セキュリティ、そして生成AIの信頼性といった問題には、引き続き慎重な対応が求められる。しかし、Firebase AI Logicが示した方向性は、間違いなくアプリ開発の未来を明るく照らすものだ。

Sources