これまで我々が目にしてきた高品質なAI動画生成モデルは、いわば「映画」であった。テキストを入力し、数分から数十分待つと、息をのむような短編クリップが完成する。しかし、それは常に完成品を鑑賞する一方通行の体験だった。

これに対し、Metaとカリフォルニア大学バークレー校の研究チームが発表した新しいAIシステム「StreamDiT」が実現するのは、言わば動画生成による「ライブ放送」だ。単一の高性能GPU(NVIDIA H100)上で、512p解像度の動画を毎秒16フレーム(16 FPS)という実用的な速度で紡ぎ出すこの技術は、AIとのインタラクションを根本から変え、ゲーミングやインタラクティブメディアのコンテンツ制作を大きく変えるかもしれない。

「見る」から「対話する」へ:StreamDiTが拓く新次元

StreamDiTが提示する未来は、これまでの動画生成AIとは一線を画す。従来のモデルが動画全体を一度に計算し、完成後に再生する「オフライン生成」であったのに対し、StreamDiTはフレームを一つずつ、連続的に生成していく「ストリーミング生成」を可能にした。

論文と共に公開されたデモ映像は、その能力を雄弁に物語る。「サングラスをかけたコーギーが熱帯の島のビーチを歩く」というプロンプトからは、滑らかなカメラワークで延々と続く動画が生成され、「FPV(一人称視点ドローン)が水中郊外のカラフルなサンゴ礁の道を飛ぶ」という指示では、幻想的な光景が途切れることなく展開される。

これは単に長い動画が作れるという話ではない。最大の革新は、そのリアルタイム性とインタラクティブ性にある。例えば、生成中にプロンプトを「穏やかな湖」から「湖の上で爆発する花火」へと変更すると、動画の内容がシームレスに変化していく。これは、ユーザーの入力に応じて世界がリアルタイムに変化する、まさに「生きている世界」のシミュレーターと言えるだろう。研究チームが「ゲームエンジンのように機能する可能性がある」と述べるように、この技術は全く新しい形のインタラクティブなエンターテインメントを生み出す起爆剤となりうる。

さらに、既存の動画をリアルタイムで編集する「ビデオ・ツー・ビデオ」能力も実証された。デモでは、通りを走る豚の動画を入力し、「通りを歩く猫」というプロンプトを与えると、背景はそのままに、豚が自然な動きの猫へとリアルタイムで変換された。

リアルタイム生成の心臓部:その技術的ブレークスルー

では、StreamDiTはどのようにしてこの画期的なリアルタイムストリーミングを実現しているのだろうか。その核心には、いくつかの独創的な技術的ブレークスルーが存在する。

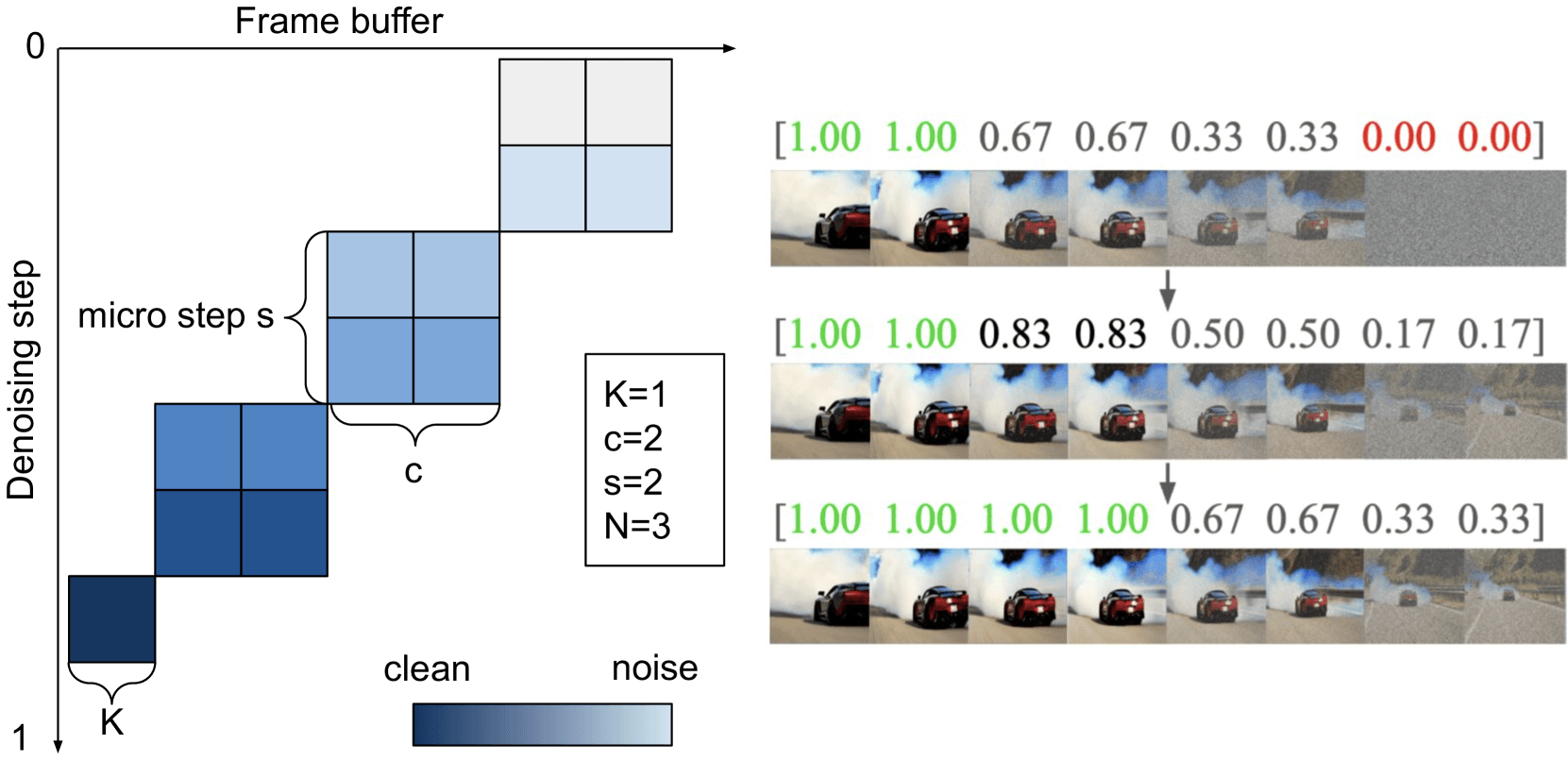

移動する作業台:「Buffered Flow Matching」という発想

StreamDiTの根幹をなすのが、「Buffered Flow Matching」という新しい学習・推論の枠組みだ。これを理解するために、ベルトコンベアの上で絵を完成させていく職人の姿を想像してみよう。

- バッファ(Buffer): 職人の前には、複数のキャンバスが乗った「作業台(バッファ)」がある。

- ノイズとリファイン: コンベアの始点では、ランダムなノイズだけのキャンバスが置かれる。職人は作業台の上にある全てのキャンバスに少しずつ手を入れて、徐々に絵を完成に近づけていく。

- ストリーミング: 絵が一つ完成すると、それはコンベアの終点から送り出され(出力)、始点には新しいノイズのキャンバスが補充される。

この「移動するバッファ」の仕組みにより、常に一部分を処理しながら、完成した部分を逐次出力していく連続的なプロセスが可能になる。これが、StreamDiTにおけるストリーミング生成の基本原理である。研究チームは、このバッファを「チャンク」と呼ばれるいくつかのフレームの塊に分割し、効率的に処理する設計を考案した。

柔軟性を生む「混合学習」と効率化の鍵「ウィンドウアテンション」

ただバッファを導入するだけでは、高品質で柔軟な生成は難しい。StreamDiTの賢さは、その学習方法とアーキテクチャの工夫にある。

- 混合学習(Mixed Training): モデルを訓練する際、研究チームは1フレームずつ処理する小さなチャンクから、16フレームを一度に処理する大きなチャンクまで、様々なサイズのチャンクを混ぜて学習させた。これは、様々な長さやスタイルの動画制作を同時に練習させるようなものだ。この「混合学習」により、モデルは特定の生成方法に過学習することなく、多様な状況に柔軟に対応できる汎用性を獲得した。

- ウィンドウアテンション(Window Attention): 通常の動画生成モデル(Transformerベース)では、動画内の一つのピクセルが他の全てのピクセルとの関係性を計算するため、計算量が膨大になる。StreamDiTは、これを効率化するために「ウィンドウアテンション」を採用した。これは、各ピクセルが全体を一度に見るのではなく、まず自分の周辺の「窓(ウィンドウ)」の中だけで情報を交換する仕組みだ。そして、層を重ねるごとにこの窓を少しずつずらしていくことで、結果的に情報が全体に行き渡る。これにより、計算効率を大幅に向上させつつ、動画としての一貫性を保つことに成功している。

128から8へ:リアルタイム化を実現した「専用蒸留技術」

そして、リアルタイム性能を実現するための最後の決め手が「蒸留(Distillation)」だ。これは、巨大で動作が重い「教師モデル」の知識を、より小さく軽量な「生徒モデル」に凝縮して教え込む技術である。

StreamDiTでは、この蒸留を独自にカスタマイズ。元々、高品質な1フレームを生成するためには128回の計算ステップ(サンプリングステップ)が必要だった。研究チームは、この128ステップの複雑な処理を、わずか8ステップで模倣できる生徒モデルを蒸留によって作り出した。

計算量を実に1/16に削減したこの技術こそが、16 FPSというリアルタイム性能を達成するための最後のピースとなったのだ。

性能を客観データで見る:従来手法を凌駕する「動き」の表現力

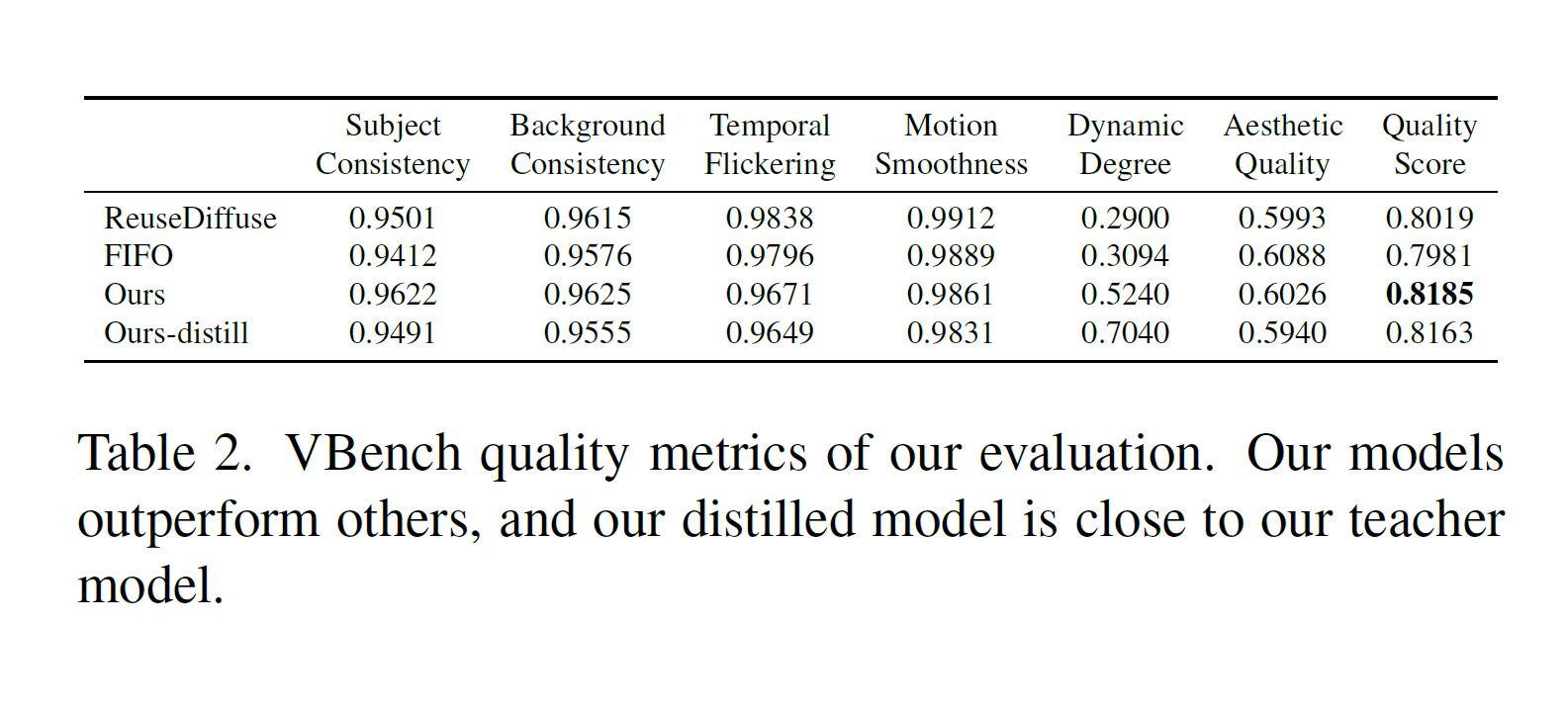

StreamDiTの優位性は、客観的なデータによっても裏付けられている。研究チームは、既存のストリーミング向け手法である「ReuseDiffuse」や「FIFO-Diffusion」と同じ土台(ベースモデル)で比較実験を行った。

VBenchと呼ばれる動画品質評価ベンチマークを用いた定量評価(論文 Table 2)では、多くの指標でStreamDiTが優位だったが、特に差が顕著だったのが「Dynamic Degree(動きの度合い)」である。既存手法が静的なコンテンツを生成しがちだったのに対し、StreamDiTは遥かにダイナミックで動きのある動画を生成できることが示された。

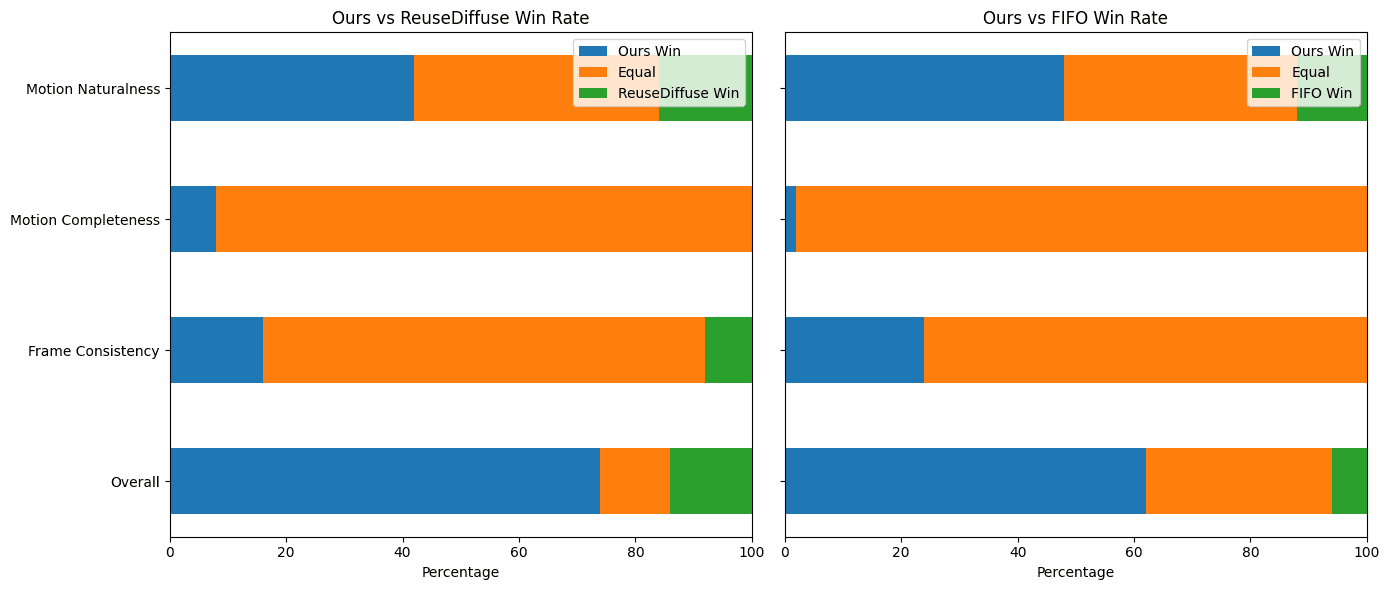

さらに、人間による評価(下グラフ)では、その差はより明確になった。「総合的な品質」「フレーム間の一貫性」「動きの完全性」「動きの自然さ」といった全ての評価項目で、StreamDiTは競合手法を圧倒。これは、技術的な優位性だけでなく、ユーザーが実際に感じる「質」の高さが卓越していることを意味する。

無限の可能性と残された課題

StreamDiTは、リアルタイム生成以外にも様々な応用可能性を示している。

- 無限ストリーミング: 5分間にわたる長尺動画を安定して生成し、理論上は無限に動画をストリーミングできる可能性を示した。

- インタラクティブな物語生成: ユーザーが次々と新しいプロンプトを与えることで、物語の展開をリアルタイムに操作できる。

- 大規模モデルへの応用: チームは、より巨大な300億(30B)パラメータモデルでも実験を行った。このモデルはリアルタイム性能こそないものの、息をのむほど高品質な動画を生成しており、StreamDiTのアプローチが将来的にさらに大規模で高性能なモデルへスケールアップ可能であることを示唆している。

一方で、この画期的な技術にもまだ課題は残されている。

- 長期記憶の欠如: StreamDiTの「記憶」は、バッファ内のフレームに限られる。そのため、例えばカメラが一周して元の場所に戻ってきた際に、以前の背景を覚えていないといった、長期的な一貫性の問題が発生しうる。

- チャンク間の「継ぎ目」: 潜在空間(AIが内部でデータを扱う空間)では滑らかに繋がっていても、最終的な映像にデコードする際に、チャンクの境界でわずかなちらつきや「継ぎ目」が見えることがある。

研究チームはこれらの課題を認識しており、Mambaのような長期記憶に優れたアーキテクチャとの統合や、デコード手法の改良(重複デコーディング)などを将来的な解決策として挙げている。

StreamDiTが拓く「生成AIネイティブ」な世界

StreamDiTの登場は、単なる動画生成ツールの高速化に留まらない。これは、私たちがデジタルコンテンツを制作し、体験する方法そのものを変えるパラダイムシフトの始まりだ。

これまで「生成AIによるコンテンツ」とは、AIが作り終えた完成品を人間が消費する、一方向的な関係だった。しかしリアルタイム性が加わることで、人間とAIの「対話」の中からコンテンツが生まれる、双方向的な関係へと進化する。

例えば、ゲームの世界ではどうだろう。プレイヤーの行動や選択に応じて、物語の背景、登場人物、クエストまでもがリアルタイムに無限生成される。二度と同じ体験はできない、真にパーソナルなオープンワールドが実現するかもしれない。ライブ配信では、視聴者のコメントを即座に映像に反映させ、配信者と視聴者が共同で物語を紡ぐ、全く新しいエンターテイメントが生まれるだろう。

これは、インターネットが情報の消費形態を変え、スマートフォンがコミュニケーションのあり方を変えたのに匹敵する、大きな変化の兆しではないだろうか。我々は今、AIがリアルタイムで世界を描き出す「生成AIネイティブ」時代の入り口に立っているのかもしれない。

論文

参考文献