Metaは2026年3月11日、自社のAIインフラストラクチャの屋台骨となる独自開発のAIアクセラレータ「MTIA(Meta Training and Inference Accelerator)」における次世代モデル、MTIA 300、400、450、および500のアウトラインを一挙に公開した。これらは2026年から2027年にかけて同社のグローバルなデータセンターへ順次導入される予定だ。

ソーシャルネットワークの基盤であった従来のランキングおよびレコメンデーション(R&R)を中心とするワークロードから、世界中のユーザーが日々享受する生成AIの推論処理へとコンピューティングの比重が急速に移り変わる中、Metaは従来のシリコン開発の常識を覆す手法を採択した。チップレットアーキテクチャという高度に分割された設計手法を活用し、約6ヶ月という極めて短いスパンでハードウェアの世代交代を反復していくという方針である。

本稿では、この極端とも言えるアグレッシブなシリコン開発戦略の背後にある技術的な必然性と、巨大テック企業による「ハイブリッド型コンピュートインフラ」構築の現在地、そしてそれが半導体エコシステム全体に及ぼす影響を見ていきたい。

アプリケーションとハードウェアの乖離を埋める極限の開発速度

AIモデルの進化速度は、現在、事実上すべてのハードウェア・アーキテクチャの伝統的な開発サイクルを完全に置き去りにしている。一般的なプロセッサの設計およびテストにおいては、将来のワークロードを予測して仕様を決定してから実際の量産シリコンがデータセンターのラックにマウントされるまでに、数年の歳月を要する。しかし、生成AIの激しい技術革新の領域においては、この「数年」という時間は単なる遅延ではなく、製品としての完全な「陳腐化」を意味する。Metaが直面していた最大のボトルネックは、数十億人が日常的に利用するプラットフォーム上で絶え間なく稼働するAIモデルの劇的な要求仕様の変化に対し、物理的なインフラストラクチャの進化が構造的に追いつかないという根本的な矛盾であった。

この危機的なタイムラグを克服するため、MetaはMTIAシリーズの開発において、単一の巨大なシリコン(モノリシック・ダイ)を設計する従来の手法を完全に放棄し、高度なモジュール型アプローチを採用した。計算処理、ネットワーク通信、入出力機能などの各コンポーネントを担う「チップレット」を独立のブロックとして捉え、必要に応じて世代ごとに特定の要素のみをスケールアップ・更新する仕組みを確立したのだ。さらに、筐体、ラック、そしてデータセンター内のネットワークインフラストラクチャといったファシリティ側のシステムレベルの設計は、MTIA 400、450、500を通じて完全に共通化されている。これにより、新型チップがロールアウトされた瞬間、多大な改修コストを伴わずに既存の物理環境へ即座に入れ替えることが可能となる。この設計論の転換により、Metaは「6ヶ月に1つの新世代を投入する」という業界標準を大きく逸脱する開発速度の獲得に成功した。将来の不確実なワークロードに対して一度の巨大な賭けに出て何年も待つのではなく、ソフトウェアのダイナミックな進化にハードウェアの歩調をリアルタイムに同期させる「アジャイルなハードウェア製造」という難題を実践しているのだ。

「推論」ボトルネックの解消に向けたアーキテクチャの急旋回

MTIAシリーズの変遷において最も注目すべきは、世代を追うごとに鮮明化していく「生成AIの推論(GenAI Inference)」への資源集中と特化のプロセスである。

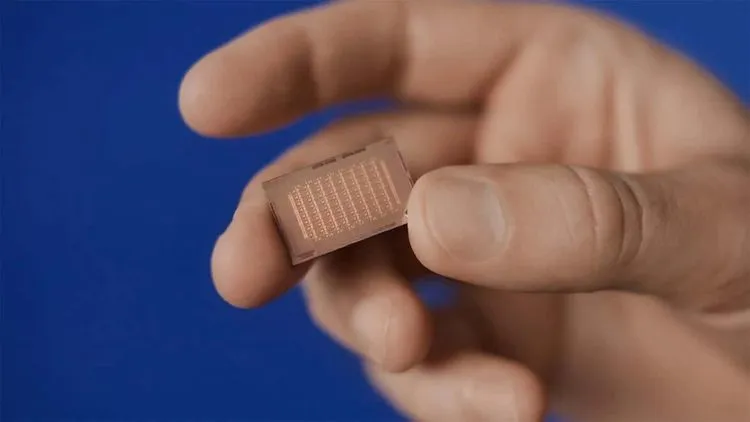

すでに本番のデータセンター環境で大規模に稼働している「MTIA 300」は、FacebookやInstagramのフィード表示を最適化するための、膨大なランキング・レコメンデーション(R&R)処理を念頭に設計されていた。1.2 PFLOPs(FP8)のベース演算能力を持つこのモデルは、いわば同社独自の通信トラフィック制御技術を確立するための強固なインフラの基礎固めであった。続く「MTIA 400」は、計算コアを倍増させることでFP8演算能力を6 PFLOPsへと一気に引き上げ、72デバイスによる大規模なスケールアップドメインを構築することによって、より計算負荷の高い汎用的な生成AIモデルにも即座に対応する強靭なスケーラビリティを証明した。

しかしながら、世界規模で指数関数的に急増する生成AIの推論リクエストに真の意味で応えるための回答となるのが、2027年におけるマスメッシュ・デプロイメントが公式にアナウンスされている「MTIA 450」および「MTIA 500」である。現在の生成AIの推論フェーズにおいて最大の物理的および時間的な制約となるのは、プロセスノードに依存する演算器自体の絶対的な処理能力よりも、計算ユニットに対する広帯域メモリ(HBM)からのデータ転送・供給速度にある。MTIA 450では、直前の世代であるMTIA 400と比較してHBM帯域幅を2倍となる18.4 TB/sへと抜本的に拡張し、同時にFP16/BF16等のデータ型の代わりに推論実行パスに特化したMX4フォーマットの演算能力群を著しく強化させた。さらに最上位に位置付けられるMTIA 500においては、これをさらに50%引き上げ、前人未到の域に達する27.6 TB/sの内部帯域幅を達成し、チップあたりに搭載されるHBMの総容量も最大512GBへと大幅に拡大されることとなる。

現在、市場の覇権を握り流通している主力グラフィックアクセラレータ(GPU)の大半は、大規模言語モデルなどにおける「事前学習(Pre-Training)」という、終わりのない巨大な行列演算と高いデータ精度を要求される汎用ワークロードを前提に最適化のチューニングが施されている。これらの巨大なGPU群を、パラメータ固定後の「推論」処理へと転用して利用すること自体は技術的に極めて容易だが、コストトラッキングや電力効率の視点から評価した場合、構造的に重大な無駄を常に内包して稼働し続けることになる。Metaが今回打ち出したアプローチは極めて現場のリアリティに即した合理的判断である。すなわち、需要の天文学的な爆発が確実に到来する「推論」機能にターゲットを絞り、ソフトウェア層のオーバヘッドを一切伴わないネイティブな低精度データの演算加速など、推論専用の処理パスをシリコンのハードウェアレベルで直接焼き付ける。このアプローチにより、処理結果の応答におけるミリ秒単位のレイテンシと、全社的な膨大なインフラ運用コストを両立させながら限界まで圧縮する強力な意図が貫かれている。

ペタスケール投資と「ハイブリッド・シリコン」の経済学

推論処理における高い処理自律性と劇的なプラットフォームコストダウンを可能にする独自のASIC(特定用途向け集積回路)アーキテクチャの開発を強力に推進しているからといって、Metaが市販の高性能商用GPUを自社エコシステムから短絡的に排除しようとしているわけではない点には、注意が不可避である。事実として、同社は2026年に入ってからも、コンピュートの領域における覇者であるNvidia、および強い追走姿勢を見せるAMDの両社から、数百億ドル規模に及ぶ最先端グラフィックハードウェアの追加長期調達契約を結んでいることが明らかになっている。

この一見すると莫大な資金を投下した独自シリコンの開発プロジェクトと、外部プロバイダからの歴史的な規模での汎用半導体大量購入という戦略行動。一方向からは意図が分散し矛盾しているように映るこの二面性こそが、グローバルに躍動する巨大プラットフォーマーが到達した究極の「ハイブリッド・コンピュートインフラ」のリスク分散・調達手法であると言える。未踏の学習領域を探索する新たな基盤アーキテクチャの「学習」フェーズや、試行錯誤が反復される研究開発(R&D)の最前線においては、ソフトウェアのプログラマビリティと絶対的な演算パワーに比類のない歴史的強みを持つNvidia製などの汎用最先端GPUをこれまでと同様に潤沢に割り当てる。その一方で、AIモデル自体の構造仕様が安定し、世界中のアクティブユーザーから日常的に殺到する数百億、数千億回もの無数のリクエストを確実にさばく必要のある最終の「推論」フェーズにおいては、TCO(総所有コスト)の圧縮率と、消費ワット数当たりのパフォーマンススループットに圧倒的に優れた自社製特化アーキテクチャであるMTIAを中心とするファブリックへとワークロードの実行単位をシームレスに引き継ぐのである。

自社設計であるMTIAは、稼働するサーバーラック単位の明確な電力上限枠(TDP)やデータセンターファシリティ側の物理的な制約(最新式の液冷から旧式の空冷設備への対応等)に合わせて、投入する回路コンポーネントを自由な裁量で段階的に調整できるだけでなく、業界の確固たるデファクトスタンダードであるオープンソースの機械学習フレームワーク「PyTorch」とのネイティブレベルでのソフトウェア統合という強力な利点を持つ。最前線で作業に当たる開発現場のエンジニア部隊は、仮にNvidia GPU向けに強力に最適化が施されたモデルであったとしても、根幹的なディープラーニングモデルのコード書き換え作業を強制される苦役を負うことなく、PyTorch 2.0の標準コンパイラによるエコシステム共通のツールチェーンを通じて、モデルを安全かつ極めて迅速にMTIA上へとデプロイし、実行環境として指定可能である。オープンソースとしてソフトウェアエコシステムそのものを主導牽引する立場にあるMetaだからこそ具現化可能なこの「摩擦を感じさせないインフラストラクチャ移行」戦略は、特定のハードウェアに対するベンダーロックインを本質的に無効化し、自社のデータセンターインフラストラクチャにおける完全な自己決定権と長期的な価格交渉力を確保するための決定的な武器となるのである。

オープン・スタンダードと地政学的リスクへの強固な防波堤

MTIAの中核的な高速化技術を構成し機能させる主要素として、ネットワーク半導体の重鎮であるBroadcomとの緊密なパートナシップ戦略が公表されているが、これはカスタム設計されたハードウェアノード間通信プロトコルや、大規模化する並列実行におけるスケーラビリティを物理的制約の中で担保する優れたネットワーキング・トポロジーに関するBroadcom側の深い専門的知見とアプローチに深く根ざしている。Meta自身は、ファウンドリの最大手であるTSMCが保有する最先端製造プロセスラインの安定したシリコン供給網を戦略的に確保しながらも、同時に外部の主要な特定分野における設計パートナーが持つ深いハードウェアレイヤーの知見と、自社内部で構築し続けた高度かつ高レイヤーのソフトウェアスタックの知見を、開発リソースの無駄なく巧みにハイブリッドさせていることがわかる。

プラットフォーム層のIT企業がみずからシリコン基板の回路設計図を引き、自社インフラに挿入するという大きな業界の潮流は、Googleによるクラウド時代の頭脳たるTPU(Tensor Processing Unit)の直近10年以上にわたる途切れることのない継続的な高度化や、Amazon傘下の多大なAWSクラウド事業が顧客向けおよび自社向けに推し進めるTrainiumおよびInferentiaといった自社特化型AIチップ路線の拡充と、完全に同一のベクトル線上を走る動きであると評価できる。今日のデジタル社会インフラにおいて、先端的な計算を可能とするコンピュートリソースの持続的な確保は、単なる一企業の長期的な設備投資計画といった生ぬるい枠を完全に逸脱し、企業の長期的な存亡そのものを決定づける最重要の「戦略物資の保持」と同義の重大性を持つようになりつつある。特定の単一メガシステムベンダーに対する急激な寡占の進行とそこへの過度なアーキテクチャ的依存状態の継続は、ライセンスやチップ本体の調達コストが天井知らずに暴騰していくリスクや、国際的な地政学的情勢を背景とした強権的な輸出規制の発動、さらにはグローバルサプライチェーンの予期せぬ物理的な大混乱による事業の突発的な停止リスクという、巨大な暗礁に直結する。

生成プロセスの一部である推論ワークロードの高速化と電力の無駄の排除に極端なまでに特化し、かつハードウェア設計のモジュール単位での切り替えやアップデートを意図的に容易にしたMTIAの新シリーズ展開は、巨大なテクノロジー業界の構造的深層において現在静かに進行するハードウェア・アーキテクチャの多元化・多極化を決定的に加速させる起爆剤となる。オープン・コンピュート・プロジェクト(OCP)というコンソーシアムが業界全体に向けて推進する、オープンなスペックのラック標準やサーバー筐体物理規格といった標準化インフラストラクチャの上に全体システムパッケージが構成されているという事実も、強固な既存の業界標準への確たる適合性と、それに逆行しない自社特有の強みの組み込みという極めて実用的でクレバーなエンジニアリングの精神を如実に反映している。

Metaという企業が今回世に問うた果断なチップ開発のロードマップ計画とアグレッシブな展開戦略の全容は、現実のプラットフォーム運営において無限に膨張し続ける当面のインフラ運用コストをエンジニアリングの力技で抑え込むための極めて実務的な対抗措置である。しかしそれと同時に、向こう十年間にわたって間違いなく展開される、グローバルなデータ・コンピュート資源を巡る苛烈な主導権争奪闘争において、自社のスタンスと絶対的な主導権を確保するための、緻密に計算されたシリコンレベルの防波堤であり、戦略的布石でもあるのだ。

Sources