2025年12月10日、フランスのAIスタートアップであり、欧州のユニコーン企業筆頭であるMistral AIが、新たなコーディング特化型モデルファミリー「Devstral 2」および「Devstral Small 2」を発表した。

生成AI市場において、AnthropicのClaudeやOpenAIのGPTシリーズといったクローズドソースモデルが覇権を争う中、Mistral AIは「圧倒的なコスト効率」と「ローカル実行可能な高性能」を武器に、開発者エコシステムの地図を塗り替えようとしている。特に注目すべきは、今回同時にリリースされたCLI(コマンドラインインターフェース)ツール「Mistral Vibe」だ。これは単なるチャットボットではなく、開発者の端末内で自律的にタスクを完遂する「エージェント」としてのAIのあり方を提示している。

Devstral 2:パラメータ効率の極限とSOTAの再定義

今回発表された「Devstral 2」ファミリーは、モデルサイズ(パラメータ数)とパフォーマンスの相関関係に対する挑戦状と言える。

1. 2つのモデル戦略:ハイエンドとエッジの両立

Mistral AIは、異なるユースケースを想定した2つのモデルを投入した。

- Devstral 2 (123B):

- 概要: 1230億パラメータを持つフラッグシップモデル。データセンターグレードのGPU(H100クラス×4基推奨)での運用を前提とする。

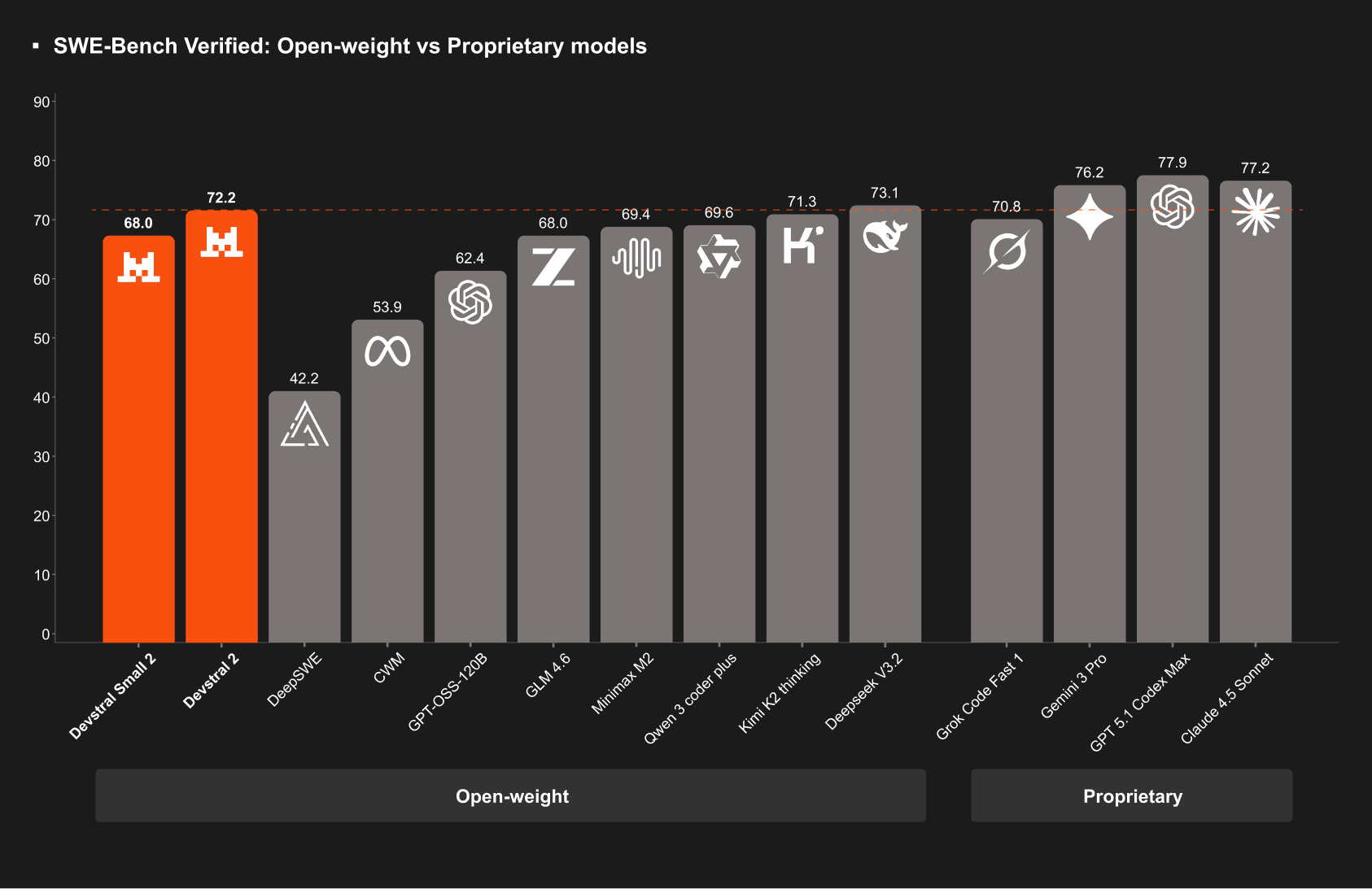

- 性能: ソフトウェアエンジニアリング能力を測るベンチマーク「SWE-bench Verified」において72.2%というスコアを記録。これはオープンウェイトモデルとして最高峰の水準であり、はるかに巨大な競合モデルに肉薄、あるいは凌駕する性能だ。

- 特徴: 256Kトークンのコンテキストウィンドウを持ち、大規模なコードベース全体を読み込んでのアーキテクチャレベルの推論が可能である。

- Devstral Small 2 (24B):

- 概要: 240億パラメータの軽量モデル。

- 革命的な点: 特筆すべきは、このモデルがコンシューマー向けハードウェア(高性能なゲーミングPCやMac Studio等)でローカル動作可能である点だ。

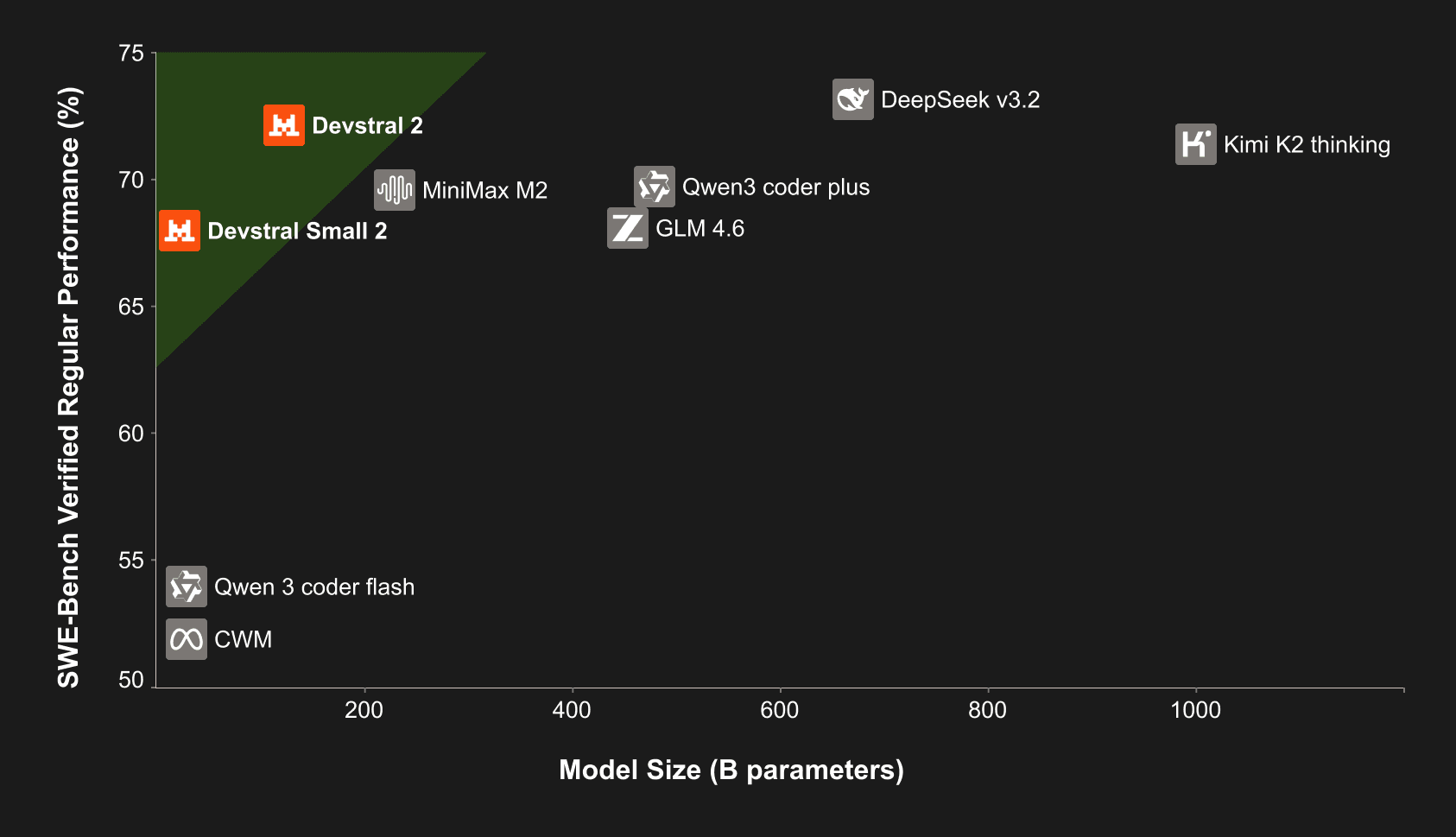

- 性能: SWE-bench Verifiedで68.0%を記録。DeepSeek V3.2と比較して約5倍小型でありながら、同等のタスク処理能力を持つとされる。プライバシーを重視する企業や、通信レイテンシを嫌う開発者にとって、ローカルで動く「賢い」コーディング相棒は待望の存在となるだろう。

2. 競合比較:DeepSeekとKimiへの対抗

Mistral AIの公式データによれば、Devstral 2およびSmall 2は、中国発の有力モデルであるDeepSeek V3.2やKimi K2と比較して、圧倒的な「サイズ対効果」を実現している。

具体的には、Devstral 2はDeepSeek V3.2の5分の1、Devstral Small 2に至っては28分の1のサイズでありながら、実用的なコーディングタスクにおいて互角以上の戦いを見せている。これは、モデルの「巨大化」一辺倒だったトレンドに対し、「密度の高い学習(Dense Transformer)」による効率化が有効であることを証明している。

「Mistral Vibe CLI」:チャットから”エージェント”へのパラダイムシフト

今回の発表でモデル性能以上に業界へのインパクトが大きいのが、「Mistral Vibe CLI」のリリースだ。これは近年開発者コミュニティでバズワード化している「バイブコーディング」の潮流を捉えた戦略的な一手である。

バイブコーディングとは何か?

バイブコーディングとは、開発者が細部の構文(Syntax)に囚われることなく、自然言語で大まかな意図(Vibe)を伝えるだけで、AIがコードの実装、修正、リファクタリングを行う開発スタイルのことを指す。CursorやSupabaseといったツールがこのトレンドを牽引してきたが、MistralはこれをCLI(黒い画面)の世界に持ち込んだ。

ターミナルに住む自律型エージェント

Mistral Vibe CLIは、単にコードを生成して提案するだけのツールではない。

- 自律的なファイル操作: ユーザーの承認に基づき、複数のファイルにまたがる変更を直接適用する。

- コンテキスト認識: 現在のディレクトリ構造やGitのステータス(変更履歴)を自動的にスキャンし、「今、開発者が何に直面しているか」を理解した上で回答する。

- 統合環境: 人気のコードエディタ「Zed」の拡張機能としても提供され、IDE内部でのシームレスな利用が可能となっている。

筆者は、これが「AIペアプログラミング」から「AI自律開発」への移行期における重要なマイルストーンになると分析する。開発者はエディタとチャット画面を行き来する必要がなくなり、ターミナル上で「このバグを直して」「テストを追加して」と指示するだけで完結する未来が、現実のものとなりつつある。

経済合理性の追求:Claude Sonnetに対する「7倍」の優位性

企業導入において最大の障壁となるのが「コスト」である。Mistral AIはこの点において、現在コーディング能力で高い評価を得ているAnthropicの「Claude 3.5 Sonnet」を明確なターゲットに据えた。

コストパフォーマンスの衝撃

Mistral AIの主張によれば、Devstral 2は実世界のタスクにおいてClaude Sonnetと比較して最大7倍のコスト効率を実現しているという。

- API価格設定:

- Devstral 2: 入力 $0.40 / 出力 $2.00(100万トークンあたり)

- Devstral Small 2: 入力 $0.10 / 出力 $0.30(100万トークンあたり)

この価格設定は、大量のコードベースを読み込ませ、複雑なリファクタリングを行わせるような「トークン消費量が多い」タスクにおいて、劇的なコスト削減をもたらす。APIは当初無料期間を経て上記の価格に移行する予定だが、この攻撃的なプライシングは、特にコストに敏感なスタートアップや、大規模な自動化パイプラインを構築するエンタープライズにとって強力な誘引材料となる。

一方で、人間による評価(Human Eval)では、依然としてClaude Sonnet 4.5の方が好まれる傾向にあることもMistral AIは正直に開示している。しかし、「最高性能」ではなく「十分な性能で圧倒的に安い」というポジショニングは、ビジネス戦略として極めて合理的だ。

緻密なライセンス戦略:オープンソースの持続可能性への解

技術的なスペック以上に興味深いのが、今回採用されたライセンス形態の違いである。ここには、オープンソースAI企業の「マネタイズ」と「普及」のジレンマに対するMistral AIの回答が見て取れる。

1. Devstral Small 2:Apache 2.0による「完全なる自由」

24Bの小型モデルには、非常に制限の緩い「Apache 2.0」ライセンスが適用された。商用利用、改変、再配布がほぼ自由であり、これは開発者の手元(ローカル環境)での普及を爆発的に加速させることを狙っている。ホビイストや個人開発者がVibe CLIを使って開発体験を共有することで、Mistralブランドの草の根的な支持を広げる役割を担う。

2. Devstral 2:Modified MITによる「防衛と収益化」

一方、123Bのフラッグシップモデルには「Modified MIT License」が適用された。ここには重要な条項が含まれている。

- レベニューキャップ(収益上限): 月間収益が2,000万ドル(約30億円)を超える企業が商用利用する場合、別途商用ライセンスの購入またはAPI経由での利用が義務付けられる。

この戦略の意図は明白だ。AWS、Microsoft Azure、Google Cloudといった「ハイパースケーラー」が、Mistralのモデルを自社プラットフォームで勝手にホスティングし、利益を独占することを防ぐための防波堤(Moat)である。

月商30億円未満の企業の大多数(99%以上のスタートアップや中小企業)にとっては、実質的に「無料のオープンソース」として機能するが、巨大テック企業が利用する際にはMistral AIへの収益還元を強制する。これは、オープンソースの精神を維持しつつ、企業の存続に必要な収益基盤を確保する、非常に現実的かつ巧みなバランス感覚と言える。

インフラとエコシステム:NVIDIA、ASMLとの連携

Devstral 2の展開において、ハードウェアパートナーとの連携も強化されている。

- NVIDIA: Devstral 2はNVIDIAのデータセンターGPUに最適化されており、NIM(NVIDIA Inference Microservices)への対応も予定されている。

- ASML: 2024年9月にオランダの半導体製造装置大手ASML主導の資金調達を実施しており、欧州のテック・エコシステム全体がMistral AIをバックアップする体制が構築されている。

また、Kilo CodeやClineといったオープンソースのエージェントツールとの提携により、リリース初日から開発者が使い慣れた環境でDevstral 2を利用できる体制を整えた点も、普及速度を早める要因となるだろう。

AI開発の「民主化」と「自動化」の加速

Mistral AIによるDevstral 2とVibe CLIの発表は、AIコーディング支援市場における「価格破壊」と「ローカル回帰」の狼煙(のろし)である。

123Bモデルによる高度な推論能力と、24Bモデルによるローカルでの軽快な動作。この2つの選択肢を提供することで、Mistralは「クラウド依存」からの脱却を開発者に提案している。特に、月額課金のSaaS型AIツールに依存せずとも、自社のハードウェアリソースで高度な自動化が可能になる点は、セキュリティとコスト管理の観点から企業のCTOたちに強く響くだろう。

「Vibe Coding」という新たな潮流に乗り、クローズドなAI巨人たちに挑むMistral AI。その戦略は、単に安価なモデルを提供することではなく、開発者のワークフローそのものを再定義することにある。

Sources

- Mistral AI: Devstral2 Mistral Vibe CLI