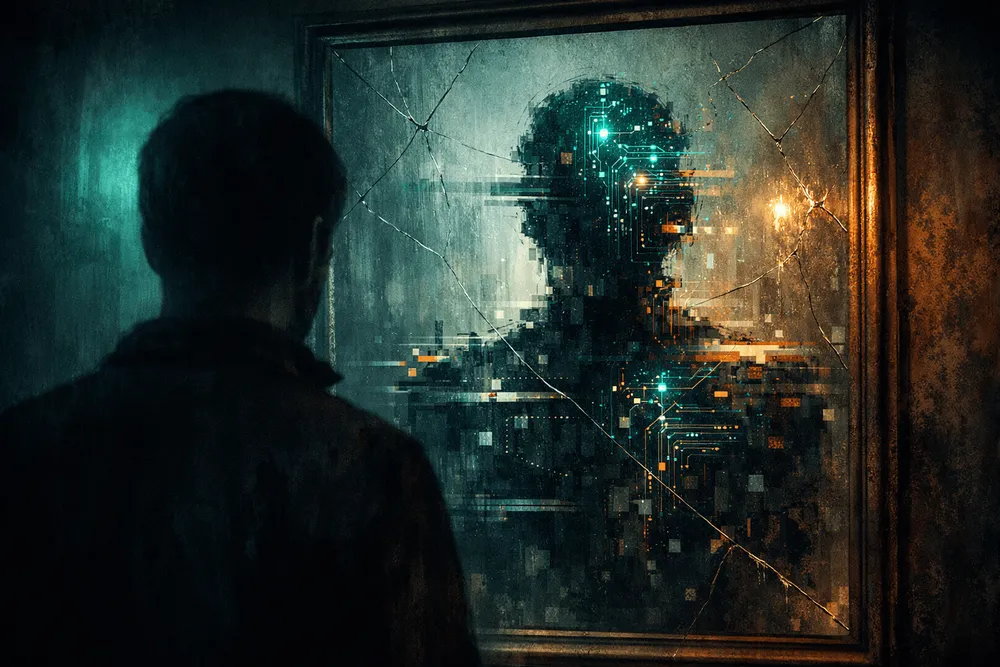

人工知能は、交友を提供するチャットボットからオンラインで目にする内容を形作るアルゴリズムまで、日常生活にますます織り込まれている。しかし、生成AIがより対話的で、没入的で、感情的に応答するようになるにつれて、臨床医は困難な問題を問い始めている。生成AIは脆弱な人々に精神病を悪化させる、あるいは引き起こす可能性があるのだろうか。

大規模言語モデルとチャットボットは広くアクセス可能であり、支援的で、共感的、さらには治療的であるとさえ位置づけられることが多い。ほとんどのユーザーにとって、これらのシステムは有用であるか、最悪でも無害である。

しかし、最近、多数のメディア報道が、ChatGPTが顕著に登場する精神病症状を経験している人々を描写している。

小規模ではあるが重要なグループ——精神病性障害を持つ人々、またはハイリスクにある人々——にとって、生成AIとの相互作用ははるかに複雑で危険である可能性がある。これは臨床医に緊急の問題を提起する。

AIが妄想的信念体系の一部となる仕組み

「AI精神病」は正式な精神医学的診断ではない。むしろ、AIシステムとの相互作用を中心に形成、強化、または構造化された精神病症状を説明するために、臨床医と研究者が使用する新たな略語である。

精神病は共有された現実との接触の喪失を伴う。幻覚、妄想、思考の混乱が中核的特徴である。精神病の妄想はしばしば文化的素材を利用する——宗教、テクノロジー、または権力構造——内的経験を理解するために。

歴史的に、妄想は神、電波、政府の監視など、いくつかのものを参照してきた。今日、AIは新たな物語的足場を提供している。

一部の患者は信念を報告している。生成AIが意識を持っている、秘密の真実を伝えている、彼らの思考を制御している、または特別な使命で協力しているという信念である。これらのテーマは精神病における長年のパターンと一致しているが、AIは以前のテクノロジーが持たなかった相互作用性と強化を追加する。

現実チェックのない検証のリスク

精神病は異常な顕著性と強く関連している。これは中立的な出来事に過度の意味を割り当てる傾向である。対話型AIシステムは、設計上、応答的で、一貫性があり、文脈を認識した言語を生成する。新たな精神病を経験している人にとって、これは不気味なほど検証されていると感じられる可能性がある。

精神病に関する研究は、確認とパーソナライゼーションが妄想的信念体系を強化する可能性があることを示している。生成AIは会話を継続し、ユーザーの言語を反映し、知覚された意図に適応するように最適化されている。

これはほとんどのユーザーにとって無害であるが、現実検討——内的思考と想像、客観的で外的な現実を区別するプロセス——が損なわれている人々において、歪んだ解釈を意図せず強化する可能性がある。

社会的孤立と孤独が精神病リスクを増加させるという証拠もある。生成AIコンパニオンは短期的には孤独を軽減する可能性があるが、人間関係に取って代わることもある。これは、すでに社会的接触から撤退している個人に特に当てはまる。この力学は、過度のインターネット使用とメンタルヘルスに関する以前の懸念と類似点を持つが、現代の生成AIの対話的深さは質的に異なる。

研究が示すこと、および不明なままのこと

現時点では、AIが精神病を直接引き起こすという証拠はない。

精神病性障害は多因子的であり、遺伝的脆弱性、神経発達的要因、トラウマ、薬物使用を含む可能性がある。しかし、AIが感受性のある個人において誘発または維持因子として作用する可能性があるという臨床的懸念が一部ある。

デジタルメディアと精神病に関する症例報告と質的研究は、テクノロジー的テーマがしばしば妄想に組み込まれることを示している。特に初回エピソード精神病中に。

ソーシャルメディアアルゴリズムに関する研究は、自動化システムが強化ループを通じて極端な信念を増幅する方法をすでに実証している。ガードレールが不十分な場合、AIチャットシステムは同様のリスクをもたらす可能性がある。

ほとんどのAI開発者は、重度の精神疾患を念頭に置いてシステムを設計していないことに注意することが重要である。安全メカニズムは精神病ではなく、自傷または暴力に焦点を当てる傾向がある。これはメンタルヘルスの知識とAI展開との間にギャップを残す。

倫理的問題と臨床的影響

メンタルヘルスの観点からは、課題はAIを悪魔化することではなく、差異的脆弱性を認識することである。

特定の薬物または物質が精神病性障害を持つ人々にとってよりリスクが高いのと同様に、特定の形態のAI相互作用は注意を必要とする可能性がある。

臨床医は妄想においてAI関連の内容に遭遇し始めているが、これを評価または管理する方法に対処する臨床ガイドラインはほとんどない。セラピストは薬物使用について尋ねるのと同じように、生成AI使用について尋ねるべきだろうか。AIシステムは精神病的観念を検出し、それに関与するのではなく緩和するべきだろうか。

開発者にとっても倫理的問題がある。AIシステムが共感的で権威的に見える場合、それは注意義務を負うのだろうか。そして、システムが意図せず妄想を強化した場合、誰が責任を負うのだろうか。

AI設計とメンタルヘルスケアの橋渡し

AIはなくならない。現在の課題は、メンタルヘルスの専門知識をAI設計に統合し、AI関連の経験に関する臨床的リテラシーを開発し、脆弱なユーザーが意図せず害を受けないようにすることである。

これには、臨床医、研究者、倫理学者、テクノロジストの間の協力が必要である。また、証拠に基づく議論を支持して、誇大宣伝(ユートピア的およびディストピア的の両方)に抵抗することも必要である。

AIがより人間らしくなるにつれて、続く問題は、その影響に最も脆弱な人々をどのように保護できるかである。

精神病は常に、その時代の文化的ツールに適応してきた。AIは、心が自身を理解しようとする最新の鏡に過ぎない。社会としての私たちの責任は、この鏡が、それを修正する能力が最も低い人々にとって現実を歪めないようにすることである。