量子コンピュータ開発の長年のジレンマだった「規模」と「精度」という、二律背反の課題がついに打ち破られたのかもしれない。カリフォルニア工科大学(Caltech)の研究チームが、従来の10倍以上となる6,100個の量子ビット(qubit)を高精度に制御する、世界最大の量子ビットアレイの構築に成功したのだ。この成果は、実用的な量子コンピュータの実現に不可欠とされる「誤り耐性」への道筋を、かつてなく明確に照らし出すものであり、量子技術の新たな時代の幕開けを告げている。

量子コンピューティングの新たな地平線:6,100原子が照らす未来

2025年9月25日、科学誌『Nature』に掲載された論文は、量子コンピューティングの研究コミュニティに大きな衝撃を与えた。 Caltechの物理学教授Manuel Endres氏が率いる研究チームが、レーザー光を用いて6,100個もの中性セシウム原子を個別に捕捉し、それらを量子ビットとして機能させることに成功したと報告したからだ。

これまで、同様の中性原子方式の量子コンピュータで実現されていた量子ビット数は、数百個のレベルに留まっていた。今回の成果は、その規模を一気に10倍以上に引き上げる、まさに桁違いのものだ。

しかし、この成果の真に驚くべき点は、単なる「量」の拡大に留まらない。研究チームは、この大規模なシステムにおいても、量子コンピュータの生命線である「質」を極めて高いレベルで維持することに成功したのだ。具体的には、量子ビットの情報を保持できる時間(コヒーレンス時間)を約13秒まで延ばし、個々の量子ビットを操作する際の精度(フィデリティ)を99.98%という驚異的な値で達成した。

「これは中性原子量子コンピューティングにとって、非常にエキサイティングな瞬間です」と、論文の主執筆者であるEndres教授は語る。「我々は今、大規模な誤り耐性量子コンピュータへの道筋を見ることができます。そのための礎石は、確かに置かれました」。

「量」か「質」か? 量子開発を縛り続けた”呪縛”

今回の成果がなぜこれほどまでに重要なのかを理解するには、量子コンピュータ開発が直面してきた根本的な課題に目を向ける必要がある。

なぜ量子ビットは増やせないのか?

古典コンピュータが「0」か「1」のどちらかの状態で情報を扱う「ビット」を用いるのに対し、量子コンピュータは「量子ビット」を用いる。量子ビットは、量子力学の奇妙な法則に支配されており、「0」と「1」の状態を同時に持つことができる。この「重ね合わせ(Superposition)」と呼ばれる性質により、量子コンピュータは膨大な数の計算を並列で実行できるポテンシャルを秘めている。

しかし、この強力な能力の源泉である重ね合わせの状態は、極めて脆い。外部からのわずかなノイズ(温度変化や電磁波など)に触れるだけで、この繊細な量子状態は簡単に壊れてしまうのだ。この現象は「デコヒーレンス」と呼ばれ、量子ビットが計算エラーを引き起こす最大の原因となっている。

そして、ここに量子コンピュータのスケールアップを阻んできた大きな壁が存在した。量子ビットの数を増やせば増やすほど、システム全体が複雑になり、外部ノイズの影響を受けやすくなる。さらに、量子ビット同士が互いに干渉し合い、新たなエラー源も生まれる。つまり、「量を増やせば、質が下がる」というトレードオフの関係が、長らく研究者たちを悩ませてきたのである。

これまでのアプローチとその限界

この難題を克服するため、世界中の研究機関や企業が、様々なアプローチで量子コンピュータの開発を競ってきた。GoogleやIBMが注力する「超電導回路」方式、IonQなどが採用する「イオントラップ」方式、そして今回のCaltechが用いた「中性原子」方式などがその代表格だ。

それぞれに長所と短所があるが、いずれのアプローチも、数千、数万という規模にまで量子ビットを拡張しながら、エラー率を十分に低く抑えるという課題に直面していた。この「量と質のジレンマ」こそが、量子コンピュータがまだ一部の研究用途に留まっている最大の理由だったと言えるだろう。

Caltechはいかにして「不可能」を可能にしたのか

Caltechのチームは、この長年の呪縛をいかにして打ち破ったのだろうか。その核心には、緻密に計算され尽くした物理学と、それを実現する高度な実験技術が存在する。

鍵は「光のピンセット」:12,000本のレーザーが織りなす精密工学

研究チームが用いたのは、「光ピンセット(optical tweezers)」と呼ばれる技術だ。 これは、強く集光したレーザービームが持つ微小な力を利用して、原子のようなナノスケールの物体を捕捉し、操作する技術である。

彼らはまず、1本の強力なレーザービームを、特殊な光学素子を使って12,000本もの微細なビームに分割した。 これらのレーザービームを真空チェンバー内に照射し、それぞれがセシウム原子を1個だけ捕まえる「ピンセット」として機能させる。そして、これらのピンセットを精密に制御することで、最終的に6,100個の原子を整然としたグリッド状に配置することに成功したのだ。

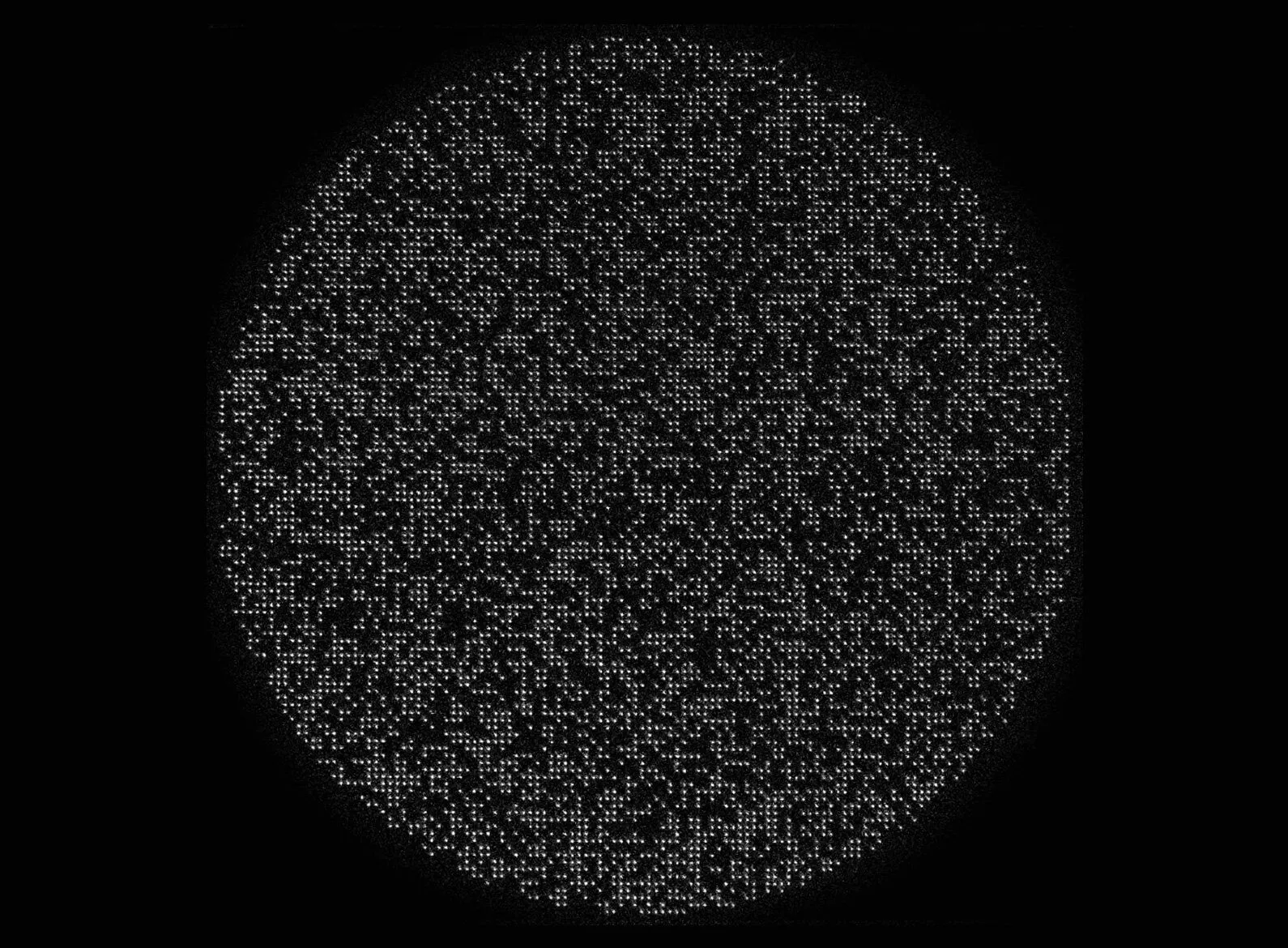

「スクリーン上では、実際に各量子ビットが光の点として見えます。これは、大規模な量子ハードウェアを目の当たりにする、非常に印象的な光景です」と、研究を主導した大学院生の一人、Hannah Manetsch氏は語る。 まるで見えない巨人が、数千の指で原子を一粒ずつつまんで並べているかのような、驚異的な光景がそこには広がっている。

驚異の性能:13秒の重ね合わせと99.98%の制御精度

この大規模なアレイで達成された性能は、まさに目を見張るものがある。

まず、約13秒というコヒーレンス時間。 量子力学の世界では、時間は極めて短いスケールで進む。13秒という時間は、量子ビットがその繊細な重ね合わせ状態を維持するには、ほとんど永遠とも言える長さだ。これは、以前の同様のシステムと比較して10倍近い改善であり、システムが外部ノイズからいかにうまく隔離されているかを示している。

そして、99.98%という制御精度。 これは、研究者がレーザーを使って特定の量子ビットを「0」から「1」へ、あるいはその逆へと操作しようとした際に、10,000回中9,998回は意図した通りに成功することを意味する。このレベルの精度は、後に述べる「量子誤り訂正」を機能させるための重要な閾値(しきいち)を超えるものであり、実用化に向けた大きな一歩と言える。

「大規模化、つまり原子の数を増やすことは、精度の犠牲の上に成り立つと考えられがちでした」と、同じく大学院生のGyohei Nomura氏は言う。「しかし我々の結果は、その両方が達成可能であることを示しています。質がなければ量子ビットは役に立ちません。今、我々は量と質の両方を手に入れたのです」。

「動かせる」量子ビットの絶大なアドバンテージ

さらに、この中性原子方式には、超電導回路のような固定式のプラットフォームにはない、決定的な利点がある。それは、量子ビットである原子そのものを、重ね合わせ状態を保ったままアレイ内で物理的に移動させられることだ。

研究チームは、原子を数百マイクロメートルにわたって動かすことに成功した。 この「シャトリング」能力は、将来的に量子コンピュータのアーキテクチャを設計する上で、絶大な柔軟性をもたらす。

マネッチ氏はこの挑戦を、巧みな比喩で表現する。「原子を動かしながら保持しようとするのは、コップの水をこぼさないようにするようなものです。そして、その原子を重ね合わせ状態で維持しようとするのは、水が飛び散るほど速く走らないように気をつけるようなものです」。

この困難なタスクを達成したことで、例えば、特定の計算に必要な量子ビット同士を物理的に近づけたり、エラー訂正のために量子ビットを再配置したりといった、動的な操作が可能になる。これは、より効率的で強力な量子アルゴリズムの実行に不可欠な機能である。

究極の目標「誤り耐性量子コンピュータ」への道筋

今回の成果が最終的に目指すのは、「誤り耐性量子コンピュータ」の実現である。

なぜエラー訂正が不可欠なのか?

前述の通り、量子ビットは本質的にエラーを起こしやすい。どんなに技術が進歩しても、エラーをゼロにすることは不可能だと考えられている。そこで不可欠になるのが、発生したエラーを検出し、訂正する「量子誤り訂正」という仕組みだ。

しかし、ここにも量子力学特有の難しさがある。古典コンピュータでは、情報を単純にコピーして多数決をとることでエラーを容易に訂正できる。だが、量子力学には「複製不可能定理(no-cloning theorem)」という大原則があり、未知の量子状態を完全にコピーすることは禁じられているのだ。

「古典コンピュータとは異なり、量子ビットは単純にコピーできません。そのため、誤り訂正はより巧妙な戦略に頼らざるを得ないのです」と、大学院生のエリー・バタイユ氏は説明する。

数千の物理量子ビットが1つの論理量子ビットを生む世界

量子誤り訂正の基本的な考え方は、1つの情報を多数の「物理量子ビット」に分散して符号化し、それらをひとまとめにして、エラーに強い1つの「論理量子ビット」として扱うというものだ。一部の物理量子ビットにエラーが発生しても、全体の符号化された情報からそれを検出し、元の正しい状態に復元することができる。

問題は、信頼性の高い論理量子ビットを1つ作るために、非常に多くの物理量子ビットが必要になることだ。現在の理論では、実用的な計算を行うためには、数千から数万の物理量子ビットを使ってようやく1つの論理量子ビットが作れると見積もられている。

この観点から見ると、Caltechが達成した6,100量子ビットという規模は、まさにこの「論理量子ビット」の構築を現実の視野に入れ始めたことを意味する。ついに、量子コンピュータが理論上の遊び道具から、実用的な計算機へと脱皮する段階に足を踏み入れたと言っても過言ではないだろう。

次なるフロンティア:「量子もつれ」が解き放つ真の力

6,100個の高品質な量子ビットという、強力な基盤を手に入れたEndres教授のチーム。彼らが次に見据えるのは、量子コンピュータに真の力を与える最後の、そして最も重要な要素である「量子もつれ」の実装だ。

量子もつれとは、2つ以上の量子ビットが、どれだけ離れていても互いに密接に結びつき、まるで一つのシステムであるかのように振る舞う現象である。一方の量子ビットの状態を測定すると、その瞬間に、もう一方の量子ビットの状態が確定する。この不思議な相関関係こそが、複雑な量子アルゴリズムを実行し、単なる重ね合わせだけでは不可能な、爆発的な計算能力を引き出す鍵なのだ。

この「もつれ」を6,100個の量子ビット間で自在に生成し、制御することができれば、それはもはや単なる実験装置ではない。新しい物質の性質をシミュレーションしたり、複雑な分子構造を解析して画期的な新薬を開発したり、さらには時空を支配する量子場の謎を解き明かしたりと、科学のあらゆる分野で革命を引き起こす可能性を秘めた、前人未到の計算機となる。

「私たちが、量子力学だけが教えることができる方法で宇宙について学ぶための機械を作っているという事実に、興奮を覚えます」とManetsch氏は言う。

中性原子方式は覇権を握るか

今回のCaltechの成果は、量子コンピュータ開発競争の勢力図を大きく塗り替える可能性を秘めている。これまで、GoogleやIBMが推進する超電導方式がメディアの注目を集めることが多かったが、中性原子方式がスケーラビリティ(拡張性)において極めて高いポテンシャルを持つことを、今回の研究は明確に示した。

超電導方式が微細加工技術によって量子ビットをチップ上に作り込むのに対し、中性原子方式はレーザー技術の進歩によって量子ビット数を増やすことができる。原理的には、より強力なレーザーと高度な光学系を用意できれば、数万、数十万という量子ビットへの道も開けている。

さらに、原子を物理的に移動できるという特徴は、量子ビット間の接続性(コネクティビティ)において大きなアドバンテージとなる。すべての量子ビットが他のすべての量子ビットと結合できる「全結合」に近いアーキテクチャを実現しやすく、これは多くの重要な量子アルゴリズムを効率的に実行する上で有利に働く。

もちろん、課題がなくなったわけではない。量子もつれを大規模かつ高精度に実現する技術や、計算結果を高速に読み出す技術など、まだ乗り越えるべきハードルは存在する。しかし、今回の成果が、実用的な大規模量子コンピュータへの最も有望なロードマップの一つを提示したことは間違いない。

人類は今、自らの手で作り出した量子的なツールを使って、自然そのものの深遠な謎に迫ろうとしている。Caltechの実験室で輝く6,100個の光の点は、私たちを全く新しい知の領域へと導く、道標となるのかもしれない。

論文

参考文献