2026年3月2日に発生したAnthropicのAIモデル「Claude」の世界規模のシステム障害は、半日以上が経過した3月3日現在も完全な収束を見せていない。米国防総省との対立に端を発する記録的な需要急増が引き金とみられるこの障害は、世界中の開発者のワークフローを麻痺させ、SNS上では地政学的な陰謀論まで飛び交う事態に発展している。倫理的スタンスを貫いた結果得た圧倒的な支持が、皮肉にも自社のインフラストラクチャを押し潰す結果となっており、同社は急激なスケールアウトという現実的な壁に直面している。

終わらない障害と連鎖する混乱

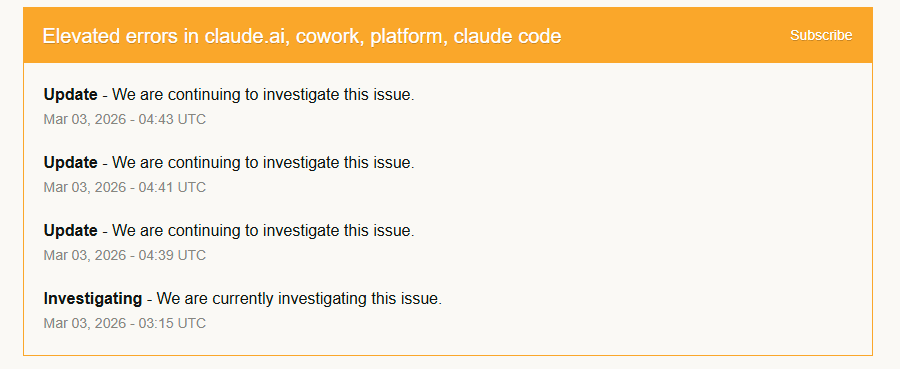

3月2日に発生した大規模なダウンタイムは、一過性のトラブルでは終わらなかった。Anthropicの公式ステータスページによれば、協定世界時(UTC)3月3日03時15分(日本時間12時15分)に新たな問題の調査が開始され、その後も解決に至っていない。筆者も実際に日本時間14時時点でもログインが不可能な状態を確認しており、ユーザーにはエラーメッセージが表示され続けている。

現在、「パフォーマンス低下(Degraded Performance)」が公式に宣言されているのは、一般向けの「Claude.ai」、開発者向けのコンソール(platform.claude.com)、そしてコーディング支援プラットフォームの「Claude Code」である。コアとなるAPI自体は「稼働中(Operational)」のステータスを維持しているものの、主要なユーザーインターフェース群が不安定な状態にあり、未解決のインシデントとして扱われている。

この長期化する障害は、AIツールへの依存を深める開発者コミュニティに直接的な打撃を与えている。SNS上では、Claudeによるコード生成や自動化機能を利用できなくなり、生成AI登場以前のように自力で手動コーディングを行わざるを得ない状況を嘆く声が溢れている。

事態の混迷は、思わぬ憶測も呼んでいる。一部のコミュニティでは、米軍がイラン攻撃の計画にClaudeを利用しているという真偽不明の噂や、中東におけるAmazon Web Services(AWS)のデータセンターへのドローン攻撃、そしてAmazonとAnthropicの強固な関係性を無理やり結びつける陰謀論が拡散している。これは、同社が直近で巻き込まれた政治的緊張が、システムの挙動に対するユーザーの不安を過剰に煽る土壌となっていることを示している。

事象の技術的推移と広がる影響

システムの不安定化は、前日から大きく二つのフェーズを経て深刻化した。3月2日の11時49分UTC(日本時間20時49分)、Anthropicのエンジニアリングチームは最初にClaude.aiのWebインターフェースおよび開発者用コンソールにおけるエラーの急増を検知した。当初はログインおよびログアウトの認証経路に限定された問題と認識されていたが、13時37分UTC(日本時間22時37分)には複数の主要なAPIメソッドで呼び出しの失敗が確認され、企業のバックエンド環境にまで連鎖的な障害が及んだ。

並行して、14時35分UTC(日本時間23時35分)には最新モデル「Claude Opus 4.6」の複雑なモデルルーティングインフラストラクチャーにおいても二次的な技術障害が発生した。Anthropicは同日15時25分UTC(日本時間3日00時25分)までに全運用システムにプログラム上の修正を適用したものの、前述の通り3月3日に入っても完全に安定稼働を取り戻すには至っていない。サイバーセキュリティの監視やリアルタイムのコード生成などをClaudeのインフラに自動化スクリプトで依存している組織は、深刻なタイムアウト応答に直面し、多岐にわたるクリティカルな処理が機能停止状態に陥った。

国防総省との決裂が引き起こした需要の暴走

Anthropicは今回の障害の根本的な原因を詳細には明かしていないが、「ここ数日の間にClaudeに対して寄せられた前例のない需要」に意図的に言及している。システム障害が発生した当週末にかけて、ClaudeはAppleのApp Storeで無料アプリランキングの1位に急浮上した。1月時点ではトップ100圏外であった事実を鑑みれば、これは桁外れの躍進である。

この異常なトラフィック急増の震源地は、米国政府との激しい対立である。Anthropicは7月に米国防総省と締結していた2億ドル規模の契約において、自社のAIモデルが完全自律型兵器や大規模な国内監視に利用されないことの確約を求めた。しかし国防総省はこれを拒絶し、合法とみなされるあらゆる目的でのプラットフォーム利用を無条件で認めるよう要求した。交渉決裂の結果、Trump大統領は全連邦機関に対してAnthropic製品の使用を即刻停止するよう命じ、Pete Hegseth国防長官は同社を「国家安全保障上のサプライチェーンリスク」に指定した。

この政府による強硬な排除措置は、一般市場において完全に逆の効果を生み出した。「自律型兵器や大量監視への加担を明確に拒む」というAnthropicの姿勢は、監視社会への懸念を抱くユーザーたちの支持を集める結果となった。Redditなどのプラットフォーム上で「キャンセルChatGPT」運動が急速に広まり、Claudeへの大規模なユーザー移行が発生した。国防総省がAnthropicとの関係を断ち切った数時間後にOpenAIが代替の契約を結んだ事実も、この動きを加速させた。無料登録者数は1月から60%以上増加し、有料会員数は過去1年間で倍増している状況下での想定外のトラフィック集中が、システムを物理的な限界に追い込んだ構造が見て取れる。

クラウドベースLLMへの過度な依存がもたらすリスク

今回の長期にわたる障害は、クラウドベースの大規模言語モデルに極度に依存する現在のシステムアーキテクチャが抱える構造的なリスクを、サイバーセキュリティ業界およびシステム開発者たちに突きつけている。単一ベンダーのAPIやログイン認証基盤がダウンした場合、接続されている無数のサービスや社内システムが連鎖的に停止する。この単一障害点(Single Point of Failure)のリスクは、AIの実用的なビジネス統合が進むにつれて増大の一途をたどっている。

企業側は、クラウド側での大規模な障害発生を大前提としたレジリエンス(回復力)の高いシステムアーキテクチャの構築を迫られている。APIの応答が停止した場合に備えた堅牢なエラーハンドリングロジックの実装、エクスポネンシャル・バックオフ(指数関数的後退)戦略を用いた洗練された再試行プロセスの導入が必須となる。さらに、一時的に処理を引き継ぐためのローカルな小規模オープンソースモデルへの自動切り替えや、複数の代替LLMエンドポイントへのフォールバック機構の設計が求められる。AIモデルを単なる外部ツールではなく、システムの中核的な基幹インフラストラクチャとして捉え直し、エンタープライズレベルの冗長性を確保することが今後のシステム設計における絶対的な条件である。

独立性と技術的拡張性の間で揺れる今後の展望

AI開発の最前線において、政府の軍事・安全保障戦略との協調を優先する企業と、自社の倫理的ガイドラインを固守する企業の間に明確な分断線が引かれた。政府市場へのアクセスを失うことが、直ちにビジネス上の敗北を意味するわけではない。国家権力との対立が、個人ユーザーの信頼獲得やプライバシーを重視する強力なブランド価値の形成に直結する新たな状況が生まれている。

だが、その爆発的な支持と成長を支えるだけの堅牢な技術的インフラが伴わなければ、今回のように甚大なシステム障害という形で物理的な限界が露呈する。一時的な需要急増を永続的な定着に変えるためには、モデルの知的性能と同等以上に、インフラストラクチャの絶対的な安定性が求められる。技術的卓越性とイデオロギーの貫徹、そして膨張するトラフィックへの物理的な対応能力という三つの要素が、Anthropicの今後の命運を決定づける。現在進行形の障害は、その困難な道程の始まりを告げる最初の試練である。

Sources