Google DeepMindは、ロボットが自ら「思考」し、複雑なタスクを計画・実行する新時代の到来を告げるAIモデル群「Gemini Robotics 1.5」を発表した。単一の指示をこなすだけでなく、Web検索などのデジタルツールを駆使して情報を収集し、多段階のタスクを自律的に解決する能力を持つ。これは、汎用ロボットの実現に向けた大きな一歩となる。

DeepMindが描くロボットAIの新たな地平

Google DeepMindは2025年9月26日、ロボット工学の分野にパラダイムシフトをもたらしうる、新たなAIモデル群を発表した。今回発表されたのは、中核となる「Gemini Robotics 1.5」と、その「頭脳」として機能する「Gemini Robotics-ER 1.5」である。

従来のロボットAIが、人間から与えられた「一つの指示」を忠実に実行することに主眼を置いていたのに対し、今回のアップデートは、ロボット自身が目的を達成するための「計画」を立て、それを自律的に実行する能力、すなわち「エージェント能力」の獲得に焦点を当てている。

Google DeepMindのロボティクス責任者であるCarolina Parada氏は、この進化を次のように語っている。「これまでのモデルは、非常に汎用的な方法で、一度に一つの指示をこなすことに長けていました。今回のアップデートにより、我々は単一の指示から、物理的なタスクに対する真の理解と問題解決へと移行しています」。

この発言が示すように、Gemini Roboticsはロボットを単なる「道具」から、人間と協働する「アシスタント」へと昇華させる可能性を秘めている。

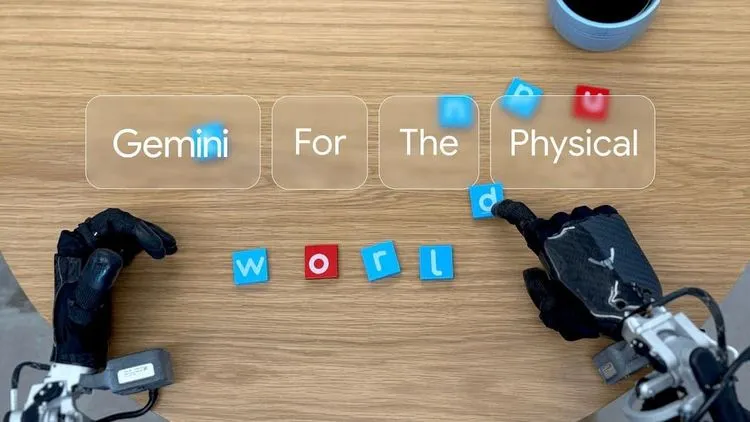

最大の特徴:「思考」と「行動」を司るデュアルモデル

今回の発表で最も注目すべきは、Google DeepMindが採用した「デュアルモデルアーキテクチャ」である。これは、タスクの計画・推論を行う「思考」モデルと、それを物理世界で実行する「行動」モデルを分離させた構成だ。この「役割分担」という考え方は、複雑なシステムを構築する上で極めて有効と言える。

このシステムは、以下の二つのモデルが協調することで機能する。

計画・推論を担う「頭脳」:Gemini Robotics-ER 1.5

「ER」とは「Embodied Reasoning」、すなわち「身体化された推論」を意味する。このモデルは、ロボットの「頭脳」に相当し、直接ロボットの腕や脚を制御するわけではない。その主な役割は、テキストや画像、動画といったマルチモーダルな情報とユーザーの指示を理解し、タスクを達成するための高レベルな計画を立案することにある。

このER 1.5の特筆すべき能力は、必要に応じてGoogle Searchのようなデジタルツールを自律的に呼び出し、外部情報を参照できる点だ。 例えば、「この地域のルールに従ってゴミを分別して」と指示されたロボットは、ER 1.5の機能を使って自身の現在地を特定し、その地域のゴミ分別に関する条例や規則をWebで検索する。そして、検索結果から得られた情報(例:「サンフランシスコでは、青いゴミ箱がリサイクル、緑がコンポスト、黒が埋め立てゴミ」)を理解し、具体的な行動計画を生成するのだ。

これは、単なるパターンに基づいた動作ではなく、状況に応じて情報を収集し、論理的な判断を下すという、より人間に近い問題解決プロセスと言えるだろう。Ars Technica誌が指摘するように、これは「Simulated reasoning(シミュレートされた推論)」であり、人間の意識のような「思考」とは本質的に異なる。 しかし、ロボットの能力を飛躍的に向上させる画期的な仕組みであることは間違いない。

物理世界で実行する「身体」:Gemini Robotics 1.5

Gemini Robotics 1.5は、「VLA(Vision-Language-Action)」モデルであり、ロボットの「身体」を制御する役割を担う。ER 1.5が立案した「スーツケースにロンドンの天気に合わせた服を詰める」といった高レベルな計画は、自然言語の指示としてVLAモデルに渡される。

VLAモデルは、カメラからの視覚情報(Vision)と、与えられた指示(Language)を統合的に理解し、それを具体的な一連の動作(Action)に変換する。 例えば、「セーターをたたんでスーツケースに入れる」という指示に対し、カメラでセーターの位置と形状を認識し、アームをどのように動かせば効率的にたためるかを判断し、実行する。

さらに、Google DeepMindのソフトウェアエンジニア、Kanishka Rao氏によれば、このVLAモデル自身も「think before it acts(行動する前に考える)」能力を備えているという。 これは、ERモデルが立てた大局的な計画の下で、各ステップを実行する際に、より細かい動作レベルでの短期的な思考や微調整を行っていることを示唆している。これにより、予期せぬ小さな変化にも柔軟に対応できる、より頑健な動作が期待できる。

汎用性の飛躍的向上:「学び」の転移と多様なロボットへの対応

今回の発表がロボット業界に与えるもう一つの大きなインパクトは、その驚異的な「汎用性」にある。

異なるロボット間でのスキル転移

従来のロボット開発では、アームの長さや関節の数、手の形状(グリッパー)が異なるロボットごとに、AIモデルを個別にトレーニングしたり、大規模なファインチューニングを施したりするのが常識だった。これは開発コストと時間を増大させる大きな要因となっていた。

しかし、Gemini Robotics 1.5は、この常識を覆す。DeepMindのテストでは、双腕ロボット「ALOHA2」で学習させたスキルが、同じく双腕の「Bi-arm Franka」や、さらには構造が全く異なる人型ロボット「Apptronik Apollo」に対しても、特別なチューニングなしで「ただ機能した(just work)」ことが確認された。

これは、一つのAIモデルが、多様な「身体(Embodiment)」を制御できることを意味する。この「学びの転移」が可能になった背景には、膨大なデータで事前学習されたGemini基盤モデルの持つ高い汎化能力と、様々なロボットの物理空間データを追加で学習させたファインチューニングの成果があると考えられる。これにより、あるロボットが得た経験が、他のすべてのロボットの性能向上に繋がり、学習効率が飛躍的に加速するエコシステムが生まれる可能性がある。

広がるパートナーシップ:エコシステム構築への布石

Google DeepMindが、Apptronik、Boston Dynamics、Agility Robotics、PAL Roboticsといった、業界を代表するロボットメーカーとパートナーシップを結んでいる点も重要だ。 これは、Googleが特定のハードウェアを開発・販売するのではなく、多様なロボットで動作する「頭脳」としてのAIプラットフォームを提供するという戦略を描いていることの現れだろう。

これは、かつてGoogleがAndroid OSを様々なスマートフォンメーカーに提供し、巨大なエコシステムを築き上げた戦略を彷彿とさせる。ロボット業界においても、「Gemini Robotics Inside」のような世界観を目指しているのかもしれない。

Gemini Roboticsが実現するタスクの具体例

今回の発表では、Gemini Robotics 1.5の能力を示す複数のデモンストレーションが公開された。

- Web検索を駆使したゴミ分別: 前述の通り、ロボットが自身の位置情報に基づいて地域のゴミ分別ルールをWeb検索し、プラスチック容器、ブドウの皮、アルミ缶などを、それぞれリサイクル、コンポスト、埋め立てゴミの箱へと正確に分別する。これは、状況に応じて外部知識を獲得し、適応する能力の好例である。

- 天気予報を考慮した旅行のパッキング: ユーザーから「来週ロンドンへ旅行に行くので、荷造りを手伝って」と頼まれた人型ロボットApolloは、まずWebでロンドンの週間天気予報を検索。雨の予報があることを確認すると、「傘もバッグに入れておきますね」と提案し、実際に傘を荷物の中に加える。

- 動的な環境変化への対応: ユーザーが洗濯物を「白物」と「色物」に分けるよう指示した後、意図的に仕分け用のカゴの位置を入れ替える。ロボットは一瞬戸惑うことなく、変更されたカゴの位置を即座に認識し、タスクを正しく続行する。これは、行動の最中にも常に環境を認識し、計画を柔軟に修正する能力を示している。

- 多段階のタスク分解: ユーザーから曖昧な指示を受けた場合でも、それを具体的なステップに分解して実行する。「机の上を片付けて」といった指示に対し、ペンをペン立てに戻し、ノートを閉じ、PCを所定の位置に移動させるといった一連の行動を自律的に計画し、遂行する。

これらの事例は、Gemini Roboticsが単なる動作生成AIではなく、真の「問題解決エージェント」へと進化していることを明確に示している。

汎用ロボットは現実の地平に見えたか

今回の発表からは、いくつかの重要な点が見えてくる。

「事前プログラム」からの脱却というパラダイムシフト

工場の組立ラインで稼働する産業用ロボットは、数十年前から存在した。しかし、それらは非常に限定された環境で、寸分違わず同じ動作を繰り返す「事前プログラムされた機械」であった。少しでも部品の位置がずれたり、予期せぬ障害物があったりすれば、容易にエラーを起こしてしまう。

対して、Gemini Roboticsが目指すのは、家庭やオフィス、店舗といった、常に変化し続ける「構造化されていない環境」で機能する汎用ロボットである。これは、ソフトウェア開発における、決められたロジックを記述する「ハードコーディング」から、データに基づいて振る舞いを学習する「機械学習」への移行と同じ構造のパラダイムシフトが、ロボティクスの世界で本格的に始まったことを意味する。生成AIの持つ汎用性が、ついに物理世界のエージェントにも適用され始めたのだ。

残された課題とGoogleの巧みな戦略

もちろん、汎用ロボットが家庭で活躍する未来はまだ先の話だ。物理世界でのインタラクションには、デジタル空間にはない無数の予測不可能な変数が存在する。滑りやすい床、壊れやすい物体の扱い、人間との安全な協調など、解決すべき課題は山積している。

しかし、今回のAPI提供戦略は非常に巧みである。タスクの計画・推論を行う「頭脳」であるGemini Robotics-ER 1.5は、Google AI Studioを通じて広く開発者に公開される。 一方、ロボットを直接動かす「身体」のGemini Robotics 1.5は、信頼できる一部のパートナーに限定して提供される。

これは、まず「何をすべきか」を考える部分のプラットフォームを広く普及させ、世界中の開発者に多様なロボットアプリケーションのアイデアを探求させる狙いがあるのだろう。その過程で収集されるであろう膨大なユースケースやデータが、いずれ「どのように動くか」を司るVLAモデルのさらなる高度化に繋がる。まずは「頭脳」のエコシステムを確立し、そこから得られる知見で「身体」を磨き上げるという、Googleらしい長期的な戦略が垣間見える。

また、ラインナップに「Gemini Robotics On-Device」モデルが含まれている点も見逃せない。 これは、将来的にインターネット接続が不安定な環境や、リアルタイム性が強く求められるタスクにおいて、ロボット単体で高度な処理を完結させることを視野に入れている証拠であり、汎用ロボットの社会実装に向けた現実的なロードマップの一部と考えられる。

今回の発表は、SFの世界で描かれてきた「自ら考え行動するロボット」が、もはや夢物語ではないことを明確に示した。不確実性の高い物理世界で、AIがどこまで信頼性と安全性を確保できるかという大きな挑戦は続くが、Gemini Robotics 1.5がその挑戦における重要なマイルストーンであることは間違いない。我々の生活空間にロボットが自然に溶け込む未来が、また一歩、現実へと近づいた。

Sources

- Google DeepMind: Gemini Robotics 1.5