フロンティアモデル学習が直面するネットワークのボトルネック

大規模言語モデル(LLM)の規模が指数関数的に拡大する中、計算資源を接続するデータセンターネットワークの性能は、人工知能開発における最も深刻なボトルネックとなっている。世界最高峰のAIモデルを訓練するためには、数万から数十万基のグラフィックス・プロセッシング・ユニット(GPU)が完全に同期して膨大なデータを交換し合う必要がある。この「同期型事前学習」のプロセスにおいて、ネットワークはデータの単純な通り道にとどまらず、巨大な並列計算機を成立させる中核コンポーネントに位置づけられる。

この極端な環境下では、ネットワークの特定のリンクで発生したわずかな渋滞や障害が、クラスタ全体のパフォーマンスに致命的な影響を及ぼす。一つのデータ転送パケットが遅延するだけで、それを受信するGPUだけでなく、同期プロセスに参加するすべてのGPUが待機状態に陥る。こうしたネットワークに起因する待機時間は、高価な計算資源の稼働率を著しく低下させ、数百万ドル単位の経済的損失を学習ジョブにもたらす。

さらに、クラスタの規模が数万基レベルに達すると、ネットワークスイッチや光ケーブルの障害は「まれな事故」ではなく、「常にどこかで発生している定常的な事象」となる。従来のネットワークアーキテクチャでは、単一のリンク障害が発生するたびに、動的ルーティングプロトコル(BGPなど)がネットワーク全体の状態を再計算し、数秒から数十秒の時間をかけて新しい経路を構築していた。この間、AIの学習ジョブはクラッシュを余儀なくされ、保存された直近のチェックポイントからの再スタートを強いられる。

こうした物理的・プロトコル的な限界を抜本的に解決するため、OpenAIは過去2年間にわたり、AMD、Broadcom、Intel、Microsoft、NVIDIAといった業界を代表するハードウェアおよびクラウドベンダーと強固な協業体制を敷いてきた。その技術的結晶として生み出されたのが、新しい通信規格「MRC (Multipath Reliable Connection)」である。

MRCが実装するマルチパス分散と障害回避メカニズム

MRCは、既存のRDMA over Converged Ethernet (RoCEv2) プロトコルを根本から再構築する形で設計されている。従来技術の最大の欠陥は、パケットの到着順序を厳密に保証するために、一連のデータ転送を単一のネットワーク経路(パス)に固定しなければならない点にあった。これにより、特定の経路に大容量のトラフィックが集中し、他の経路が空いているにもかかわらずネットワーク全体が渋滞を引き起こすという構造的な問題を抱えていた。

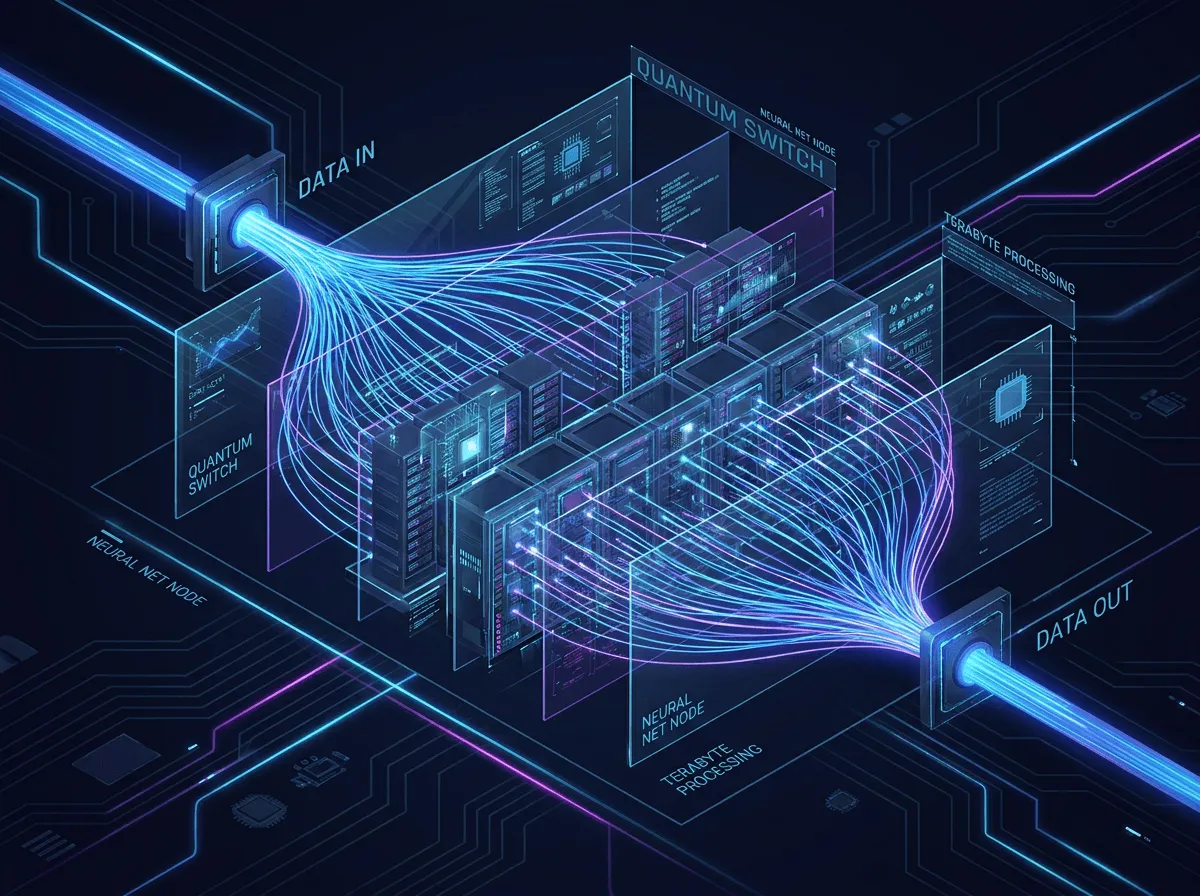

この課題に対し、MRCはデータ転送を単一経路に固定するアプローチを放棄した。一つのコネクションのパケットを数百の異なる経路へ同時に「スプレー(散布)」することで、ネットワーク全体の帯域幅を均等に使い切る手法を採用したのである。パケットは順不同で宛先に到達するが、MRCの各パケットには転送先メモリの仮想アドレスが埋め込まれており、受信側のネットワークインターフェース(NIC)がハードウェアレベルで正確にデータを再配置する。

パケットロスや渋滞への対応も極めて高度化されている。従来のようなPFC (Priority-based Flow Control) による大雑把なトラフィックの一時停止(バックプレッシャー)に依存せず、MRCは「パケットトリミング」と呼ばれる手法を導入した。スイッチが輻輳によってパケットを破棄せざるを得ない場合、ペイロード(データ本体)のみを切り落とし、ヘッダー情報だけを受信側に届ける。これにより、受信側は「どのパケットが失われたか」を瞬時に把握し、送信側へピンポイントでの再送要求(NACK)を発行できる。

さらに画期的なのは、ネットワークの中間スイッチから動的ルーティングの複雑な判断を排除したことである。MRCはIPv6 Segment Routing (SRv6) マイクロセグメントを用いたソースルーティングを活用し、パケットの送信元が経路を完全指定する。スイッチは設定された静的なルーティングテーブルに従ってパケットを転送するだけのシンプルな動作に特化する。仮にある経路で障害が検出された場合、送信元のプロトコルスタックは数マイクロ秒単位でその経路の使用を中止し、他の正常な経路にトラフィックを瞬時に振り替える。この自己完結型の制御ループにより、AI学習ジョブはネットワーク障害を認識することなく計算を継続可能となる。

マルチプレーンネットワークによる物理構成の革新

MRCの導入は、データセンターの論理的なプロトコル改善にとどまらず、物理的なネットワークトポロジ(配線構造)のあり方に劇的な変革をもたらす。これまでの超大規模クラスタでは、損失なくデータを転送するために、800Gb/sクラスの極太の通信パイプを持つネットワーク構築が主流であった。しかし、ポートあたりの通信帯域を太くすると、一つのスイッチが収容できるポート数(ラディックス)が減少する。その結果、数十万基のGPUを接続するためには、ネットワークが3層から4層の深い階層(ティア)を持つ複雑な構造にならざるを得なかった。

MRCは、「マルチプレーンネットワーク」という新しいアプローチでこの物理的制約を回避する。1つの800Gb/sネットワークインターフェースを、例えば100Gb/sの細いリンク8本に論理的に分割し、それぞれを完全に独立した8つの並列ネットワーク(プレーン)に接続する。この設計により、各スイッチのポート密度を最大限に高めることが可能となる。

具体的なハードウェアで想定すると、51.2Tbpsのスイッチング容量を持つ最新チップを用いた場合、800Gb/sのポートであれば64ポートしか提供できないが、100Gb/sであれば512ポートを提供できる。512ポートのスイッチを駆使すれば、約131,000基ものGPUを接続する巨大なファブリックを、わずか2層(ティア0およびティア1)のフラットな構造で構築することが理論上可能となる。

ネットワーク階層が削減されることは、莫大なインフラ投資の圧縮を意味する。設置されるスイッチの総数が減少し、光トランシーバーやケーブルなどの高価なコンポーネント点数も削減される。また、データが通過するスイッチのホップ数が減ることで、通信遅延が低減し、スイッチ全体の消費電力も大幅に削減される。これは、電力供給の制約が厳しい現代のデータセンター運用において決定的な優位性となる。

本番環境での運用実績とハードウェアエコシステムの対応

MRCは実験室内のプロトタイプではなく、既に世界で最も過酷な本番環境で稼働している実証済みの技術である。OpenAIの最新のフロンティアモデル(ChatGPTやCodexの次世代基盤)の訓練においては、テキサス州アビリーンにあるOracle Cloud Infrastructure (OCI) の「Stargate」スーパーコンピュータや、Microsoftが構築した「Fairwater」クラスタといったNVIDIA GB200ベースの環境で、MRCがトラフィック制御の要を担っている。

OpenAIの運用データが示す成果は極めて明確である。実際のモデル学習中に、ネットワーク保守のためにティア1スイッチを再起動したり、ケーブルの物理的な切断が発生したりといった深刻な障害シナリオにおいても、MRCは即座にトラフィックを別のプレーンへ迂回させた。結果として、学習プロセスを一時停止するためのオペレーション連携は不要となり、ジョブ自体は何事もなかったかのように継続された。一時的な帯域減少による軽微なパフォーマンス低下は観測されたものの、システム全体のクラッシュという最悪の事態は完全に回避されている。

このプロトコルを実社会のインフラに落とし込むため、ハードウェアエコシステム側の対応も急速に進展している。NVIDIAは自社のSpectrum-X EthernetプラットフォームおよびConnectX SuperNICにおいてMRCをネイティブサポートしており、ハードウェアレベルの極低遅延でマルチプレーン負荷分散と障害迂回を実行している。

Broadcomは、800Gb/s対応のThor Ultra NICに搭載されたNPL (Network Programming Language) のプログラマビリティを活用し、MRCの高度な受信者主導型輻輳制御やパケットトリミングをハードウェアに実装している。また、Tomahawk 5およびTomahawk 6スイッチファミリでは、この複雑なマイクロセグメント処理とトリミング機能を全ポートでラインレート処理する能力を提供している。

AMDも仕様策定の初期段階から深く関与しており、Pensando Pollara 400 AI NICを通じた事前検証を経て、現在は800Gb/sのVulcano AI NICへとMRCの技術を統合している。同社の高いプログラマビリティにより、規格が固まる前の試行錯誤の段階でプロトコルの有効性が迅速に実証された。

業界標準化がもたらすAIインフラの将来像

これほど高度に最適化された独自プロトコルは、往々にして特定ベンダーのクローズドなエコシステムに囲い込まれる運命にある。しかし、OpenAIと協業企業群は、MRCの仕様をOpen Compute Project (OCP) を通じて完全なオープンソース仕様として公開する道を選択した。この決断の背景には、AI向けのEthernetインフラを一部の巨大テック企業だけの特権から、業界全体の共有財産へと昇華させるという明確な意図がある。

データセンター業界では現在、Ultra Ethernet Consortium (UEC) が次世代のAI向けトランスポートプロトコルの策定を大規模なコンソーシアム体制で進めている。UECが通信プロトコルを根本から新しく設計し直す「クリーン・スレート(白紙からの)」アプローチを取っているのに対し、MRCは既存のVerbs APIとRoCEv2インフラに対する互換性を維持しつつ、致命的な欠陥のみを取り除く現実的なアプローチを採用している。これは、今まさに稼働中のAIファクトリーの要求に即応するための処方箋として機能している。

さらに、MRCのアーキテクチャは「ホスト主導型」のネットワーク制御という新しいパラダイムをもたらす。従来、インフラを借りてAIモデルを学習するテナント企業は、基盤となるネットワークスイッチのルーティングアルゴリズムに介入することは不可能であった。しかし、MRCは経路選択の権限をエンドポイントであるNIC側に移譲するため、OpenAIのようなAI企業は、自社のワークロードに最適なルーティング戦略や障害対応ポリシーを、インフラ所有者に依存することなく独自に定義し実行できるようになった。

パラメータ数が数兆規模に達する次世代モデルの開発競争において、計算ユニットを接続するネットワークの信頼性と効率は、勝敗を分ける最大の差別化要因となりつつある。MRCのオープン標準化は、ベンダーロックインを回避しながらも、ギガスケールのAIインフラにおける「AIネイティブなEthernet」のあり方を明確に提示しており、今後のデータセンター設計の標準的な青写真となることが確実視されている。