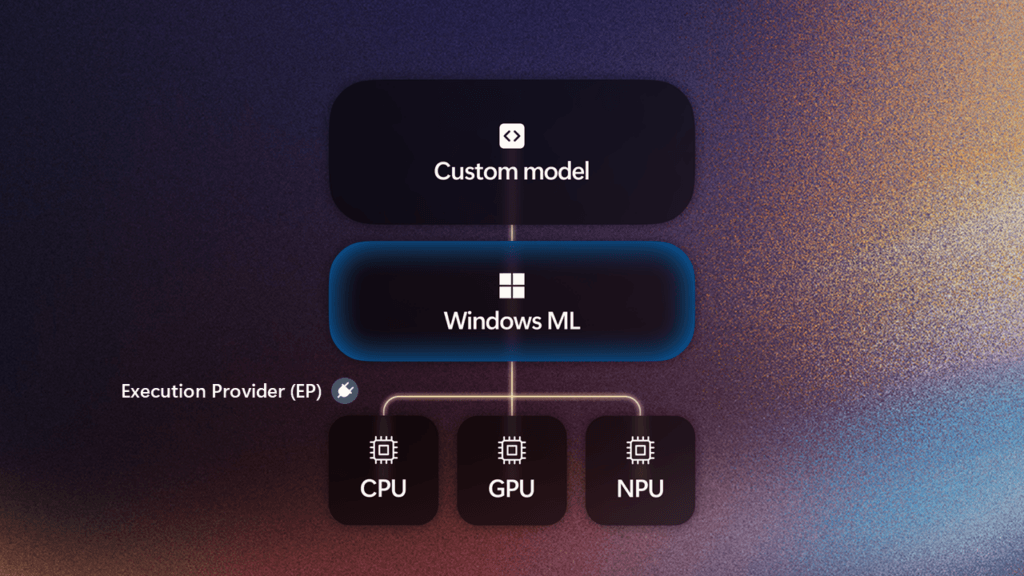

Microsoftは、2025年5月の開発者会議「Build 2025」でそのベールを脱いだAI開発基盤「Windows ML」を、Windows 11 24H2を対象とする全ての開発者に向けて一般提供 を開始したと発表した。 これは、開発者がローカルデバイス上でAIモデルを効率的に実行するためのランタイムと、ハードウェアの違いを吸収する抽象化レイヤーを提供するものだ。CPU、GPU、そしてAI処理に特化したNPUといった多様なプロセッサーをOSレベルでシームレスに連携させるこの仕組みは、来るべき「AI PC」時代におけるWindowsのエコシステムを盤石にする、Microsoftの野心的な戦略の核心と言える。

AIアプリ開発の「ハードウェアの壁」を破壊する一手

これまで、Windows上で動作するAIアプリケーションの開発には、目に見えない高い壁が存在した。それは、PCに搭載されているプロセッサーの多様性だ。Intel、AMDが開発するx64アーキテクチャのCPUやGPU、NVIDIAの高性能なディスクリートGPU、そしてQualcommのArmベースSoC「Snapdragon X Elite」に搭載されるNPUなど、ハードウェアの選択肢は多岐にわたる。

開発者がAI機能の性能を最大限に引き出すためには、これらの異なるハードウェアアーキテクチャそれぞれに最適化したコードを個別に用意する必要があった。 これは開発コストと時間を増大させるだけでなく、特定のハードウェアを持たないユーザーがAI機能の恩恵を受けられないという「分断」を生み出す原因ともなっていた。

今回一般提供が開始されたWindows MLは、この根深い課題に対するMicrosoftの明確な回答である。Windows MLは、OSとアプリケーションの間に介在する「翻訳者」のような役割を担う。アプリケーション開発者は、Windows MLが提供する統一されたインターフェース(API)に対して命令を出すだけでよい。あとはWindows MLが、そのPCに搭載されているハードウェア構成を自動的に認識し、AIの計算処理(「推論」と呼ばれる)を最も効率的に実行できるプロセッサーに適切に割り振ってくれるのだ。

これにより、開発者はハードウェアの差異を意識することなく、一度の開発で多種多様なWindows PC上で最適に動作するAIアプリケーションを構築できる。これは、WindowsというプラットフォームにおけるAI開発の民主化であり、エコシステム全体の活性化を狙った戦略的な一手であることは間違いない。

なぜ今「オンデバイスAI」が重要なのか?

Windows MLが目指すのは「オンデバイスAI」の普及だ。これは、AIの処理がクラウド上の巨大なサーバーではなく、ユーザーの手元にあるPCやスマートフォンの内部で完結することを意味する。これまで多くの生成AIサービスがクラウドを基盤としてきたが、オンデバイスAIにはそれを補って余りある、決定的な利点が存在する。

- プライバシーの保護:

最も重要な利点の一つがプライバシーだ。カメラの映像、マイクの音声、個人的な文書といった機密性の高いデータをデバイスの外部に送信することなくAI処理できるため、情報漏洩のリスクを根本から断ち切ることができる。 - 速度(低遅延):

クラウドとのデータ通信が不要になるため、処理の応答速度が劇的に向上する。ビデオ会議でのリアルタイム背景ぼかしやノイズ除去、ライブ翻訳、あるいはアートフィルターの適用といった、瞬時の応答が求められる機能において、その真価を発揮する。 - コストと接続性:

クラウドサーバーの利用料金が発生せず、インターネット接続がないオフライン環境でもAI機能を利用できる。これにより、飛行機の中や通信環境の悪い場所でも、高度なAIアシスタント機能などを活用することが可能になる。

Microsoftが「Copilot+ PC」という新たなPCカテゴリを提唱し、高性能なNPU(Neural Processing Unit)の搭載を推進している背景には、こうしたオンデバイスAIの利点を最大限に活かすという明確な意図がある。Windows MLは、このCopilot+ PCの心臓部となるNPUを、CPUやGPUと並ぶOS管理下のコンピューティングリソースとして統合し、アプリケーションから透過的に利用可能にするための技術的な土台なのだ。

Windows MLの心臓部:ハードウェア抽象化の仕組みを分解する

Windows MLが容易に異なるハードウェアを使い分けることができる背景には、いくつかの重要な技術要素が組み合わさっている。その仕組みを紐解くことで、Microsoftの技術的な工夫が見えてくる。

HONNX Runtimeが支えるモデルの互換性

Windows MLの基盤となっているのは、Microsoftが主導して開発したオープンソースの推論エンジン「ONNX Runtime」である。 AIモデルは、GoogleのTensorFlowやMetaのPyTorchなど、様々なフレームワークを用いて開発されるが、それぞれが独自のデータ形式を持っている。ONNX (Open Neural Network Exchange)は、これらの異なるフレームワークで作られたモデルを共通の形式に変換するための標準規格だ。

Windows MLがONNX Runtimeをベースとしていることで、開発者は特定のフレームワークに縛られることなく、幅広いAIモデルをWindowsアプリケーションに統合できる。これは、多様なAI研究の成果を迅速にWindowsエコシステムに取り込むための、戦略的な布石と言えるだろう。

「実行プロバイダー(EP)」を動的に割り当てる賢さ

Windows MLの最も革新的な側面は、「実行プロバイダー(Execution Provider, EP)」の管理方法にある。EPとは、特定のハードウェア(IntelのCPU、NVIDIAのGPU、QualcommのNPUなど)上でAIモデルの演算を最適に実行するための、いわば専門ドライバのようなソフトウェア部品だ。

従来の開発では、考えられる全てのハードウェアに対応するため、複数のEPをアプリケーション本体に同梱(バンドル)する必要があった。 これではアプリケーションのファイルサイズが肥大化し、ユーザーのストレージを圧迫してしまう。

Windows MLはこの問題を根本的に解決する。OSはPCに搭載されているハードウェアを常に把握しており、アプリケーションがAI処理を要求した際に、そのハードウェアに最適なEPがシステムに存在しない場合、Microsoftのサーバーから動的にダウンロードしてインストールする。 EPはOSから独立して更新されるため、ハードウェアベンダーが新たな最適化をリリースすれば、アプリケーションを更新することなく、ユーザーは常に最新のパフォーマンスを得られる。

この仕組みにより、開発者はアプリ本体にEPを含める必要がなくなり、アプリケーションのダウンロードサイズとインストールサイズを劇的に削減できるという、大きな恩恵を受ける。

CPU、GPU、NPUのシームレスな連携

Windows MLは、PCに搭載された3種類の主要プロセッサーを、それぞれの特性に応じてインテリジェントに使い分ける。

- CPU (Central Processing Unit): 汎用的な処理を得意とし、幅広い互換性を持つ。AI処理の柔軟な実行を保証する最後の砦となる。

- GPU (Graphics Processing Unit): 本来は画像処理のために設計されたが、その膨大な数のコアによる並列計算能力がAIの行列演算に極めて適している。高いパフォーマンスが要求されるタスクで活躍する。

- NPU (Neural Processing Unit): AIの推論処理に特化して設計されたプロセッサー。ニューラルネットワークの計算を極めて低い消費電力で実行できるのが最大の特徴。常時起動するようなバックグラウンドのAIタスクに適している。

開発者は、例えば「省電力性を優先する」あるいは「最高のパフォーマンスを求める」といった抽象的な目標をWindows MLに伝えるだけでよい。 あとはWindows MLが、現在のPCの負荷状況やバッテリー状態なども考慮しながら、タスクに最も適したプロセッサーへ自動的に処理を割り振る。この高度なハードウェア抽象化こそが、Windows MLの真骨頂なのである。

開発者とユーザーにもたらされる具体的な恩恵

Windows MLの一般提供開始は、開発者とエンドユーザーの双方に具体的かつ大きなメリットをもたらす。

開発者にとっては、前述の通り、ハードウェアの多様性を意識する必要がなくなることによる開発工数の大幅な削減が最大のメリットだ。 Windows App SDKの一部として提供されるため、既存のWindowsアプリケーションにも比較的容易にAI機能を組み込める。 これにより、これまでAI開発に踏み出せなかった中小規模の開発者や個人開発者にも、新たなチャンスが広がるだろう。

一方、ユーザーは、より多くのWindowsアプリケーションで、高速かつプライバシーに配慮されたAI機能の恩恵を受けられるようになる。Microsoftによれば、既にAdobe、McAfee、Topaz Labs、Wondershareといった著名なソフトウェアベンダーがWindows MLの採用を進めている。 例えば、画像編集ソフトであれば、被写体の切り抜きやノイズ除去といった処理がオフライン環境でも瞬時に完了するようになる。セキュリティソフトであれば、不審な挙動を検知するAIモデルがデバイス上で常に動作し、プライバシーを守りながら保護を強化できる。

AI PC時代のOS覇権を巡るMicrosoftの深謀

Windows MLの一般提供開始は、単なる一技術のリリースに留まらない、より大きな戦略的意味合いを持つと見られる。これは、次世代のパーソナルコンピューティング、すなわち「AI PC」時代におけるOSの主導権を巡る、競争の幕開けと見ることも出来るだろう。

Apple「Core ML」、Google「Android NNAPI」との三つ巴の戦い

オンデバイスAIのためのフレームワークを提供するという試みは、Microsoftが初めてではない。AppleはiOSとmacOS上で「Core ML」を、GoogleはAndroid上で「Neural Networks API (NNAPI)」をそれぞれ展開し、自社エコシステム内でのAI実行環境を整備してきた。

しかし、Microsoftが対峙する現実は、AppleやGoogleよりも遥かに複雑だ。Appleは自社設計のApple Siliconにハードウェアを統一することで、Core MLの最適化を容易にしている。一方、Windowsの世界は、Intel、AMD、NVIDIA、Qualcommなど、多数のハードウェアベンダーが競い合う、良くも悪くも「多様性」の坩堝(るつぼ)である。

Windows MLは、このWindowsエコシステムの「弱み」とも見えた多様性を、「強み」へと転換させるための戦略的ツールである。あらゆるハードウェアベンダーを巻き込み、その違いをOSレベルで吸収する共通のレイヤーを提供することで、Appleの垂直統合モデルとは異なる、オープンなAIエコシステムのデファクトスタンダードを確立しようという野心が透けて見える。

「Windows AI Foundry」構想とエコシステム戦略

Microsoftの資料によれば、Windows MLは「Windows AI Foundry」と呼ばれる、より広範なAIプラットフォーム構想の基礎を成すものと位置づけられている。 これは、Windows MLという低レベルの実行基盤の上に、一般的なタスク向けの組み込みAIモデルや、すぐに利用できるAIモデルを集めたライブラリなどを提供し、開発者がAIをより簡単に利用できる環境を階層的に整備していく構想だ。

これは、ハードウェアメーカーからアプリケーション開発者に至るまで、Windowsに関わる全てのプレイヤーを巻き込み、WindowsをAI開発と実行の中心地へと押し上げようとする壮大なエコシステム戦略に他ならない。成功すれば、開発者は「まずWindows向けにAIアプリを開発する」ことが最も合理的となり、ユーザーは「AI機能を使いたいならWindows PCを選ぶ」という強力なサイクルが生まれるだろう。

残された課題と未来展望

もちろん、その道のりは平坦ではない。Windows MLが直面するであろう課題も存在する。

最大の課題は、多様なハードウェア上で一貫したパフォーマンスと安定性を保証することだ。特定のEPとモデルの組み合わせで予期せぬ不具合が発生したり、性能が想定よりも伸び悩んだりする可能性は常に存在する。Microsoftと各ハードウェアベンダーとの継続的かつ緊密な連携が、この課題を克服する鍵となるだろう。

また、オンデバイスで実行されるAIモデル自体のセキュリティも新たな論点となる。悪意のある者がモデルを改ざんしたり、モデルの挙動から機密情報を盗み出したりするような攻撃に対する防御策も、今後重要になってくるはずだ。

とはいえ、Windows MLがWindowsプラットフォームの未来にとって、極めて重要な一歩であることは疑いようがない。これまでクラウドの専売特許と見なされてきた高度なAI機能が、OSの標準機能として、あらゆるアプリケーションから当たり前のように呼び出される時代がすぐそこまで来ている。

Windows MLの一般提供開始は、その新しい時代の扉を開いた。今後、この強力なツールを手にした開発者たちが、我々の想像を超えるどのような革新的なAIアプリケーションを生み出していくのか。本当のAI PC革命は、まさに今、始まったばかりなのである。

Sources