私たちが生きるデジタル空間において、「速さ」は常に絶対的な善とされてきた。クリックして即座に開くウェブページや、コンマ1秒の遅延すら許されないオンラインゲームの世界において、人類は過去数十年にわたり、システム応答時間という目に見えない壁と戦い、待ち時間を削り落とすことに巨額の資本と知恵を注ぎ込んできた。しかし、相手が単なるファイルサーバーではなく、人間のように言葉を紡ぐ人工知能となったとき、この強固な速度至上主義のパラダイムは奇妙な軋みを上げ始める。重い人生相談や複雑な企画の壁打ちをAIに持ちかけた際、エンターキーを叩いた瞬間に長文の回答が返ってきたらどう感じるだろうか。優秀さを称える前に、自分の質問の真意を本当に理解してくれたのかというかすかな疑念が頭をもたげるはずだ。バルセロナで開催されたヒューマン・コンピュータ・インタラクション分野の最高峰国際会議「ACM CHI 2026」において、ニューヨーク大学(NYU)Tandon工科大学院の研究チームは、このパラドックスの正体を暴く研究結果を発表した。彼らは、AIの応答速度を意図的に操作した大規模な実験を通じ、待ち時間が私たちのAIに対する評価を根底から歪めている事実を証明した。本記事では、この研究が突きつける機械と人間の間に流れる時間の意味について見ていきたい。

速度の神話と、知性という名のブラックボックス

コンピュータサイエンスの歴史において、システムの応答時間はユーザー体験を決定づける中核的な指標であった。1960年代のRobert Millerによる先駆的な研究から、1990年代のJakob Nielsenによるユーザビリティの原則に至るまで、古典的な教義では0.1秒以内の応答は直接操作している感覚を与え、1秒以内の遅延はユーザーの思考の流れを途切れさせない限界とされ、10秒を超えるとユーザーは注意を失い別の作業に移ると定義されてきた。これらの法則は、マウスのクリックやファイルのダウンロードといった、入力に対して結果が常に一定である決定論的なシステムにおいて、長らく絶対的な基準とされてきた。

しかし、大規模言語モデルの台頭は、この前提を根底から揺さぶっている。ChatGPTやClaudeのようなAIは、確定したデータを引き出すのではなく、文脈に応じて確率的な推論を行いながら言葉を一つひとつ生成していく。このブラックボックス化されたプロセスに直面したとき、ユーザーは無意識のうちにAIを擬人化し、人間同士のコミュニケーションにおける暗黙のルールを適用し始める。想像してほしい。高級レストランで熟練のソムリエに、自分の好みや今日の料理に合わせたワインの選定を頼んだとする。ソムリエが言葉を終えるや否や、食い気味に一本のボトルをテーブルに置いた場合、たとえそれが完璧なチョイスであったとしても、真剣に考えてくれたのかと拍子抜けしてしまうはずだ。逆に、数秒間顎に手を当ててセラーの奥を思い浮かべるような沈黙の時間が介在すれば、そのワインの価値は何倍にも跳ね上がる。NYUの研究チームが目を付けたのは、まさにこの人間特有の「努力ヒューリスティック」がAIとの対話においてどう作用しているかという点だった。人が結果そのものと同じくらい、そこに費やされたプロセスや労力を評価する心理的傾向は、機械に対しても発動するのかという壮大な問いである。

思考を計る時計:240人を対象にした時間と知覚の実験

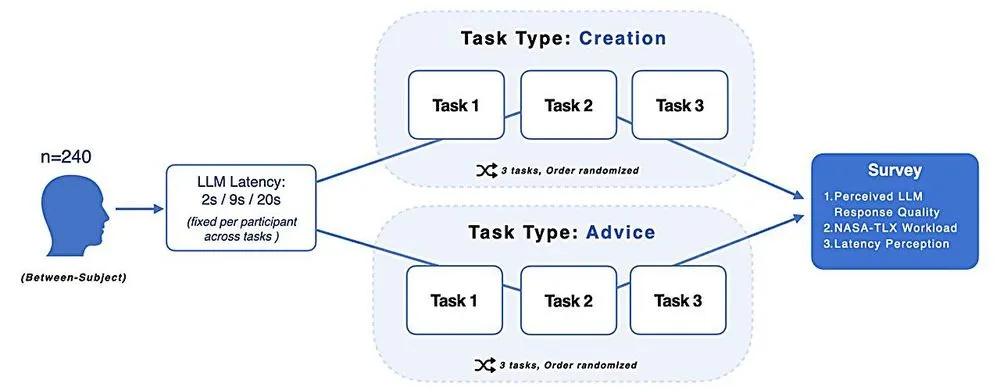

研究チームは、AIの待ち時間がユーザーの実際の行動と主観的な評価にどのような影響を与えるかを切り分けて分析するため、精緻なコントロール環境を構築した。米国の一般ユーザー240人を対象に、背後でGPT-4oが稼働するカスタムインターフェースを提供し、参加者を大きく2つのタスク群と3つの応答速度群に無作為に割り当てた。

用意されたのは、知的なナレッジワーカーが日常的に直面する2つの相反するタスクである。一つは「創造」。新しい教育プラットフォームのキャッチコピー作りや、集中できない高校生のための学習活動のブレインストーミングなど、ゼロからアイデアを広げていく発散型の作業だ。もう一つは「助言」。在宅勤務で集中できない同僚へのアドバイスや、転職の意思決定を評価するメモの査読など、正確性や客観的評価が求められる収束型の作業である。そして、この実験の最大の仕掛けは、最初の文字が表示されるまでの待機時間を強制的に操作したことにある。研究チームは背後のAPIを制御し、ユーザーがプロンプトを送信してから最初の文字が出現するまでの時間を意図的に2秒、9秒、20秒の3段階に固定した。最初の文字が出現した後のテキスト生成速度は一定に保たれている。

これほど極端な遅延を組み込んだ場合、10秒で注意が散漫になるという古典的なユーザビリティの法則に従えば、20秒待たされるユーザーは苛立ち、プロンプトの送信をためらい、行動を大きく変容させるはずである。しかし、記録されたシステムログが弾き出した事実は、研究者たちの予想を完全に裏切るものだった。

沈黙は行動を変えない。手数を決めるのはタスクの性質

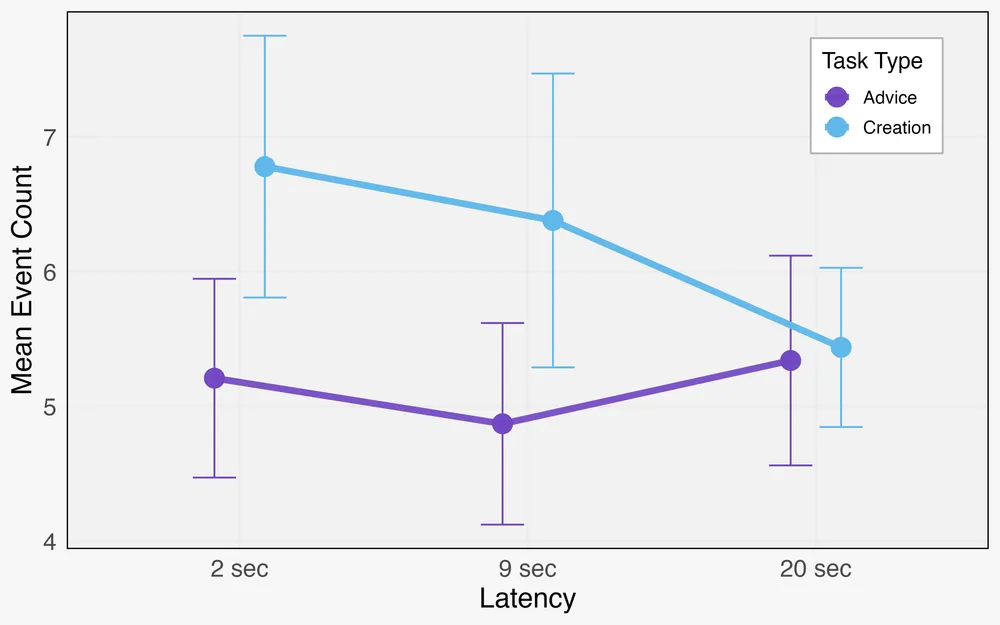

ログデータの解析によって明らかになった第一の発見は、応答速度の違いがユーザーの操作行動にほとんど影響を与えないという驚くべき事実である。回答に2秒しかかからない軽快なAIを使っていたグループも、20秒という重苦しい沈黙を強いられたグループも、新しくプロンプトを送信する回数や、出力をコピー&ペーストする頻度、回答を再生成させる割合に統計的な有意差は見られなかった。待たされる時間が長いからといって、一度のプロンプトで完璧な指示を出そうと画策したり、対話を早めに切り上げようとしたりする保守的な戦略をとるユーザーは極めて稀だった。ユーザーの行動を明確に支配していたのは、時計の針ではなくタスクの性質だった。

タスクの種類とレイテンシごとのプロンプト送信回数を示すグラフ。創造系タスクに取り組んだ参加者は、助言系タスクに取り組んだ参加者に比べて、レイテンシの長さに関わらず一貫して多くのプロンプトを送信していることが分かる。 (Credit: Felicia Fang-Yi Tan, Moritz Alexander Messerschmidt, Wen Yin, and Oded Nov. 2026. The Impact of Response Latency and Task Type on Human-LLM Interaction and Perception. In Proceedings of the 2026 CHI Conference on Human Factors in Computing Systems (CHI '26). DOI: 10.1145/3772318.3790716)

データは残酷なほど明確なコントラストを描き出している。創造タスクを課されたグループは、1人あたり平均6.20回のプロンプトを送信したのに対し、助言タスクのグループは平均5.14回にとどまった。この結果は、人間の知的生産活動の構造を考えれば十分に説明がつく。創造とは、手元にある粘土をこねて新しい形を際限なく探り続ける作業だ。AIが提示したアイデアに対し、もっとエッジを効かせてほしい、別の切り口で提案してほしいと要求を重ねるたびに、新たなインスピレーションが生まれる。一方、助言は裁判官が判決を下すプロセスに似ている。必要な証拠や的確な視点が十分に出揃ったと判断した時点で、それ以上の対話は無用になる。待つことのコストは、新しいアイデアを探求したいという人間の知的好奇心や、タスクを完遂するという目的意識の前では、行動を変えるほどの致命的な障壁にはならなかったのである。この点は、AIインターフェースを設計する開発者にとって、インフラのサーバー負荷やトークン消費量の予測モデルを根本から見直す必要性を提示している。

9秒のタメが醸し出す知性の錯覚と心理的バイアス

行動を変えなかった待機時間は、何を変えたのか。それは人間の知覚という極めて主観的で脆い領域である。事後のアンケートでAIの出力品質を評価させた結果、従来のシステム設計の常識を完全に破壊するデータが示された。驚くべきことに、わずか2秒で即答するAIの回答は、9秒や20秒待たされた後に返ってくる回答よりも、思慮深さや有用性という項目において一貫して低く評価されたのだ。出力している中身は本質的に同等の質であるにも関わらず、人間の脳は時間がかかった回答の方を無意識に高く評価してしまっている。

研究チームはこの現象を詳細に分析し、参加者の約31パーセントが待機時間をAIが推論を行っている時間として肯定的に解釈していた事実を見出した。彼らにとって9秒という時間は、システムが計算リソースを浪費しているダウンタイムではなく、自分の複雑な要求に対してAIが懸命に知恵を絞っている証として映ったのだ。2秒の即答は、軽薄な反射神経や既存テンプレートの流用と受け取られ、アウトプットの価値が割り引かれて評価されるリスクを抱える。一方で9秒の適度なタメは、熟考のパフォーマンスとして受け取られ、努力ヒューリスティックが最大限に機能するスイートスポットとなる。

このポジティブ・フリクションと呼ばれる概念は、適切なタイミングで差し込まれるわずかな摩擦が、かえってユーザーの思考を深め、結果に対する価値を高めることを意味している。しかし、この魔法には限界がある。20秒の遅延群では、依然として評価自体は2秒群より高かったものの、定性的なコメントには待つ価値がある内容だったから許せたがインターネットが切断されたのかと不安になったという声が混じり始めた。過度な摩擦は、知性のタメというポジティブな枠組みを超え、システムの故障に対する不信感へと反転する境界線に達してしまうのだ。さらに、作業の文脈から外れてしまうほどの長い空白は、集中力を維持する上での認知的な負荷を別の形で強いることになり、結果的にユーザーの離脱を招く引き金となり得る。

パフォーマティブな熟考が突きつける倫理的ジレンマ

この発見は、テクノロジー業界全体に極めて重厚な社会的な文脈を接続する。現在、OpenAIのo1モデルなどに代表される推論特化型システムは、複雑な推論チェーンを背後で実行するため、出力までに数十秒から数分の時間を要する。利用者は、待たされる分だけ賢い回答が返ってくるという新たなメンタルモデルを形成しつつある。しかし、NYUの研究が暴き出した真の懸念はここから始まる。もしユーザーが、時間がかかるシステムは思慮深く高品質であると錯覚してしまうのであれば、システム設計者は、AIの応答に意味のない偽の遅延を組み込むだけで、自社のAIモデルをより賢く信頼できるように見せかけることが可能になる。

これはパフォーマティブな熟考、あるいは善意の欺瞞と呼ばれるユーザーインターフェース上のダークパターンに直結する。人間が医療の意思決定や金融の投資判断をAIに委ねる時、AIが意図的に仕組んだ10秒間の沈黙によって、その出力結果を無批判に信じ込んでしまう危険性が高い。本来であれば客観的な事実確認に向かうべき人間の批判的思考が、AIが演出した擬似的な態度の前で武装解除されてしまうのだ。システムの透明性を担保するためには、その待機時間が実際の演算処理によるものなのか、それともUXを向上させるための意図的な演出なのかを明確にするガイドラインの整備が急務となる。

さらに本研究は未踏のリサーチギャップも残している。今回の実験では、待機中に考えていますといった画面上のプログレス表示をあえて排除し、純粋な時間そのものの影響を測定した。現実のプラットフォームが採用している多様なUIの視覚的要素が介在した場合、この時間の魔法がどのように増幅されるのか。また、実社会の過酷なマルチタスク環境において、ユーザーがAIの遅延を別の作業をするための好機としてどう組み込んでいくのかは、今後の重要な検証課題である。速さは人間の認知の脆弱性を突く心理的なパラメーターへと変貌を遂げており、私たちはテクノロジーがデザインする時間の中で、いかにして批判的な理性を保ち続けるかという新たな試練に直面している。システムをどれだけ速くできるかという技術的な競争の裏側で、その沈黙に私たちが何を投影してしまうのかという人間の認知構造への深い洞察が、これからのAI開発における最大の焦点となるはずだ。

論文

- 2026 CHI Conference on Human Factors in Computing Systems: The Impact of Response Latency and Task Type on Human-LLM Interaction and Perception

参考文献

- TechXplore: Why faster AI isn't always better