生成AIの進化が「エージェント型(自律型)AI」という新たな局面を迎える中、グローバルなデータセンターのハードウェア構成に劇的かつ不可逆的な構造変化が生じている。2026年に入り、AIインフラの主役はGPU単体での「学習特化型」の構成から、複雑な推論タスクやデータベース検索を持続的に担う「CPUの中核的配置」へと急速に回帰し始めた。このパラダイムシフトは、過去数年間にわたるGPU偏重の市場トレンドに冷や水を浴びせるかのように、ハイエンドサーバー向けCPUの深刻な供給不足と異例の価格高騰を引き起こしている。

エージェント型AIが要求する新たなコンピューティングバランス

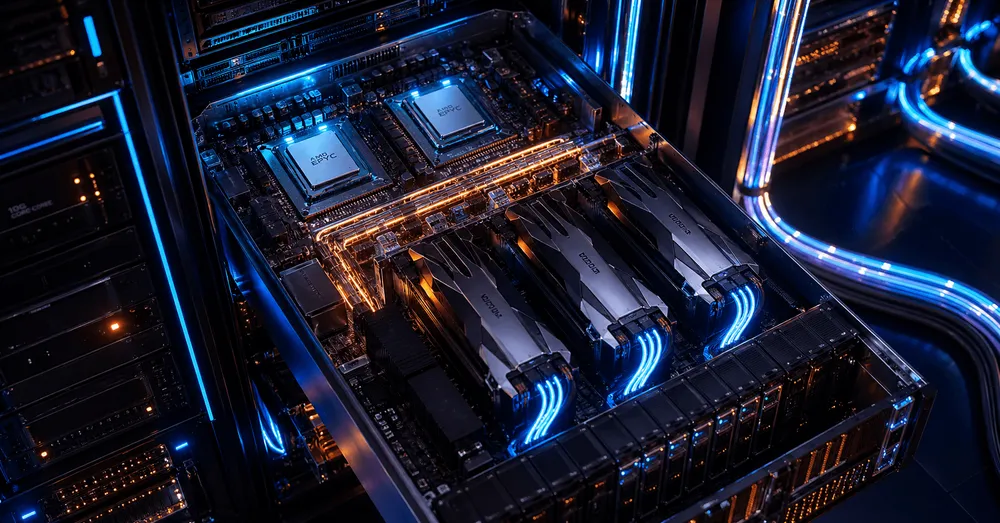

これまでの生成AIブームは、基礎となる大規模言語モデルの「学習(Training)」フェーズによって牽引されていた。この段階では、膨大なパラメータと学習データを並列処理できるGPUが圧倒的な優位性を誇り、サーバーラック内のCPU対GPUの構成比率は1対8が業界標準であった。この構成において、CPUは各GPUへのデータの受け渡し、ネットワークのパケットロス管理、あるいは基本的なOSの実働といった管理タスクに甘んじており、インフラ投資の大部分はNVIDIAなどのAIアクセラレータに極端に集中していた。

現在進行形で市場を席巻している「Agentic AI(エージェント型AI)」の普及は、この開発の前提を根底から覆している。エージェント型AIは、単純なプロンプトへのテキスト出力を超えたシステムである。自律的に複数のタスクを切り分け、外部ツールを呼び出し、データベースから情報を取得して文脈を動的に構築する。この一連の「推論(Inference)」とオーケストレーションのプロセスにおいて、RAG(Retrieval-Augmented Generation)を用いた大規模なベクター検索や複雑なツリー探索、緻密なロジック処理といった直列的かつ条件分岐の多いタスクが大量かつ継続的に発生する。

これらは、単純な行列演算の並列化に特化したGPUのアーキテクチャには極めて不向きである。GPUは条件分岐に弱く、外部情報のフェッチを待機している間にコンピュートユニットがアイドル状態に陥るという致命的なボトルネックを抱えやすい。高いシングルスレッド性能、投機的実行に最適化された大容量のキャッシュ、そして強力な分岐予測機構を備えたCPUが、エージェンティック・システムの処理全体におけるクリティカルパスとして再び浮上したのである。

劇的に変化するサーバー構成:1対8から1対1へのパリティ移行

Intelが2026年第1四半期の決算説明会でCFOのDavid Zinsner氏を通じて明らかにしたデータは、需要構造の逆転を客観的かつ如実に示している。新規のAIワークロード向けサーバー展開において、CPUとGPUの導入比率は従来型の1対8からすでに1対4へと急速に移行している。推論およびエージェンティックワークロードの増大に伴い、この比率が最終的に1対1の完全なパリティに到達すると同社は予測している。

同一規模のGPUファームを稼働させて推論パフォーマンスを最大化するためには、従来の最大8倍ものサーバーCPUをデータセンター内に敷き詰める必要がある。「CPU需要はAIの総アドレス指定可能市場において極めて重要な要素になりつつある」というIntel側の発言は、インフラ設計の物理的な制約から生じる深刻な見解である。

競合企業もすでにこのCPU回帰の波に戦略的布石を打っている。NVIDIAは独立型の「Vera CPU Rack」を発表し、自社のGraceアーキテクチャを用いたCPU展開を加速させている。Arm陣営も自社設計の「AGI CPU」を市場に投入し、空冷と液冷の両バリアントを備えたCPUラック構成を披露することで、巨大な推論市場へ正式に参入した。AIモデルの開発を支える基盤が学習から推論へと移る中で、推論フェーズにおけるCPUの支配力拡大は疑いようのないトレンドとなっている。

サプライチェーンを直撃する需要爆発と深刻化する価格高騰の連鎖

AIワークロードにおける需要爆発は、即座にグローバルな半導体サプライチェーンに強烈な負荷をかけ、価格体系を破壊し始めている。台湾のサプライチェーン動向を報じるCTEEやODM企業からのデータによれば、2026年3月時点でコンシューマー向けCPUの価格は前月比で5%から10%、需要がより逼迫しているサーバー向けCPUに至っては10%から20%という劇的な価格急騰を記録した。

価格高騰の背景には、供給側の物理的な製造ノードの限界という複雑な要因が絡み合っている。ハイエンドサーバーCPUは、TSMCを中心とするファウンドリの最先端プロセス(2nmおよび3nmノード)に大きく依存している。これらの最新製造ラインは、既存のGPU、専用のカスタムAIアクセラレータ、フラグシップスマートフォン向けSoCからのオーダーですでに飽和状態にある。最先端ノードにおけるウェハーの奪い合いが激化する中、急増するサーバーCPUの受注を残されたキャパシティでカバーすることは物理的に不可能に等しい。

IntelやAMDといったプロセッサ・ベンダーは、バックエンドのパッケージングを含めた生産能力の制約から、需給バランスの崩れを価格に転嫁せざるを得ない状況に直面している。サプライチェーンの分析によると、両社は2026年の第2四半期および第3四半期にさらなる価格引き上げを予定しており、一部のSKUにおいては年間での累計値上げ幅が16%から17%に達する見通しである。

Intelがすでに限られた生産リソースを再配分している点は特に市場へ大きな影響を与えている。同社はコンシューマー向けプロセッサのウェハー生産枠を大幅に削減し、粗利益率が高く戦略的に重要なサーバー向け「Xeon」ラインアップの生産へとリソースを強制的にシフトさせている。この決断はクライアントPC市場へも波及効果をもたらしており、PCメーカーの調達リードタイムは従来の数週間から約半年にまで長期化を見せている。インフラシフトの歪みは、一般企業のPC更新サイクルにまでダメージを与え始めている。

ハイパースケーラーが直面するTCO悪化とアーキテクチャ再編のジレンマ

CPUの価格高騰と調達プロセスの長期化は、クラウドサービスプロバイダー(CSP)やハイパースケーラーの事業計画に直接的な打撃を与えている。インフラストラクチャの増強において、CPU調達単価の20%近い上昇は、TCO(総所有コスト)の計算モデルを根本から狂わせる主要因である。データベース検索などで増大するメモリアクセスを支えるための大容量ECC DDR5やHBMの確保も進めなければならず、システム全体のBOMコストはかつてない水準にまで膨れ上がっている。

クラウドベンダーは、ハードウェアの調達コスト上昇分をインスタンスの利用料金にそのまま反映させるか、自社の利益率低下を許容するかの厳しい選択を迫られている。独自のハードウェアレベルでの防衛策として、特定のベンダーに依存しないシステムアーキテクチャの再設計に向けた動きも活発化している。

AWSが自社のArmベース「Graviton5」プロセッサを展開し、Googleが「Axion」、Microsoftが「Cobalt」プロセッサの導入面積を広げているのは、高騰する外部製品への偏重リスクを分散させるためのエコシステム防衛策である。Ampere Computingの「AmpereOne」に代表される高効率並列CPUの採用も進行しており、これまではNVIDIAのGPUをどのように効率よく稼働させるかに焦点が当てられていたエンジニアリング領域は、代替アーキテクチャ全体でいかにCPUへの価格依存を引き下げるかという課題へと移行している。

演算技術の変革が導くシステム主導プラットフォームの幕開け

エージェント型の進化は、AI技術が高度な検索、文脈の推論、および外部システムに対する行動決定を自律的かつ連続的に統合するオペレーティング・プラットフォームへと成熟したことを示している。自律的なシステムを滞りなく支えるインフラもまた、単一のコンポーネントが肥大化する構造から、分散処理と全体最適を志向するアーキテクチャへと変質していくのは不可避である。

Intelの次世代Xeon 6+(Clearwater Forest)や、AMDの次期EPYC(Venice)といった2026年後半以降のロードマップにある製品群は、このエージェンティック推論を念頭に置き、コア数の大幅増強とシングルスレッド性能の高度なバランスを狙って設計されている。最新アーキテクチャは、増え続ける推論リクエストを効率的にルーティングし、チップレット間の高速インターコネクトを通じて演算のロスを極限まで下げることを目指している。

現在のCPUの価格高騰と品薄状態は、AI産業による演算リソースの再評価という長期的なトランジションの初期症状である。これは決して特殊な要因による一時的なパニックではない。インフラ激変の荒波の中で、自社の保有するハードウェア構成を最も柔軟かつ迅速に最適化できる組織が、次世代プラットフォーム競争において強固な産業的優位性を築くことになる。

Sources