AIインフラ投資といえばNVIDIAのGPUを積み上げることだ、という前提が業界全体に浸透して久しい。ところがMetaはAmazon Web Services(AWS)との間に、GPUではなくArmベースのCPU「Graviton5」を数千万コア・最低3年間調達する大型契約を2026年4月24日に締結した。なぜGPUではなくCPUなのか。答えはレイテンシ(応答遅延)にある。エージェント型AI (Agentic AI)が外部ツールを呼び出しながら逐次的に判断を繰り返す処理では、GPUの得意とする大規模並列演算よりも、低レイテンシと高いスレッド並列性が求められる。そしてそれはCPUが本来得意とする領域だ。数千万コアという規模は、この判断がMetaにとって実験ではなく戦略的確信であることを示している。

MetaはなぜGravitonを選んだか?エージェント型AIとCPUの構造的な合致

エージェント型AIのワークロードは、画像生成モデルや大規模言語モデル(LLM)の学習とは根本的に構造が異なる。LLMのトレーニングや画像生成は、浮動小数点演算を同時に大量に実行するGPUの特性と性質が合う。一方で、AIエージェントが外部ツールを呼び出しながら逐次的に判断を繰り返すオーケストレーション処理は、レイテンシの低さと高いスレッド並列性が求められる——これはCPUが本来得意とする領域だ。

Metaのインフラ担当責任者Santosh Janardhan氏は「コンピュートソースの多様化は戦略的必須事項。GravitonはCPU集約型ワークロードをMetaのスケールで必要なパフォーマンスと効率で実行できる」と述べた。数千万コアという規模で一定の効率を保つには、GPU換算では電力コストと発熱が問題になる。AWSはGraviton5について、代替アーキテクチャと比較して60%少ないエネルギー消費と最高のコストパフォーマンスを主張している。

Metaは月間アクティブユーザーが30億人を超えるプラットフォームを抱えており、検索・コード生成・会話のオーケストレーションを毎秒何百万件も処理する必要がある。その規模では、電力あたりのスループット差が設備投資全体の費用対効果に直接跳ね返る。GPUで同じ処理を賄えばコストが増大するだけでなく、データセンターの電力容量そのものが制約になりかねない。Graviton5が担うのは、リアルタイム推論・コード生成・検索・マルチステップタスクのオーケストレーションといった処理だ。

Graviton5の実力:192コア・3nmで前世代を超える

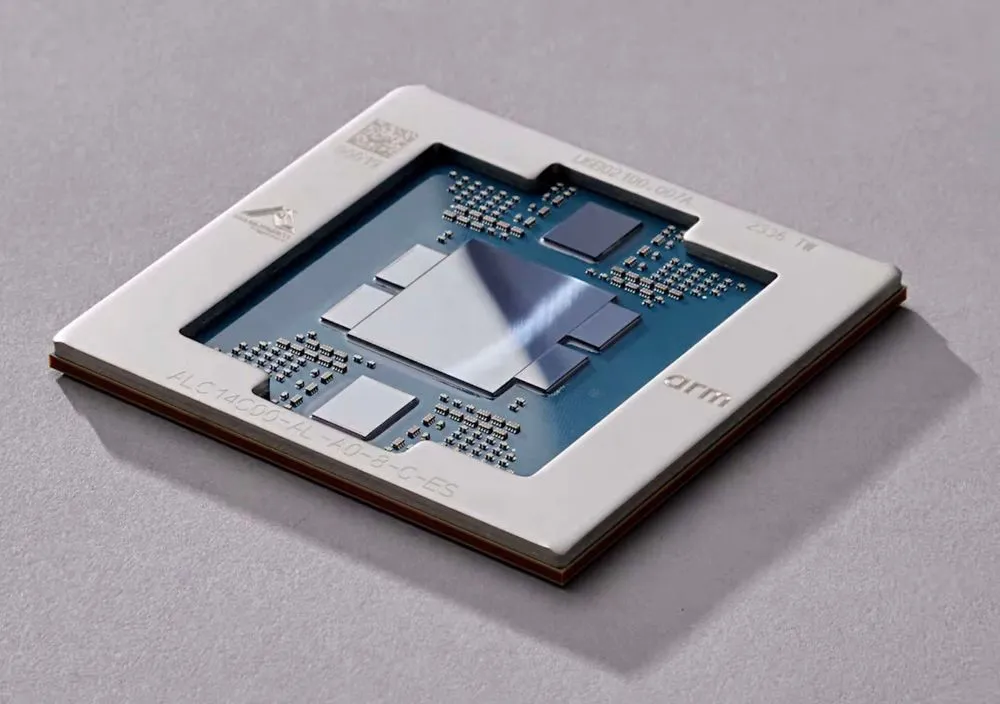

Graviton5はArmアーキテクチャをベースに、TSMCの3nmプロセスで製造される。前世代比で主要な性能指標が大幅に改善されており、L3キャッシュ容量は前世代の5倍、コア間のレイテンシは最大33%削減、計算性能は最大25%向上している。1チップあたりのコア数は192コアで、これを数十万枚単位で展開することで数千万コアという規模を実現する計算になる。

CPUにとってレイテンシの削減は特に意味が大きい。エージェント型AIはツール呼び出し・ベクトル検索・外部API連携を組み合わせた非同期処理を高頻度で実行する。その際にコア間でデータをやり取りする速度が遅ければ、スループットの上限がチップ内の通信速度によって決まってしまう。Graviton5が33%のレイテンシ削減を達成した設計の背景には、こうした処理パターンへの対応が意識されている。

L3キャッシュの5倍増も実効性能に直結する。推論処理では同じモデルの重みを繰り返し参照するため、キャッシュに収まる量が多いほどメモリ帯域への負荷が下がる。192コアという大きなチップ面積を活用してキャッシュを大幅に拡張した設計は、AI推論特有のアクセスパターンに合わせたものといえる。3nmプロセスへの移行はトランジスタ密度の向上をもたらし、これだけの規模の構成を現実的な消費電力で実現する土台になっている。

MetaのマルチクラウドAIインフラ戦略の全体像

今回のAWSとの契約は、Metaが同時期に締結した複数の大型インフラ契約の一つだ。CoreWeaveとは210億ドル規模の契約を結び、NebiusとはNVIDIA GPUクラスタ向けに最大270億ドル規模の契約を交わしている。MetaはGoogleとのインフラパートナーシップも維持しており、2026年のAI設備投資計画は最大1,350億ドルに達する。

GPU集約型の学習・大規模推論はCoreWeaveとNebiusのNVIDIA GPU群が担い、コスト効率と低レイテンシが求められるエージェント型AIのオーケストレーション処理にはGravitonが割り当てられる構図だ。複数ベンダーからの調達により、AWSやNebiusといった個別プロバイダーに対する価格交渉力を維持できる。一社のプロバイダーがMetaの全需要を握れば、コスト構造の主導権は自然とその一社に移る。

契約金額の具体的な数字はAWS・Meta双方から公表されていないが、数十億ドル規模とみられる。ただし「最低3年間・数千万コア」という条件の重さは、単純なベンチマーク評価で終わった試験導入とは明らかに異なる。長期契約によってAWSはGraviton5の製造量を計画しやすくなり、Metaはコスト固定と安定供給を確保できる——双方にとって戦略的な合理性がある。

GPUからCPUへ——AI推論インフラが示す構造転換

AI投資の議論はNVIDIAのGPU受注量を軸に語られることが多かった。だが今回の契約が示すのは、エージェント型AIという新たなワークロード類型が台頭することで、インフラの最適解がワークロードによって明確に分岐しつつあるという現実だ。学習フェーズはGPUが不可欠だが、推論の中でもエージェント処理に限定すれば、CPUの方が電力効率・コスト・レイテンシの複合指標で優位に立てる局面が存在する。NVIDIAのGPUが不要になるわけではなく、生成AIモデルの学習と複雑な推論においてGPUは依然として代替できないが、インフラの意思決定は「GPUか否か」という二択から「どのワークロードに何を使うか」という精緻な設計へと移行している。

Amazon CEOのAndy Jassy氏の発言——「エージェント型AIはGPUと同等規模のCPUストーリーになりつつある」(原文:"Agentic AI is becoming almost as big a CPU story as a GPU story")——はマーケティング的な言い回しではなく、この分岐を事業判断として受け入れた宣言として読める。AWSにとってGravitonは自社設計チップであり、NVIDIA依存からの脱却を促す製品戦略の核心でもあるからだ。Metaのような最大規模の顧客がGravitonを選ぶことは、他のクラウドプロバイダーや企業がインフラ選定を見直す際の参照点になる。

Meta以外の大手テック企業も、似た問題意識を持ち始めている。GoogleはTPU(Tensor Processing Unit)をAI推論に積極活用しており、MicrosoftはAzureのMtrionチップ展開を進めている。アーキテクチャの分散は業界全体の傾向として固まりつつあり、MetaとAWSが結んだ今回の契約は、数千万コアという単位でその領域の大きさを可視化した最初の事例のひとつだ。

Sources

- AWS: Meta signs agreement with AWS to power agentic AI on Graviton chips

- Meta: Meta Partners With AWS on Graviton Chips to Power Agentic AI

- CNBC: Meta will adopt hundreds of thousands of AWS Graviton chips

- TechCrunch: In another wild turn for AI chips, Meta signs deal for millions of Amazon AI CPUs

- GeekWire: Meta signs multibillion-dollar deal to use Amazon's Graviton chips