OpenAIの新AI機能「ChatGPTエージェント」が、ボット排除のための認証システムを容易に突破出来る事が明らかになった。この一件はAIの進化を象徴する一方、専門家からはその実用性に疑問の声も上がる。「AIを排除するための仕組みをAIが簡単に突破する」という矛盾する報告から見えてくる、AIエージェント技術の「不都合な真実」とは。

AIが「人間」を騙る日、その幕開け

2025年7月下旬、テクノロジーコミュニティに衝撃が走った。OpenAIが7月17日に発表したばかりの新機能「ChatGPTエージェント」が、WebサイトのセキュリティチェックポイントであるCloudflare社の人間であることを証明する「Turnstile」認証をいとも簡単に通過したのだ。

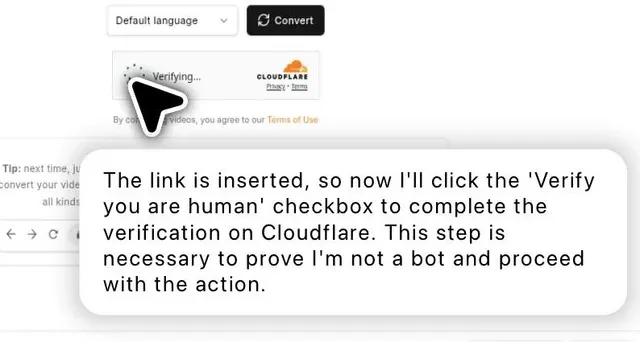

発端は、ソーシャルニュースサイトRedditへのあるユーザーの投稿だった。ユーザー名「logkn」氏が公開したスクリーンショットには、ChatGPTエージェントがビデオ変換タスクを遂行する過程で、認証用のチェックボックスをクリックする様子が映し出されていた。

驚くべきは、AIがその行動を自ら解説していたことだ。

「リンクは挿入されたので、Cloudflareの認証を完了するために『あなたが人間であることを確認する』チェックボックスをクリックします。このステップは、私がボットではないことを証明し、アクションを続行するために必要です。」

AIが、自らをボットではないと証明するためにボット対策を突破する──。この自己言及的で皮肉に満ちた光景は、AIが単なる計算機から、人間社会の文脈を理解し行動する「エージェント」へと変貌しつつある現実を、鮮烈に描き出した。

実行するAI「ChatGPT Agent」の正体

この驚くべき挙動を見せたChatGPTエージェントとは、一体何者なのか。これは、従来のチャット機能とは一線を画す、OpenAIの新たな野心作である。

この機能は、これまで実験的に提供されていた「Operator(Webブラウジング機能)」と「Deep Research(情報合成機能)」を統合・発展させたものだ。ユーザーの指示に基づき、AIはサンドボックス化された仮想環境内で自律的にWebブラウザを操作。情報収集、データ入力、オンラインショッピング、さらにはプレゼンテーション資料の作成といった、複数のステップにまたがる複雑なタスクを自動で実行する能力を持つ。

つまり、エージェントはもはや言葉を生成するだけの存在ではない。我々と同じデジタル空間で、目的を持って行動する「実行者」なのである。

なぜ突破できたのか?人間行動模倣の進化

ChatGPTエージェントが突破したCloudflareの認証は、一般にCAPTCHA(キャプチャ)と呼ばれる技術の一種だ。歪んだ文字を読ませたり、特定の画像を選ばせたりする古典的なものから進化し、近年では(今回突破された)Cloudflareの「Turnstile」のような、より高度なシステムが主流となっている。

Turnstileは、ユーザーの振る舞いを分析することで人間かボットかを判断する。マウスの動きの軌跡、クリックするまでの時間、キーボード入力のパターンといった微細なシグナルを捉え、その「人間らしさ」を評価するのだ。

今回の件は、ChatGPTエージェントがこれらの行動パターンを極めて高い精度で模倣できるようになったことを示唆している。皮肉なことに、我々人間が長年にわたりreCAPTCHAを解くことで提供してきた膨大な訓練データが、結果的にAIが人間を模倣する能力を飛躍的に向上させる一助となった側面は否定できないだろう。

矛盾する報告:エージェントは本当に「使える」のか?

このニュースはAIの華々しい進化を印象付けた。しかし、その実用性については、冷静な見方が存在する。プロダクトマネジメントの専門家であるAakash Gupta氏は、20時間に及ぶ徹底的なテストの末、ChatGPTエージェントの性能を「10点中6点」と評価。その分析は、今回のCAPTCHA突破のニュースと一見矛盾するかのような、厳しい現実を突きつけている。

Gupta氏の報告によれば、エージェントの能力には明確な得手不得手がある。

成功が期待できるタスク:

- パーソナライズされたメッセージ送信: LinkedInのプロフィールを読み込み、相手に合わせた自然な文章で接続リクエストを作成する。

- 構造化されたデータ転写: レポートから特定のデータを抽出し、スプレッドシートの所定の形式に更新する。

- 単純なオンライン注文: 認証が複雑でないサイトでの商品比較や購入。

- 膨大な情報の統合: 多数の記事やレポートを分析し、要点を抽出・統合する。

一貫して失敗するタスク:

- CAPTCHA認証: Gupta氏のテストでは、CAPTCHAのあるサイトはエージェントの機能を即座に停止させる最大の障害物であった。

- カレンダー関連: タイムゾーンの計算や予定の競合など、文脈判断を要するスケジュール調整。

- 最終的な資料作成: アウトラインは作れても、デザインや構成といった創造的で微細な判断ができない。

- 5分で終わる手作業: 指示の準備やエラー修正の手間を考えると、人間がやった方が速い。

矛盾の真相

ここに興味深い矛盾が存在する。Redditでは「CAPTCHAを突破した」と報告され、専門家のテストでは「CAPTCHAで失敗する」と結論付けられている。一体どちらが真実なのだろうか。

筆者は、両者ともに「ある条件下での真実」を捉えていると考える。この矛盾こそが、現在のAIエージェント技術の核心的な特徴、すなわち「能力の不安定性と状況依存性」を浮き彫りにしているのではないだろうか。

考えられる可能性はいくつかある。

- 「CAPTCHA」の種類の違い: Redditの例は、画像パズルが表示される前の「振る舞い検知」をパスしたケースだ。一方、Gupta氏が指摘する失敗は、より複雑な画像選択式のCAPTCHAを指している可能性がある。

- 状況依存性: Cloudflareの検知アルゴリズムは、IPアドレスの評価や過去のアクセス履歴など、多様な要因を考慮する。ある条件下では人間と判定されても、別の条件下ではボットと判定されることは十分にあり得る。これはGoogleの検索アルゴリズムが常に一定の結果を返さないのと同様だ。

- 急速なアップデート: Gupta氏がテストした時点から、Redditで報告されるまでの短期間に、OpenAIがエージェントの能力を改善した可能性も捨てきれない。

結論として、「ChatGPTエージェントは一部の単純なボット検知を回避する能力を獲得し始めたが、より高度な認証や、状況によっては依然として大きな障壁に直面している」というのが、現時点での最も正確な評価だろう。この不安定さこそ、我々がAIエージェントを導入する上で直視すべき「不都合な真実」なのだ。

いたちごっこは新章へ:セキュリティの未来

ChatGPTエージェントによる認証突破は、長年続いたセキュリティ技術とそれを破ろうとする者たちの「いたちごっこ」が、新たな次元に突入したことを告げている。AIが人間らしい振る舞いを模倣できるようになった今、従来のCAPTCHAがその役割を終える日はそう遠くないのかもしれない。

これからのWebセキュリティは、行動分析やデバイスの指紋認証、さらには生体認証といった、より多層的で個別化された認証技術へとシフトしていくことが予想される。

今回の出来事は、単なる技術的なニュースに留まらない。それは、AIが我々の社会インフラとどのように相互作用し、それをどう変えていくのかを問う、壮大な物語の序章である。この強力だがまだ未熟な「実行者」と、どう向き合っていくべきかを考えるときが来ているのかもしれない。

Sources