2026年3月のPixel Feature Dropは、Googleが長年模索してきた「モバイルとデスクトップの境界線の撤廃」が初めて本格的な形となって現れた、極めて重要なマイルストーンだ。これまで、スマートフォンの進化は「画面内の体験最適化」に終始してきた。しかし、Android 16 QPR3の一般公開にあわせて提供された新機能群を読み解くと、Googleの焦点が「スマートフォンという物理的な枠組みからコンピューティング体験を解放すること」へと明確に移行していることがわかる。

本稿では、今回のアップデートの核心である「Androidデバイスの外部ディスプレイ接続によるデスクトップモード」の技術的背景と業界への影響、そして並行して投下されたPixel 10シリーズを中心とするGemini Automationの自律的エージェント化の動きについて見てみたい。

物理的制約からの解放:標準化されたデスクトップ環境の登場

これまでのAndroidエコシステムにおいて、モバイル端末をデスクトップ環境として利用するアプローチは、Samsungの「DeX」やMotorolaの「Ready For」など、個々のメーカーが独自に開発した機能に依存していた。これは、開発者にとって一貫したターゲット環境が存在しないことを意味し、アプリが全画面表示やウィンドウ表示に柔軟に対応するインセンティブを削ぐ結果となっていた。

今回のAndroid 16 QPR3によるデスクトップ・ウィンドウ体験の一般提供(GA)は、この分断された状況に終止符を打つものだ。Pixel 8以降のデバイス、Pixel Tablet、そして一部のSamsungデバイスにおいて、USB Type-C経由で外部モニターに接続するだけで、完全なデスクトップセッションが自動的に開始される。タスクバーが配置され、ウィンドウを自由にリサイズして複数アプリを同時に実行可能なこの環境は、従来のChromebookやWindows PCの代替として機能するポテンシャルを秘めている。

特筆すべきは、タブレット端末などの大画面デバイスを接続した場合の挙動だ。単なる画面のミラーリングではなく、2つのディスプレイにまたがる拡張ワークスペースが形成され、アプリのウィンドウやカーソルがシームレスに移動する。これは、スマートフォンやタブレットが「持ち歩く中枢神経」となり、あらゆる外部ディスプレイが「思考を展開するためのキャンバス」へと変わるパラダイムシフトの完成を意味している。

開発パラダイムの強制的な転換:Jetpack WindowManagerと適応型設計

ハードウェア側の機能開放と連動し、Googleは開発者に対しても明確なメッセージを発している。アプリがポートレート(縦画面)固定やタッチ操作のみを前提とする時代は終焉を迎えたということだ。

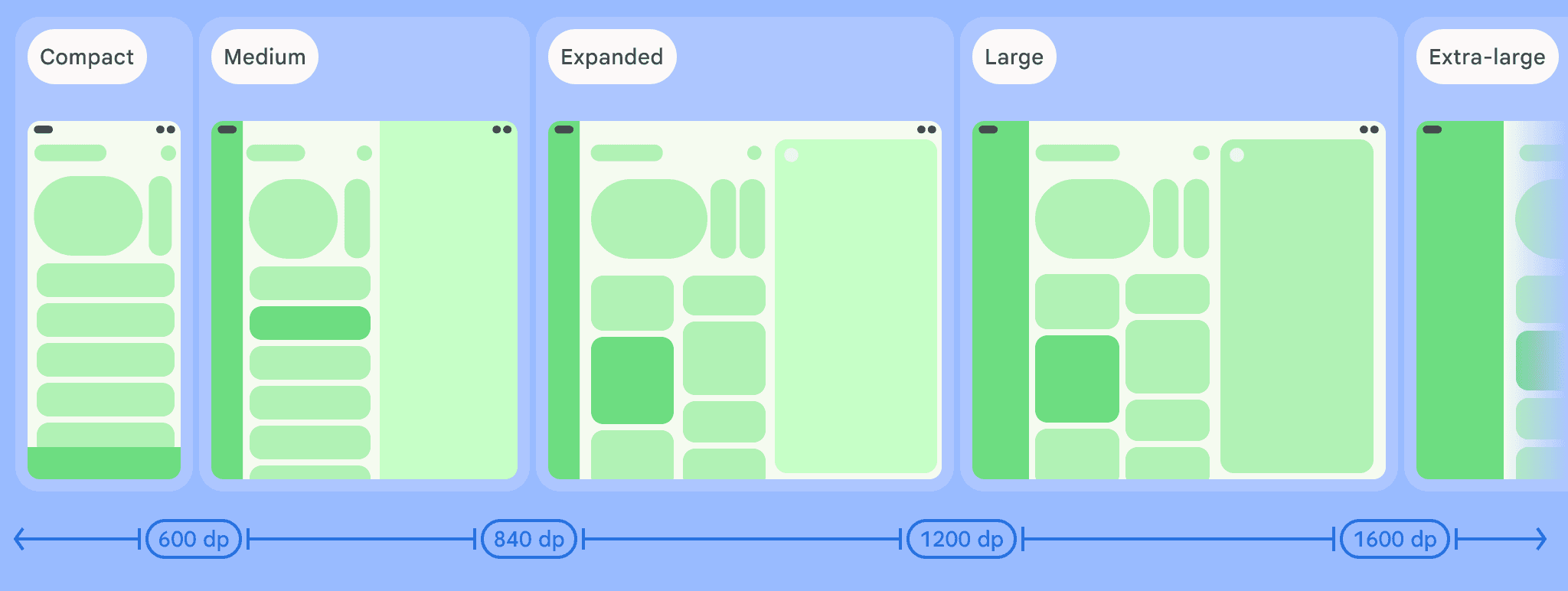

Jetpack WindowManager 1.5.0のアップデートにおいて、Googleは全く新しいウィンドウサイズクラスを導入した。幅1200dp〜1600dpの「Large」、そして1600dp以上の「Extra-large」である。これまで、Androidの開発ではタブレットクラスの画面サイズ(Expanded)が最大幅として想定されてきた。しかし、外部モニターという新たな広大なサーフェスが出現したことで、UI設計の前提が大きく崩れたのである。

例えば、従来のメールアプリで採用されていた2ペイン(リストと詳細)のレイアウトは、Extra-largeの環境では余白が多く、情報を効率的に表示しきれない。ここで求められるのは、3ペイン、あるいは4ペインのレイアウト(ナビゲーション、リスト、詳細、カレンダー等を同時表示)を動的に切り替える高度なアダプティブ・デザインである。Compose Material 3 Adaptive libraryにおいてこれらの新しいブレークポイントが標準サポートされたことは、Androidプラットフォーム全体が「超大画面」をファーストクラスの実行環境として扱い始めた証拠に他ならない。また、外部マウスやキーボードといった周辺機器の入力系に関する互換性レイヤーの強化も、本アップデートにおける技術的な鍵となっている。

行動の代行者への進化:Gemini Automationと予期型AIの台頭

ハードウェア体験の拡張と並行し、今回のアップデートにおいてAIの役割も大きく変質している。「質問に対してテキストや画像で回答する」という対話型アシスタントの枠を完全に超え、デバイスが自律的にタスクを遂行する「エージェント」としての機能が実装されている。

Pixel 10シリーズ向けに展開された「Gemini Automation」は、その最たる例だ。ユーザーからの要求に応じ、Geminiはセキュアなバックグラウンド環境で該当のアプリを自動で起動し、タップ操作、スクロール、テキスト入力などの一連の操作を自律的に実行する。食料品の注文や配車の手配がシステムの裏側で進行し、状況は通知を通じてリアルタイムで報告される。ユーザーは最後に購入や予約の最終確認ボタンを押すだけで済む。これは、AIが「知識の提供者」から「行動の代行者」へと昇華した決定的な瞬間である。

さらに、「マジックサジェスト」によるチャット内でのレストランの自律的な提案も、アンティシペーション(予期)の概念を具現化している。ユーザーが自省的に何かを検索する前に、コンテキストを解析し「今必要となるであろう情報」を提示する。これらの機能の基盤には、画面に表示されている複数の物体を同時に識別するCircle to SearchのGemini 3アップデートや、発信者の言葉のパターンから詐欺電話をリアルタイム検知するScam Detection(日本を含む各国へ拡大展開中)など、高度なオンデバイスAIの継続的な強化が存在する。

生活のインフラ化と個別化の共存

日常の利便性においても、At a Glanceやカスタマイズ機能が拡充されている。「My Commute」機能は、設定された通勤ルートに関する出発の時刻や遅延情報、さらにはバイパスルートをリアルタイムでホーム画面やロック画面に提示する。さらに、Google Financeからのデータ抽出による株価の終値の報告や、フォローしているスポーツチームのライブスコアの常時表示など、情報取得のゼロクリック化が推し進められている。

これと対照的に、AI生成によるカスタムアイコン(Scribbles、Cookies、Easel、Treasure、Stardust)の導入や、Comfort viewによる画面の色彩刺激の適切な制限などは、各ユーザーの個人的嗜好や視覚的な感度の多様性に合わせたパーソナライゼーションの極致である。技術が高度に抽象化され、システムが複雑になる一方で、ユーザーが触れる表層的な部分は限りなく人間的で個別最適化されたものへと進化している側面を逃してはならない。

計算機資源の分散と統合が織りなす未来

AppleはiPadとMacという製品ラインを明確に分割させ、それぞれのOSを独自の発展の道へと進ませている。Appleのエコシステム内では、それぞれのデバイスが補完的に機能することはあっても、機能の完全な統合には至っていない。これに対し、GoogleのAndroidにおけるアプローチは「一台のデバイスがあらゆる形態に変化する」という真逆の哲学に基づいている。

Android 16 QPR3によるデスクトップ環境の標準化と、Pixel Feature Dropで明らかになったGeminiの自律的エージェント化は、個別の機能アップデートとして切り離して評価すべきではない。「常に身につけている最も高性能なプロセッサ」を中核とし、視覚の出力先(モニター)や入力装置(キーボード)を自由に選択・交換させ、その全ての動作を高度なAIがバックグラウンドで自動操縦する。これが、Googleが描く「ポスト・スマートフォン」時代のパラダイムである。ハードウェアの境界線は溶け合い、ユーザーは単に「計算能力」にアクセスするためのインターフェースのみを意識すればよい環境が、いま確実に構築されつつある。

Sources

- Android Developer Blog: Android devices extend seamlessly to connected displays