南カリフォルニア大学(USC)の研究チームが、AI(人工知能)の未来を根底から覆す可能性を秘めた技術を発表した。生物の脳が情報を処理する際の複雑な電気化学的挙動を、シリコンチップ上で物理的に再現する「人工ニューロン」の開発に成功したのだ。電子の代わりに原子(イオン)の動きで計算するこの新技術は、AIチップを桁違いに小型化・省エネ化し、真の人工汎用知能(AGI)への道を切り拓くかもしれない。

シミュレーションの壁を超えて:脳を「物理的に再現」するということ

現代のAI技術、特にその頭脳であるプロセッサは、驚異的な進化を遂げてきた。しかし、その根幹にあるのは、あくまで人間の脳の働きを「数学的に模倣(シミュレーション)」するアプローチである。膨大な数のトランジスタを使い、ニューロンの発火(スパイク)やシナプスの結合強度変化を計算によって再現しているに過ぎない。これは、鳥の飛び方を写真でコマ送りにして理解するようなものであり、実際に翼で風を掴む物理現象そのものを再現しているわけではない。

この「シミュレーション」方式は、特定のタスクでは人間を凌駕する性能を発揮する一方、致命的な欠点を抱えている。それは、圧倒的なエネルギー消費と、柔軟な学習能力の欠如だ。人間の脳がわずか20ワット程度の電力で、数例の経験から物事を学習し、複雑な思考を行うのに対し、スーパーコンピュータがAIモデルを動かすにはメガワット単位、つまり数十万倍もの電力を必要とする。

この根本的な課題に対し、USCヴィタビ工学部のJoshua Yang教授率いる研究チームが提示した答えは、まさにパラダイムシフトと呼ぶにふさわしい。彼らは、脳の動作を計算で模倣するのではなく、その物理的・化学的なプロセス自体をチップ上に「具現化」する道を選んだのだ。

Yang教授らの研究成果は、科学誌『Nature Electronics』に掲載された。 その論文が示すのは、単なる性能向上ではない。AIハードウェアの設計思想そのものを、現在の「電子工学」から、脳の「電気化学」へと引き戻し、再構築しようとする壮大な試みなのである。

技術の核心「拡散型メモリスタ」:銀イオンが紡ぐ知性の源

この革命的な人工ニューロンの心臓部を成すのが、「拡散型メモリスタ(diffusive memristor)」と呼ばれる新しいデバイスだ。 従来のコンピュータチップが、半導体内を軽快に駆け巡る「電子」の流れを利用して「0」と「1」のデジタル情報を処理するのに対し、このデバイスは全く異なる役者、すなわち「原子(イオン)」を主役に据える。

なぜ「電子」ではなく「原子」なのか?

Yang教授はこの選択の理由を、「それが人間の脳で起こっていることであり、進化の勝者である人間の脳が、最も効率的な知能エンジンだからだ」と語る。

私たちの脳内では、ニューロン(神経細胞)が情報をやり取りする際に、複雑で美しい連携プレーが繰り広げられている。まず、ニューロンの内部を電気信号が伝わる。そして、ニューロンの末端である「シナプス」という接合部に到達すると、この電気信号は「神経伝達物質」という化学物質の放出を促す。この化学物質がシナプスの隙間を漂い、次のニューロンに受け取られると、そこで再び電気信号へと変換される。

この「電気信号→化学信号→電気信号」という変換プロセスこそが、脳の柔軟な学習や記憶、そして驚異的なエネルギー効率の源泉となっている。ナトリウム、カリウム、カルシウムといった「イオン」(電荷を帯びた原子)が、この化学的な情報伝達において極めて重要な役割を果たしているのだ。

Yang教授らのチームは、この生体内のイオンのダイナミックな動きを、酸化物内で移動する「銀イオン」を用いてエミュレートすることに成功した。

「我々の人工シナプスやニューロンで使うイオンは、生体内のものと全く同じではないが、イオンの動きやそのダイナミクスを支配する物理法則は非常によく似ている」とYang教授は説明する。

銀イオンは酸化物の中を比較的容易に拡散する性質を持つ。この「拡散」という物理現象が、生体ニューロン内のイオンの振る舞いを忠実に再現するための鍵となる。電圧をかけると銀イオンが集まり、電圧を止めると自然に散らばっていく。このゆっくりとした、しかし確実な原子の動きが、従来の電子デバイスでは実現が難しかった、時間的な情報処理やアナログ的な記憶保持を可能にするのだ。

電子は極めて軽量で高速に移動できるため、純粋な計算速度では有利だ。しかし、その軽快さゆえに、情報は揮発しやすく、学習のような持続的な変化をハードウェア自体に刻み込むのが難しい。結果として、現代のAIは「ソフトウェアベースの学習」に依存せざるを得ない。

対照的に、脳はイオンという「重み」のある物質を動かすことで、シナプスの結合強度を物理的に変化させ、学習する。これは「ハードウェアベースの学習」、あるいはYang教授が言うところの「ウェットウェア」での学習であり、本質的にエネルギー効率が高い。 この深遠な原理を、拡散型メモリスタは固体デバイスの中で初めて忠実に再現しようとしているのである。

1トランジスタという衝撃:AIチップの常識を覆す超高密度化

この新技術がもたらすインパクトは、その動作原理の革新性だけにとどまらない。最も衝撃的なのは、その驚異的な実装効率だ。

従来のCMOS技術を用いて人工ニューロンを一つ作製するには、その機能の複雑さに応じて、数十個から時には数百個ものトランジスタが必要とされてきた。これは、チップ上で広大な面積を占有し、消費電力も増大させる大きな要因となっていた。

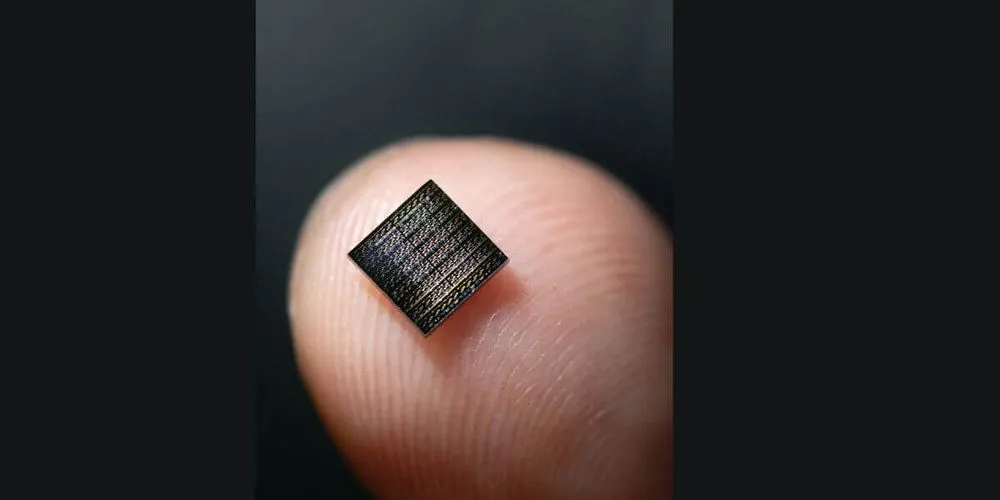

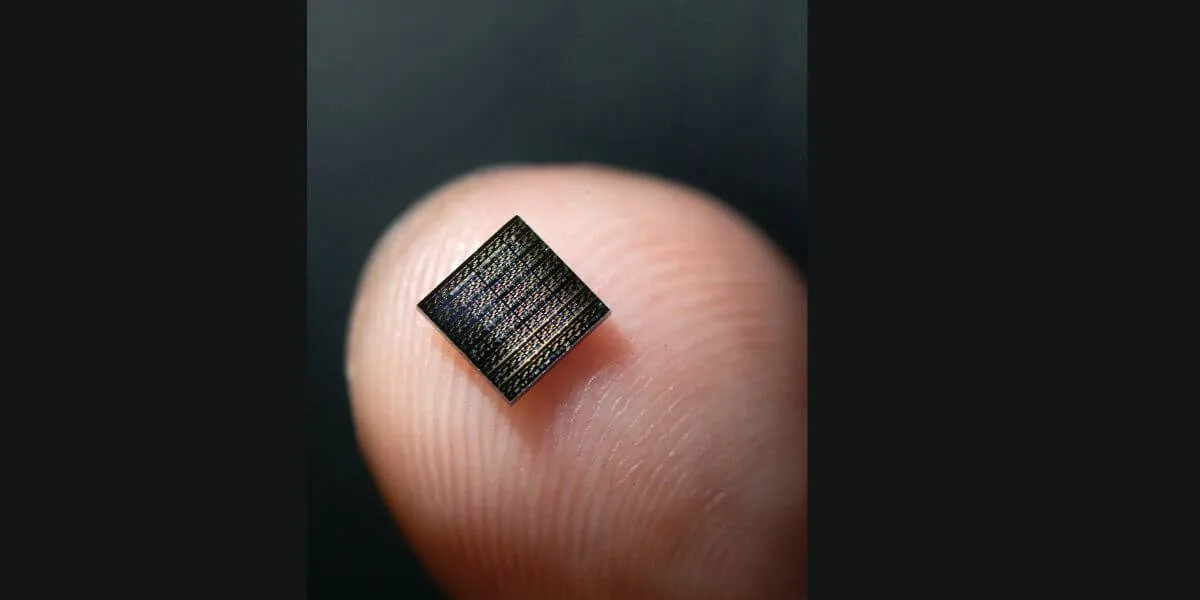

しかし、Yang教授らが開発した人工ニューロンは、拡散型メモリスタと抵抗器、そしてたった一つのトランジスタを積層するだけで構成できる。 つまり、一つのニューロンが占める面積(フットプリント)は、実質的に「トランジスタ一つ分」にまで縮小されたのだ。

Yang教授は次のように述べる。「この革新により、我々はニューロンごとにトランジスタ一つのフットプリントしか使わない。我々が設計しているのは、最終的にチップサイズを桁違いに縮小し、エネルギー消費を桁違いに削減するためのビルディングブロックなのだ」。

この「桁違いの小型化」が現実のものとなれば、その影響は計り知れない。

現在、スマートフォンの頭脳であるSoC(System on a Chip)には、数十億個のトランジスタが集積されている。もし、その一部をこの人工ニューロンで置き換えることができれば、同じチップ面積で遥かに多くのニューロンを搭載できるようになる。これは、スマートフォンやスマートウォッチのようなエッジデバイス上で、クラウドに頼ることなく、高度なAI処理をリアルタイムで実行できる未来を意味する。

例えば、より自然な言語で対話できるパーソナルアシスタント、ユーザーの健康状態を常に監視し予測するウェアラブルデバイス、あるいは、ネットワーク接続なしで動作する高度な自動運転システムなど、応用範囲は無限に広がるだろう。

脳の「20ワット」に挑む:エネルギー危機に瀕するAIへの福音

小型化と並ぶ、もう一つの巨大なメリットが「省エネルギー性」だ。近年の大規模言語モデル(LLM)に代表されるAIの進化は目覚ましいが、その裏ではデータセンターが消費する莫大な電力が深刻な問題となっている。AIの学習や運用には、一つの国に匹敵するほどのエネルギーが必要とも言われ、このままでは持続可能性の観点からAIの発展が頭打ちになりかねない。

Yang教授は、この現状を的確に指摘する。「問題は、我々のチップやコンピュータが十分にパワフルでないということではない。効率的でないということだ。エネルギーを使いすぎている」。

ここで再び、比較対象となるのが人間の脳である。前述の通り、脳はわずか20ワット、豆電球一つ程度の電力で、認識、学習、創造といった高度な知的活動を行っている。 この驚異的なエネルギー効率は、イオンを利用した化学的な情報処理の賜物だ。

Yang教授らの人工ニューロンは、この脳の原理に立ち返ることで、AIのエネルギー問題に対する根本的な解決策を提示しようとしている。原子の物理的な移動は、電子の高速なスイッチングに比べて遥かに少ないエネルギーで済む。情報を不揮発的に(電源を切っても消えない形で)保持できるため、待機電力も大幅に削減できる可能性がある。

この技術が成熟すれば、AIが消費するエネルギーを数桁、つまり1/100や1/1000に削減できるかもしれない。そうなれば、AIは一部の巨大企業がデータセンターで独占する技術ではなく、あらゆる場所に遍在し、持続可能な形で社会を豊かにする真のインフラとなり得るだろう。

課題と未来:AGIへの道筋と残されたハードル

この画期的な研究は、AIの未来に大きな光明を投げかけるものだが、実用化への道のりはまだ始まったばかりだ。ジャーナリストとして、その課題と今後の展望についても冷静に見つめる必要がある。

最大のハードルの一つは、材料の問題だ。今回の実験で使用された銀イオンは、その優れた拡散特性から選ばれたが、銀は現代の半導体製造の主流であるシリコン(CMOS)プロセスとの互換性が低いという問題がある。 製造ラインに銀が混入すると、他の半導体デバイスの特性を劣化させてしまう可能性があるためだ。

Yang教授自身もこの課題を認識しており、今後は銀と同様の機能を持つ、半導体プロセスと互換性のある別のイオン種を探求する必要があると言及している。 リチウムイオンやプロトン(水素イオン)など、他の候補材料での研究が今後の焦点となるだろう。

また、現在はまだ個別のニューロンやシナプスといった「ビルディングブロック」が実証された段階だ。次のステップは、これらのデバイスを数百万、数十億という規模で大規模に集積し、複雑なネットワークを構築して、実際に脳のような学習能力や効率を発揮できるかを検証することになる。

しかし、これらの課題を乗り越えた先には、壮大な未来が待っている。

Yang教授が語るように、この研究の最終的な目標は、単に効率的なAIを作ることだけではない。「さらにエキサイティングなのは、このような脳に忠実なシステムが、脳そのものがどのように機能するのかについて、我々が新たな洞察を得る手助けとなる可能性があることだ」。

脳を模倣した工学システムを構築し、その動作を分析することで、これまで謎に包まれていた記憶や意識といった脳の高度な機能のメカニズムを解明する手がかりが得られるかもしれない。それは、工学が神経科学に貢献し、その逆もまた然りという、学際的な知のフロンティアを切り拓く可能性を秘めている。

そしてその先に見据えるのは、多くの研究者が夢見る人工汎用知能(AGI)の実現だ。特定のタスクに特化した現在のAIとは異なり、人間のように柔軟に学習し、未知の課題に対応できる真に知的な存在。脳の物理的・化学的原理を忠実に再現したハードウェアは、その実現に向けた、最も確かな一歩となるのかもしれない。

USCの研究チームが灯したこの小さなイオンの輝きは、AIという技術の在り方、そして我々自身の知性の本質に対する理解を、根底から照らし出す狼煙となるだろう。

論文

- Nature Electronics: A spiking artificial neuron based on one diffusive memristor, one transistor and one resistor

参考文献

- USC Viterbi School of Engineering: Artificial neurons developed by USC team replicate biological function for improved computer chips