AMDはFinancial Analyst Day 2025において、次世代CPUコアアーキテクチャ「Zen 6」および「Zen 7」に関する公式ロードマップを公開した。Zen 6ではTSMCの2nmプロセスノードへの移行とAI向け命令セットの拡充が明示され、Zen 7では新たに「マトリックスエンジン」の搭載が予告された。これは、汎用コンピューティング市場におけるAI処理能力の統合を加速させるAMDの明確な戦略を示すものだ。

AMDが描く成長戦略と技術的裏付け

AMDのCEOであるLisa Su氏は、同社が今後3年から5年の間に年率35%の全体的な収益成長を見込んでいると発表した。 特にAIデータセンター事業においては、同期間で年率80%という極めて高い成長率を予測しており、2027年までにはAIチップの売上が数百億ドル規模に達するとの見通しを示している。 この強気な予測の背景には、NVIDIAが現在90%以上のシェアを占めるとされるAIアクセラレータ市場において、「2桁」のシェアを獲得するという目標がある。

この財務目標は、OpenAIやMeta、Oracleといった主要クラウドプロバイダーとの長期的なパートナーシップによって支えられている。 特にOpenAIとの協業では、次世代のInstinct MI400X AIチップを基盤としたラック規模のシステム構築も含まれており、AMDが単なるチップ供給に留まらず、NVIDIAのDGXシステムに匹敵する統合プラットフォームレベルでのソリューション提供を目指していることを示唆している。

しかし、こうした市場戦略の実現可能性は、根底にある半導体技術とマイクロアーキテクチャの進化に依存する。今回公開されたZen 6とZen 7のロードマップは、その技術的裏付けを具体的に示すものに外ならない。

Zen 6アーキテクチャ:2nmプロセスとAI命令セットの拡張

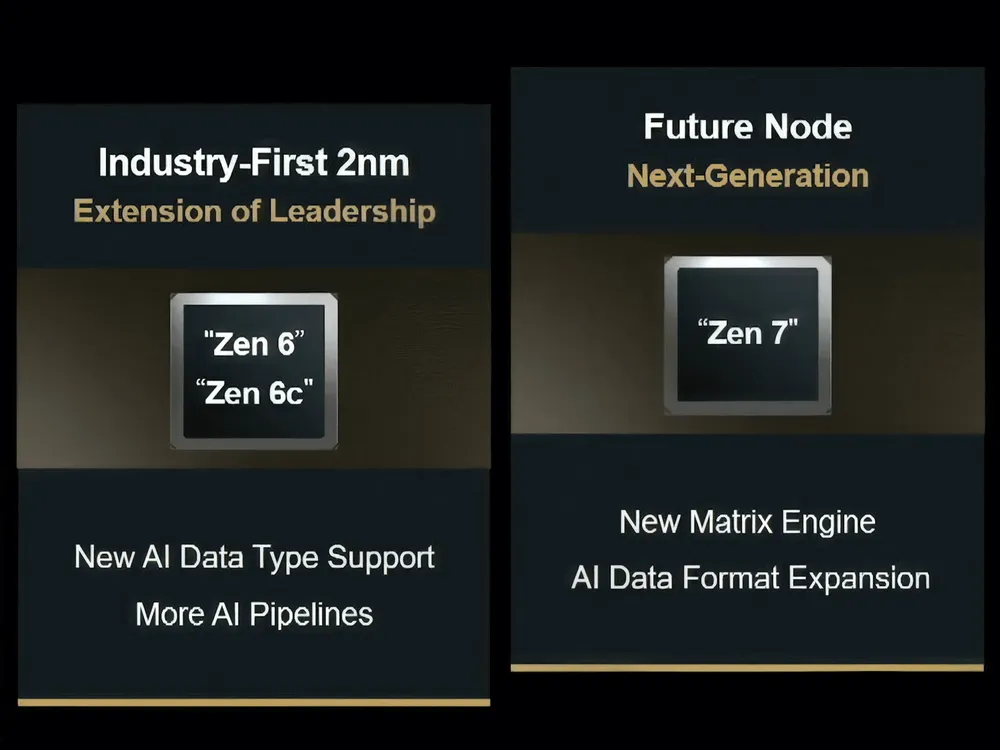

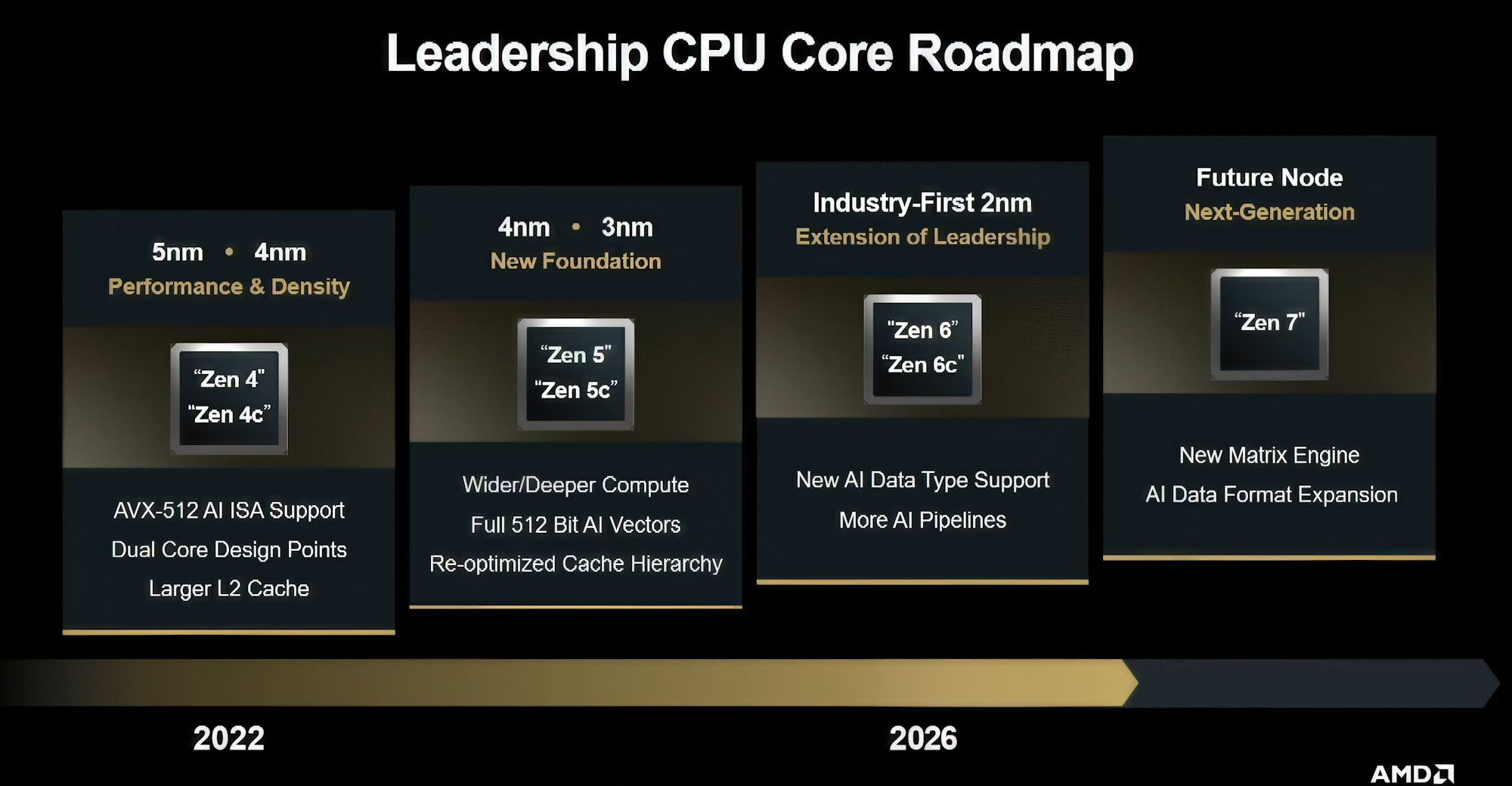

2026年の市場投入が計画されているZen 6アーキテクチャは、主に2つの技術的進歩を柱としている。それは、業界をリードする2nmプロセスノードへの移行と、AI推論ワークロードに特化した命令セットアーキテクチャ(ISA)の拡張である。

TSMC 2nmプロセスがもたらす物理的優位性

Zen 6は、TSMCの2nmプロセスノードを採用することが明記された。 Zen 4世代の5nm/4nm、Zen 5世代の4nm/3nmからの順当かつ急進的な微細化である。プロセス微細化は、半導体性能向上の根源的なドライバーであり、以下の物理的な利点をもたらす。

- トランジスタ密度の向上: 同一面積により多くのトランジスタを実装可能になり、キャッシュ容量の増大や、後述するAIパイプラインのような専用回路の追加が容易になる。

- 電力効率の改善: トランジスタのスイッチングに必要な電圧と電流が低下するため、同一性能をより低い消費電力で、あるいは同一消費電力でより高い性能を達成できる。

- スイッチング速度の向上: ゲート遅延が短縮され、より高いクロック周波数での動作が可能となる。

これらの基本的な利点が、Zen 6で目標とされる「IPC(Instructions Per Clock)の向上」と「効率改善」の物理的な基盤となる。AMDはZen 6を搭載するサーバー向けプロセッサ EPYC “Venice” がすでにテープアウト(設計完了)したと言及しており、この先進プロセスへの移行が具体的な製品計画として進行中であることを裏付けている。

ISAレベルでのAI機能強化:低精度データ型とVNNIのサポート

Zen 6は、プロセス技術の進化に加え、ISAレベルでAI処理能力を強化する。具体的には、新たなAIデータ型のサポートと、AIパイプラインの拡充が予告されている。 過去のリーク情報やISAの変更履歴から、以下の機能追加が確実視されている。

- AVX512-FP16: 半精度浮動小数点数(FP16)フォーマットでの512ビットベクトル演算をサポートする。AIモデルの重みや活性化関数では、FP32(単精度)ほどの精度は不要な場合が多く、FP16を用いることでメモリ帯域幅の消費を半減させ、計算スループットを理論上2倍に高めることができる。

- AVX512-VNNI (Vector Neural Network Instructions): 整数(INT8やINT16)データ型を用いた内積演算を効率化する命令セットである。特にAI推論(Inference)ワークロードでは、量子化によってモデルをINT8に変換することが一般的であり、VNNIは畳み込みニューラルネットワーク(CNN)などで頻出する積和演算を単一命令で高速に実行する。

- 追加のAIパイプライン: これは、これらの新しい命令を効率的に処理するための実行ユニット(Execution Unit)がCPUコア内に増設されることを意味する。これにより、汎用的な浮動小数点演算ユニット(FPU)と並行して、AIに特化した演算を高いスループットで処理する能力が向上すると考えられる。

このアプローチは、CPUコアのベクトル演算能力をAIワークロードに最適化するものであり、既存のソフトウェアスタックとの互換性を保ちながら、幅広いAIアプリケーションの性能を底上げする現実的な選択である。

Zen 7アーキテクチャ:汎用CPUコアへの「マトリックスエンジン」統合

Zen 6がベクトル演算の拡張であるのに対し、2027年頃の登場が見込まれるZen 7は、より抜本的なアーキテクチャの変更を示唆している。ロードマップ上で初めて公式に確認されたZen 7の最大の特徴は、「新しいマトリックスエンジン」の搭載である。

マトリックスエンジンとは何か? NPUとの技術的比較

マトリックスエンジンとは、AIや機械学習の中核となる行列積和演算(Matrix Multiply-Accumulate, MMA)を専門に処理するために設計されたハードウェアアクセラレータである。これは、AMDがRyzen Mobileプロセッサに搭載しているNPU(Neural Processing Unit)である「Ryzen AI (XDNAアーキテクチャ)」や、AppleのNeural Engine、IntelのNPUと同様の概念だ。

しかし、Zen 7におけるマトリックスエンジンの重要性は、その実装形態にあると推察される。これまでのNPUは、CPUコアやGPUコアとは独立したIPブロックとしてSoC(System-on-a-Chip)上に実装されるのが一般的であった。一方、Zen 7のロードマップにおける記述は、このマトリックスエンジンがZen 7 CPUコアの内部、あるいは極めて密接に連携する形で統合される可能性を示唆している。

CPUコア統合がもたらす技術的含意とパフォーマンスへの影響

CPUコアへのマトリックスエンジンの統合は、単なる機能追加以上の技術的な意味を持つ。

- 超低レイテンシの実現: 独立したNPUにタスクをオフロードする場合、CPUとNPU間でデータをやり取りするためのオーバーヘッド(レイテンシ)が発生する。マトリックスエンジンがCPUコアと同一のキャッシュ階層(L1/L2キャッシュ)を共有できれば、データ移動が最小限に抑えられ、OSのスケジューリングやUIの応答といった、即時性が求められる小規模なAIタスクを極めて低い遅延で実行可能になる。

- プログラマビリティとOS統合: CPUコアに統合された演算ユニットは、OSのスケジューラから直接可視化され、管理されやすいという利点がある。これにより、開発者は特別なドライバやAPIを介さずとも、よりシームレスにAI機能をアプリケーションに組み込める可能性がある。これは、AI機能をOSの根幹サービスとして統合しようとする近年の潮流とも合致する。

Zen 7は、このマトリックスエンジンと「AIデータフォーマットの拡張」を組み合わせることで、CPUを単なる汎用計算機から、AIネイティブな処理能力を持つハイブリッドコンピューティングユニットへと進化させる試みであると考えられる。これは、サーバーからクライアントPCまで、あらゆるコンピューティングデバイスにおいて、常時稼働するAIアシスタントやリアルタイム推論の性能と効率を劇的に向上させる潜在能力を秘めている。

製品ロードマップと市場へのインパクト

これらの新アーキテクチャは、AMDの全製品ラインに展開される計画である。

- サーバー市場: EPYCプロセッサは、Zen 6世代で”Venice”、Zen 7世代で”Verano”として登場する。 データセンターでは、学習よりも推論ワークロードの比率が爆発的に増加しており、Zen 6のISA拡張とZen 7のマトリックスエンジンは、この需要に直接応えるものとなる。特に、推論APIの提供やデータベースのAI機能拡張といった、CPUセントリックなAIワークロードにおいて、AMDの競争力を高める重要な要素となる。

- コンシューマ市場: Ryzenブランドでは、Zen 6がデスクトップ向けの”Olympic Ridge”と、モバイル向けの”Medusa Point”に採用される。 クライアントデバイスにおいては、OSに統合されたAI機能や、コンテンツ生成AIアプリケーションのローカル実行が重要なユースケースとなる。Zen 7のマトリックスエンジンが実現すれば、ビデオ会議でのリアルタイム背景処理やノイズ除去、あるいはゲームにおけるNPCの高度なAI挙動などを、CPUパワーのみで効率的に処理する未来が開けるだろう。

AI時代におけるCPUの再定義

AMDが Financial Analyst Dayで示したZen 6およびZen 7のロードマップは、単なるCPUの性能向上計画に留まらない。これは、AIワークロードをCPUアーキテクチャの根幹に統合し、CPUというプロセッサの役割を再定義しようとする野心的な試みである。

Zen 6は、ベクトル演算ユニットの能力を現実的なAIワークロードに合わせて拡張するという、ソフトウェア互換性を重視した堅実な進化である。一方、Zen 7で示唆されたマトリックスエンジンの統合は、CPUコアの設計思想そのものを変えかねない、より大きな飛躍となる可能性がある。

NVIDIAがGPUによってAI市場を席巻する中、AMDはCPU、GPU、NPUを組み合わせたヘテロジニアス・コンピューティングで対抗軸を形成しようとしている。その戦略において、システムの中心に位置するCPUコア自体が高度なAI処理能力をネイティブに備えることの重要性は計り知れない。Zen 6とZen 7の進化は、AMDがAI時代におけるコンピューティングの未来をどのように見据えているかを示す、力強い技術的宣言である。

Sources