AIチップ開発のスタートアップ企業、EnCharge AIが、長年にわたる研究開発の集大成として、革新的なAIアクセラレータチップ「EN100」を発表した。このチップは、同社独自の「アナログ・インメモリ・コンピューティング」技術を核とし、従来のデジタルGPUと比較して最大約20倍という驚異的な電力効率を実現。これにより、これまでクラウド環境が必須とされてきた高度なAI推論処理を、ラップトップやワークステーション、さらにはエッジデバイス上で直接実行可能にする「オンデバイスAI」の新たな地平を切り拓くものとして、業界内外から大きな注目を集めている。

AIの「ローカル化」を加速するEN100、その核心とは?

現代のAI、特に大規模言語モデル(LLM)や高度な画像認識、マルチモーダルAIといった処理は、膨大な計算リソースと電力を消費するため、その実行環境は大規模なデータセンターに集中しているのが実情だ。しかし、このクラウド依存の状況は、コスト、遅延(レイテンシ)、そしてデータセキュリティやプライバシーといった観点から、多くのアプリケーションにとって課題となっていた。

EnCharge AIが発表したEN100は、この状況を根本から覆す可能性を秘めている。同社によれば、EN100はラップトップやワークステーションといったクライアントプラットフォームの電力制約内で、200兆回/秒(TOPS)を超える演算性能を提供。これにより、これまでクラウド上での処理が現実的だった高度なAI推論が、ユーザーの手元にあるデバイスで直接、かつ効率的に実行できるようになるという。

EnCharge AIの共同創業者兼CEOであるNaveen Verma氏は、「EN100の登場は、AIコンピューティングアーキテクチャにおける根本的な変化を意味します。高度で安全、かつパーソナライズされたAIが、クラウドインフラに依存することなくローカルで実行できるようになるのです。これにより、AIでできることの可能性が飛躍的に拡大することを期待しています」と、その意義を強調している。

驚異の効率性を生む「チャージベース・アナログ・インメモリ・コンピューティング」

EN100の革新性を支える核心技術が、「アナログ・インメモリ・コンピューティング」であり、特に同社が「チャージベースメモリ(charge-based memory)」と呼ぶ独自のアプローチだ。

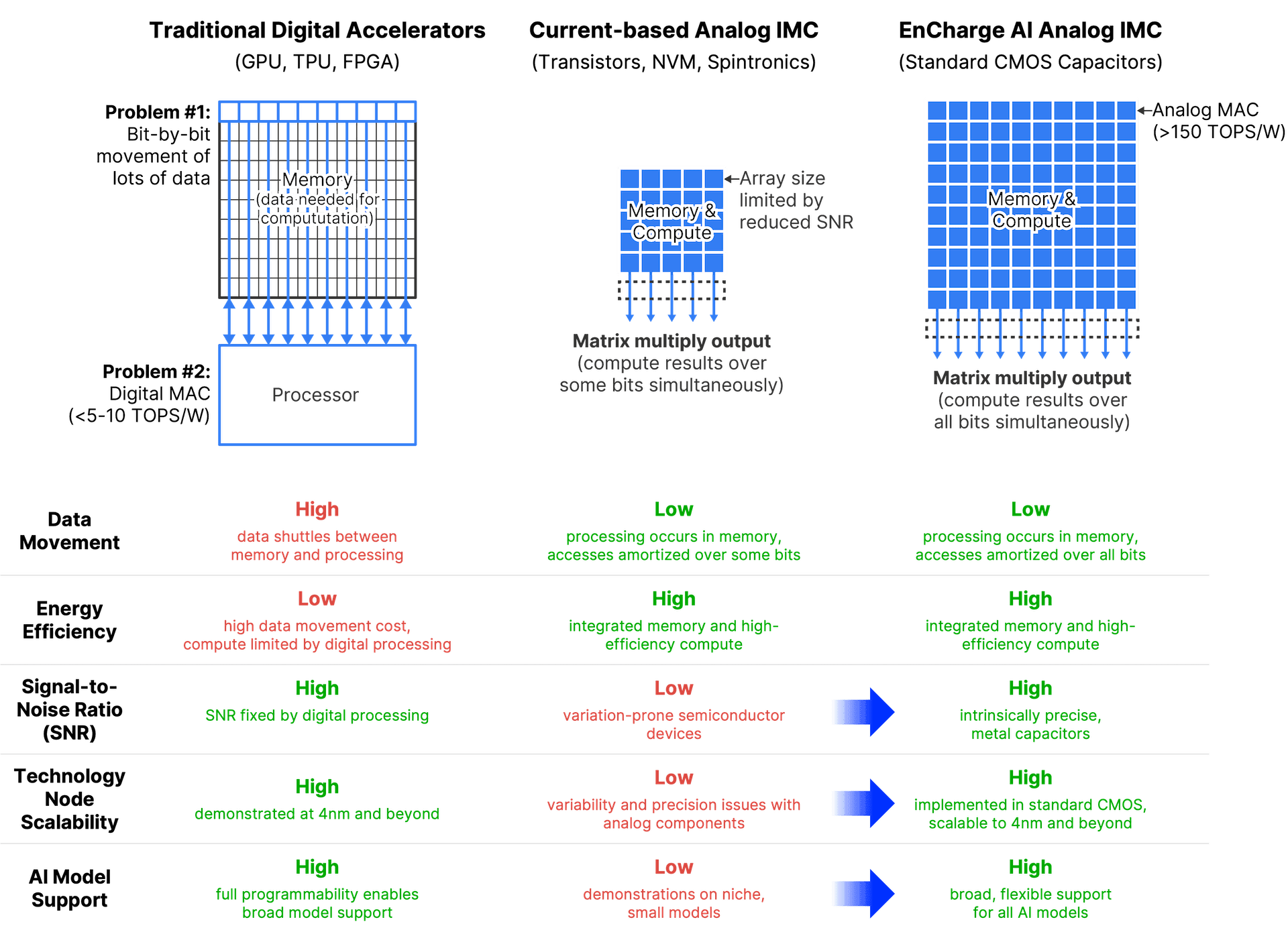

従来のデジタルコンピューティングでは、データはメモリとプロセッサ間を頻繁に移動する必要があり、このデータ移動が大きな電力消費と遅延の原因(いわゆるフォン・ノイマン・ボトルネック)となっていた。インメモリ・コンピューティングは、この問題を解決するため、メモリセル自体で演算処理を行う技術である。

EnCharge AIのチャージベースメモリは、このインメモリ・コンピューティングをアナログ領域で実現する。具体的には、データを個々のビットセルから読み出すのではなく、メモリプレーン上の電荷(電流の総和)から読み取る。これにより、ノイズに弱く精度を出しにくい半導体(トランジスタ)ベースのアナログ演算ではなく、より精密でスケーラブルなキャパシタ(コンデンサ)を利用した演算が可能になるという。結果として、特にAI処理で多用される行列積和演算のようなデータ削減処理において、劇的な効率向上が達成される。

Verma CEOは2022年のSiliconANGLEとのインタビューで、「(電荷を利用することで)半導体から非常に堅牢でスケーラブルなキャパシタに移行できます。これにより、演算が非常に正確に行えるようになります」と語っており、この技術がEN100の驚異的な電力効率(最大約20倍)と高い演算密度(従来のデジタルアーキテクチャ比で約10倍の30 TOPS/mm² 対 3 TOPS/mm²)の源泉となっていると考えられる。

要するに、EN100は個々のビットやバイトを細かくやり取りする代わりに、計算結果そのものを効率的に伝達することで、エネルギー消費を劇的に削減しているのだ。

用途で選べる2つのフォームファクタ:ラップトップからワークステーションまで

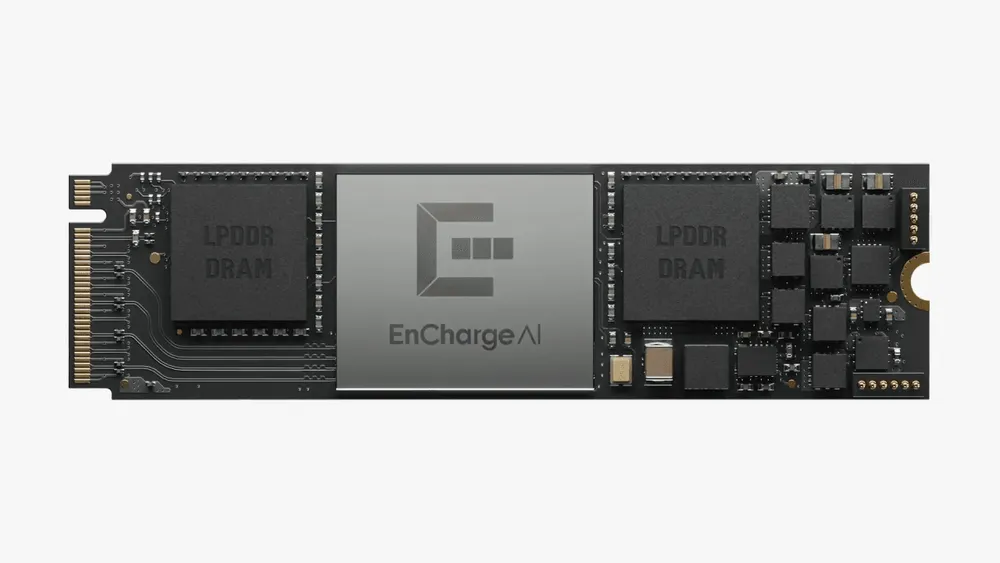

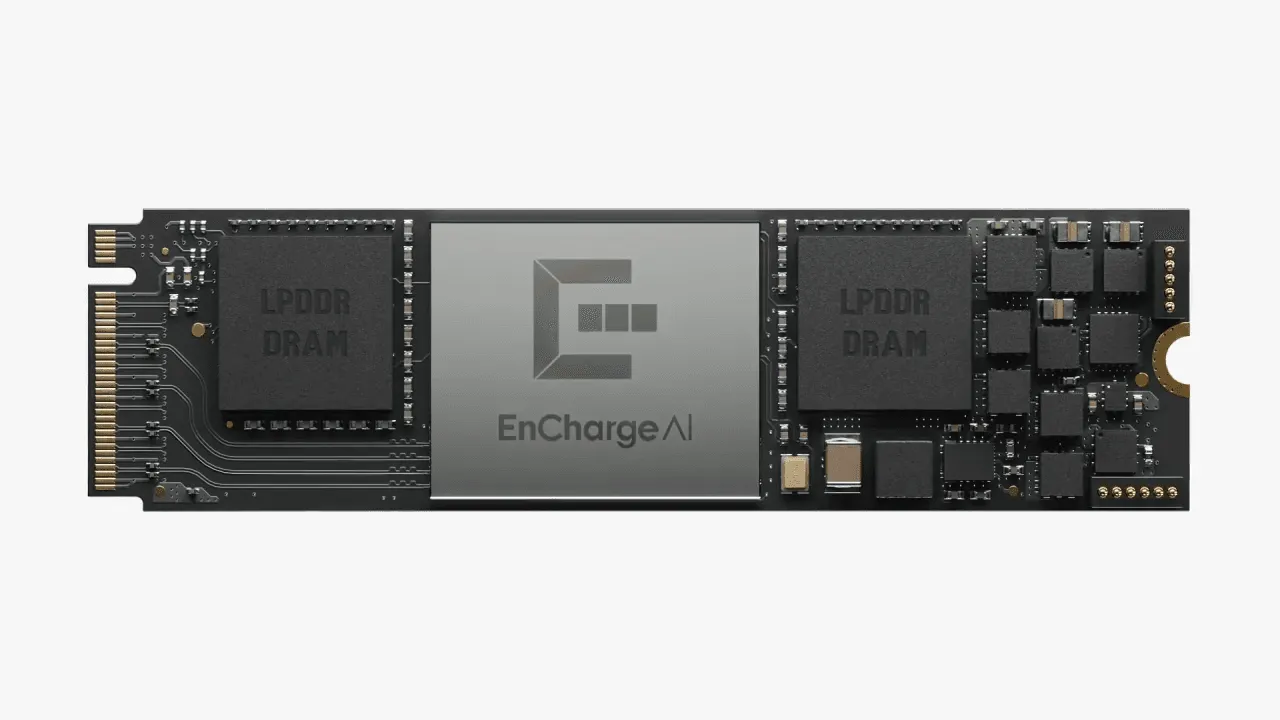

EnCharge AIは、EN100を2つのフォームファクタで提供する。\

- EN100 M.2 (ラップトップ向け):

- 最大200+ TOPSのAI演算性能

- 消費電力: 最大8.25W

- オンボードメモリ: 32GB LPDDR(最大68 GB/s帯域)

- フォームファクタ: M.2 2280

- 特徴: バッテリー駆動のデバイスでも、バッテリー寿命や携帯性を損なうことなく高度なAIアプリケーションの実行を可能にする。

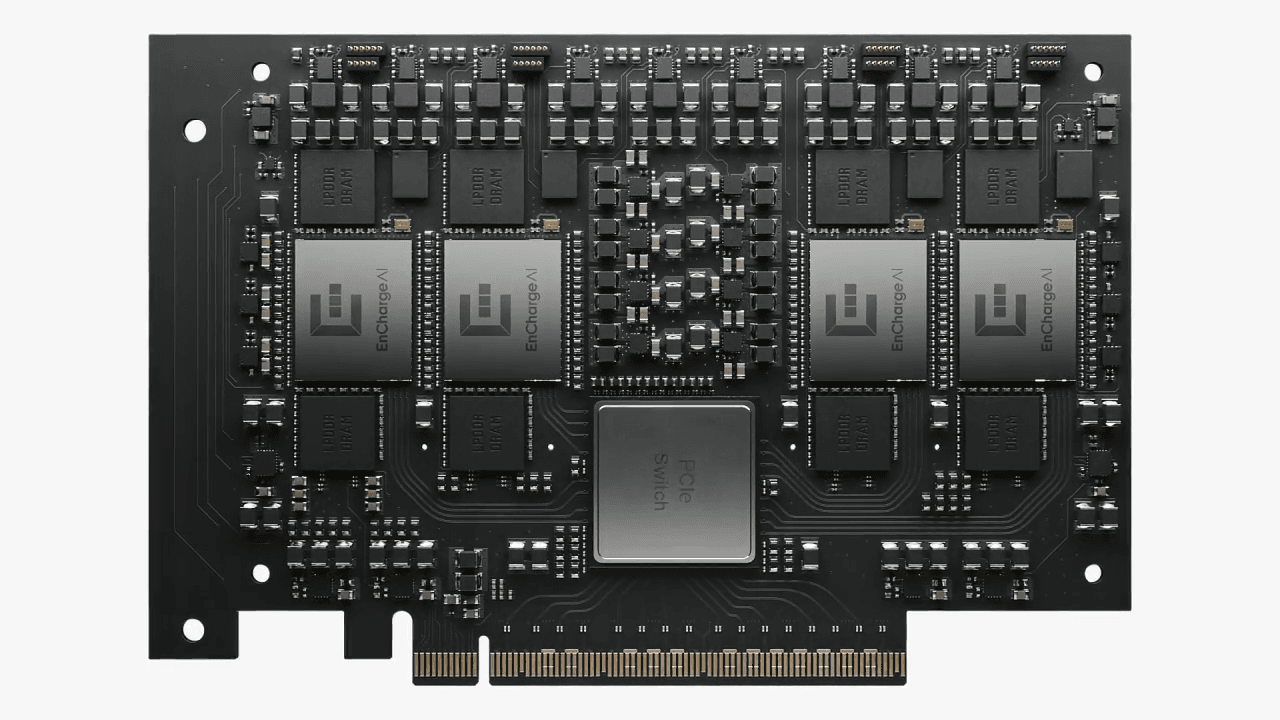

- EN100 PCIe (ワークステーション向け):

- 最大約1 PetaOPS (1000 TOPS) のAI演算性能 (4基のNPUを搭載)

- 消費電力: 最大40W

- オンボードメモリ: 128GB LPDDR(合計帯域272 GB/s)

- フォームファクタ: PCIe HHHL (Half-Height, Half-Length)

- 特徴: NVIDIAの最先端GPUに匹敵する演算能力を、はるかに低いコストと消費電力で実現。より高度なLLMや大規模データセットを利用するプロフェッショナルAIアプリケーション向け。

いずれのフォームファクタも、16nm CMOSプロセスで製造され、制御用としてマルチスレッドRISC-Vコアを搭載。これまでクラウドでの処理が一般的だった生成AIチャットボット、リアルタイムコンピュータビジョン、画像生成といったタスクをローカルデバイス上で実行可能にする能力を持つ。

開発者を強力にサポートするソフトウェアエコシステム

ハードウェアの性能を最大限に引き出すためには、ソフトウェアのサポートが不可欠だ。EnCharge AIは、EN100の性能を最大限に活用し、開発者が既存のプラットフォームへシームレスに統合できるよう、包括的なソフトウェアスイートを提供している。

- EnCharge Quantization Tools: PyTorch、Keras、JAXといった業界標準フレームワーク内で、8ビットおよび4ビット量子化をサポートし、AIモデルの構築やEnChargeシリコンへの最適化を容易にする。

- EnCharge Compiler Stack: AIモデルをEN100 NPU上で効率的かつ高性能に実行するためのコンパイラ。

- EnCharge Runtime Stack: 各推論リクエストに対して、低レベルランタイム、デバイスドライバ、ファームウェアへの接続を提供する。

- EN100 Toolkit: 最適化されたSDK、モデルズーサポート、パフォーマンス解析ツール(デバッガ、シミュレータなど)を提供し、製品統合のためのFAEサポートも用意されている。

これらのツール群は、TensorFlow、ONNX、Hugging Face Transformers、さらにはllama.cppやOllamaといった推論フレームワークもサポートしており、開発者は使い慣れた環境でEN100向けのAIアプリケーション開発を進めることができる。

プリンストン大学発、8年越しの研究が生んだ革新

EnCharge AIは、プリンストン大学で7年以上にわたり次世代コンピューティングアーキテクチャを研究してきたNaveen Verma氏(現CEO)らによって2022年に設立されたスタートアップだ。その研究は、AIモデルの巨大化・複雑化に伴う従来のチップアーキテクチャ(GPUなど)の限界、特にメモリとプロセッサ間のボトルネックや、それに伴うエネルギー消費の急増という課題認識から始まった。

Verma氏らのチームは、アナログ・インメモリ・コンピューティングにおけるノイズ問題などを克服するブレークスルーを達成し、その技術を商用化するためにEnCharge AIを立ち上げた。同社はこれまでにTiger Global Management、Samsung Ventures、IQT、RTX Ventures、Anzu Partnersなどから総額1億4400万ドル以上の資金を調達。2024年3月には、プリンストン大学と共同で、DARPA(米国防高等研究計画局)のOPTIMAプログラムから1860万ドルの助成金を獲得するなど、その技術力と将来性に対する期待は高い。

EnCharge AIが目指すのは、AIコンピューティングのあり方を根本から変革し、AIをデータセンターから解放することだ。これにより、サイズ、重量、電力に制約のあるデバイスや、低遅延・高プライバシーが求められるユースケースでも高度なAIが利用可能になり、家電製品から航空宇宙、防衛に至るまで、幅広い産業に大きな影響を与える可能性がある。

AIチップ市場における新たな選択肢と今後の展望

NVIDIAが支配的な地位を築くAIアクセラレータ市場において、EnCharge AIのEN100は、特にオンデバイスAIおよびエッジAIの領域で新たな選択肢を提示するものと言えるだろう。電力効率と演算密度を武器に、AI PC市場や、より小型のAI搭載デバイス市場での普及を目指す戦略は明確だ。

同社は、EN100が競合ソリューションと比較して、様々なAIワークロードにおいて最大約20倍のワット当たり性能を発揮すると主張しており、これは特にバッテリー駆動時間が重視されるモバイルデバイスや、発熱・消費電力の制約が厳しい組み込みシステムにおいて大きなアドバンテージとなる。

具体的なユースケースとしては、以下のようなものが挙げられている。

- 生産性向上: 常に動作し、ユーザーのデータや好みに安全かつプライベートにアクセスできるマルチモーダル生成AIアシスタント。会議やレポートの要約、ドキュメント作成、コーディング支援、リアルタイム翻訳、スケジュール管理などを実現。

- クリエイティビティ支援: テキスト、音声、画像、動画を横断的に扱えるマルチモーダルAIによるコンテンツ生成・編集。アイデア創出、反復作業、作品の洗練を支援。

- 没入型体験: 低遅延のオンデバイスAIによるフレームレート向上、応答性の高いNPC、プロシージャルコンテンツ生成などを通じた、新たなレベルのゲーミング体験。

EnCharge AIは、EN100の早期アクセスプログラム(EAP)の第1ラウンドが既に満員であると発表しており、関心の高さが伺える。現在は第2ラウンドの参加者を募集中だ。

このEN100の登場は、AI技術がより身近なものとなり、私たちの生活や仕事のあり方をさらに深く変革していく未来を予感させる。クラウドとエッジが協調し、それぞれの得意分野を活かすハイブリッドなAI活用が進む中で、EnCharge AIのような革新的な技術が果たす役割はますます大きくなるのではないだろうか。

Sources

- Encharge AI: EN100