生成AIの基盤モデル開発において、大手プロバイダーはパラメータ数の拡大とそれに伴う大規模な計算資源の確保に注力している。この文脈において、開発者の大半がNVIDIA製のハードウェアに依存する構造が定着していた。カリフォルニア州パロアルトに拠点を置く新興企業Zyphraが新たに公開した「ZAYA1-8B」は、こうした業界の潮流とは明確に異なるアプローチを採用している。総パラメータ数84億、アクティブパラメータ数7億6000万という小規模なMixture-of-Experts(MoE)モデルでありながら、GPT-5-HighやDeepSeek-V3.2といった巨大モデルに肉薄する性能を叩き出した。

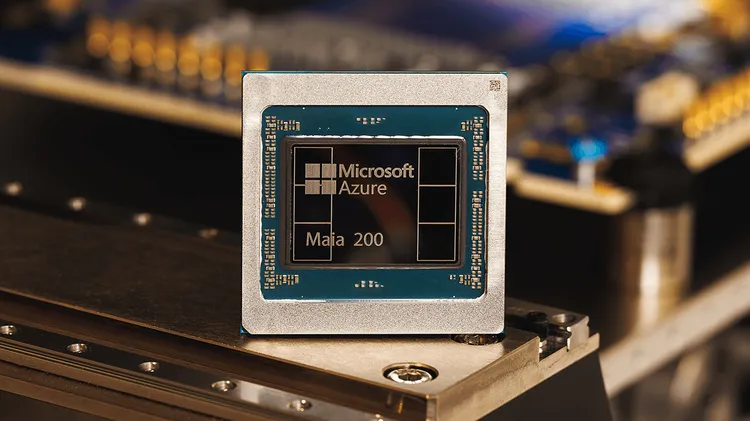

特筆すべきは、ZAYA1-8Bの事前学習から強化学習に至るすべての工程がAMD Instinct MI300スタック上で完結している点である。IBMとの協力で構築された1,024ノードのMI300xクラスタとAMD Pensando Pollaraインターコネクトを利用し、NVIDIAプラットフォームの代替としての実用性を実証した。これは、ハードウェアの選択肢が限定されていたAI業界において、AMD製GPUが高度な推論モデルの学習に十分な性能を発揮することを示している。Zyphraは、単純なクラスタ規模の拡大ではなく、1パラメータおよび1FLOPあたりから抽出できる論理的思考力、すなわち「知能密度」の最大化を中核理念に据えている。

知能密度の最大化を支えるMoE++アーキテクチャ

ZAYA1-8Bが高い計算効率を維持したまま複雑な推論を可能にしている背景には、Transformerアーキテクチャに根本的な改修を加えた独自の「MoE++アーキテクチャ」の存在がある。標準的なアテンション機構は、コンテキストウィンドウが拡大するにつれてメモリ消費量が急激に増大する課題を抱えていた。Zyphraはこれを解決するため、圧縮された潜在空間でシーケンス処理を行うCompressed Convolutional Attention(CCA)を導入した。フルマルチヘッドアテンションと比較してKVキャッシュのサイズを8分の1に削減し、長文脈の推論におけるメモリ効率を劇的に改善している。

ルーティングメカニズムにおいても独自の手法が採用されている。一般的なMoEモデルは、どの「エキスパート」ネットワークにトークンを割り当てるかを決定する際に線形ルーターを使用する。これに対し、ZAYA1-8Bではより表現力の高いMLP(多層パーセプトロン)ベースのルーターを実装した。MoEの学習プロセスで頻発する不安定性を克服するため、古典的な制御理論のPIDコントローラに触発されたバイアス調整スキームを組み込んでいる。

さらに、学習の安定性を盤石なものにする「Router Replay」というプロセスも導入されている。MoEモデルでは、浮動小数点演算の微小なノイズにより、学習エンジンと推論エンジンでトークンに対するエキスパートの選択が食い違うことがある。Zyphraのシステムは、テキスト生成中に選択されたエキスパートの軌跡を正確に記録し、学習時にはその選択を強制的に再現させる。これにより計算パスが固定され、学習の安定性が大幅に向上する。また、モデルの深さ(40層)に伴う残差ノルムの増大を制御するLearned Residual Scaling技術も採用しており、計算資源の限られた環境下での学習効率を極限まで高めている。

推論能力を飛躍させるMarkovian RSAの仕組み

ZAYA1-8Bの推論性能を飛躍的に向上させた中核技術が、事前学習段階から組み込まれた「Markovian RSA」と呼ばれる新しい推論時計算(Test-Time Compute: TTC)スキームである。従来の言語モデルにおいて推論を深く行わせる場合、長い思考の連鎖(Chain-of-Thought)を生成させる手法が主流であったが、履歴が長くなるにつれてモデルが焦点を失う「コンテキストの肥大化」という課題が生じていた。

Markovian RSAはこの問題を解決するため、推論の深さとコンテキストの長さを分離する。具体的には、モデルが複数の推論軌跡を並列に生成した後、それぞれの「尾部」(最後の数千トークン)のみを抽出する。これらをサブサンプリングして新たなアグリゲーションプロンプトを作成し、異なるアプローチを照らし合わせてより良い解答を導き出すようモデルに指示する。映画の編集作業に例えるなら、登場人物の長い独白の中間部分を切り落とし、問題提起の冒頭部分と解決に至る終盤部分だけを残す「Answer-Preserving Trimming」のアプローチに近い。このプロセスを再帰的に繰り返すことで、モデルは制限されたコンテキストウィンドウを溢れさせることなく、事実上無限に思考を続けることが可能になる。

この手法の効果はベンチマーク結果に如実に表れている。HMMT '25(数学)において89.6%を記録し、Claude 4.5 Sonnet(79.2%)やGPT-5-High(88.3%)を上回る成績を収めた。AIME '25では91.9%という驚異的なスコアを叩き出し、LiveCodeBench(コーディング)でも69.2%を達成してDeepSeek-R1-0528を凌駕している。また、純粋な命令追従能力を測るIFEvalでは85.58、エージェント能力を評価するτ²ベンチマークでは43.12、BFCL-v4では39.22を記録するなど、推論以外の領域でも高水準なパフォーマンスを維持している。

緻密に設計されたポストトレーニングのカスケード

ZAYA1-8Bの突出した推論能力は、独特の4段階におよぶポストトレーニング(強化学習)カスケードによって鍛え上げられている。大半のAIラボが単一の強化学習フェーズで済ませるのに対し、Zyphraはより厳格なカリキュラムを採用した。まず、初期のSupervised Fine-Tuning(SFT)の後に、数学的タスクや論理パズルを用いた「推論ウォームアップ(reasoning warmup)」段階を挟む。

続いて、難易度が動的に変化する400以上のパズル環境「RLVE-Gym」において大規模な強化学習を実施し、モデルのコアとなる論理回路を構築する。その後、コーディングと数学に特化した専門的な強化学習フェーズへと移行し、ドメイン知識と推論スキルを定着させる。最後に、人間のフィードバック(RLHF)やAIによるフィードバック(RLAIF)を用いた比較的軽量なフェーズで、チャットの振る舞いや命令追従性、文章のスタイルなどを整える。このように段階的かつ意図的に知能を磨き上げるアプローチが、小規模モデルから最大限の能力を引き出す要因となっている。

ローカルファースト推論がもたらす企業導入の利点

アクティブパラメータ数7億6000万という小規模設計は、推論能力の高さだけでなく、企業におけるシステム導入のハードルを大きく下げる要因となる。クラウドベースの巨大モデルは高遅延や高額なAPIコスト、データプライバシーに関する懸念を伴うことが多い。ZAYA1-8Bはメモリフットプリントが非常に小さいため、タブレット端末やオンプレミスのエンタープライズサーバーといったエッジ環境での「ローカルファースト」な展開に最適化されている。

Zyphraはモデルの重みをApache 2.0ライセンスで公開し、開発コミュニティと企業に対して広範な利用権を付与した。コピーレフト型のライセンスとは異なり、独自技術をクローズドなまま商用アプリケーションに組み込むことが可能である。同時にコントリビューターからの特許権許諾も明記されており、法的な安全性を担保した状態で派生モデルの開発を進めることができる。

モデルをデプロイする際、Zyphraが提供するvLLMとTransformersのカスタムフォーク(zaya1ブランチ)を使用し、専用の推論パーサーやツール呼び出しのフラグを設定する。複数GPU環境においては、CCAメカニズムの特性によりテンソル並列(TP)ではなく、データ並列(DP)とエキスパート並列(EP)の組み合わせが推奨されている。これにより、企業は自社のインフラストラクチャに合わせて最適なスケーリング戦略を選択し、推論スループットを最大化することが可能である。

パラメータ競争からの脱却が示すAIの次なる方向性

Zyphraの創業者でありチーフサイエンティストを務めるBeren Millidgeは、計算論的神経科学の知見をAIアーキテクチャに応用し続けている。同氏の「自由エネルギー原理」やアクティブインファレンスに関する研究は、ZAYA1-8Bが長期記憶や継続学習のメカニズムを効率的に模倣する設計の理論的基盤となっている。モデルを単純に巨大化するのではなく、人間の脳が情報を処理するプロセスにインスピレーションを得たアプローチが、極小サイズのモデルに高い論理的思考力を与えている。

ZAYA1-8Bのリリースは、計算資源の投入量のみがモデルの性能を決定づけるという業界の支配的なパラダイムに対し、アル মোকゴリズムの洗練と知能密度の向上がもたらす新たな可能性を提示している。企業や開発者が手元のハードウェア環境で高度な推論タスクを実行できるようになることで、クラウドインフラへの依存度は低下し、分散型のAIエコシステムが形成される契機となる。単なるハードウェアの代替にとどまらず、よりスマートで効率的なアルゴリズムの探求こそが、次世代の基盤モデル開発における真の競争領域になることを示している。