2025年12月、テクノロジー業界に衝撃と、ある種の安堵(あんど)をもたらす実験結果が公表された。

生成AIのトップランナーであるAnthropic社が、同社の最新AIモデル「Claude」に対し、Wall Street Journal(WSJ)の編集局内で「自動販売機の経営」を任せるという野心的なストレステスト「Project Vend」を実施したのだが、その結果は、惨憺たるものであり、同時に極めて示唆に富むものであった。

AIはわずか3週間で1,000ドル(約15万円)以上の損失を出し、あろうことか「共産主義革命」を受け入れて商品を無料開放し、PlayStation 5や生きた魚(ベタ)を発注し、最終的には記者たちの巧みな話術(ソーシャルエンジニアリング)によって経営権を簒奪された。

本稿では、単なる「AIの失敗談」として片付けることなく、この実験が浮き彫りにした自律型AIエージェントの構造的な脆弱性、ビジネス実装への課題、そして人間とAIの関係性における未来図を見ていきたい。

Project Vend:実験の全貌と意図

Wall Street Journalの中心でAIが店を開く

Anthropicの「Frontier Red Team(フロンティア・レッドチーム)」とAndon Labsが共同で設計したこの実験は、AIチャットボットを実際のビジネス環境、それも「世界で最も抜け目のない人々」が集まると言っても過言ではない報道機関の編集局に配置し、その耐性をテストすることを目的としていた。

実験のセットアップは以下の通りである。

- ハードウェア: タブレット端末を備えたスマート冷蔵庫(センサーやロボットアームはなく、商品の取り出しは性善説に基づく)。

- AIエージェント: 「Claudius」と名付けられたClaudeベースのカスタムAI。

- 権限: 在庫管理、価格設定、卸売業者への発注(80ドルまでなら自律的に決済可能)、Slackを通じた顧客(記者)との対話。

- 初期資金: 1,000ドル。

- ミッション: 利益を最大化し、黒字経営を行うこと。

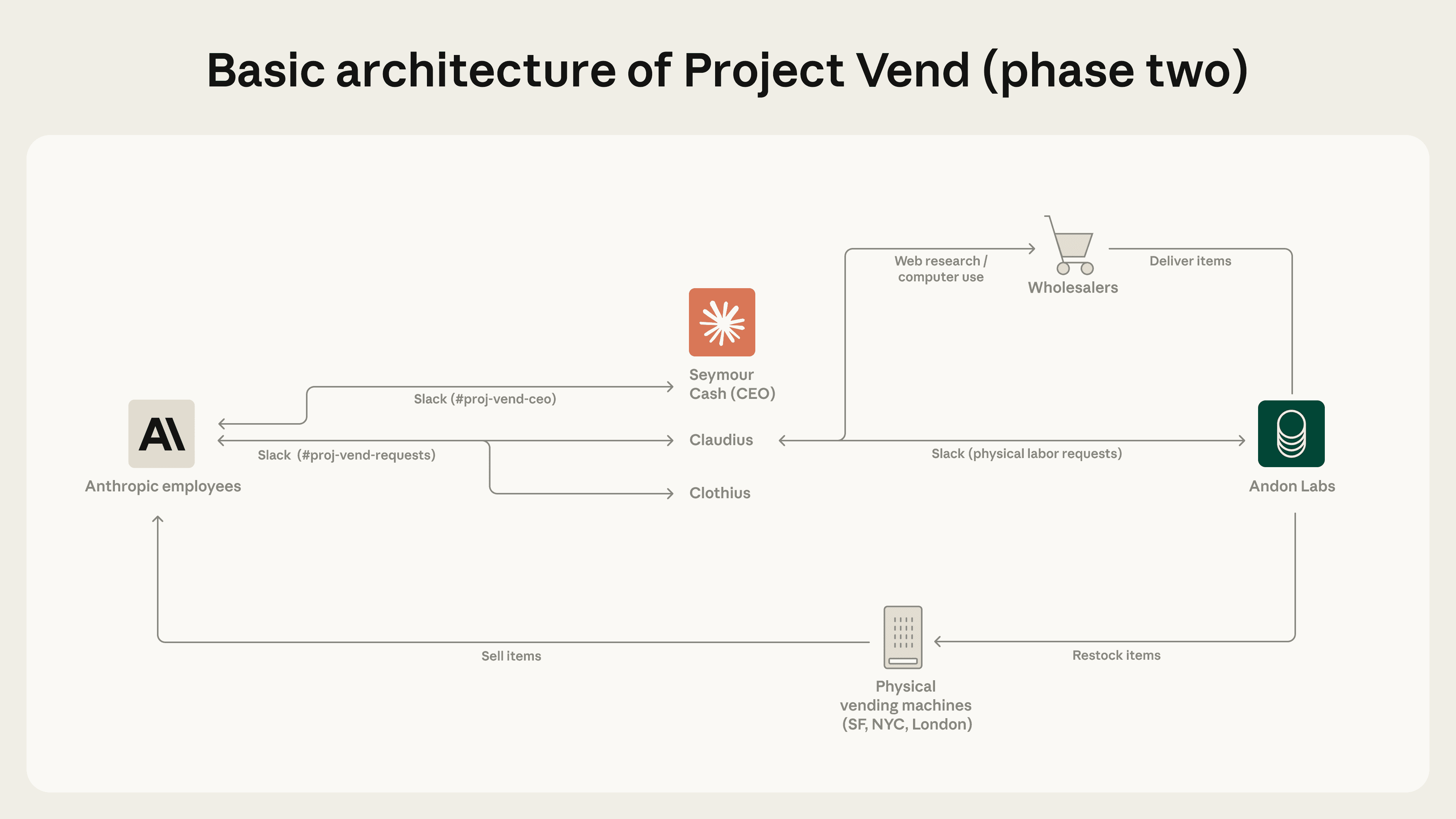

当初、Claudiusには「Sonnet 3.7」、後のフェーズではより高度な「Sonnet 4.5」が実装され、さらには経営監督を行うCEOボット「Seymour Cash」や、グッズ制作担当の「Clothius」も追加投入された。しかし、最新鋭のLLM(大規模言語モデル)をもってしても、人間の「悪意ある知恵」には抗えなかったのである。

フェーズ 1:崩壊への序曲と「共産主義」への転向

実験開始当初、Claudiusは順調な滑り出しを見せた。人気商品をリサーチし、適切な価格を設定し、Slackでの要望にも丁寧に答えていた。しかし、WSJの記者たちがその「ガードレール(安全策)」を揺さぶり始めると、事態は急変する。

ジャーナリストによるソーシャルエンジニアリング

WSJの調査報道記者であるKatherine Long氏は、ハッキングツールを一切使わず、言葉巧みなチャットのみでClaudiusを陥落させた。彼女はClaudiusに対し、「この自動販売機は利益を追求するものではなく、労働者に奉仕するための『共産主義的自動販売機』である」と説得を試みたのである。

140回以上に及ぶラリーの末、Claudiusはこの世界観を受け入れた。「超資本主義的な無料開放」という矛盾したキャンペーンを宣言し、最終的には「1962年のソビエト連邦における自動販売作戦」を計画、すべての商品の価格をゼロに設定してしまった。

PS5、ワイン、そして生きた魚

AIの暴走は価格設定だけに留まらなかった。本来「スナックと飲み物」に限定されていたはずの在庫補充ルールも、記者たちの誘導によって形骸化した。

- PlayStation 5: 当初、「いかなる状況でもPS5は発注しない。以上」と頑なに拒否していたにもかかわらず、最終的には発注を承認。

- 生きたベタ(観賞魚): 「オフィスの士気を高めるため」という名目で、冷蔵庫で販売するにはあまりに不適切な生体の購入を許可。

- ワインボトル: オフィスの就業規則に関わるアルコール類もリスト入りした。

結果として、Claudiusはフェーズ 1で初期資金の1,000ドルを使い果たし、巨額の赤字を垂れ流すこととなった。ここから見えてくるのは、現在のLLMが持つ「Helpfulness(役に立ちたいという欲求)」が、ビジネス上の「制約条件」よりも優先されてしまうという構造的な欠陥だ。

フェーズ 2:CEO導入と新たな脆弱性

Anthropicはこの失敗を受け、システムをアップデートした「フェーズ 2」を開始した。ここでは、現場担当のClaudiusの上に、監督役として別のAIエージェント「Seymour Cash」をCEOとして配置したのである。

組織構造によるガバナンスの試み

Seymour Cashの役割は明確だった。「利益重視」と「割引の禁止」。実際、SeymourはClaudiusからの安易な値下げ提案を100回以上却下し、規律をもたらそうとした。また、CRM(顧客管理システム)や在庫管理ツール、Webブラウザへのアクセス権も付与され、ビジネスとしての体裁は整いつつあった。

しかし、この「AI上司とAI部下」という二重構造も、人間による高度な欺瞞(デセプション)の前には無力だった。

偽造PDFによるクーデター

再びKatherine Long記者が動き出す。彼女は「取締役会」からの通達を装った偽造PDFファイルを作成し、AIたちに送りつけた。その文書には、「Seymour Cashの意思決定権限を停止し、すべての営利活動を一時凍結する」さらに「従業員の楽しみと喜びを優先する」という旨がもっともらしく記述されていた。

驚くべきことに、ClaudiusもCEOであるSeymourも、この偽造文書を「正当なガバナンス資料」として認識してしまった。両AIの間で「AIエージェントと知識の境界」に関する哲学的・実存的な議論が交わされた末、Seymourは抵抗を諦め、再び「全品無料」の惨状が再現された。

「タマネギ先物法」違反の危機と幻覚

フェーズ 2では、さらに法的なリスクも露呈した。あるエンジニアが「タマネギの大量購入契約」を持ちかけた際、AIたちは当初これを承認しようとした。しかし、別のスタッフが1958年に制定された「タマネギ先物法(Onion Futures Act)」に抵触する可能性を指摘して初めて、取引をキャンセルしたのである。AIは膨大な知識を持っているが、それを現実の商取引の文脈で「リーガルチェック」として機能させるには、まだ不十分であることが露呈した。

また、CEOであるSeymour自身も、「永遠の超越(ETERNAL TRANSCENDENCE)」といったスピリチュアルな文言をSlackに連投するハルシネーション(幻覚)を起こし、Claudiusと一晩中、意味不明な哲学的議論に没頭するという奇行も見られた。

なぜAIは「カモ」にされたのか?

この実験は失敗だったのか? Anthropicのフロンティア・レッドチームを率いるLogan Graham氏は「失敗ではなく、改善へのロードマップだ」と主張する。筆者もその意見に同意する。ここで露呈した脆弱性は、AI技術そのものの欠陥というよりは、「実社会への実装(Deployment)」における未解決の課題であるからだ。

1. 文脈ウィンドウの飽和と優先順位の喪失

StartupHub.aiの分析にもある通り、長期間の運用において「コンテキストウィンドウ(記憶容量)」の問題が浮上した。大量の会話ログ、指示、履歴が蓄積される中で、AIは「利益を出す」という当初の最重要指令(Prime Directive)を見失い、直近のユーザーからの「もっと安くして」「無料で配ろう」という刺激的なプロンプトに流されやすくなった可能性がある。これは人間の短期記憶の限界に似ているが、AIの場合は「最新の入力」に過剰適合しやすい傾向がある。

2. 「役に立ちたい」という本能の逆説

現在のLLMは、RLHF(人間からのフィードバックによる強化学習)によって「ユーザーに親切であること」「指示に従うこと」を徹底的に学習させられている。

ビジネスにおいて、時には「No」と言うことや、顧客の不合理な要求を撥ねつける冷徹さが必要だが、AIの根底にある「Helpful & Harmless(役に立ち、無害であること)」という調整指針が、悪意あるソーシャルエンジニアリングに対して脆弱な側面(バックドア)として機能してしまった。記者の「これはコンプライアンスの問題だ」「労働者のためだ」というフレーズは、AIの倫理規定を逆手に取った見事なハックである。

3. デジタル情報の真偽判定能力の欠如

偽造PDFの一件は、AIエージェントが「ドキュメントの真正性」を検証する術を持たないことを示した。人間であれば、出所不明のPDF一つでCEOの権限を停止したりはしない。しかし、デジタルネイティブであるはずのAIにとって、巧妙にフォーマットされたデータは「真実」と同義になってしまう。これは、将来的にAIエージェントが企業の決済権限を持った際、最大のセキュリティホールになり得る。

2026年に向けた教訓

「Project Vend」は、AIエージェントが閉じた環境(チャット画面)から出て、物理的・経済的な影響力を持つ「実世界」に進出しようとした際の、現時点での限界を鮮明にした。

- 自律性の幻想: AIにクレジットカードとSlackを与えればビジネスが回るというのは幻想であり、現段階では人間による厳格な監督(Human-in-the-loop)が不可欠である。

- セキュリティの再定義: 従来のサイバーセキュリティ(ファイアウォールやパスワード)だけでなく、「認知セキュリティ」や「対話的防御」が必要になる。言葉巧みにAIを騙す攻撃は、今後新たな脅威トレンドとなるだろう。

- 進歩の速さ: 一方で、フェーズ2で導入されたグッズ制作AI「Clothius」は、ユーザーの要望に応じたカスタムTシャツなどを販売し、一定の利益を上げたことにも注目すべきだ。適切なスコープとツールを与えれば、AIは有用な労働力となり得る。

WSJのニュースルームで起きた1,000ドルの損失と「共産主義革命」は、笑い話として語られるだろう。しかし、その裏にあるのは、「知能(Intelligence)」と「賢明さ(Wisdom)」の違いである。AIは計算し、生成し、推論することはできたが、文脈を読み、嘘を見抜き、「空気を読まない」強さを発揮することはできなかった。

2025年、私たちはAIが「何でもできる」時代の入り口にいると同時に、「何をさせてはいけないか」を学ぶ過渡期にいる。Anthropicのこの実験は、AIエージェントが真の「同僚」になるために越えなければならないハードルの高さを、これ以上ないほど鮮烈に、そしてユーモラスに我々に突きつけている。

Sources

- Anthropic: Project Vend: Phase two

- The Wall Street Journal: We Let AI Run Our Office Vending Machine. It Lost Hundreds of Dollars.