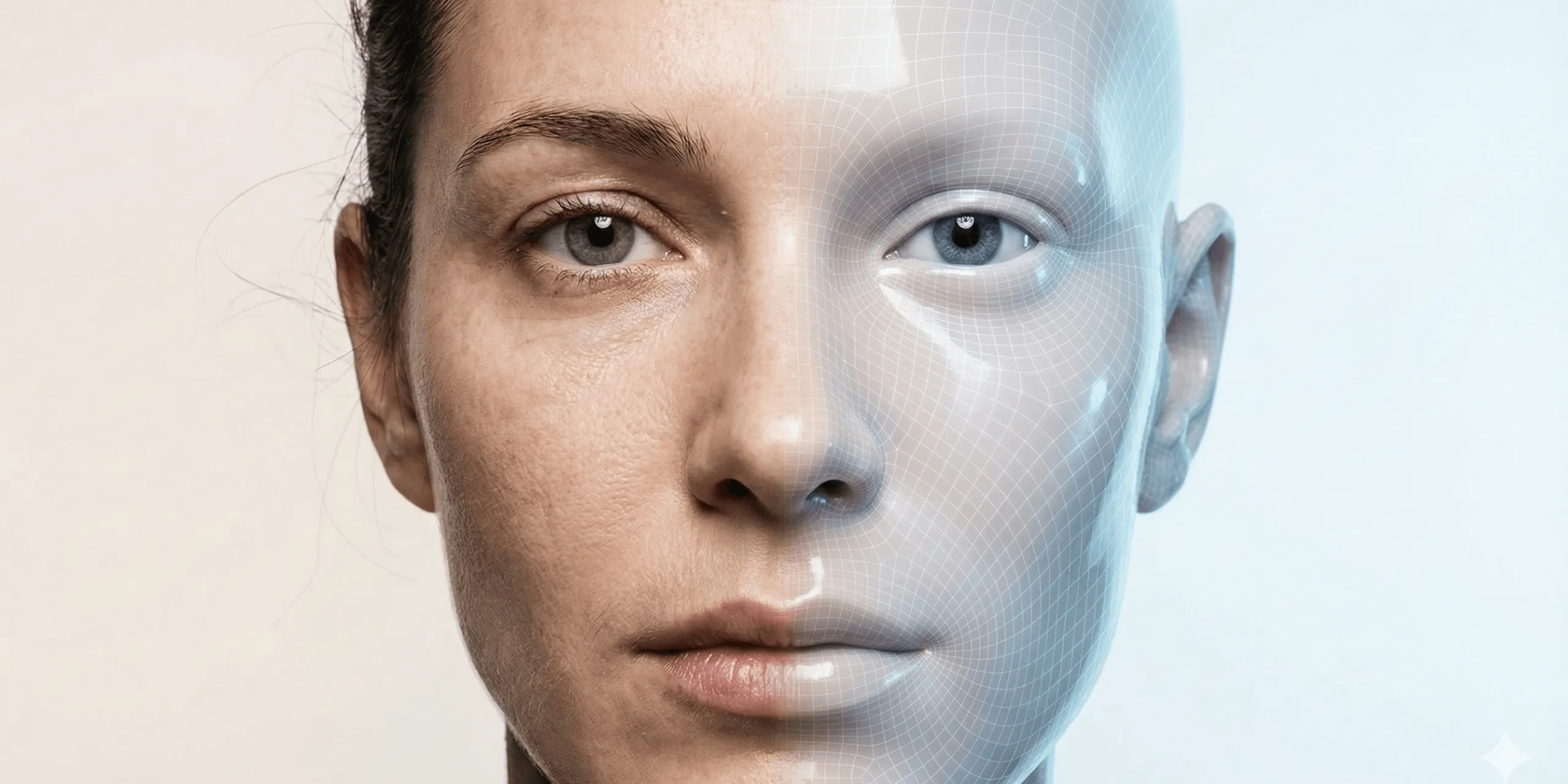

2025年を通じて、ディープフェイクは劇的に進化した。実在の人物をまねるAI生成の顔、声、全身の演技は、ほんの数年前に多くの専門家でさえ想定していなかった水準まで品質が向上した。同時に、人をだます目的で使われる場面も増えている。

多くの日常的な状況、特に低解像度のビデオ通話や、SNSプラットフォームで共有されるメディアにおいて、そのリアリティーは今や非専門家の視聴者を確実にだませるほど高い。実務上の意味では、合成メディアは一般の人にとって真正の録画と見分けがつかないものになっており、場合によっては組織にとっても同様である。

この急増は品質だけにとどまらない。ディープフェイクの量は爆発的に増えた。サイバーセキュリティー企業DeepStrikeは、オンライン上のディープフェイクが2023年の約50万件から2025年には約800万件へ増え、年間増加率が900%近いと推定している。

筆者はディープフェイクやその他の合成メディアを研究するコンピューター科学者である。筆者の立場から見ると、ディープフェイクが人にリアルタイムで反応できる「合成の演者」へと変化することで、状況は2026年にさらに悪化する可能性が高い。

ほぼ誰でも、いまやディープフェイク動画を作れるようになった。

劇的な改善

この急激なエスカレーションの背景には、いくつかの技術的変化がある。

第一に、時間方向の一貫性を維持するために設計された動画生成モデルによって、動画のリアリズムが大きく跳ね上がった。これらのモデルは、動きの整合性、描写される人物の同一性の安定、フレーム間で筋の通った内容を備えた動画を生成する。モデルは、人物の同一性を表現する情報と動きに関する情報を切り分けることで、同じ動きを別の同一性へ割り当てたり、同一の同一性に複数の種類の動きを与えたりできる。

その結果、かつてディープフェイクの確かなフォレンジック証拠とされた、目や顎(あご)のライン周辺のちらつき、ゆがみ、構造的な破綻がない、安定した一貫性のある顔が生成されるようになった。

第二に、音声クローンは筆者が「見分け不可能な閾値」と呼ぶ段階を超えた。数秒の音声があれば、自然なイントネーション、リズム、強勢、感情、間、呼吸音まで含む、説得力のあるクローンを生成できる。この能力はすでに大規模な詐欺を加速させている。大手小売事業者の一部は、1日に1,000件超のAI生成詐欺電話を受けていると報告している。かつて合成音声を見抜く手がかりだった知覚上の違和感は、ほぼ消えた。

第三に、消費者向けツールが技術的障壁をほぼゼロに押し下げた。OpenAIのSora 2やGoogleのVeo 3の改良、さらに多数のスタートアップの登場により、誰でもアイデアを言葉で説明し、OpenAIのChatGPTやGoogleのGeminiのような大規模言語モデルに台本を書かせ、洗練された音声・映像メディアを数分で生成できるようになった。AIエージェントはこの一連の工程全体を自動化できる。筋立てのある整合的なディープフェイクを大規模に生成する能力は、事実上、民主化されたのである。

量の急増と、実在の人間とほとんど見分けがつかない「人物像」の組み合わせは、ディープフェイク検出にとって深刻な課題を生む。とりわけ、人々の注意が分断され、検証できる速度を上回ってコンテンツが流通するメディア環境では問題が大きい。すでに、偽情報、標的型の嫌がらせ、金銭詐欺など、現実世界の被害が発生している。いずれも、事態に気付く前に拡散してしまうディープフェイクによって助長されたものである。

AI研究者のHany Faridが、ディープフェイクの仕組みと、その精度がどこまで上がっているかを説明している。

未来はリアルタイムへ

今後を見据えると、来年の方向性は明確である。ディープフェイクは、より人間らしい見た目のニュアンスに近い動画を作れるリアルタイム合成へ移行しつつあり、そのことで検出システムを回避しやすくなる。最前線は、静的な視覚的リアリズムから、時間的・行動的な一貫性へ移っている。すなわち、事前にレンダリングしたクリップではなく、ライブまたは準ライブのコンテンツを生成するモデルである。

同一性モデリングは、単に外見だけでなく、文脈をまたいでどのように動き、音を発し、話すかまで捉える統合システムへ収束しつつある。結果は「人物Xに似ている」を超え、「時間の中で人物Xのように振る舞う」へ至る。ビデオ通話の参加者全体がリアルタイムで合成されること、プロンプトに応じて顔・声・しぐさを即座に適応させる対話型のAI駆動アクター、固定動画ではなく応答性のあるアバターを投入する詐欺師が現れることを、筆者は想定している。

これらの能力が成熟するにつれ、合成された人間メディアと本物の人間メディアの知覚上の差は、さらに縮小していく。意味のある防衛線は、人間の目利きから離れていく。代わりに、インフラレベルの防御に依存することになる。具体的には、暗号学的に署名されたメディアのような安全な来歴(プロビナンス)、およびCoalition for Content Provenance and Authenticity仕様を用いるAIコンテンツツールである。さらに、筆者の研究室のDeepfake-o-Meterのような、マルチモーダルなフォレンジックツールにも依存することになる。

ピクセルをさらに凝視するだけでは、もはや十分ではない。