NVIDIAのAIアシスタント「G-Assist」が、新たにプラグイン機能を搭載した。これにより、ユーザーは独自のAI機能を作成・統合し、PCの操作性や機能を自分好みに拡張できるようになる。ゲームの最適化にとどまらず、日常的なタスクやエンターテイメントまで、AIによるPC体験の可能性が大きく広がりそうだ。

AIアシスタントを“育てる”時代へ:G-Assistプラグイン登場

NVIDIAは、GeForce RTX搭載PC向けのAIアシスタント「Project G-Assist」に、待望のプラグイン機能を追加したことを発表した。これは、単なる機能追加ではなく、G-Assistがユーザーと共に進化していくための重要な一歩と言える。これまでG-Assistは、主にゲームプレイ中のパフォーマンス監視や設定最適化といった、いわば「守り」の機能を提供する実験的なツールだった。しかし、プラグイン機能の導入により、ユーザー自身が「攻め」の機能、すなわち新しい能力をG-Assistに与えることが可能になる。

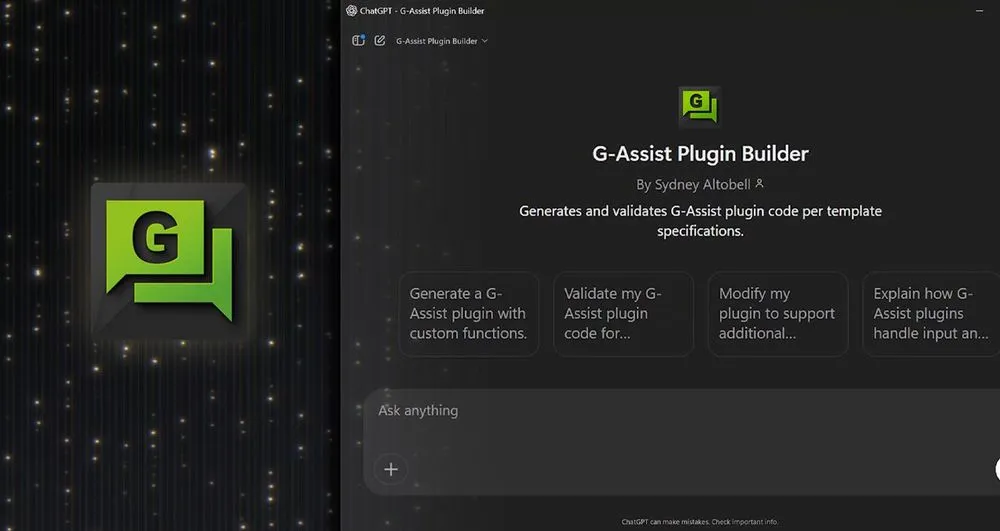

このカスタマイズの中核を担うのが、新たに提供される「G-Assist Plug-In Builder」だ。特筆すべきは、これがChatGPTベースである点だ。ユーザーは自然言語で指示を与えることで、プラグインに必要なコード(JSON形式の設定ファイルとPythonによるロジック)の雛形を生成できるという。これにより、プログラミング経験が少ないユーザーでも、比較的容易に独自のプラグイン開発に着手できる可能性がある。ただし、完全にコード不要というわけではなく、生成されたコードの理解や微調整、そしてAPI(Application Programming Interface)の知識がある程度求められる場面も想定されるため、全くの初心者には依然としてハードルがあるかもしれない。一方で、熟練した開発者にとっては、定型的なコード生成をAIに任せることで、より本質的な機能開発に集中できるメリットがあるだろう。

作成されたプラグインは、指定されたディレクトリに配置するだけでG-Assistに自動的に読み込まれ、NVIDIAのオーバーレイから直接、音声やテキストコマンドで呼び出すことが可能になる。アプリケーションを切り替える手間なく、シームレスに連携できるのは大きな利点である。

これらのプラグイン機能は、PCに搭載されたGeForce RTX GPU上でローカルに動作する比較的小規模な言語モデル(SLM: Small Language Model)によって支えられている。クラウドAIのように外部サーバーとの通信を必要としないため、応答速度が速く、プライバシーの観点からも有利であり、オフライン環境でも機能する。ただし、The Vergeによれば、このローカルSLMはアシスタント機能と音声認識のために約10GBのストレージ容量を必要とし、GPUには最低でも12GBのVRAMが要求される点は留意が必要だ。対応GPUはRTX 30シリーズ以降とされている。

Spotify操作からGemini連携まで:広がるプラグインの可能性

では、具体的にどのようなプラグインが利用可能、あるいは作成可能なのだろうか。NVIDIAはすでにいくつかのサンプルプラグインをGitHubリポジトリで公開しており、ユーザーはその可能性の一端に触れることができる。

- Spotify連携: 「次の曲にして」「音量を上げて」といった音声コマンドで、Spotifyの音楽再生や音量調整をハンズフリーで行える。

- Google Gemini連携: G-Assist単体では難しい複雑な質問への回答や、ブレインストーミング、Web検索などを、Googleの大規模言語モデルGemini(無料のGoogle AI Studio APIキーが必要)に依頼できる。例えば、ゲーム『Apex Legends』でソロプレイ時におすすめのキャラクターを尋ねたり、『Diablo IV』の高難易度モードに挑戦すべきかアドバイスを求めたりといった使い方が紹介されている。

- Twitch連携: 「ねぇTwitch、[配信者名]はライブ中?」のように、特定のストリーマーが配信中かどうかを声で確認できる。NVIDIAが公開したデモ動画では、Plug-In Builderを使ってこの機能を作成する様子が紹介されており、テキストプロンプトからわずか数分で動作するプラグインが完成する様子が示されている。

- ペリフェラル制御: 対応するLogitech G、Corsair、MSI、Nanoleaf製のデバイスのRGBライティングを変更したり、ファン速度を調整したりといったハードウェア制御をコマンドで実行できる。

- 株価チェッカー: 指定した銘柄のリアルタイム株価やパフォーマンスデータを素早く表示する。

- 天気予報: 都市名を指定して現在の天気を確認できる。

これらはあくまで一例であり、プラグインの可能性はアイデア次第で無限に広がる。NVIDIAは開発者向けに、GitHubリポジトリでサンプルコード、詳細な手順、ドキュメントを公開している。開発者はJSONで機能を定義し、Pythonでロジックを記述することで、独自のプラグインを作成できる。

さらに、NVIDIAは開発コミュニティの活性化を促しており、作成したプラグインをレビューのために提出し、承認されれば公式リポジトリに追加され、他のユーザーも利用できるようになる可能性がある。また、開発のヒントとして、publicapis.devやfree-apis.github.ioといった、無料で利用可能なAPIを検索できるディレクトリの活用も推奨している。

このプラグインアーキテクチャは、G-Assistを単なるNVIDIA製ソフトウェアの枠を超え、より広範なPCエコシステムと連携するためのハブへと進化させる可能性を秘めている。将来的には、Langflowのようなエージェントフレームワークと統合し、より複雑なAIパイプラインやマルチエージェントシステムの一部としてG-Assistが機能することも視野に入れられているようだ。

G-Assistおよびプラグイン機能は、NVIDIAアプリ(旧GeForce Experience)の実験的機能として提供されており、対応するRTX GPU(30シリーズ以降、12GB VRAM以上推奨)を搭載したPCで利用できる。AIによるPC体験のパーソナライズに興味があるユーザーや開発者にとって、G-Assistプラグインは非常に魅力的な新機能と言えるだろう。

Sources