人工知能(AI)の急速な進化と社会実装は、データセンターの処理能力と電力網に前例のない負荷をかけつつある。OpenAIのDALL-E、Midjourney、あるいはStable Diffusionといった最先端の画像生成AIモデルは、精密で写真のような画像を数秒で生成する驚異的な能力を持つ一方で、そのプロセスにおいて莫大な計算資源とエネルギーを浪費している。この「計算能力の向上に伴うエネルギー消費の爆発的な増加」という物理的かつ経済的な限界に対し、突破口を開く可能性を秘めた新たな潮流が学術界と産業界の一部で急速に注目を集めている。それが、「熱力学コンピューティング(Thermodynamic Computing)」だ。

ローレンス・バークレー国立研究所(Lawrence Berkeley National Laboratory)の研究員であるStephen Whitelam氏らが率いる研究チームは、この熱力学コンピューティングの概念を画像生成に応用すれば、従来のデジタルハードウェアと比較して計算に必要な全体的なエネルギーコストをはるかに低く抑えることができるという見解を示した。そのエネルギー削減効果は理論上、数桁に及び、現在のツールの数分の一どころか最大で「100億分の一」に達する可能性すらあるとされている。

計算のパラダイムシフト:ノイズを排除するのではなく「計算エンジン」として利用する

現代の主軸となっているコンピューティングシステムは、厳格な決定論的プロセスに基づくデジタル半導体回路で構成されている。そこでは、情報は確定的な「0」と「1」のバイナリ値として扱われ、論理ゲートを通じて正確な演算が行われる。しかし、ミクロの物理世界において、環境には常に分子の振動やまばらな電子の振る舞いに起因する「熱ノイズ(熱ゆらぎ)」が存在している。

従来の半導体工学は、論理値を反転させる演算において、この自然界の熱ノイズよりも圧倒的に大きなエネルギー(電圧)をシステムに印加することで、ノイズを意図的に押し殺すアプローチをとってきた。エラーを排除し、計算の堅牢性を担保するためには必要な措置であるが、この設計思想こそが電力消費を劇的に押し上げる最大の要因である。Whitelam氏はこの構図を、海の「波」を進む「船」のアナロジーで説明している。現代のデジタルコンピューティングは、海の波(熱ノイズ)を意に介することなく、エンジンを全開にして強引に海を突き進む巨大な「外洋客船」に等しい。目的を達成する確実性は極めて高いが、そのために消費される燃料(エネルギー)コストはすさまじい。

対照的に、熱力学コンピューティングが目指すのは、「波のエネルギーをそのまま推進力へと変換するサーファー」のような振る舞いだ。熱力学コンピュータは、物理回路が環境の熱変動や確率的なノイズに対して自然に応答する性質を利用し、低エネルギーでの計算を実行する。計算プロセスを駆動するために高い電圧をかけてノイズをねじ伏せるのではなく、むしろ自然発生する物理的なノイズ自体を確率的な遷移プロセスとして受け入れ、答えを導き出すためのエネルギーとして再利用する。回路をノイズレベルまで微小なエネルギーで動作させることは、大海原で小さな動力のディンギーを操舵するような難しさがあるものの、それを制御し「波に乗る」ことができれば、エネルギー効率の桁違いな改善が見込まれる。

拡散モデルの深奥とランジュバン方程式の邂逅

現在の画像生成AIの心臓部となっている技術は、「拡散モデル(Diffusion Models)」だ。この技術は、2015年頃のSohl-Dicksteinらの研究を始点として飛躍的に発展したものであり、元の画像データに対して徐々にノイズを付加し、完全に原型を留めないランダムな砂嵐のようなデータへと劣化させる。その後、ニューラルネットワークに対して、その逆プロセスの「ノイズを一段階ずつ除去して元の構造を復元する手順」を学習させるというものだ。

デジタルコンピュータでこのノイズ付加と除去の学習プロセスを模倣する場合、システムは擬似乱数生成アルゴリズムを利用して意図的にノイズデータを生成し、さらにその逆計算を決定論的な回路の上でゴリ押し計算しなければならない。これは極めて非効率で計算負荷の高い作業を要求する。

Whitelam氏の鋭い洞察は、この「拡散プロセス」自体が、もともとは統計力学および熱力学における古典的な物理現象であるという事実に根ざしている。自然界における粒子の拡散や分散現象は、1908年に提案された「ランジュバン方程式(Langevin equation)」によって数学的に記述される。この方程式は、システムが大きなノイズの影響下でどのように遷移していくかを時間の関数として計算するものである。言い換えれば、「画像がノイズに埋もれていく過程」における各ピクセルのランダムな変化確率は、物理法則によって元々自然に算出されている。

研究チームは、この物理法則を利用し、回路のコンポーネント間で自然に生じるノイズの変動を利用して確率を計算し、状態間の「結合強度(coupling strengths)」を調整するというアプローチをとった。熱平衡状態に向かうランダムな変動の中で、どの遷移が目標となるパターン再構築に結びつくかを確率的に評価し、結合を強化したり弱めたりする。Physical Review Lettersに発表されたシミュレーションにおいては、デジタル回路や膨大な電力を消費する疑似乱数生成器を使用せずとも、「0」や「1」、「2」といった手書き数字の画像をノイズから生成できることが見事に実証されている。

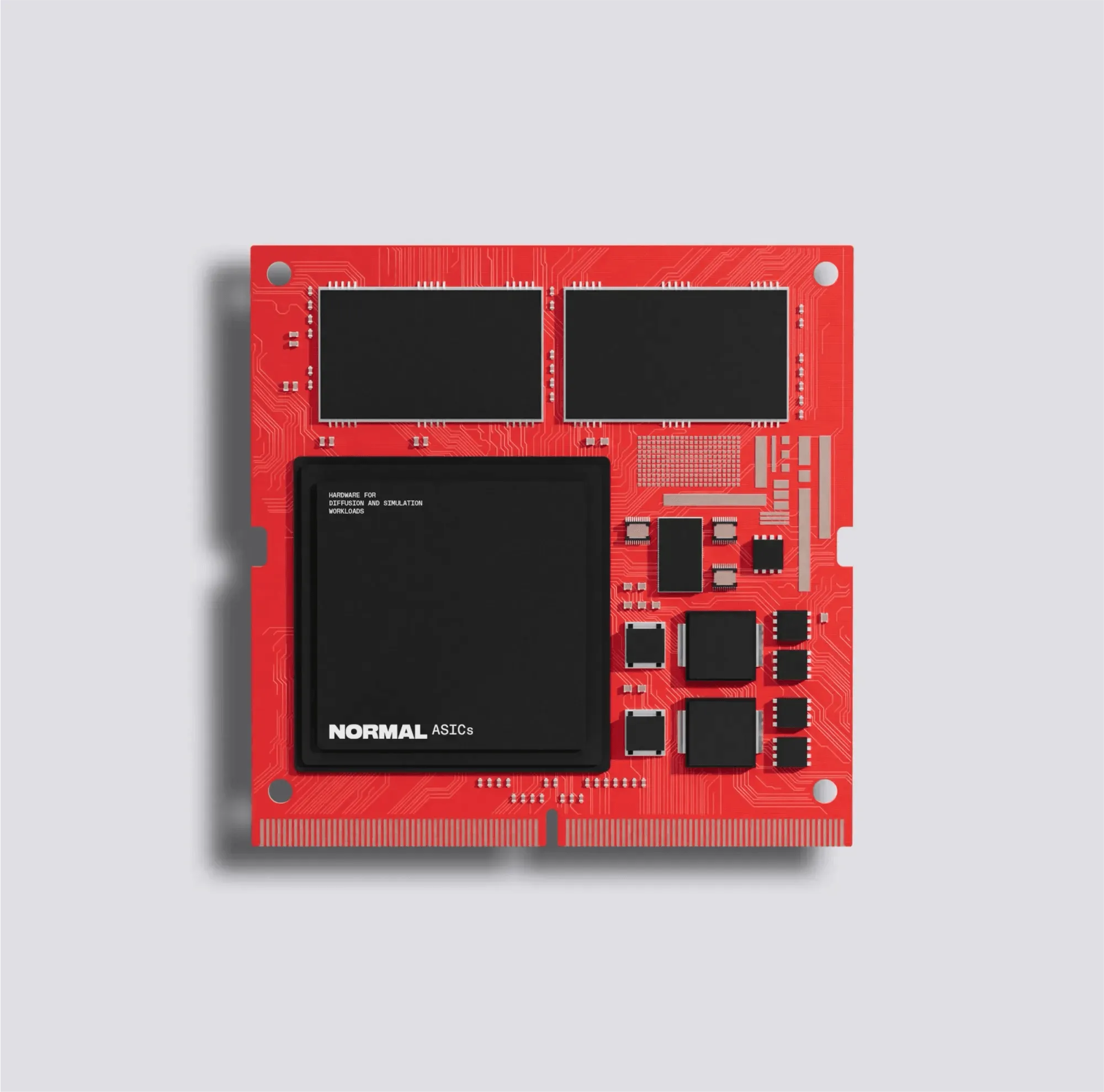

Normal Computingが示す実用化のロードマップと「CN101」の凄み

熱力学コンピューティングはすでに学術的な理論の枠を超え、商用化への第一歩を踏み出している。Google Brain、Google X、そしてPalantirの元主要エンジニアたちによって設立されたスタートアップ企業「Normal Computing」は、世界初の熱力学ベースの半導体チップ「CN101」をテープアウト(論理設計を完了し、物理的製造工程へ移行)したと発表し、業界に衝撃を与えた。

「CN101」は、環境のゆらぎやエントロピーの散逸、確率的変動といった物理現象に内在するダイナミクスを直接的にアルゴリズム処理の動力源として活用する「物理ベースのASIC(特定用途向け集積回路)」である。この次世代チップは、AIのワークロードを支える根幹である線形代数計算、行列演算、さらには格子ランダムウォークによる確率的サンプリングに最適化されている。同社によれば、このアーキテクチャは従来の決定論的半導体チップの理論限界を大幅に凌駕し、エネルギー消費効率をおよそ1,000倍に高める潜在能力を有しているという。

特筆すべきは、同社の描く事業ロードマップの明確さにある。CN101の製造完了を皮切りに、Normal Computingはすでに高解像度の画像拡散モデル処理に対応する「CN201」、ならびにさらに計算要求の厳しい最新の実写映像生成・動画拡散モデル向けの「CN301」の設計に着手している。これらの進捗は、熱力学コンピューティングが机上の空論から脱却し、数年以内にエンタープライズ領域の実在するデータセンターのラックにマウントされる現実的なハードウェアとなることを強く示唆している。

「スケーリング則」の壁の突破と業界アーキテクチャの再構築へ

現在進行中のAI競争の本質は「力技の演算競争」である。莫大な投資によってGPUクラスタを数百、数千と並列化させ、モデルパラメータとデータ量を増大させることで精度を上げるという「スケーリング則(Scaling Laws)」が業界を牽引してきた。しかし、この戦術に基づく限り、計算資源の確保とそれを動かす電力網の制約という物理的な壁に衝突することは避けられない。AI市場を牽引するNVIDIAなどの巨大テック企業が提供するハードウェアは、あくまで決定論的デジタル回路をいかに並列化・高速化するかという従来技術の最適化の延長にある。

熱力学コンピューティングは、この硬直化したゲームのルールを完全に覆す。電力を投じて答えを「計算する」のではなく、設計された物理システムのゆらぎを観測し、システムが自然に熱平衡へと向かう過程で答えを「読み取る」アプローチである。もしこの手法が大規模なスケールで実現可能となれば、現在AIモデルの学習・推論インフラに課せられている電力問題や排熱問題の多くが解消される可能性がある。

さらに注目すべき付加価値として挙げられるのが、ブラックボックス化するAIに対する「解釈の明瞭化」である。確率的コンピューティングに取り組むQuantum DiceのCEO、Ramy Shelbaya氏が述べている通り、物理学に触発されたモデルは、アルゴリズムがどのように結果を導き出したのかについての基礎的な解釈手段を提供する可能性がある。熱力学的なパラメータの遷移として学習プロセスを可視化できれば、現在の深層学習モデルが抱えるアライメントや説明可能性の欠如といった深刻な課題に対しても、強力な解決の糸口を提供できるかもしれない。

もちろん、商用化に至るまでの道程には巨大な技術的ハードルが待ち構えている。Whitelam氏も率直に認めている通り、システムを設計・制御するための材料工学、量子力学的ノイズからマクロな信号への増幅、そして新しい確率論的プログラミングインターフェースの整備など、課題は山積している。熱力学コンピュータによって生成された単純な数字画像と、DALL-Eクラスのモデルが生成する複雑な概念の合成画像の間のギャップを埋めるハードウェアの設計手法は、未だ確立されていないのが現状である。

だが、明らかなのは、これまでの「無限のエネルギー消費」を前提としたアーキテクチャが限界を迎えつつあるということだ。技術進化と持続可能性(サステナビリティ)の両立が至上命題となる次の十年において、熱力学コンピューティングが切り拓く根本的なパラダイムシフトは、エネルギー効率と計算の歴史に新たなマイルストーンを刻むことになるだろう。

論文

- Physical Review Letters: Generative Thermodynamic Computing

参考文献

- IEEE Spectrum: Thermodynamic Computing Slashes AI-Image Energy Use