ドイツ・ケルンで開催されたGamescom 2025の舞台で、NVIDIAは同社のAIアシスタント「Project G-Assist」の未来を占う重要なアップデートを発表した。新しい軽量AIモデルの採用により、これまでハイエンドGPUの特権とされてきたこの機能が、VRAM 6GB以上のあらゆるRTX GPUで利用可能になる。さらに、mod.ioとの協業による「G-Assist Plug-In Hub」の登場は、AIアシスタントの可能性を飛躍的に広げるものとして、業界の注目を集めている。

AIアシスタント普及の障壁を打ち破る技術的ブレークスルー

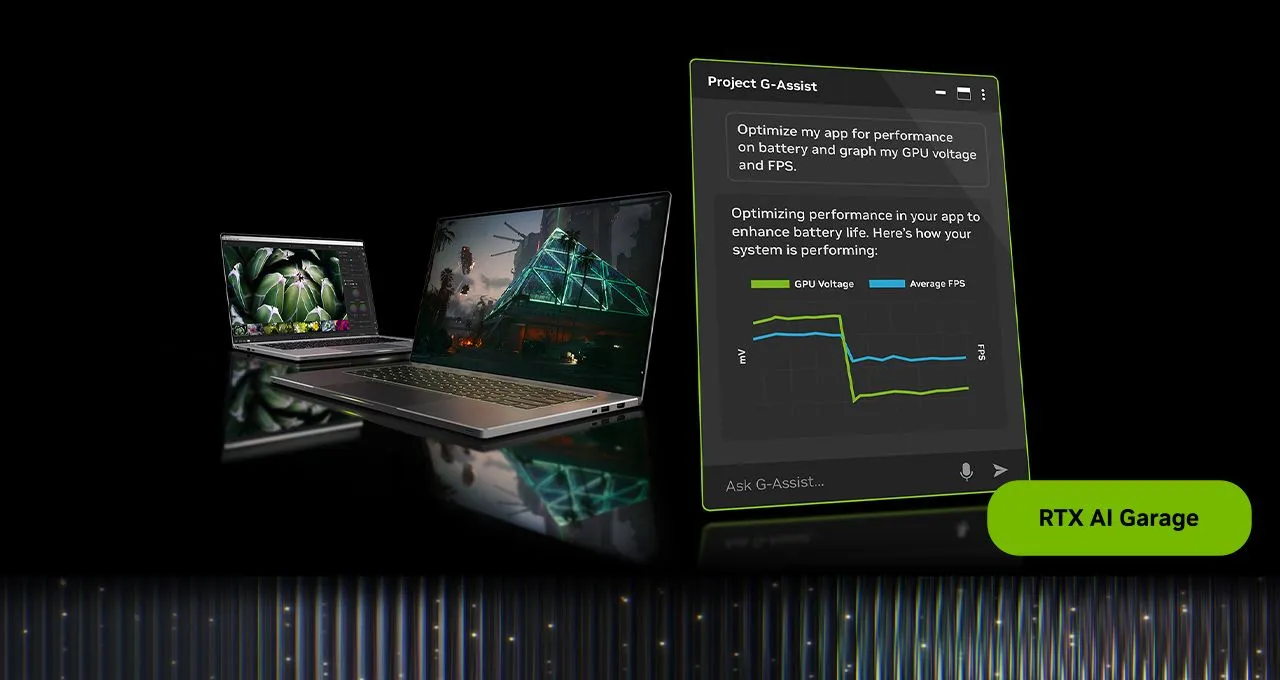

Project G-Assistは、複雑化する一方のPC設定を、音声やテキストによる自然言語で制御可能にすることを目指す野心的な試みだ。ゲームのパフォーマンス最適化から、フレームレートの表示、GPU温度の監視、さらにはキーボードのライティング調整まで、これまで複数のソフトウェアを渡り歩く必要があった操作をAIが一手に引き受ける。

しかし、その先進性には高い代償が伴った。初期バージョンは、動作に12GB以上のVRAMを要求。これは、NVIDIAの現行世代であるRTX 50シリーズですら、RTX 5060や5060 Tiといったミドルレンジモデルを対象外とする、極めて高いハードルだった。多くのゲーマーにとって、G-Assistは「絵に描いた餅」に過ぎなかったのが実情だ。

今回発表されたアップデートの核心は、この状況を劇的に変える点にある。NVIDIAは、G-Assistの頭脳であるAIモデルを根本から見直し、大幅に効率化。その結果、VRAM使用量を実に40%も削減することに成功した。応答精度を維持したまま、より高速に応答できるようになったという。

動作要件がVRAM 6GB以上に引き下げられたことで、GeForce RTX 2060のような数世代前のモデルから、最新のラップトップに搭載されるモバイルGPUまで、膨大な数のRTX搭載PCが新たにG-Assistの利用対象となる。NVIDIAによれば、これはデスクトップPCだけでなく、ラップトップも含まれる。まさにAIアシスタントの門戸が、大多数のRTXユーザーに向けて開かれた瞬間と言えるだろう。

VRAM 40%削減の舞台裏

この劇的なメモリ削減は、最適化によるもののみならず、オンデバイスAI技術の進化を物語っている。オンデバイスAI、つまりクラウドサーバーを介さずユーザーのPC内で処理を完結させるAIは、応答速度とプライバシー保護の面で優れる一方、PCのリソース、特にGPUのVRAMを大きく消費するという課題を抱えていた。

NVIDIAが今回、どのようにして40%もの削減を達成したのか、その詳細な技術は明かされていない。しかし、モデルの量子化(データ精度を少し落としてサイズを圧縮する技術)や蒸留(巨大な教師モデルから、性能を維持したまま小さな生徒モデルを作成する技術)、そしてアーキテクチャそのものの改良など、複数の最先端技術が投入されたものと考えられる。重要なのは、この効率化がPCゲームという極めてリソース要求の厳しいアプリケーションと並行して動作するAIアシスタントで実現されたという事実だ。これは、今後のAI PC開発における重要なマイルストーンとなるに違いない。

「できること」を無限に拡張するG-Assist Plug-In Hub

今回のアップデートでは、動作要件以外にも注目すべき点がある。NVIDIAは、MODコミュニティプラットフォームの雄である「mod.io」と提携し、「G-Assist Plug-In Hub」を立ち上げることを発表した。これは、G-Assistの機能をユーザー自身が拡張できる、オープンなエコシステムの創出を目指すものだ。

プラグインはJSONとPythonスクリプトをベースに開発でき、NVIDIAは自然言語でプラグインの骨格を生成できる「Plug-In Builder」も提供し、開発のハードルを下げている。

すでに開催されたハッカソンからは、その可能性を示す興味深いプラグインが生まれている。

- Omniplay: ゲームをプレイしながら、オンラインのWikiで設定や物語の背景を調べたり、リアルタイムでメモを取ったりできる。

- Launchpad: 生産性を高めるため、特定のアプリグループをワンコマンドで起動・切り替えできる。

- Flux NIM Microservice for G-Assist: G-Assist内から、PC上で動作するNVIDIA NIM(推論マイクロサービス)を利用してAI画像を生成する。

これらの例が示すように、プラグインの登場によって、G-Assistは単なるシステム最適化ツールから、ゲームプレイそのものを豊かにし、生産性をも向上させる包括的なアシスタントへと進化するポテンシャルを秘めている。ユーザーはG-Assistに話しかけるだけで、ハブから新しいプラグインを検索し、インストールすることさえ可能になるという。筆者は、このプラグインエコシステムの成否こそが、G-Assistの長期的な価値を決定づける鍵となると考えている。

パフォーマンス問題は克服されたか?

輝かしい未来像が描かれる一方で、我々は冷静に現実を見つめる必要がある。G-Assistの初期バージョン(v0.1)は、そのコンセプトとは裏腹に、深刻なパフォーマンス問題を抱えていた。

Windows Centralが2025年3月に行ったテストでは、16GBのVRAMを搭載したハイエンドGPU「RTX 5080」ですら、G-Assistを使用した際にフレームレートが3桁から1桁にまで激減したり、システムが完全にフリーズしたりする事態が報告されている。「G-Syncは有効ですか?」といった単純な質問でさえ、ゲームをクラッシュ寸前に追い込んだという。

今回の「軽量化」が、この致命的なパフォーマンス問題を解決する保証はどこにもない。VRAM使用量の削減は、あくまでAIモデルが占有するメモリ量を減らすものであり、AIの推論処理そのものがGPUの演算コアに与える負荷とは、必ずしもイコールではないからだ。ゲームのレンダリングとAIの推論がGPUリソースを奪い合う構図は変わらない。

このアップデートが真に評価されるべきは、より多くのユーザーがG-Assistを「試せる」ようになったこと、そして、その上で現実的なパフォーマンスがどの程度達成されているか、という点にかかっている。NVIDIAがこの根本的な課題にどう向き合ったのか、8月19日にリリースされるGame Ready DriverとNVIDIA Appのアップデートを、世界中のゲーマーが固唾を飲んで見守っている。

AIアシスタントはPCゲーミングの「標準装備」となるか

今回のGamescomでの発表は、NVIDIAが描くAI PC戦略の核心部分を浮き彫りにした。それは、AIを一部のパワーユーザーや開発者のための特殊なツールから、すべてのゲーマーが日常的にその恩恵を受けられる「標準装備」へと昇華させるという強い意志だ。

VRAM 6GBへの対応拡大と、プラグインハブによるオープンなエコシステムの構築は、そのための両輪である。しかし、その道のりはまだ始まったばかりだ。パフォーマンス問題の克服という喫緊の課題をクリアし、ユーザーが「本当に使える」と実感できる実用性を示せるか。

Project G-Assistは、PCゲーミングの複雑さを解消する救世主となるか、あるいはパフォーマンスを犠牲にする諸刃の剣であり続けるのか。その答えは、間もなく我々ユーザー自身の手によって明らかにされるだろう。いずれにせよ、このアップデートが、AIとゲーミングの関係を新たなステージへと押し上げる、重要な一歩であることは間違いない。

Sources