2026年1月7日(米国時間)、OpenAIは同社のAIチャットボットにおける新たな専用領域「ChatGPT Health(ChatGPT ヘルスケア)」を正式に発表した。

この動きは、週間2億3,000万人ものユーザーがすでにChatGPTに対して健康相談を行っているという事実を背景に、断片化された個人の医療データ(EHR)やウェアラブルデバイスのログを統合し、AIによる高度な健康管理を実現しようとする、OpenAIの極めて野心的なエコシステム戦略の幕開けと言える。

本稿では、発表された「ChatGPT ヘルスケア」の機能詳細、Appleヘルスケア等との連携、そして最も懸念されるプライバシー保護の仕組みについてを見ていきたい。

週間2.3億人の「隠れた需要」と専用空間の必然性

OpenAIが公開したデータによると、世界中で毎週2億3,000万人以上がChatGPTに対して健康やウェルネスに関する質問を投げかけているという。これまでユーザーは、一般的なチャット画面で「頭痛の原因は?」「マラソンのトレーニングメニューを作って」といった対話を行ってきた。

しかし、この「一般的な体験」には大きな課題があった。それは、コンテキストの欠如とデータの安全性だ。

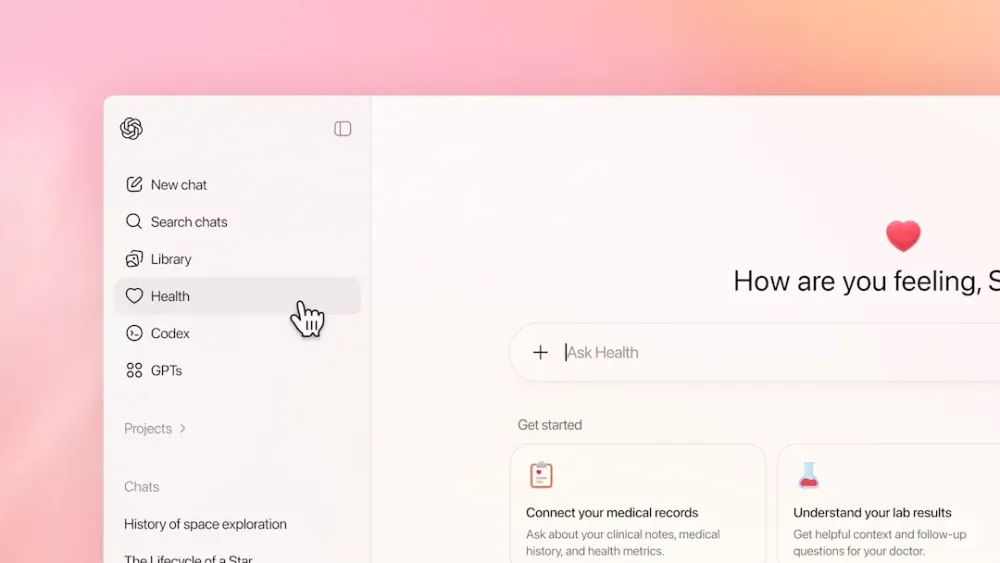

新設された「ChatGPT ヘルスケア」は、サイドバーに追加される独立したスペース(サンドボックス)として機能する。ここでの会話は、通常のチャット履歴とは明確に隔離(サイロ化)される。

なぜ「隔離」が必要なのか?

筆者は、この隔離構造こそが本機能の核心であると見る。

- コンテキストの汚染防止: 通常のチャットでコーディングや旅行の計画について話している最中に、過去の病歴が文脈として混入することを防ぐ。

- 心理的安全性: ユーザーが「ここは医療専用の診察室である」と認識することで、より正確で詳細な症状やデータを入力する動機付けとなる。

- データガバナンス: 後述するが、この領域のデータはAIの学習に使用されないという厳格なルールを適用するための技術的な境界線となる。

なお、通常のチャットで健康に関する話題が出た場合、AIはユーザーに対し「ヘルスケア」セクションへ移動するようナッジ(誘導)を行う設計となっている。

Appleヘルスケア、電子カルテとの「ディープ・インテグレーション」

今回の発表で最も注目すべきは、外部データソースとの連携機能だ。これまでの「テキストベースの相談」から、「自身の生体データに基づいた分析」へとフェーズが移行する。

連携可能な主要プラットフォーム

OpenAIは以下のサービスやデータソースとのAPI連携を発表している。

- Apple ヘルスケア: iPhoneやApple Watchで収集された歩数、睡眠、心拍数などのアクティビティデータ。

- MyFitnessPal / Weight Watchers: 食事記録やカロリー摂取状況。

- Function: ラボテスト(血液検査など)の結果データ。

- 電子健康記録 (EHR): 米国の医療データ接続インフラ企業 b.well と提携し、米国内の多くの医療機関の診療記録をインポート可能にする(EHR連携は米国先行)。

具体的なユースケース:断片情報の統合

ユーザーは、PDFで受け取った血液検査の結果をアップロードしたり、Apple Watchの睡眠データを接続したりすることで、以下のような対話が可能になる。

- 「先月の血液検査の結果に基づき、コレステロール値を改善するための今週の食事プランを、MyFitnessPalの履歴を考慮して作成して」

- 「最近、睡眠の質が落ちているが、活動量との相関関係はあるか?」

- 「来週の医師との診察に向けて、過去半年の私の体調変化のサマリーを作成して」

これまでユーザー自身が頭の中で繋ぎ合わせていた「ウェアラブルのデータ」「病院の検査結果」「日々の食事」を、AIが統合的に解釈する役割を担うことになる。

「学習データには使わない」:プライバシーと信頼性の攻防

医療データを扱う以上、避けて通れないのがプライバシーとハルシネーション(幻覚)の問題だ。これに関しては、OpenAIはこの点に極めて慎重なアプローチを取っている。

1. 学習への利用禁止

OpenAIは明言している。「ChatGPT ヘルスケア内での会話やデータは、基盤モデルのトレーニングには使用されない」。

これは、デフォルト設定として適用される。通常のチャットでは、オプトアウトしない限り会話データが学習に回る可能性があるが、ヘルスケア領域では逆のアプローチが取られている。これは、HIPAA(米国の医療保険の携行性と責任に関する法律)などの規制を意識した措置であり、企業としての法的リスクヘッジであると同時に、ユーザーの信頼獲得のための必須条件だ。

2. 医療アドバイスの限界と「HealthBench」

OpenAIのアプリケーション責任者であるFidji Simo氏は、本機能が「診断や治療を目的としたものではない」と強調している。AIはあくまで「情報の整理」と「準備」を支援するツールという位置づけだ。

しかし、不正確な回答は健康被害に直結する。これに対処するため、OpenAIは以下のプロセスを経てモデルを調整した。

- 専門家との協働: 60カ国、260人以上の医師と2年以上にわたり協力。

- HealthBench: 独自の評価フレームワークを開発。単なる医学的知識の正確性だけでなく、「いつ医師の受診を促すべきか」「ユーザーの不安を煽らない表現か」といった臨床現場の判断基準(クリニカル・ジャッジメント)を評価指標に組み込んでいる。

Appleのヘルスケアアプリとの連携への懸念

一方で、Apple ヘルスケアのデータをChatGPTに接続することに対しては、一つ注意しなければならない点がある。AppleのSiri経由でのChatGPT利用は、Apple側で個人情報を匿名化してから送信されるが、今回の直接連携ではユーザーがOpenAIに対して直接データアクセス権を付与することになる。

OpenAIがいかに「学習に使わない」と宣言しても、サーバー上にデータが渡るという構造上のリスクは残る。ユーザーは利便性とプライバシーのトレードオフを慎重に判断する必要があるだろう。

OpenAIが「医療」を垂直統合する意味

今回の動きは「検索エンジンの代替」を超えた、「パーソナル・エージェント」としての地位確立に向けた決定打であると考えられる。

Google・Appleへの対抗策

GoogleはすでにFitbitを買収し、Geminiを用いた医療特化モデル(Med-Gemini)を開発している。Appleも「Quartz」や「Mulberry」といったコードネームでAIヘルスコーチング機能を開発中と噂されている。

しかし、OpenAIはプラットフォーム(OS)を持たないがゆえに、Apple ヘルスケアやAndroid上のアプリと中立的に連携できるという強みがある。OSの壁を越えてデータを集約できる「医療データのハブ」としてのポジションを、競合に先駆けて取りに来た形だ。

「Dr. Google」から「Dr. ChatGPT」へ

かつて人々は症状を検索窓に打ち込み(Dr. Google)、大量の検索結果から自分に当てはまる情報を探すのに疲弊していた。ChatGPT ヘルスケアは、個人の医療データを前提に、ピンポイントで回答を生成する。これは情報探索のコストを劇的に下げる革命であり、検索エンジンの広告モデルにとって脅威となり得る。

今後の展開と利用可能性

ロールアウト計画

- 提供開始: ベータ版として順番待ちリスト登録者から順次開放。数週間以内にPlus、Pro、Team、および無料ユーザーへも拡大予定。

- 地域制限: 現時点ではEEA(欧州経済領域)、英国、スイスでは提供されない。GDPRなどの厳格なデータ保護規制への対応が完了していないためと推測される。

- EHR連携: 電子カルテ連携は米国市場が中心となる。日本国内でのEHR連携は、マイナポータル等とのAPI整備が進むまで時間を要するだろう。

AIが「あなたの体」を理解する時代の到来

OpenAIによる「ChatGPT ヘルスケア」の発表は、AIが単なる知的作業のアシスタントから、人間の生存そのものに関わるパートナーへと進化する象徴的な出来事だ。

2.3億人の週間ユーザーという圧倒的な基盤に対し、医療データという「究極の個人情報」を統合させる試みは、成功すれば医療のアクセシビリティや予防医学の在り方を根本から変える可能性がある。一方で、セキュリティ事故や誤った助言によるリスクもかつてないほど高まっている。

我々は今、自らの身体情報をシリコンバレーのアルゴリズムに委ねるかどうかの、大きな分岐点に立っていると言えるだろう。

Sources

- OpenAI: ChatGPT ヘルスケアが登場