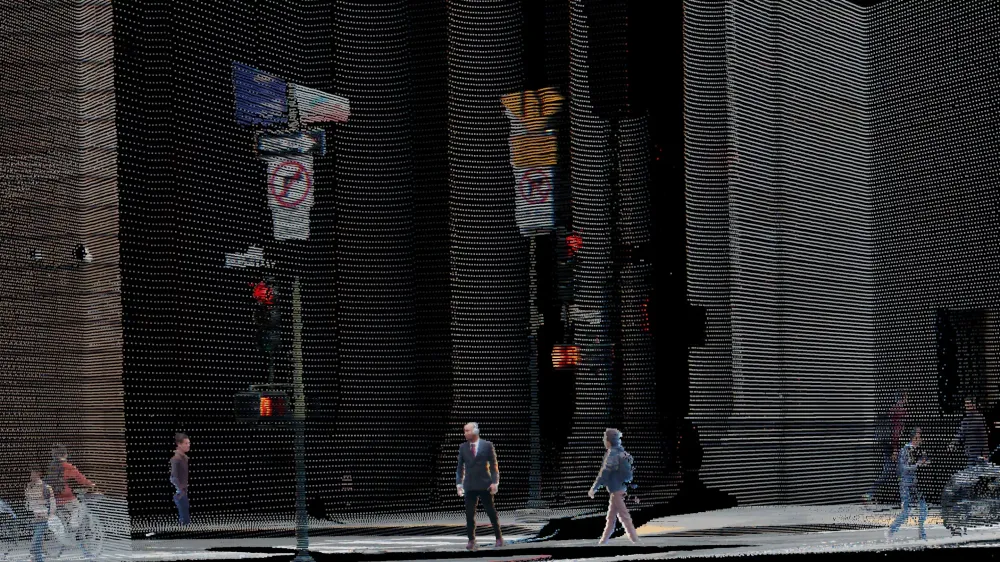

自動運転車が夜間の交差点に差し掛かる。現在のAIが見ているのは、無数の点からなる冷たい幾何学模様の集合体だ。レーザーの反射時間を計測して作られた精緻な3Dマップは、障害物との距離をミリ単位で割り出すが、信号の赤も、歩行者が着ているジャケットの色も、そのままでは認識できない。世界は鮮やかな色に溢れているというのに、最先端のロボットたちの眼は、本質的に「色盲」だったのである。

世界を測る眼の限界。後処理がもたらす時間のズレと空間の歪み

現在の自動運転やロボティクスは、立体を把握する能力において驚異的な進化を遂げてきた。その中核にあるのがLiDAR(Light Detection and Ranging)である。LiDAR単体では世界をモノクロの形状としてしか認識できないため、自動運転システムが路面に引かれた黄色い車線や前方の車両のブレーキランプを認識するには、カメラという別のセンサーに頼らざるを得ない。

ここで業界の主流となっているのが、LiDARで測った精緻な距離・形状データと、カメラで取得した2Dの色彩画像をソフトウェア上で後から縫い合わせる「センサーフュージョン」というアプローチだ。物理的に異なる位置に設置された二つのセンサーから送られてくるデータを統合する際、キャリブレーションの誤差や計算処理の遅延が避けられない。時速100キロメートルで高速道路を巡航する車両において、わずか数十ミリ秒の計算遅延や、カメラとLiDARの空間的なマッピングのズレは、システムが障害物の存在と属性を見誤る直結要因となる。

ソフトウェアアルゴリズムによる後処理のフュージョンが限界に直面しているならば、どうすれば機械は人間の目と同じように「形」と「色」を完璧に同期した状態で知覚できるのだろうか。

物理層での融合。L4 Ouster Siliconが実現するネイティブカラーの衝撃

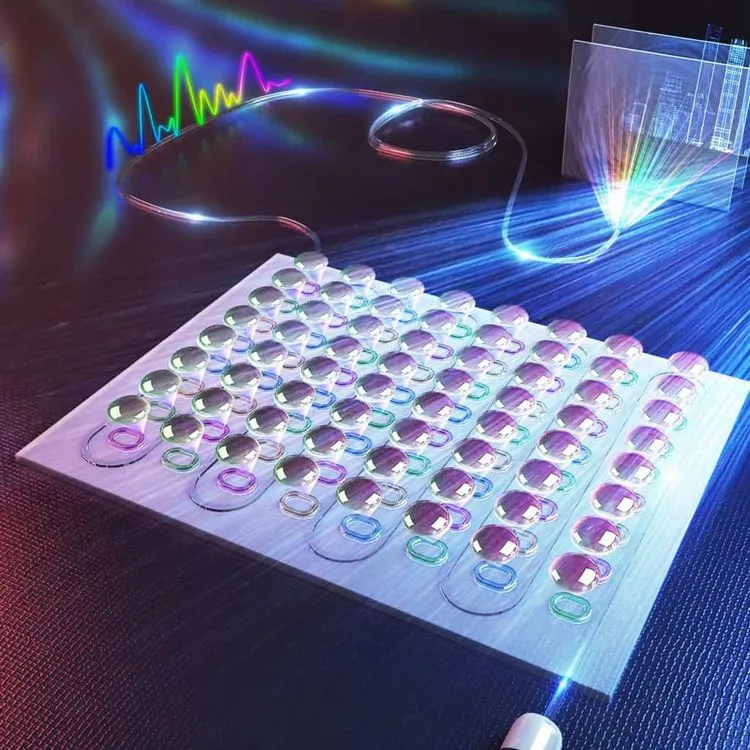

米Ousterが新たに発表した「Rev8」センサーファミリーは、この難問に対する物理学とシリコン設計からの鮮烈な回答である。彼らはソフトウェアによる複雑な後処理を捨て、センサーのハードウェアレベルで三次元の距離データと可視光による色情報を一体化させた、世界初のネイティブカラーLiDARを完成させた。

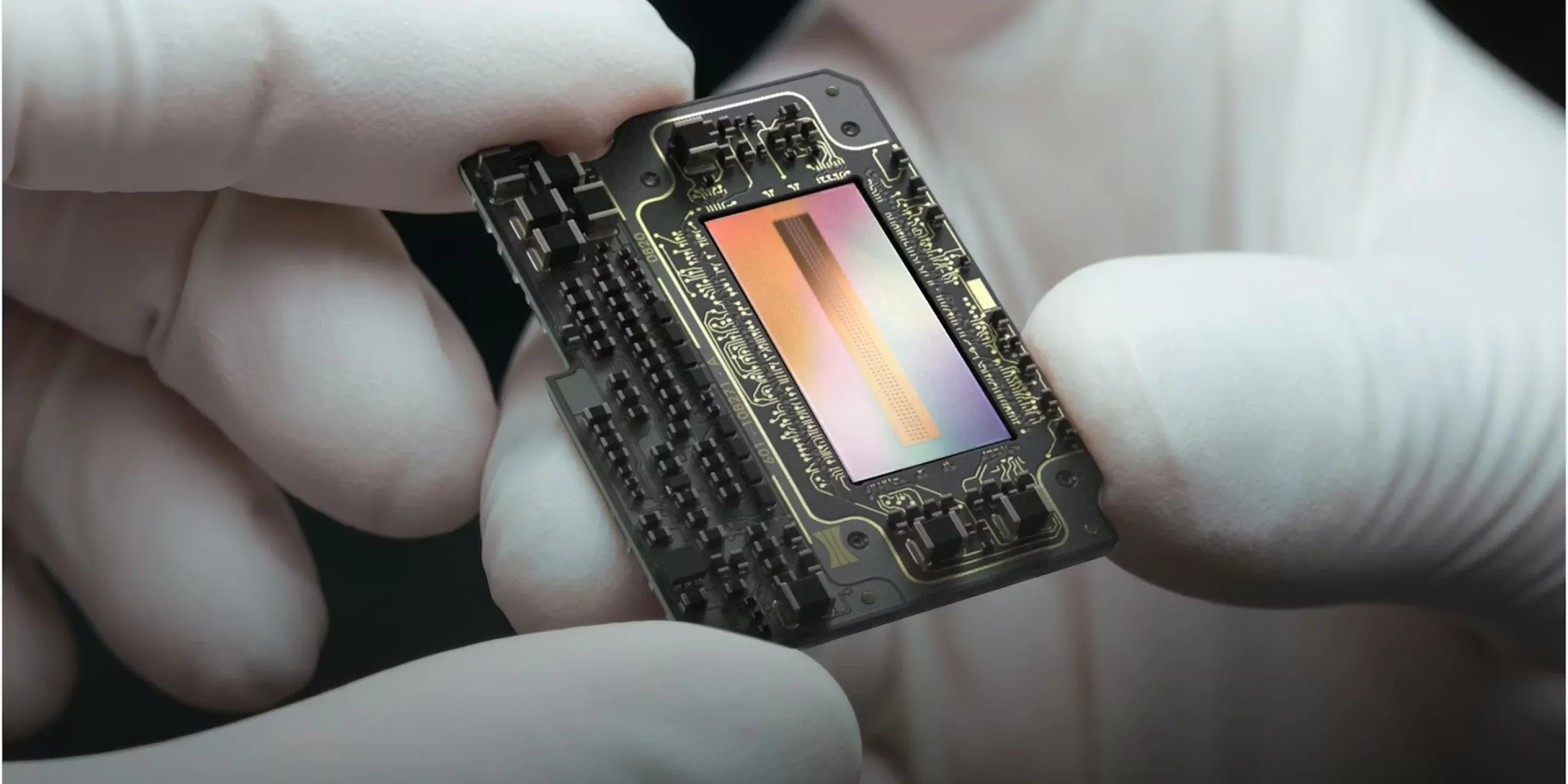

技術的ブレイクスルーの核心は、次世代チップ「L4 Ouster Silicon」に集約されている。この新設計のアーキテクチャは、毎秒20兆個の光子を検出し、40kHzの測定レートとピコ秒単位のタイミング精度を叩き出す。計算能力は42.9 GMACsに達し、毎秒最大1040万点のポイントクラウド(点群)データを処理するという途方もないスペックを誇る。

特筆すべきは、同社が写真フィルムやデジタルカメラの知見を持つ富士フイルムと協業し、そのカラーサイエンスをL4チップに直接組み込んだことだ。LiDARが発射して跳ね返ってきた近赤外線の反射データに、その同じ座標の可視光の色彩データを物理レベルで融合させている。生成されるすべてのドット(点)は、生まれた瞬間から色を持っている。

このネイティブカラーデータは、48ビットの色深度と116dBのダイナミックレンジを確保している。「116dBのダイナミックレンジ」とは、夏の強烈な西日が差し込む状況下(約200万lux)を走りながら、同時に暗いトンネルの奥深く(1lux)に潜む障害物を黒つぶれせずに見分けることができる眼球の柔軟性に等しい。複雑なソフトウェア補正を一切必要とせず、あらゆる照明環境下で完璧な空間的・時間的同期を保ったデータがシステムへ直接入力されるのである。

制動距離の支配。OS1 Maxが切り拓く500メートル先の視界

Rev8ファミリーのフラッグシップとして投入された「OS1 Max」は、前世代のRev7から解像度と測定範囲を倍増させている。256チャネルの高解像度スキャン機構を備え、光をほとんど反射しない10パーセントの低反射率の物体(例えば黒いタイヤや暗い衣服を着た歩行者など)であっても200メートル先から捕捉可能だ。最大検出距離は500メートルに達し、垂直方向45度、水平方向360度の広大な視野をカバーする。

500メートルという長大な距離は、高速道路でのレベル4自動運転において決定的な意味を持つ。時速120キロメートルで走行する車両が落下物や停止車両を発見して安全に回避行動をとるためには、システムが状況を認知して軌道を再計算するための十分な時間的余裕が不可欠だ。旧来のセンサーが200メートルから300メートルの視界に留まっていたのに対し、OS1 Maxは制動距離に対する広大なマージンを自動運転システムに提供する。

| スペック / モデル | Ouster Rev7 (旧世代) | Ouster Rev8 OS1 Max (新世代) | 従来型センサーフュージョン |

|---|---|---|---|

| 色情報の取得方法 | 非対応(モノクロ点群) | ハードウェアでのネイティブ統合 | ソフトウェアでの後処理結合 |

| 最大検出距離 | 約200m〜300mクラス | 500m | LiDARの性能に依存 |

| チャネル数 | 128チャネル | 256チャネル | - |

| キャリブレーション | 不要 | 不要 | 定期的な厳密な調整が必須 |

| NVIDIAエコシステム | 対応 | DRIVE Hyperionネイティブ対応 | システム構築側の実装に依存 |

この圧倒的な物理データは、NVIDIAの自動運転向けプラットフォーム「DRIVE Hyperion」へそのまま流し込まれる。OusterはRev8ファミリーをNVIDIAのDriveWorks SDKに最適化したプラグインとして提供し、ハードウェアアクセラレーションが効いたNVIDIAのソフトウェアスタックへ直接データを送り込む認証を取得した。レベル4の自律走行システムを開発する自動車メーカーは、独自に膨大な検証作業を行う手間を省き、最先端のチップとセンサーを組み合わせた開発環境を即座に構築できる。

DXOMARKの参入が物語るアノテーションパイプラインの変革

このRev8の登場によって、LiDARという計測機器はカメラと同じ画質評価の俎上に載ることになった。画質評価の世界的権威であるDXOMARKがOusterと戦略的協業を結んだことは極めて象徴的である。DXOMARKは過去20年にわたりスマートフォンやデジタルカメラのセンサーを評価してきたが、彼らがLiDARの色彩忠実度や環境耐性をテストするという事実は、LiDARが純粋な距離計から総合的な視覚センサーへとパラダイムシフトを遂げたことを意味している。

ハードウェアレベルで完全に同期した色と立体のデータは、AIモデルの開発コストを激減させる可能性を秘めている。現在の先進運転支援システム(ADAS)や自動運転モデルの訓練には、収集したデータに対して「これは歩行者」「これは信号機」とタグ付けを行うデータアノテーション(ラベリング)作業が必須である。従来は人間が目視で確認し、3Dの点群データと2Dのカメラ画像を突き合わせながら手作業でラベルを付与するという、泥臭く膨大なコストのかかる作業を強いられてきた。

Rev8が吐き出す色付きの3Dデータは、このアノテーションパイプラインの完全自動化への扉を開く。システム側で「赤い色の点群の集まりは一時停止の標識である」といった法則を直感的に学習させることが可能になり、AIの訓練サイクルが劇的に短縮されるのだ。

多次元化する知覚。Hesai「6D ETX」と交錯する次世代アーキテクチャの対立

市場を見渡せば、知覚技術の進化はOuster一社の独走状態ではない。中国のLiDAR最大手であるHesai Groupは、直近で「6D ETX」と名付けられたフルカラープラットフォームを発表した。ここには、次世代のパーセプションエンジンを巡る明確な思想の対立が存在している。

OusterがL4チップを用いた色情報と点群の完全な空間的同期に主眼を置いているのに対し、HesaiのアプローチはX、Y、Zの空間座標に加えて、反射率、速度、そして色の6次元データを統合するというものだ。特に「速度(Velocity)」をドップラー効果を用いてハードウェアレベルで直接計測しようとする試みは、空間内のオブジェクトがどこに向かって動いているかというベクトル情報までを一元化する。色の統合を最優先するか、動的ベクトルを含めた多次元データの網羅性を重視するか。自動運転エコシステムにおいてどちらのアプローチが覇権を握るかは、後段のAIモデルがどのようなフォーマットのデータを最も効率よく咀嚼できるかに依存している。

StereoLabs買収の深層。「Physical AI」を駆動するワールドモデルの構築

ハードウェアの競争が激化する中、Ousterの真の狙いは部品の売り切りモデルからの脱却にある。2026年2月に実行されたコンピュータビジョン専門企業StereoLabsの3800万ドルでの買収劇は、同社が包括的なパーセプション(知覚)プラットフォーム企業へと舵を切ったことを鮮明に示している。

StereoLabsは、ステレオカメラと空間AIを用いて高精度な3Dマッピングを行う「ZED」カメラシリーズで知られる。彼らが持つ最大の武器は、視覚情報から空間の意味を推論し、リアルタイムで環境を理解する強力なソフトウェアの知見だ。OusterがRev8で生成したネイティブカラーの点群データは、StereoLabsのアルゴリズムと組み合わさることで初めて真の価値を発揮する。

その価値とは、次世代の「ワールドモデル」の構築基盤となることだ。自動運転車や自律型ロボットが現実世界(Physical AI)で稼働するためには、目の前の物理世界をAI内部で正確にシミュレーションし、次に何が起きるかを予測する強固な基盤モデルが必要不可欠である。色と立体情報が初めから完全にアライメントされたRev8のデータセットは、このワールドモデルの学習コストを劇的に引き下げる。自社ハードウェアでノイズのない極上の基礎データを生成し、自社傘下のソフトウェアでそれを解釈・学習する。これがOusterの描く垂直統合のグランドデザインである。

毎秒22.4ギガビットの代償。Zonalアーキテクチャと車載ネットワークへの重圧

革新的な技術的跳躍は、自動車メーカーに新たな試練を突きつけている。最大の懸念事項は、データ帯域の爆発的な増加と車載ネットワークへの負荷である。新開発のL4チップは、最大で毎秒22.4ギガビットという途方もないデータをオフチップへ送信する。解像度の向上と48ビットの色情報が加わったことで、センサーが吐き出すデータ量は従来のLiDARの比ではない。

自動車業界は現在、無数のECU(電子制御ユニット)を分散配置する古い設計から、数個の強力な車載コンピューターで車両全体を制御する「Zonal(統合型) E/Eアーキテクチャ」への移行期にある。テスラや新興EVメーカーが牽引するこのアーキテクチャにおいて、センサーからの生データは高速な車載イーサネットを通じて中央のAIプロセッサへと集約される。しかし、毎秒数十ギガビットというLiDARの常時ストリーミングデータは、現在の最新の車載ネットワークの帯域幅すらも容易に食いつぶす恐れがある。

大容量データを遅延なく伝送するための高性能なスイッチングハブや太いワイヤーハーネスの採用は、車両全体の製造コストを押し上げ、熱設計や消費電力の上昇を招く。OusterはRev8の製造コストを抑え、10年間の生産寿命を見据えたマスマーケットへの展開を強調している。GoogleやVolvo Autonomous Solutionsをはじめとする数十社がすでに採用の意向を示しているものの、普及価格帯の乗用車がこのフラッグシップセンサーを無理なく消化するためには、自動車側の神経系インフラの大規模なアップデートが伴わなければならない。

AIが真の意味で世界を色彩豊かに認識し、私たちの日常を安全にナビゲートする日は着実に近づいている。その目覚めの裏側では、膨大なデータを処理し切るための新しい物理的インフラの構築と、次世代ソフトウェアの覇権を懸けた総力戦がすでに始まっているのである。